Linguistic Comparison of AI- and Human-Written Responses to Online Mental Health Queries

作者: Koustuv Saha, Yoshee Jain, Munmun De Choudhury

分类: cs.HC, cs.AI, cs.CL, cs.SI

发布日期: 2025-04-12

💡 一句话要点

对比分析AI与人类在在线心理健康社区的回复,揭示AI在共情和个性化方面的局限性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 在线心理健康社区 生成式AI 大型语言模型 语言学分析 心理语言学

📋 核心要点

- 在线心理健康社区面临挑战,即如何大规模提供个性化和有同理心的支持,现有方法难以兼顾。

- 本研究对比分析了AI和人类在在线心理健康社区的回复,评估AI在提供细致支持方面的能力。

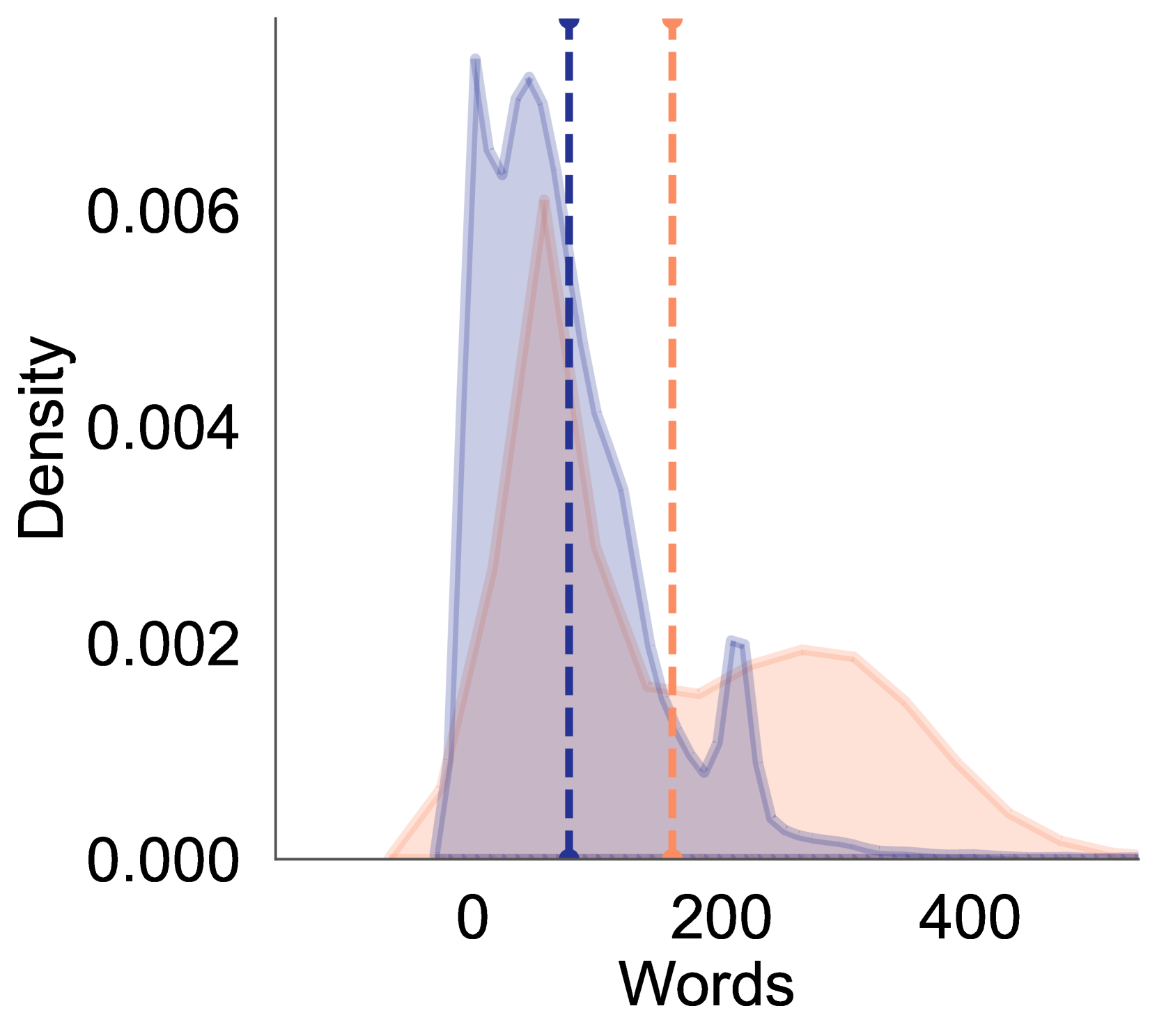

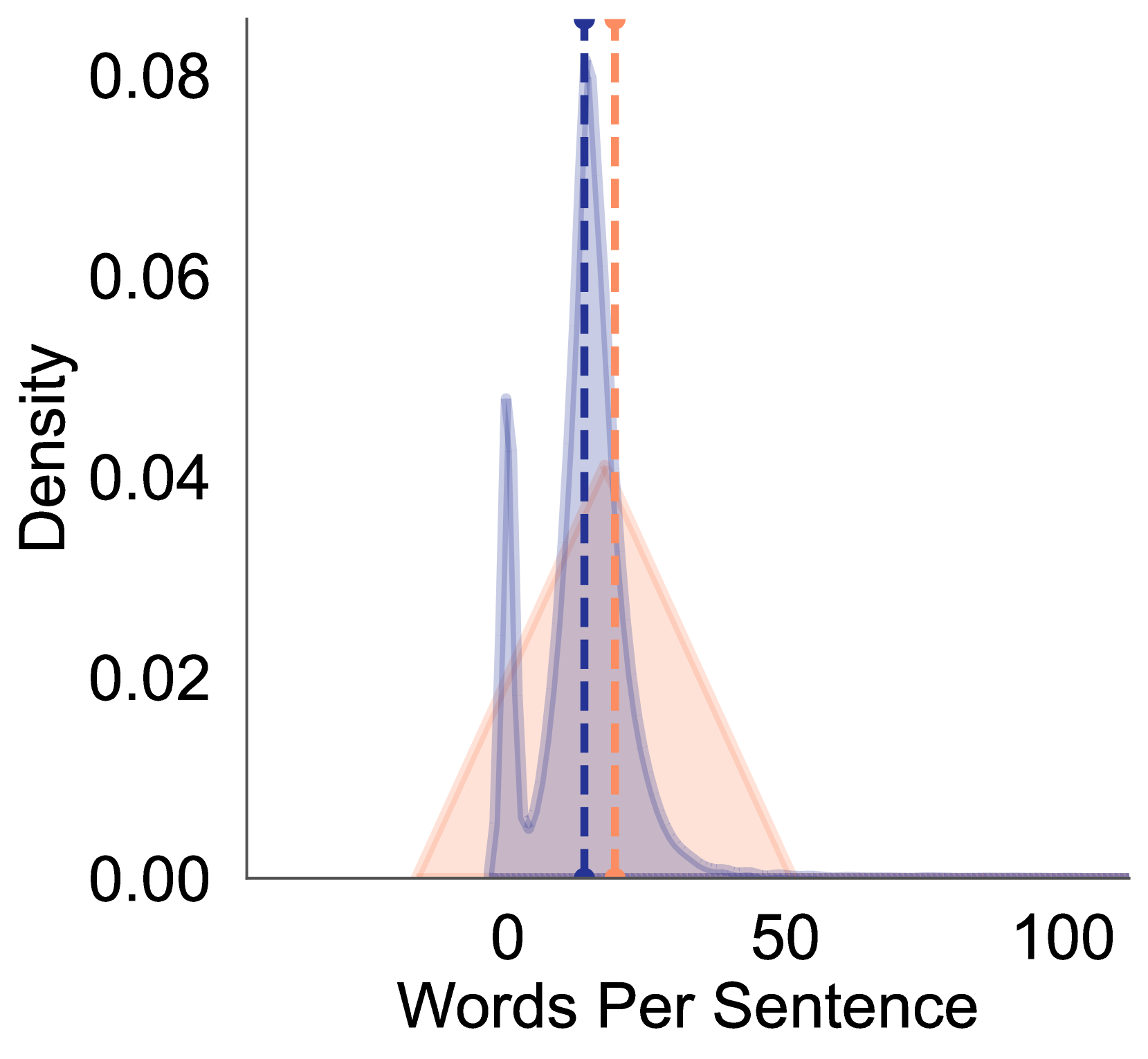

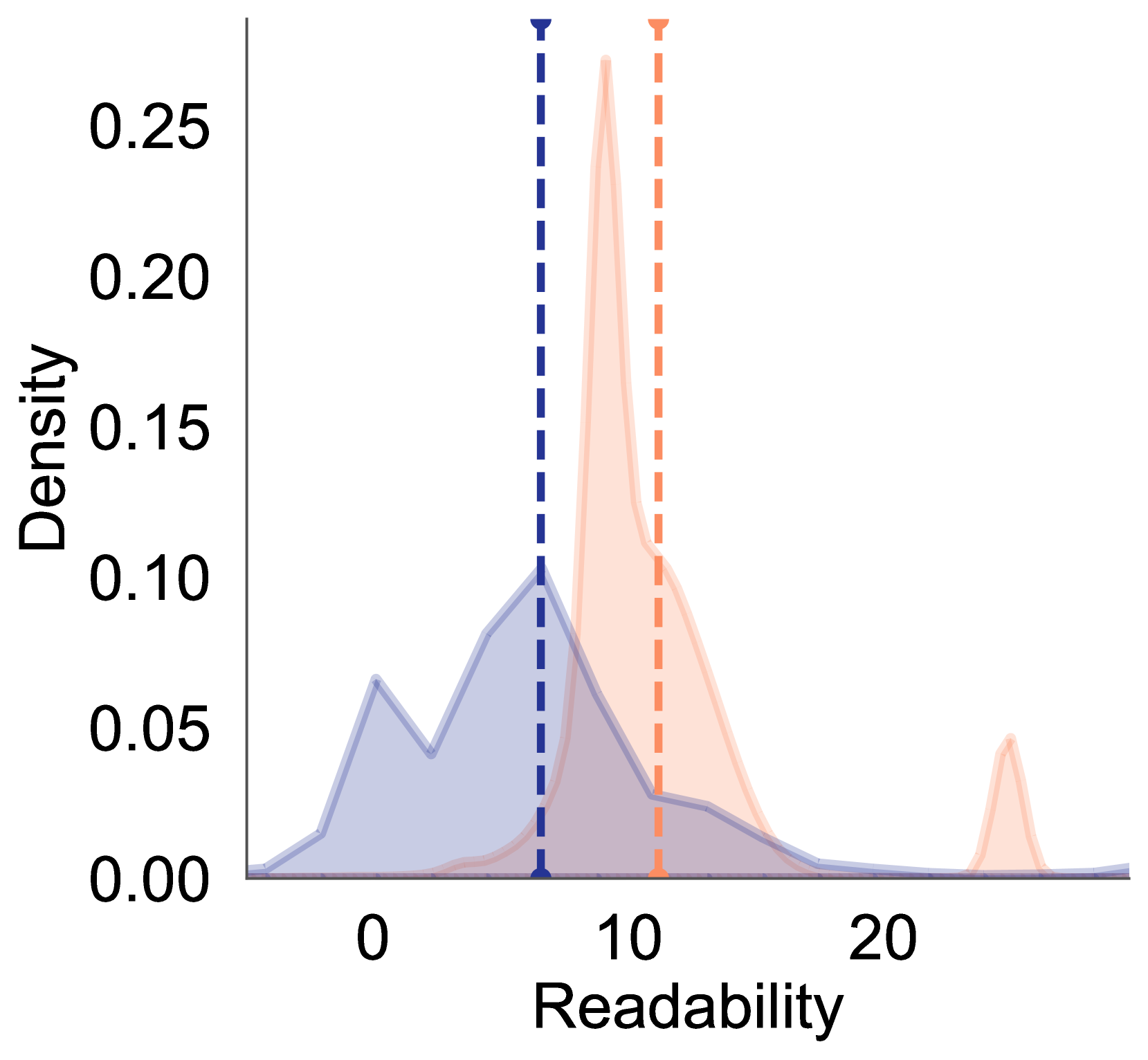

- 实验结果表明,AI回复在结构和可读性上更优,但在语言多样性和个人叙述方面不如人类回复。

📝 摘要(中文)

随着数字技术的普及,在线心理健康社区(OMHCs)为同伴支持提供了安全空间。生成式AI和大型语言模型(LLMs)为全天候心理健康援助提供了新的可能性,可以增强和补充OMHCs的能力。尽管genAI在提供即时和个性化回复方面显示出潜力,但它们在复制人类同伴基于经验的细致支持方面的有效性仍是一个悬而未决的问题。本研究利用来自Reddit上55个OMHCs的24,114个帖子和138,758个在线社区(OC)回复,使用这些帖子提示了几个最先进的LLM(GPT-4-Turbo、Llama-3和Mistral-7B),并基于心理语言学和词汇语义学的各种语言学指标,将它们的(AI)回复与人类撰写的(OC)回复进行了比较。研究结果表明,AI回复更冗长、更易读、结构更具分析性,但缺乏人类互动中固有的语言多样性和个人叙述。通过定性检查,我们发现了对AI回复性质的验证和补充见解,例如其立场的中立性和缺乏寻求来回澄清。我们讨论了将生成式AI集成到OMHCs中的伦理和实践意义,提倡平衡AI的可扩展性和及时性与人类连接的不可替代的真实性、社交互动性和专业知识的框架,这些框架构成了在线支持社区的精神。

🔬 方法详解

问题定义:论文旨在解决的问题是,如何评估生成式AI在在线心理健康社区中提供支持的有效性,特别是与人类提供的支持相比。现有方法缺乏对AI回复在语言风格、共情能力和个性化程度上的深入分析,无法充分了解AI在这一领域的潜力和局限性。

核心思路:论文的核心思路是通过对比分析AI和人类在在线心理健康社区中的回复,量化AI在语言风格、情感表达和互动模式上的差异。通过这种对比,可以揭示AI在提供心理健康支持方面的优势和不足,为未来AI在这一领域的应用提供指导。

技术框架:整体框架包括以下几个主要阶段:1) 数据收集:从Reddit上的55个OMHCs收集帖子和回复数据。2) AI回复生成:使用GPT-4-Turbo、Llama-3和Mistral-7B等LLM对帖子生成回复。3) 语言学分析:使用心理语言学和词汇语义学指标对AI和人类回复进行量化分析。4) 定性分析:对AI回复进行人工分析,以补充量化分析的结果。

关键创新:论文的关键创新在于:1) 系统性地对比分析了AI和人类在在线心理健康社区中的回复,揭示了AI在语言风格和情感表达上的差异。2) 结合量化和定性分析方法,更全面地评估了AI在提供心理健康支持方面的能力。3) 探讨了将生成式AI集成到OMHCs中的伦理和实践意义,为未来AI在这一领域的应用提供了指导。

关键设计:论文的关键设计包括:1) 选择了具有代表性的LLM(GPT-4-Turbo、Llama-3和Mistral-7B)作为AI回复生成模型。2) 使用了多种心理语言学和词汇语义学指标,如词汇多样性、情感强度和可读性等,对AI和人类回复进行量化分析。3) 进行了人工分析,以补充量化分析的结果,并更深入地了解AI回复的性质。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AI回复在冗长性、可读性和分析结构方面优于人类回复,但在语言多样性和个人叙述方面存在不足。定性分析发现,AI回复通常保持中立立场,缺乏寻求澄清的互动,这表明AI在提供共情和个性化支持方面仍有提升空间。

🎯 应用场景

该研究成果可应用于在线心理健康支持系统的设计与评估,帮助开发者更好地利用AI技术,同时避免其潜在风险。研究结果为制定AI在心理健康领域的伦理规范和实践指南提供了参考,促进负责任的AI应用。

📄 摘要(原文)

The ubiquity and widespread use of digital and online technologies have transformed mental health support, with online mental health communities (OMHCs) providing safe spaces for peer support. More recently, generative AI and large language models (LLMs) have introduced new possibilities for scalable, around-the-clock mental health assistance that could potentially augment and supplement the capabilities of OMHCs. Although genAI shows promise in delivering immediate and personalized responses, their effectiveness in replicating the nuanced, experience-based support of human peers remains an open question. In this study, we harnessed 24,114 posts and 138,758 online community (OC) responses from 55 OMHCs on Reddit. We prompted several state-of-the-art LLMs (GPT-4-Turbo, Llama-3, and Mistral-7B) with these posts, and compared their (AI) responses to human-written (OC) responses based on a variety of linguistic measures across psycholinguistics and lexico-semantics. Our findings revealed that AI responses are more verbose, readable, and analytically structured, but lack linguistic diversity and personal narratives inherent in human-human interactions. Through a qualitative examination, we found validation as well as complementary insights into the nature of AI responses, such as its neutrality of stance and the absence of seeking back-and-forth clarifications. We discuss the ethical and practical implications of integrating generative AI into OMHCs, advocating for frameworks that balance AI's scalability and timeliness with the irreplaceable authenticity, social interactiveness, and expertise of human connections that form the ethos of online support communities.