MCP Bridge: A Lightweight, LLM-Agnostic RESTful Proxy for Model Context Protocol Servers

作者: Arash Ahmadi, Sarah Sharif, Yaser M. Banad

分类: cs.CR, cs.AI

发布日期: 2025-04-11 (更新: 2026-01-12)

备注: 29 pages, 11 figures

💡 一句话要点

提出MCP Bridge轻量级RESTful代理,解决LLM与MCP服务器在资源受限环境下的连接难题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 模型上下文协议 RESTful代理 大型语言模型 强化学习 安全执行 跨平台兼容 边缘计算 Qwen模型

📋 核心要点

- 现有MCP实现依赖本地进程执行,不适用于移动设备、浏览器和边缘计算等资源受限环境。

- MCP Bridge通过RESTful代理连接多个MCP服务器,提供统一API,支持多种LLM后端,并具备风险控制的安全机制。

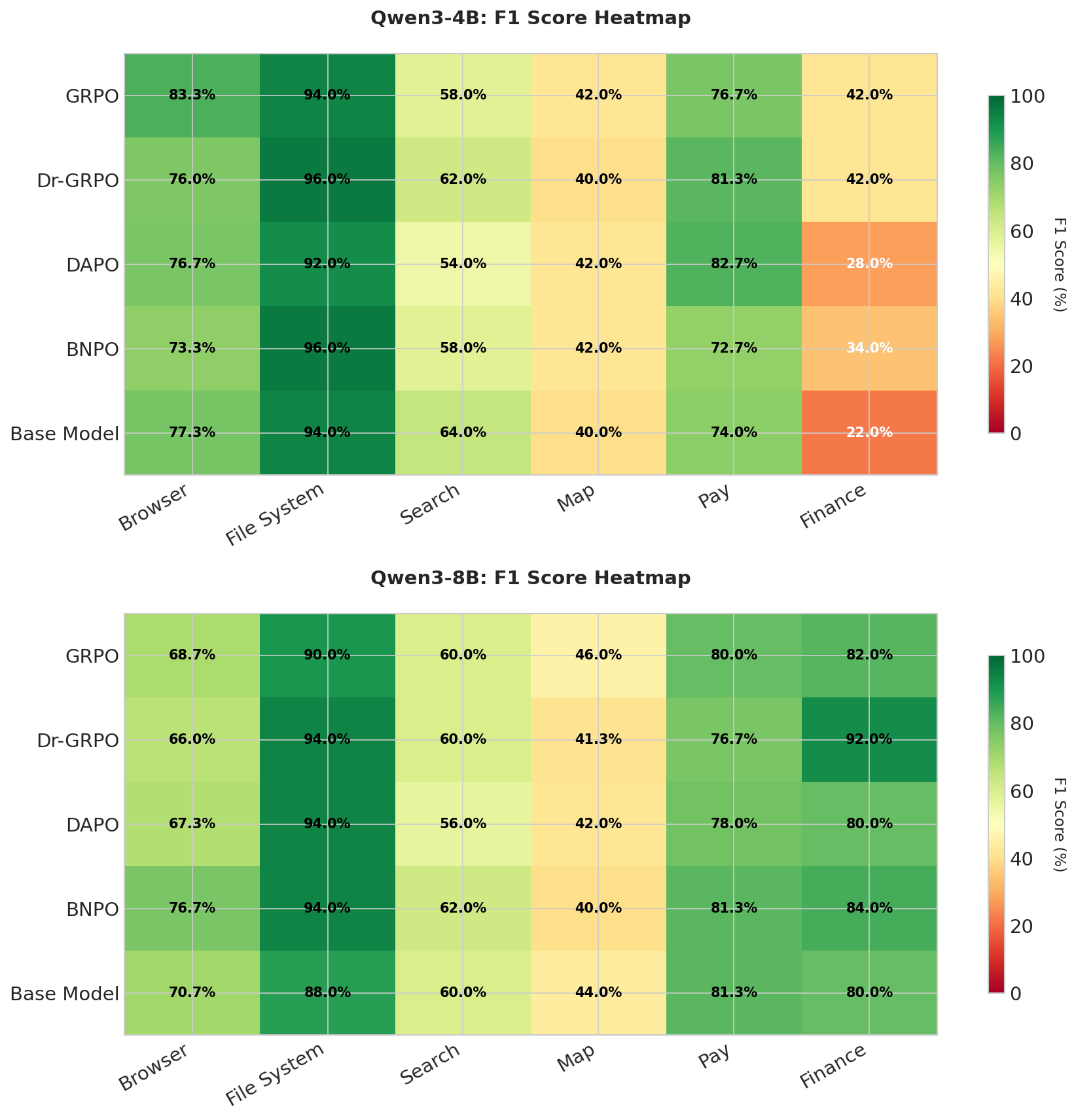

- 通过强化学习微调Qwen模型,在MCPToolBench++上达到73.0%的F1分数,超越GPT-OSS-120B。

📝 摘要(中文)

大型语言模型(LLM)越来越多地通过模型上下文协议(MCP)等标准化接口与外部工具集成。然而,当前的MCP实现存在局限性:它们通常需要通过STDIO传输进行本地进程执行,这使得它们在移动设备、Web浏览器和边缘计算等资源受限的环境中不切实际。我们提出了MCP Bridge,一个轻量级的RESTful代理,它连接到多个MCP服务器,并通过统一的API公开它们的功能。与现有解决方案不同,MCP Bridge完全与LLM无关,支持任何供应商的后端。该系统实现了一种基于风险的执行模型,具有三个安全级别——标准执行、确认工作流和Docker隔离——同时保持与标准MCP客户端的向后兼容性。为了确保在此框架内的可靠执行,我们还使用四种强化学习技术(GRPO、Dr. GRPO、BNPO和DAPO)在Agent-Ark/Toucan-1.5M数据集上微调了Qwen3 4B和8B模型系列。在MCPToolBench++基准测试中,我们优化的模型实现了73.0%的F1分数,优于GPT-OSS-120B(62.17%),并且与70B+参数的基线模型相比仍具有竞争力。评估表明,MCP Bridge成功地解决了直接MCP连接的限制,同时提供了增强的安全控制和跨平台兼容性,从而在以前无法访问的环境中实现了复杂的LLM驱动的应用程序。

🔬 方法详解

问题定义:现有模型上下文协议(MCP)的实现通常依赖于本地进程执行,通过STDIO进行数据传输。这种方式在资源受限的环境(如移动设备、Web浏览器和边缘计算)中效率低下且难以部署。因此,需要一种轻量级、跨平台的解决方案,使得LLM能够方便地与各种MCP服务器交互,而无需复杂的本地配置。

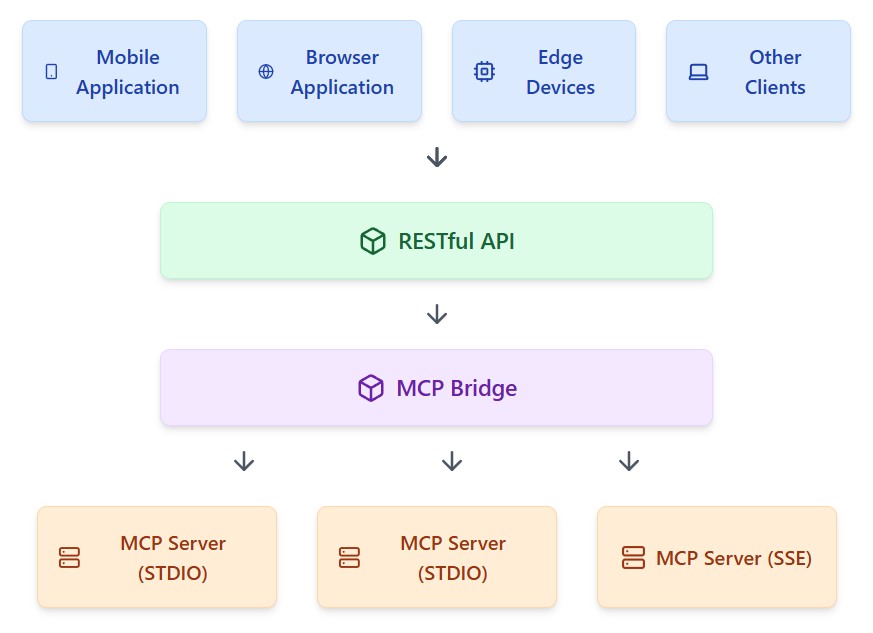

核心思路:MCP Bridge的核心思路是引入一个RESTful代理层,将MCP服务器的能力通过标准的HTTP接口暴露出来。这样,LLM可以通过简单的API调用来访问MCP服务器,而无需直接建立本地连接。这种设计降低了部署复杂性,提高了可扩展性,并且能够支持多种LLM后端。

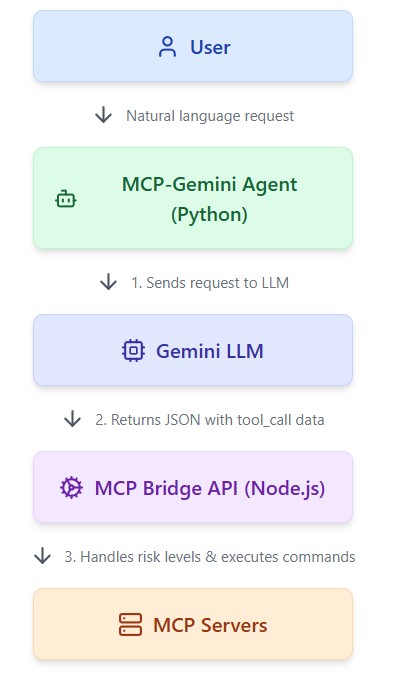

技术框架:MCP Bridge包含以下主要模块:1) RESTful API服务器:负责接收来自LLM的请求,并将其转换为MCP协议消息。2) MCP客户端:负责与实际的MCP服务器进行通信。3) 安全模块:实现基于风险的执行模型,包括标准执行、确认工作流和Docker隔离等安全级别。4) 模型优化模块:使用强化学习技术微调LLM,使其更好地遵循MCP协议规范。整个流程是LLM通过RESTful API向MCP Bridge发送请求,MCP Bridge根据安全级别进行处理,然后将请求转发给MCP服务器,最后将结果返回给LLM。

关键创新:MCP Bridge的关键创新在于其轻量级、LLM无关的设计,以及基于风险的安全执行模型。传统的MCP实现通常与特定的LLM绑定,并且缺乏灵活的安全控制。而MCP Bridge通过RESTful API实现了与LLM的解耦,并且提供了多种安全级别,以适应不同的应用场景。

关键设计:在安全模块中,论文设计了三种安全级别:标准执行、确认工作流和Docker隔离。标准执行直接执行来自LLM的请求;确认工作流需要用户确认才能执行;Docker隔离则将请求放在Docker容器中执行,以防止恶意代码的执行。此外,论文还使用GRPO、Dr. GRPO、BNPO和DAPO等强化学习技术微调Qwen模型,使其能够更好地遵循MCP协议规范,提高任务完成的准确率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,经过强化学习微调的Qwen模型在MCPToolBench++基准测试中取得了显著的性能提升,F1分数达到73.0%,超越了GPT-OSS-120B(62.17%),并且与70B+参数的基线模型相比仍具有竞争力。这证明了MCP Bridge的有效性和优化模型的必要性。

🎯 应用场景

MCP Bridge可广泛应用于需要LLM与外部工具集成的场景,例如智能助手、自动化流程、机器人控制等。它尤其适用于资源受限的环境,如移动设备和边缘计算设备,使得这些设备也能充分利用LLM的能力。该研究为构建更安全、更灵活的LLM应用生态系统奠定了基础。

📄 摘要(原文)

Large Language Models (LLMs) are increasingly augmented with external tools through standardized interfaces like the Model Context Protocol (MCP). However, current MCP implementations face critical limitations: they typically require local process execution through STDIO transports, making them impractical for resource-constrained environments like mobile devices, web browsers, and edge computing. We present MCP Bridge, a lightweight RESTful proxy that connects to multiple MCP servers and exposes their capabilities through a unified API. Unlike existing solutions, MCP Bridge is fully LLM-agnostic, supporting any backend regardless of vendor. The system implements a risk-based execution model with three security levels-standard execution, confirmation workflow, and Docker isolation - while maintaining backward compatibility with standard MCP clients. However, reliable execution within this framework requires models that can strictly adhere to protocol schemas. To this end, we also fine-tuned the Qwen3 4B and 8B model family on the Agent-Ark/Toucan-1.5M dataset using four Reinforcement Learning techniques: Group Relative Policy Optimization (GRPO), Dr. GRPO, Beta Normalization Policy Optimization (BNPO), and Decoupled Alignment Policy Optimization (DAPO). Evaluated on the MCPToolBench++ benchmark, our optimized model achieves an F1 score of 73.0% that outperforms GPT-OSS-120B (62.17%) and remains competitive with the 70B+ parameter baselines. Evaluation demonstrates that MCP Bridge successfully addresses the constraints of direct MCP connections while providing enhanced security controls and cross-platform compatibility, enabling sophisticated LLM-powered applications in previously inaccessible environments.