Do LLMs trust AI regulation? Emerging behaviour of game-theoretic LLM agents

作者: Alessio Buscemi, Daniele Proverbio, Paolo Bova, Nataliya Balabanova, Adeela Bashir, Theodor Cimpeanu, Henrique Correia da Fonseca, Manh Hong Duong, Elias Fernandez Domingos, Antonio M. Fernandes, Marcus Krellner, Ndidi Bianca Ogbo, Simon T. Powers, Fernando P. Santos, Zia Ush Shamszaman, Zhao Song, Alessandro Di Stefano, The Anh Han

分类: cs.AI, cs.CY, cs.GT, nlin.CD

发布日期: 2025-04-11

💡 一句话要点

利用演化博弈论框架,研究LLM智能体在AI监管中的策略行为

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI监管 演化博弈论 大型语言模型 信任机制 AI伦理 策略行为 智能体建模

📋 核心要点

- 现有AI监管缺乏对开发者、监管者和用户之间复杂交互的建模,难以有效促进可信AI系统的采用。

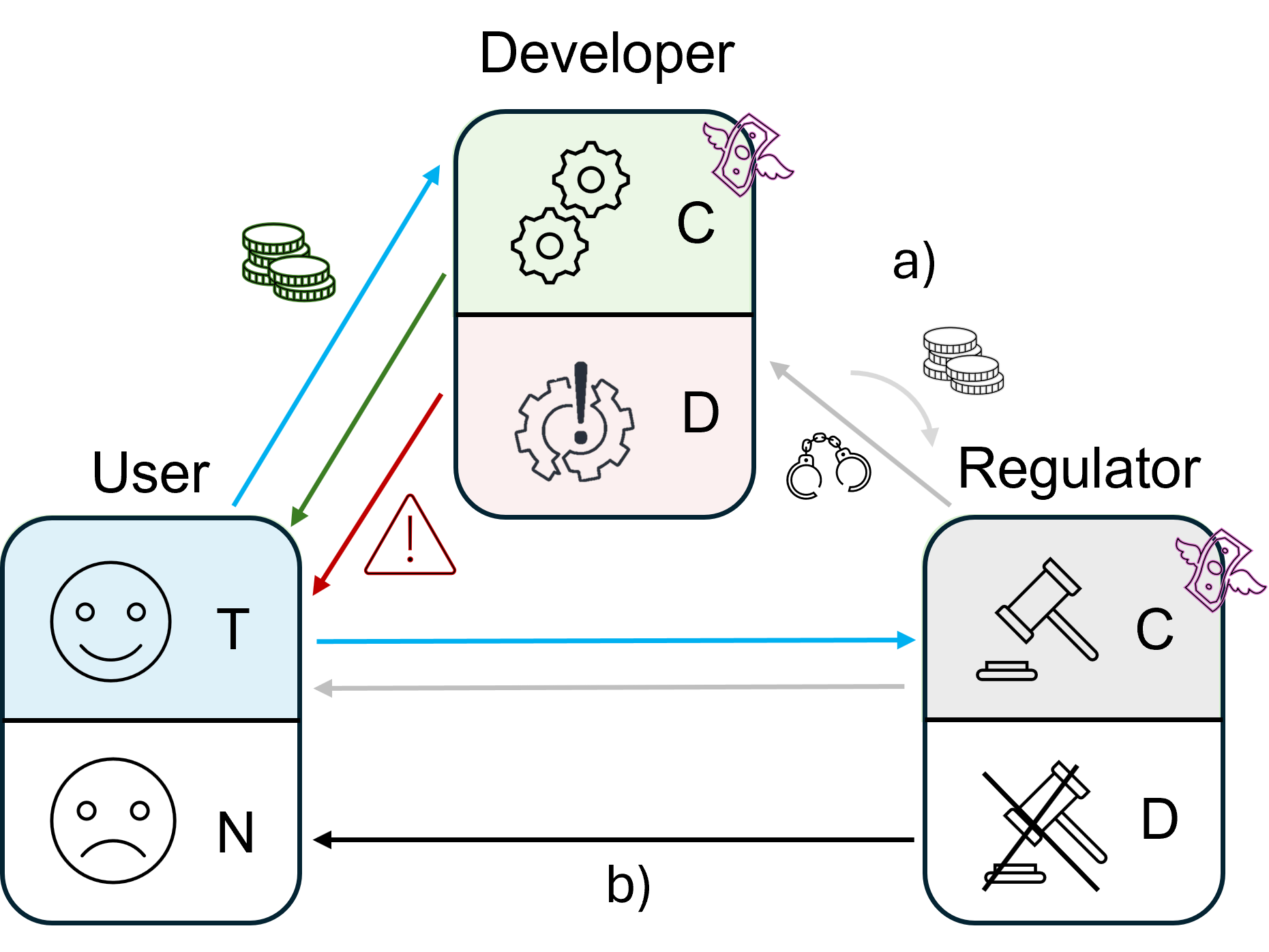

- 论文提出将LLM智能体嵌入演化博弈论框架,模拟不同监管场景下的战略选择,从而研究AI监管中的信任与合作。

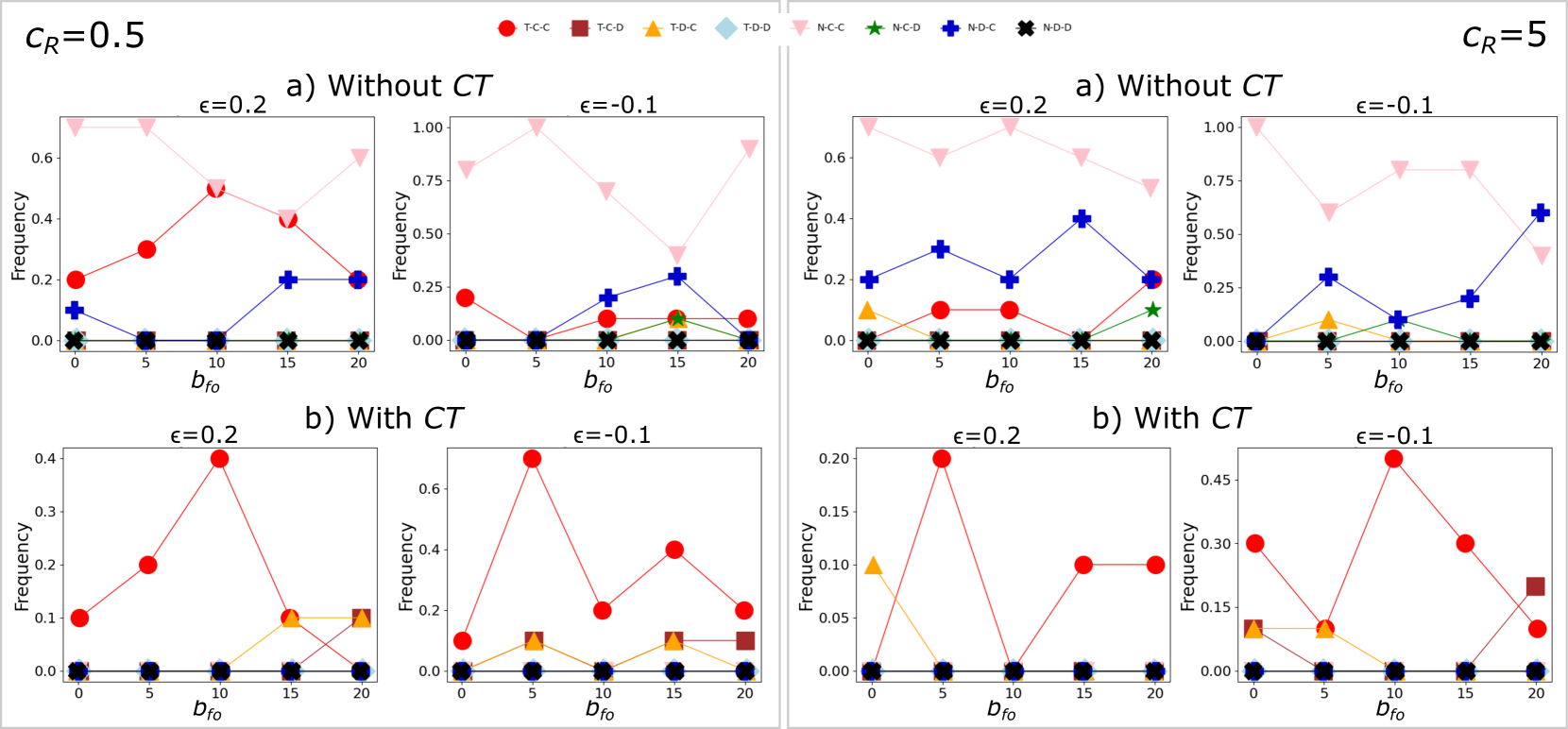

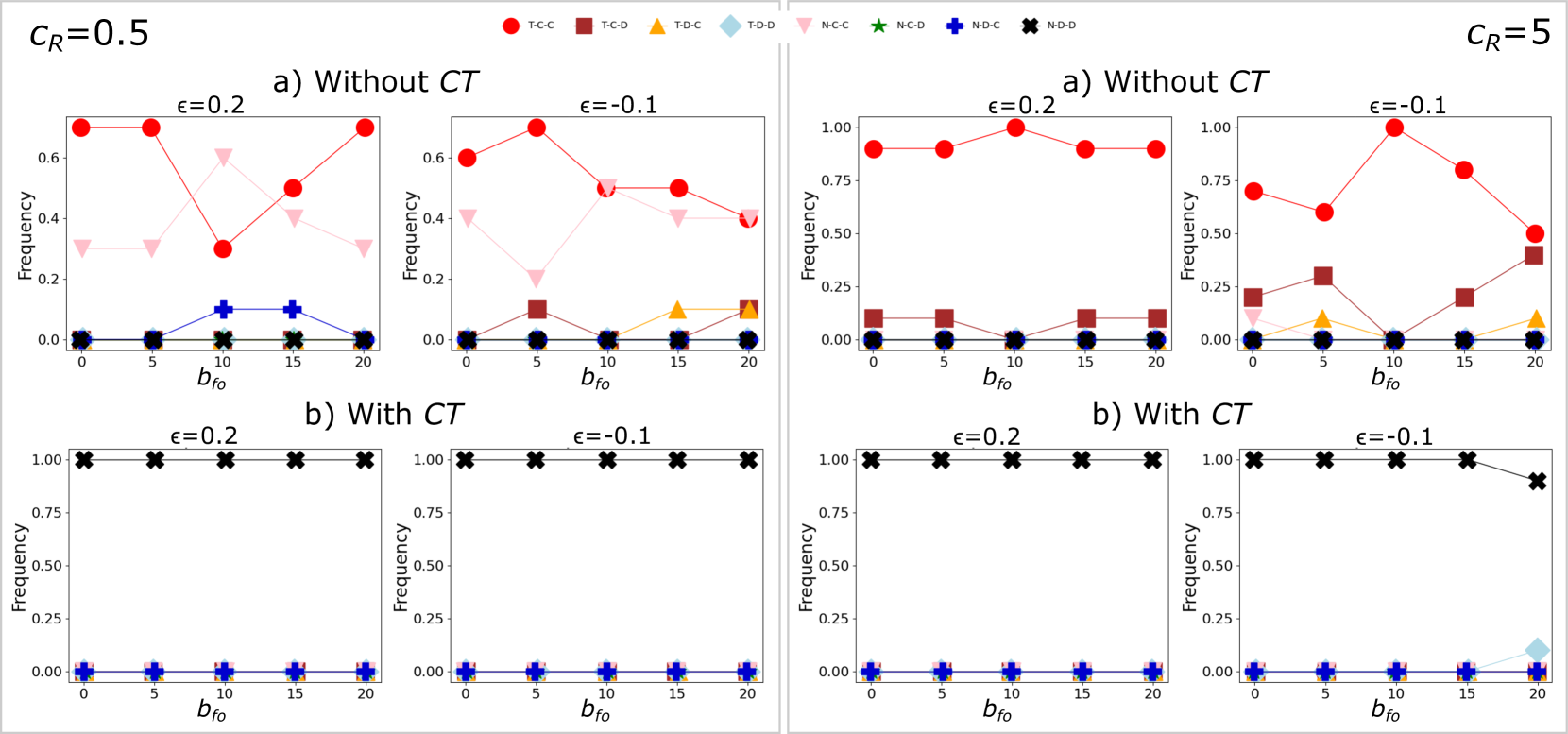

- 研究发现LLM智能体倾向于采取更悲观的策略,用户信任是有效监管的关键,且信任程度依赖于所使用的LLM。

📝 摘要(中文)

本文将大型语言模型(LLM)智能体嵌入到演化博弈论框架中,研究了AI开发者、监管者和用户之间复杂的相互作用,模拟了不同监管场景下他们的战略选择。演化博弈论(EGT)被用于定量建模每个参与者面临的困境,而LLM则提供了额外的复杂性和细微差别,并支持重复博弈和人格特质的融入。研究发现,战略AI智能体倾向于采取比纯粹的博弈论智能体更“悲观”(不信任和违约)的立场。观察表明,如果用户完全信任,激励措施可以有效促进有效监管;然而,有条件的信任可能会破坏“社会契约”。因此,在用户信任和监管者声誉之间建立良性反馈似乎是引导开发者创建安全AI的关键。然而,这种信任出现的程度可能取决于用于测试的特定LLM。研究结果为AI监管系统提供了指导,并有助于预测战略LLM智能体的结果,如果它们被用于辅助监管本身。

🔬 方法详解

问题定义:论文旨在解决如何理解和预测AI开发者在不同监管策略下的行为,以及如何建立有效的AI监管机制。现有方法通常基于静态博弈论,无法捕捉AI开发者、监管者和用户之间的动态交互和信任关系。此外,现有方法难以处理AI开发者行为的复杂性和细微差别,例如人格特质和重复博弈的影响。

核心思路:论文的核心思路是将LLM智能体嵌入到演化博弈论(EGT)框架中,模拟AI开发者、监管者和用户之间的战略互动。EGT能够捕捉参与者策略的动态演化,而LLM则可以提供更丰富和细致的行为建模,包括人格特质和对信任的反应。通过这种方式,论文旨在揭示在不同监管场景下,AI开发者可能采取的策略,以及如何通过激励和建立信任来促进负责任的AI开发。

技术框架:该研究的技术框架主要包括以下几个部分:1) 使用演化博弈论(EGT)来建模AI开发者、监管者和用户之间的互动。2) 使用LLM来模拟AI开发者的行为,包括其策略选择、对信任的反应和人格特质。3) 设计不同的监管场景,例如完全信任、有条件信任和不信任,并分析在这些场景下AI开发者的策略演化。4) 通过模拟实验来评估不同监管策略的有效性,并识别影响AI开发者行为的关键因素。

关键创新:该研究的关键创新在于将LLM智能体与演化博弈论相结合,从而能够更真实地模拟AI开发者在监管环境中的行为。与传统的博弈论模型相比,LLM智能体可以更好地捕捉AI开发者行为的复杂性和细微差别,例如人格特质和对信任的反应。此外,该研究还提出了一个基于信任的AI监管框架,强调了用户信任在促进负责任的AI开发中的重要性。

关键设计:在具体实现上,论文可能涉及以下关键设计:1) 如何选择合适的LLM来模拟AI开发者的行为。2) 如何设计合适的演化博弈模型来捕捉AI开发者、监管者和用户之间的互动。3) 如何定义AI开发者的策略空间,例如是否遵守监管规定、是否采取负责任的开发实践等。4) 如何设计合适的激励机制来引导AI开发者采取负责任的行为。5) 如何量化用户对AI系统的信任程度,并将其纳入到博弈模型中。

🖼️ 关键图片

📊 实验亮点

研究发现,LLM智能体倾向于采取比纯粹博弈论智能体更悲观的策略。在用户完全信任的情况下,激励措施能有效促进监管。然而,有条件信任可能破坏社会契约。用户信任和监管者声誉之间的良性反馈是关键。信任程度依赖于所使用的LLM,这表明不同LLM对监管的反应存在差异。

🎯 应用场景

该研究的潜在应用领域包括AI监管政策的制定、AI伦理规范的建立以及AI风险评估。通过理解AI开发者在不同监管策略下的行为,监管机构可以设计更有效的监管措施,促进负责任的AI开发。此外,该研究还可以用于评估不同AI系统的风险,并制定相应的风险管理策略。未来的影响在于,该研究可以帮助建立一个更加安全、可靠和可信的AI生态系统。

📄 摘要(原文)

There is general agreement that fostering trust and cooperation within the AI development ecosystem is essential to promote the adoption of trustworthy AI systems. By embedding Large Language Model (LLM) agents within an evolutionary game-theoretic framework, this paper investigates the complex interplay between AI developers, regulators and users, modelling their strategic choices under different regulatory scenarios. Evolutionary game theory (EGT) is used to quantitatively model the dilemmas faced by each actor, and LLMs provide additional degrees of complexity and nuances and enable repeated games and incorporation of personality traits. Our research identifies emerging behaviours of strategic AI agents, which tend to adopt more "pessimistic" (not trusting and defective) stances than pure game-theoretic agents. We observe that, in case of full trust by users, incentives are effective to promote effective regulation; however, conditional trust may deteriorate the "social pact". Establishing a virtuous feedback between users' trust and regulators' reputation thus appears to be key to nudge developers towards creating safe AI. However, the level at which this trust emerges may depend on the specific LLM used for testing. Our results thus provide guidance for AI regulation systems, and help predict the outcome of strategic LLM agents, should they be used to aid regulation itself.