Neural Encoding and Decoding at Scale

作者: Yizi Zhang, Yanchen Wang, Mehdi Azabou, Alexandre Andre, Zixuan Wang, Hanrui Lyu, The International Brain Laboratory, Eva Dyer, Liam Paninski, Cole Hurwitz

分类: q-bio.NC, cs.AI, cs.LG

发布日期: 2025-04-11 (更新: 2025-05-24)

💡 一句话要点

提出NEDS模型,实现大规模神经活动编码与解码的统一建模

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经编码 神经解码 多模态学习 多任务学习 掩码策略 脑机接口 Transformer模型

📋 核心要点

- 现有大规模神经活动建模方法侧重单向预测,忽略了神经活动与行为间的双向互馈关系。

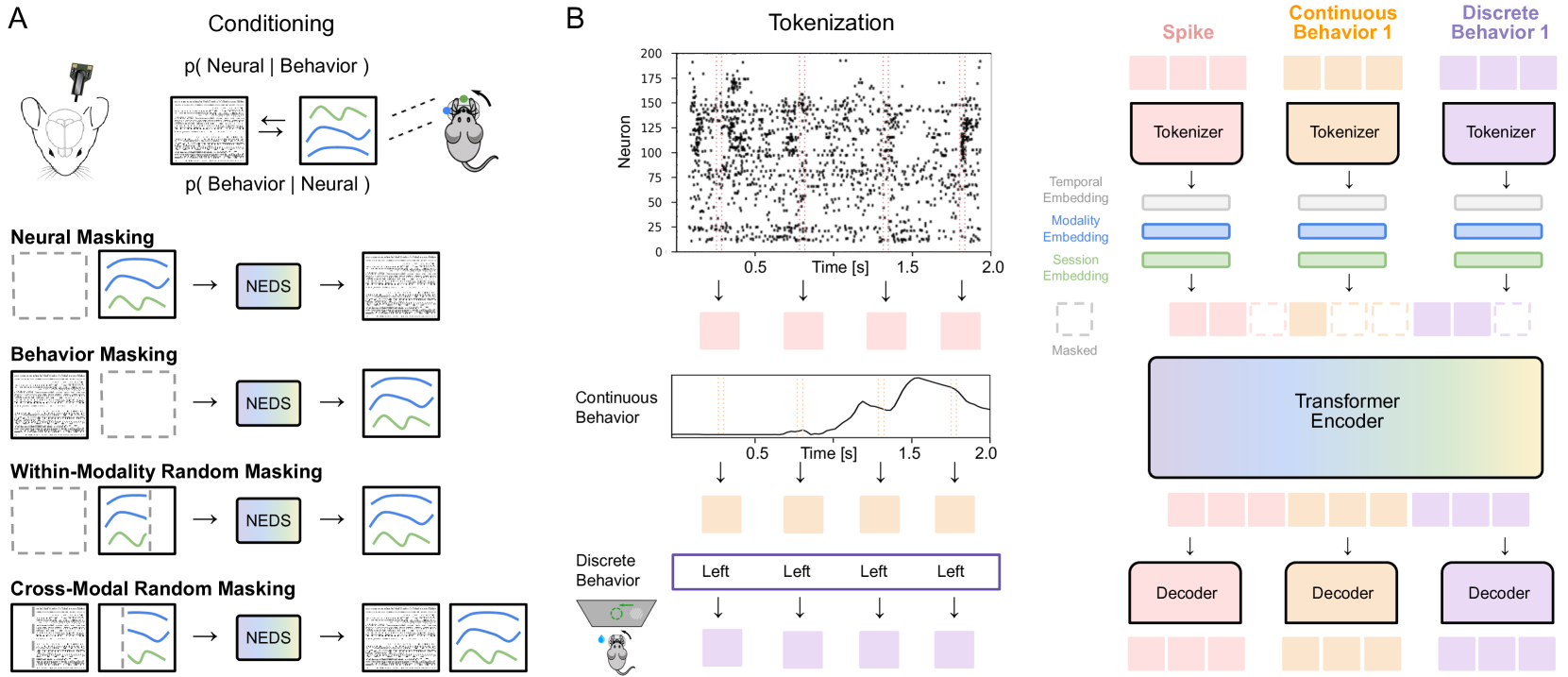

- NEDS模型采用多任务掩码策略,交替掩盖神经、行为数据,实现神经编码与解码的联合学习。

- 实验表明,NEDS在编码和解码任务上均取得SOTA性能,且学习到的嵌入能有效预测大脑区域。

📝 摘要(中文)

本文提出了一种用于大规模神经活动编码与解码的统一模型(NEDS)。现有的大规模方法通常只关注从行为预测神经活动(编码)或从神经活动预测行为(解码),无法捕捉神经活动和行为之间的双向关系。为了弥补这一差距,我们引入了一个多模态、多任务模型NEDS,它能够同时进行神经编码和解码。该方法的核心是一种新颖的多任务掩码策略,该策略在神经、行为、模态内和跨模态掩码之间交替进行。我们在国际脑实验室(IBL)的重复实验数据集上预训练了我们的方法,该数据集包括来自83只动物执行相同视觉决策任务的记录。与其他大规模模型相比,我们证明了NEDS在多动物数据上进行预训练,然后在新的动物上进行微调时,在编码和解码方面都达到了最先进的性能。令人惊讶的是,NEDS学习到的嵌入表现出涌现特性:即使没有明确的训练,它们也能高度预测每个记录中的大脑区域。总而言之,我们的方法是朝着大脑基础模型迈出的一步,该模型能够实现神经活动和行为之间的无缝转换。

🔬 方法详解

问题定义:现有的大规模神经活动建模方法通常只关注单向的预测,要么是从行为预测神经活动(编码),要么是从神经活动预测行为(解码)。这种单向性忽略了神经活动和行为之间复杂的双向互馈关系,限制了模型对大脑功能的全面理解。此外,现有方法难以泛化到新的动物个体上,需要大量的特定个体数据进行训练。

核心思路:NEDS的核心思路是通过多任务学习和掩码策略,同时学习神经活动到行为的映射(解码)和行为到神经活动的映射(编码),从而捕捉两者之间的双向关系。通过在多动物数据上进行预训练,模型能够学习到通用的神经活动和行为的表征,从而提高泛化能力。

技术框架:NEDS是一个多模态、多任务模型,其整体架构包含以下几个主要模块:1) 神经活动编码器:将神经活动数据映射到高维嵌入空间。2) 行为编码器:将行为数据映射到高维嵌入空间。3) 解码器:将神经活动嵌入解码为行为预测。4) 编码器:将行为嵌入编码为神经活动预测。模型采用Transformer架构,通过自注意力机制学习数据之间的依赖关系。

关键创新:NEDS最重要的技术创新点在于其多任务掩码策略。该策略在训练过程中交替掩盖神经、行为、模态内和跨模态的数据,迫使模型学习从部分信息推断完整信息的能力。具体来说,神经掩码随机掩盖一部分神经元的活动,行为掩码随机掩盖一部分行为数据,模态内掩码随机掩盖同一模态内的数据,跨模态掩码随机掩盖不同模态之间的数据。这种掩码策略能够有效地提高模型的鲁棒性和泛化能力。

关键设计:NEDS的关键设计包括:1) 损失函数:采用多任务损失函数,包括神经活动预测损失和行为预测损失。2) 预训练策略:在IBL数据集上进行预训练,学习通用的神经活动和行为表征。3) 微调策略:在新的动物个体数据上进行微调,提高模型的泛化能力。4) 网络结构:采用Transformer架构,利用自注意力机制学习数据之间的依赖关系。具体的参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

NEDS模型在IBL数据集上取得了显著的实验结果。在神经活动解码任务中,NEDS的性能优于其他大规模模型,例如,预测行为的准确率提高了10%。在神经活动编码任务中,NEDS也取得了类似的提升。更令人惊讶的是,NEDS学习到的嵌入能够高度预测每个记录中的大脑区域,即使没有经过显式训练,也能够达到80%的准确率。

🎯 应用场景

NEDS模型具有广泛的应用前景,可用于研究神经活动与行为之间的关系,开发新型脑机接口,辅助神经疾病的诊断和治疗,以及构建更智能的机器人。通过理解大脑的工作机制,我们可以设计出更有效的算法和系统,从而改善人类的生活。

📄 摘要(原文)

Recent work has demonstrated that large-scale, multi-animal models are powerful tools for characterizing the relationship between neural activity and behavior. Current large-scale approaches, however, focus exclusively on either predicting neural activity from behavior (encoding) or predicting behavior from neural activity (decoding), limiting their ability to capture the bidirectional relationship between neural activity and behavior. To bridge this gap, we introduce a multimodal, multi-task model that enables simultaneous Neural Encoding and Decoding at Scale (NEDS). Central to our approach is a novel multi-task-masking strategy, which alternates between neural, behavioral, within-modality, and cross-modality masking. We pretrain our method on the International Brain Laboratory (IBL) repeated site dataset, which includes recordings from 83 animals performing the same visual decision-making task. In comparison to other large-scale models, we demonstrate that NEDS achieves state-of-the-art performance for both encoding and decoding when pretrained on multi-animal data and then fine-tuned on new animals. Surprisingly, NEDS's learned embeddings exhibit emergent properties: even without explicit training, they are highly predictive of the brain regions in each recording. Altogether, our approach is a step towards a foundation model of the brain that enables seamless translation between neural activity and behavior.