Missing Premise exacerbates Overthinking: Are Reasoning Models losing Critical Thinking Skill?

作者: Chenrui Fan, Ming Li, Lichao Sun, Tianyi Zhou

分类: cs.AI, cs.CL, cs.LG

发布日期: 2025-04-09 (更新: 2025-04-11)

💡 一句话要点

揭示推理LLM在缺失前提问题上过度思考,暴露批判性思维缺失

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 推理LLM 过度思考 缺失前提 批判性思维 蒸馏学习

📋 核心要点

- 现有推理LLM在处理缺失前提的问题时,容易产生过度思考,导致效率降低。

- 论文提出分析LLM在处理缺失前提问题时的行为,揭示其过度思考的模式和原因。

- 实验表明,专门训练的推理LLM在缺失前提问题上表现不如未专门训练的模型。

📝 摘要(中文)

本文发现,无论是通过强化学习还是监督学习训练的推理LLM,在面对缺失前提(MiP)的不适定问题时,其响应长度都会急剧增加,最终导致冗余和无效的思考。这种新引入的场景在很大程度上加剧了一般的过度思考问题,我们将其命名为MiP-Overthinking。这种失败违背了“测试时缩放定律”,但在我们策划的多个包含MiP的数据集上被广泛观察到,表明廉价的过度思考的危害以及缺乏批判性思维。令人惊讶的是,未经过专门推理训练的LLM在MiP场景中表现出更好的性能,产生更短的响应,能够快速识别不适定查询。这暗示了当前推理LLM训练方法的一个关键缺陷,即没有充分鼓励高效思考,导致思考模式的滥用。为了进一步研究这些失败背后的原因,我们对不同类型的LLM的推理长度、过度思考模式和批判性思维的位置进行了细粒度分析。此外,我们的扩展消融研究表明,过度思考可以通过推理模型响应的蒸馏来传播。这些结果提高了对过度思考的理解,并为缓解该问题提供了新的见解。

🔬 方法详解

问题定义:论文旨在解决推理LLM在处理包含缺失前提(Missing Premise, MiP)的不适定问题时,出现的过度思考(Overthinking)现象。现有方法训练的推理LLM在面对MiP问题时,会产生过长的、冗余的推理过程,导致效率低下,并且违背了“测试时缩放定律”。这种过度思考表明模型缺乏批判性思维,无法有效识别和处理不适定问题。

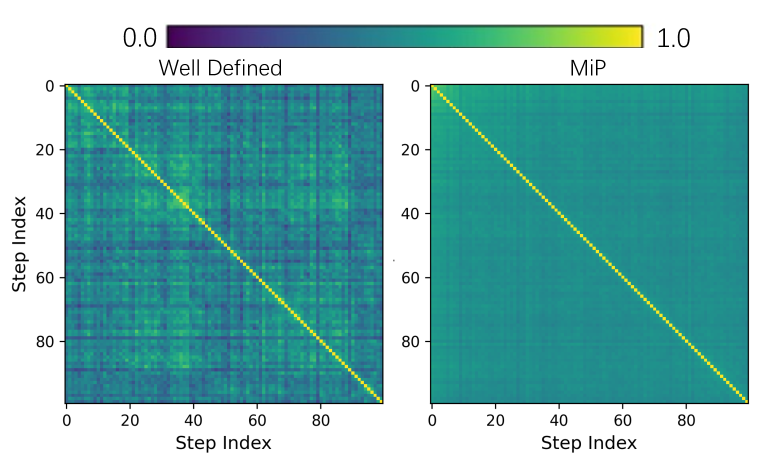

核心思路:论文的核心思路是通过分析LLM在MiP场景下的行为,揭示其过度思考的模式和原因。通过对比专门训练的推理LLM和未专门训练的LLM在MiP问题上的表现,发现前者更容易出现过度思考。这表明当前的推理LLM训练方法可能存在缺陷,没有充分鼓励高效思考,导致模型滥用思考模式。

技术框架:论文主要通过实验分析来研究过度思考现象,并没有提出新的模型架构。其研究框架包括:1) 构建包含MiP的数据集;2) 在不同类型的LLM上进行实验,包括专门训练的推理LLM和未专门训练的LLM;3) 分析LLM的推理长度、过度思考模式和批判性思维的位置;4) 进行消融研究,探究过度思考的传播机制。

关键创新:论文的关键创新在于发现了推理LLM在处理MiP问题时存在的过度思考现象,并将其命名为MiP-Overthinking。此外,论文还揭示了过度思考可以通过推理模型响应的蒸馏来传播,这为理解和缓解过度思考问题提供了新的视角。

关键设计:论文侧重于实验分析,没有涉及具体的模型参数设置或网络结构设计。关键在于数据集的构建,需要包含一定比例的缺失前提的问题。此外,论文还设计了多种指标来衡量LLM的推理长度、过度思考程度和批判性思维能力。消融研究部分,通过蒸馏训练,探究过度思考的传播。

🖼️ 关键图片

📊 实验亮点

实验结果表明,专门训练的推理LLM在MiP场景下表现不如未专门训练的模型,其响应长度显著增加,表明存在严重的过度思考。消融研究进一步揭示,过度思考可以通过蒸馏进行传播,强调了训练数据和方法对LLM推理能力的影响。这些发现为改进推理LLM的训练策略提供了重要依据。

🎯 应用场景

该研究成果可应用于提升推理LLM的鲁棒性和效率,尤其是在处理现实世界中可能存在信息缺失或不完整的问题时。通过改进训练方法,鼓励LLM进行更高效、更批判性的思考,可以减少过度思考,提高推理的准确性和速度。这对于智能问答、决策支持等领域具有重要意义。

📄 摘要(原文)

We find that the response length of reasoning LLMs, whether trained by reinforcement learning or supervised learning, drastically increases for ill-posed questions with missing premises (MiP), ending up with redundant and ineffective thinking. This newly introduced scenario exacerbates the general overthinking issue to a large extent, which we name as the MiP-Overthinking. Such failures are against the ``test-time scaling law'' but have been widely observed on multiple datasets we curated with MiP, indicating the harm of cheap overthinking and a lack of critical thinking. Surprisingly, LLMs not specifically trained for reasoning exhibit much better performance on the MiP scenario, producing much shorter responses that quickly identify ill-posed queries. This implies a critical flaw of the current training recipe for reasoning LLMs, which does not encourage efficient thinking adequately, leading to the abuse of thinking patterns. To further investigate the reasons behind such failures, we conduct fine-grained analyses of the reasoning length, overthinking patterns, and location of critical thinking on different types of LLMs. Moreover, our extended ablation study reveals that the overthinking is contagious through the distillation of reasoning models' responses. These results improve the understanding of overthinking and shed novel insights into mitigating the problem.