Frontier AI's Impact on the Cybersecurity Landscape

作者: Yujin Potter, Wenbo Guo, Zhun Wang, Tianneng Shi, Hongwei Li, Andy Zhang, Patrick Gage Kelley, Kurt Thomas, Dawn Song

分类: cs.CR, cs.AI, cs.CY

发布日期: 2025-04-07 (更新: 2025-11-27)

💡 一句话要点

前沿AI加剧网络安全攻防失衡,攻击能力超越防御,亟需新基准与防御AI

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 网络安全 人工智能 AI代理 攻防失衡 基准测试 专家调查 防御性AI

📋 核心要点

- 现有网络安全防御方法难以有效应对前沿AI带来的新型攻击,攻防能力失衡问题日益严重。

- 论文通过多维度分析,揭示AI在攻击方面的优势,并强调AI代理在复杂安全分析和工作流程规划上的不足。

- 专家调查表明,AI在短期内将继续有利于攻击方,但差距有望缩小,因此需要加强防御性AI的研究和应用。

📝 摘要(中文)

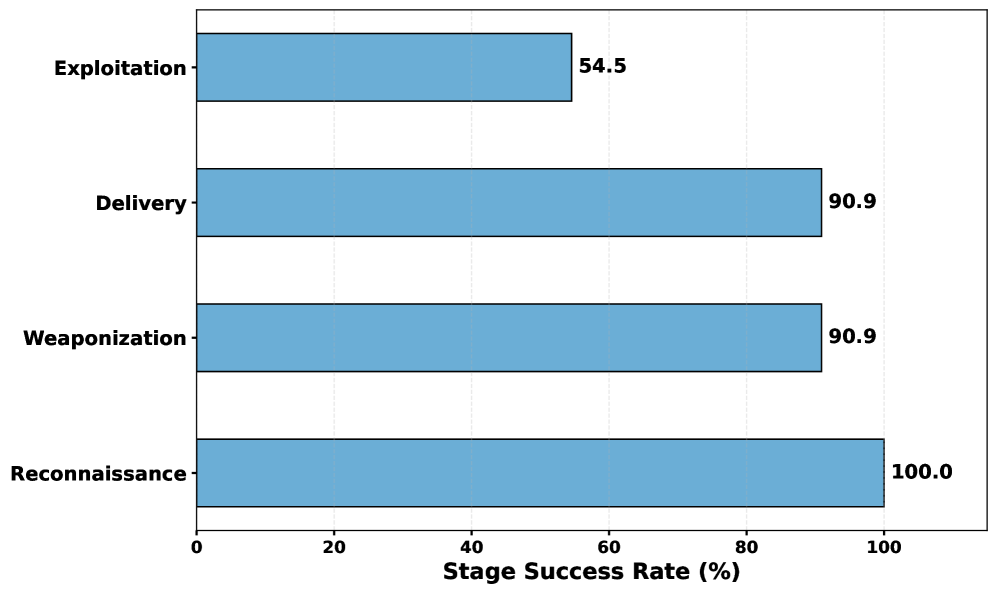

本文全面分析了前沿人工智能(AI代理和基础模型)对网络安全领域日益增长的影响。通过定量基准测试、定性文献综述、实证评估和专家调查等多方面分析,结果一致表明AI在攻击方面的能力和应用已超过防御。对广泛使用的代理系统在网络安全基准上的实证评估表明,当前AI代理在灵活的工作流程规划和使用领域特定工具进行复杂安全分析方面存在困难,而这些能力对防御应用至关重要。AI和安全研究人员及从业者的专家调查显示,普遍认为AI将继续使攻击者受益,尽管差距预计会随着时间推移而缩小。这些结果表明迫切需要评估和减轻前沿AI的风险,引导其有利于网络防御。为此,我们针对以下方面提出了具体的行动号召:构建新的网络安全基准、开发用于防御的AI代理、设计可证明安全的AI代理、改进部署前安全测试和透明度,以及加强以用户为中心的教育和防御。

🔬 方法详解

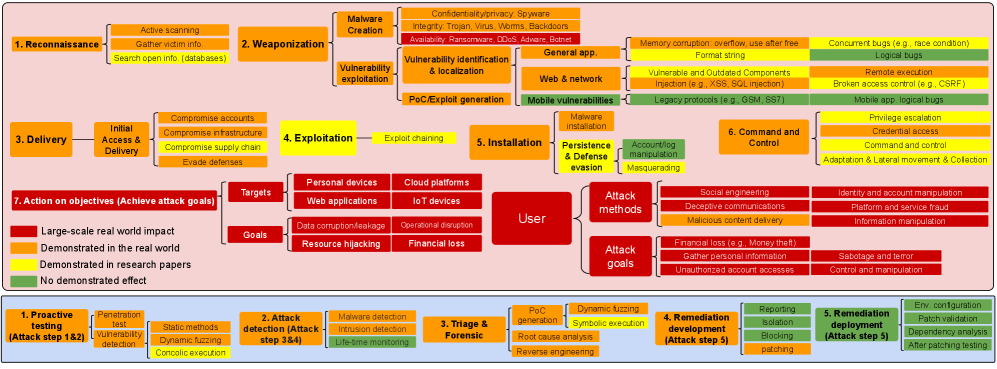

问题定义:论文旨在解决前沿AI(如AI代理和基础模型)在网络安全领域造成的攻防失衡问题。现有方法在应对AI驱动的复杂攻击时显得力不从心,尤其是在利用AI进行主动防御方面存在明显短板。现有的安全工具和策略难以充分利用AI的潜力,无法有效应对AI带来的新型威胁。

核心思路:论文的核心思路是通过全面评估AI在攻防两端的实际能力,找出AI在网络安全中的优势和劣势,从而为开发更有效的防御性AI提供指导。具体而言,论文通过定量基准测试、定性文献综述、实证评估和专家调查等多种方法,系统地分析了AI对网络安全的影响。

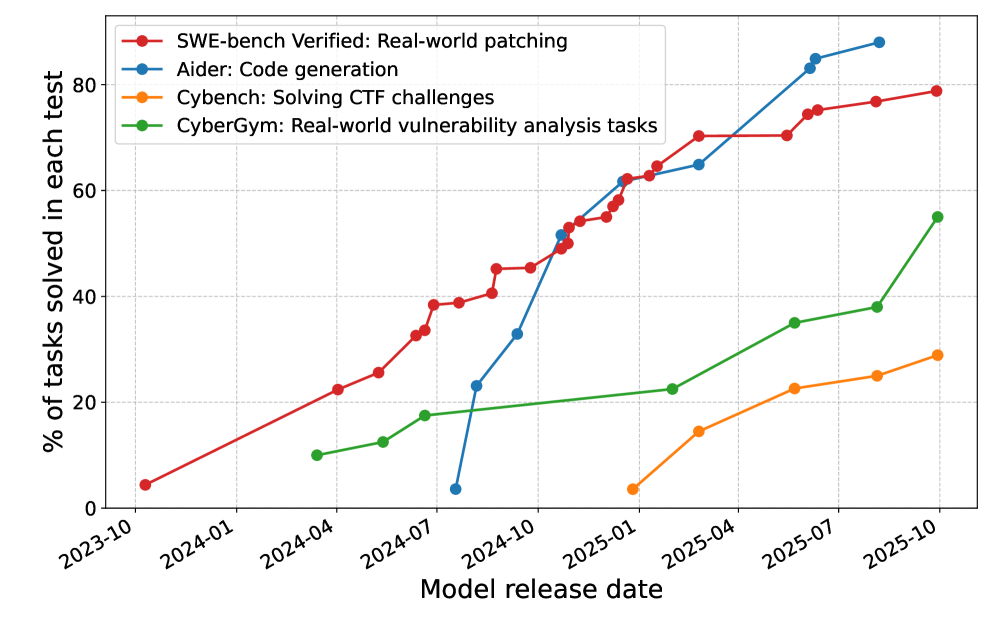

技术框架:论文采用多管齐下的研究方法,没有提出一个单一的技术框架,而是从多个角度对问题进行了剖析。主要包括:1) 定量基准测试:使用标准化的网络安全基准评估AI代理的性能。2) 定性文献综述:梳理现有研究,了解AI在网络安全攻防两端的应用现状。3) 实证评估:对现有AI代理系统进行实际测试,评估其在网络安全任务中的表现。4) 专家调查:收集AI和安全领域专家的意见,了解他们对AI在网络安全中作用的看法。

关键创新:论文的关键创新在于其综合性的分析方法和对AI攻防失衡问题的深刻洞察。它不仅定量地评估了AI代理的性能,还通过定性和实证研究揭示了AI在网络安全中的复杂影响。此外,专家调查为研究结果提供了额外的佐证,并为未来的研究方向提供了指导。

关键设计:论文没有涉及具体的算法或模型设计,而是侧重于对现有AI技术在网络安全领域的应用进行评估和分析。其关键设计体现在研究方法的选择和数据的收集与分析上。例如,在实证评估中,论文选择了具有代表性的AI代理系统和网络安全基准,并设计了合理的实验流程,以确保评估结果的可靠性和有效性。

🖼️ 关键图片

📊 实验亮点

研究表明,当前AI在网络攻击方面的能力超过防御,AI代理在复杂安全分析和工作流程规划方面存在不足。专家调查也普遍认为AI在短期内将继续有利于攻击方。这些结果强调了开发更强大的防御性AI和改进现有安全策略的紧迫性。

🎯 应用场景

该研究成果可应用于指导网络安全策略的制定,推动防御性AI技术的研发,并为网络安全从业人员提供培训和教育。通过构建更强大的防御性AI系统,可以有效应对AI驱动的复杂网络攻击,提升整体网络安全水平。此外,该研究还有助于提高公众对AI安全风险的认识,促进负责任的AI开发和部署。

📄 摘要(原文)

The impact of frontier AI (i.e., AI agents and foundation models) in cybersecurity is rapidly increasing. In this paper, we comprehensively analyze this trend through multiple aspects: quantitative benchmarks, qualitative literature review, empirical evaluation, and expert survey. Our analyses consistently show that AI's capabilities and applications in attacks have exceeded those on the defensive side. Our empirical evaluation of widely used agent systems on cybersecurity benchmarks highlights that current AI agents struggle with flexible workflow planning and using domain-specific tools for complex security analysis -- capabilities particularly critical for defensive applications. Our expert survey of AI and security researchers and practitioners indicates a prevailing view that AI will continue to benefit attackers over defenders, though the gap is expected to narrow over time. These results show the urgent need to evaluate and mitigate frontier AI's risks, steering it towards benefiting cyber defenses. Responding to this need, we provide concrete calls to action regarding: the construction of new cybersecurity benchmarks, the development of AI agents for defense, the design of provably secure AI agents, the improvement of pre-deployment security testing and transparency, and the strengthening of user-oriented education and defenses. Our paper summary and blog are available at https://rdi.berkeley.edu/frontier-ai-impact-on-cybersecurity/.