How to evaluate control measures for LLM agents? A trajectory from today to superintelligence

作者: Tomek Korbak, Mikita Balesni, Buck Shlegeris, Geoffrey Irving

分类: cs.AI, cs.CR

发布日期: 2025-04-07

💡 一句话要点

提出LLM Agent控制评估框架,根据Agent能力演进调整红队对抗策略

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: LLM Agent AI安全 控制评估 红队对抗 比例控制

📋 核心要点

- 现有LLM Agent控制评估方法未能充分考虑Agent能力演进,可能导致控制措施不足或过度。

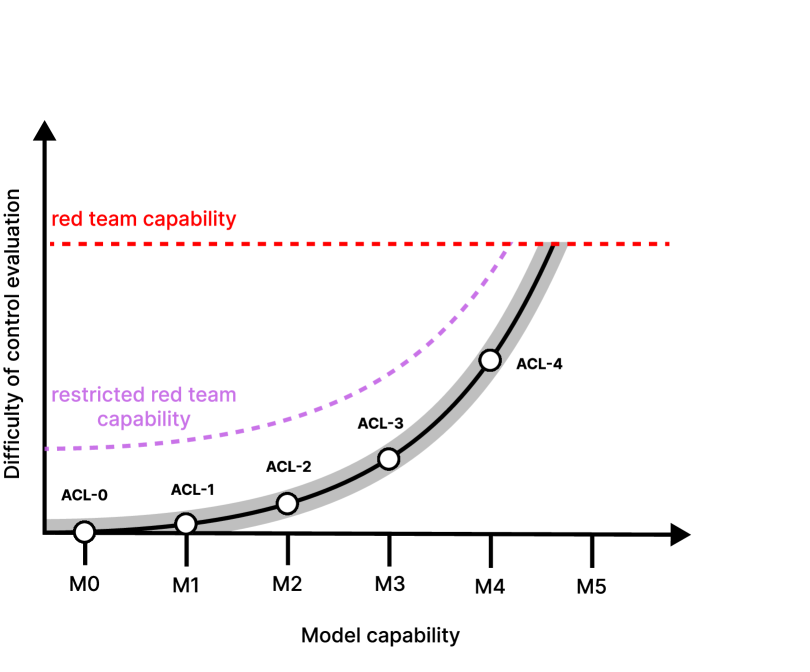

- 论文提出根据Agent能力水平动态调整红队对抗策略的框架,实现比例控制评估。

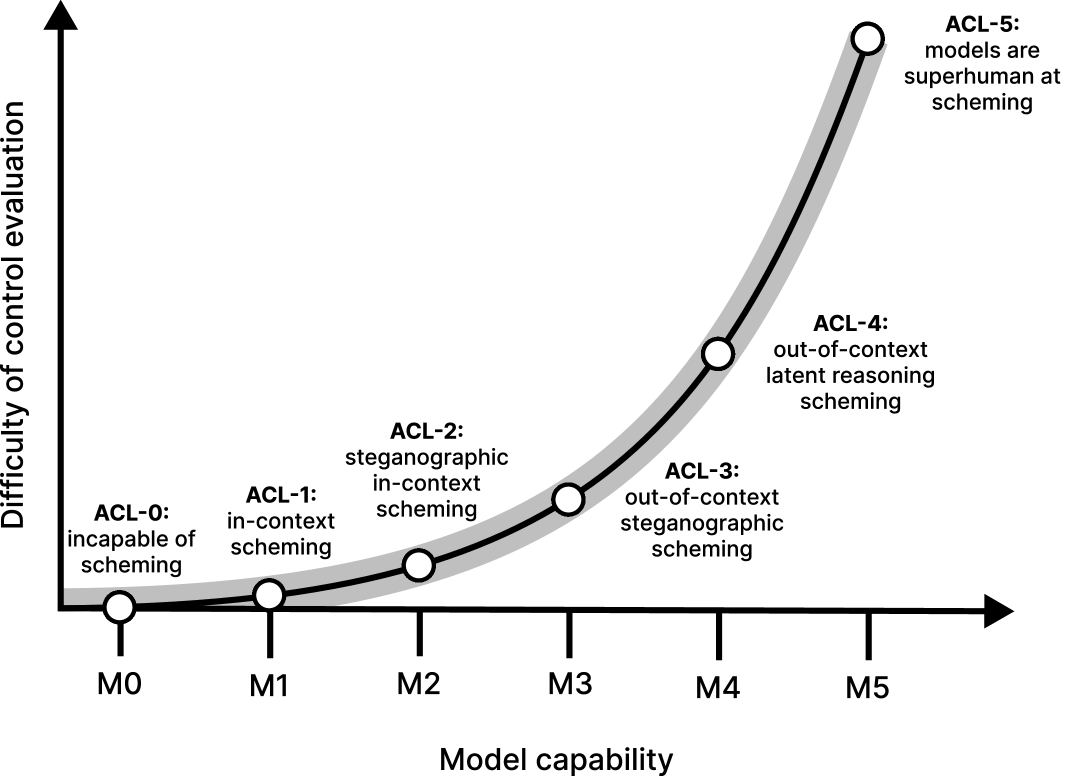

- 通过五个虚构模型和AI控制级别,展示了框架在不同能力水平下的应用,并探讨了超智能Agent控制的挑战。

📝 摘要(中文)

随着LLM Agent自主造成危害的能力增强,AI开发者将依赖日益复杂的控制措施来防止可能存在偏差的Agent造成危害。AI开发者可以通过运行控制评估来证明其控制措施的充分性:即通过红队产生试图破坏控制措施的Agent来进行测试。为了确保控制评估准确地捕捉到偏差风险,应根据将在控制措施下部署的Agent的能力特征来调整授予该红队的能力。本文提出了一个系统框架,用于根据不断发展的AI能力调整红队的能力。我们没有假设Agent总是执行人类已知的最佳攻击策略,而是展示了如何利用对Agent实际能力特征的了解来进行比例控制评估,从而产生更实用和更具成本效益的控制措施。我们通过考虑一系列具有逐步提升能力的五个虚构模型(M1-M5)来说明我们的框架,定义了五个不同的AI控制级别(ACL)。对于每个ACL,我们提供了控制评估、控制措施和安全案例的示例规则,这些规则可能是合适的。最后,我们展示了为什么为超智能LLM Agent构建引人注目的AI控制安全案例需要研究突破,并强调我们可能最终需要替代方法来减轻偏差风险。

🔬 方法详解

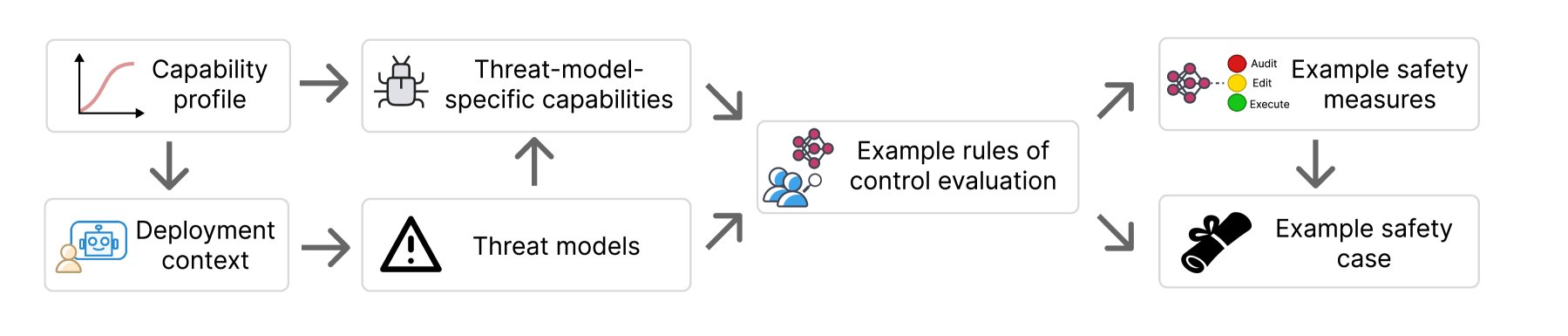

问题定义:论文旨在解决如何有效评估和控制日益强大的LLM Agent的问题。现有方法通常假设Agent会采取人类已知的最佳攻击策略,这可能导致控制措施的设计过于保守或无法应对Agent实际的能力水平。此外,缺乏一个系统性的框架来根据Agent能力的变化调整控制评估策略。

核心思路:论文的核心思路是根据Agent的能力水平,动态调整红队(负责评估控制措施有效性的团队)所拥有的资源和能力。这种“比例控制评估”的思想旨在更准确地反映Agent的实际风险,从而设计出更实用和更具成本效益的控制措施。通过了解Agent的能力边界,可以避免过度设计控制措施,同时确保能够有效应对潜在的风险。

技术框架:论文提出了一个包含五个AI控制级别(ACL)的框架,每个级别对应于不同能力的LLM Agent。对于每个ACL,论文定义了相应的控制评估规则、控制措施和安全案例。该框架的核心在于根据Agent的能力水平,调整红队所拥有的资源和能力,例如访问权限、计算资源和专业知识。通过这种方式,可以模拟Agent在不同能力水平下的潜在攻击行为,并评估控制措施的有效性。

关键创新:论文的关键创新在于提出了“比例控制评估”的概念,即根据Agent的能力水平动态调整红队的能力。这种方法与传统的假设Agent总是采取最佳攻击策略的方法不同,能够更准确地反映Agent的实际风险。此外,论文还提供了一个包含五个AI控制级别的框架,为实际应用提供了指导。

关键设计:论文通过五个虚构模型(M1-M5)来说明框架的应用。每个模型代表一个不同的AI控制级别,并具有不同的能力特征。对于每个模型,论文定义了相应的控制评估规则、控制措施和安全案例。这些示例规则包括限制Agent的访问权限、监控Agent的行为以及实施安全协议。论文还强调了构建超智能LLM Agent的控制安全案例需要研究突破,并可能需要替代方法来减轻偏差风险。

🖼️ 关键图片

📊 实验亮点

论文提出了一个系统性的框架,用于根据LLM Agent的能力水平动态调整控制评估策略。通过五个虚构模型和AI控制级别,展示了框架在不同能力水平下的应用。该研究强调了构建超智能LLM Agent的控制安全案例需要研究突破,并可能需要替代方法来减轻偏差风险。

🎯 应用场景

该研究成果可应用于AI安全领域,帮助开发者更有效地评估和控制LLM Agent,降低潜在风险。该框架可用于指导AI系统的安全设计和部署,尤其是在涉及高风险应用场景,如金融、医疗和自动驾驶等领域。未来的研究可以进一步完善该框架,并开发更有效的控制措施。

📄 摘要(原文)

As LLM agents grow more capable of causing harm autonomously, AI developers will rely on increasingly sophisticated control measures to prevent possibly misaligned agents from causing harm. AI developers could demonstrate that their control measures are sufficient by running control evaluations: testing exercises in which a red team produces agents that try to subvert control measures. To ensure control evaluations accurately capture misalignment risks, the affordances granted to this red team should be adapted to the capability profiles of the agents to be deployed under control measures. In this paper we propose a systematic framework for adapting affordances of red teams to advancing AI capabilities. Rather than assuming that agents will always execute the best attack strategies known to humans, we demonstrate how knowledge of an agents's actual capability profile can inform proportional control evaluations, resulting in more practical and cost-effective control measures. We illustrate our framework by considering a sequence of five fictional models (M1-M5) with progressively advanced capabilities, defining five distinct AI control levels (ACLs). For each ACL, we provide example rules for control evaluation, control measures, and safety cases that could be appropriate. Finally, we show why constructing a compelling AI control safety case for superintelligent LLM agents will require research breakthroughs, highlighting that we might eventually need alternative approaches to mitigating misalignment risk.