Improving World Models using Deep Supervision with Linear Probes

作者: Andrii Zahorodnii

分类: cs.AI, cs.LG

发布日期: 2025-04-04

备注: ICLR 2025 Workshop on World Models

💡 一句话要点

提出基于线性探针深度监督的世界模型改进方法,提升智能体在复杂环境中的推理能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 世界模型 深度监督 线性探针 表征学习 智能体 强化学习 环境建模

📋 核心要点

- 现有世界模型在复杂环境中推理能力不足,难以有效编码底层世界特征。

- 通过在损失函数中引入线性探针,引导网络将关键世界特征编码到隐藏状态中。

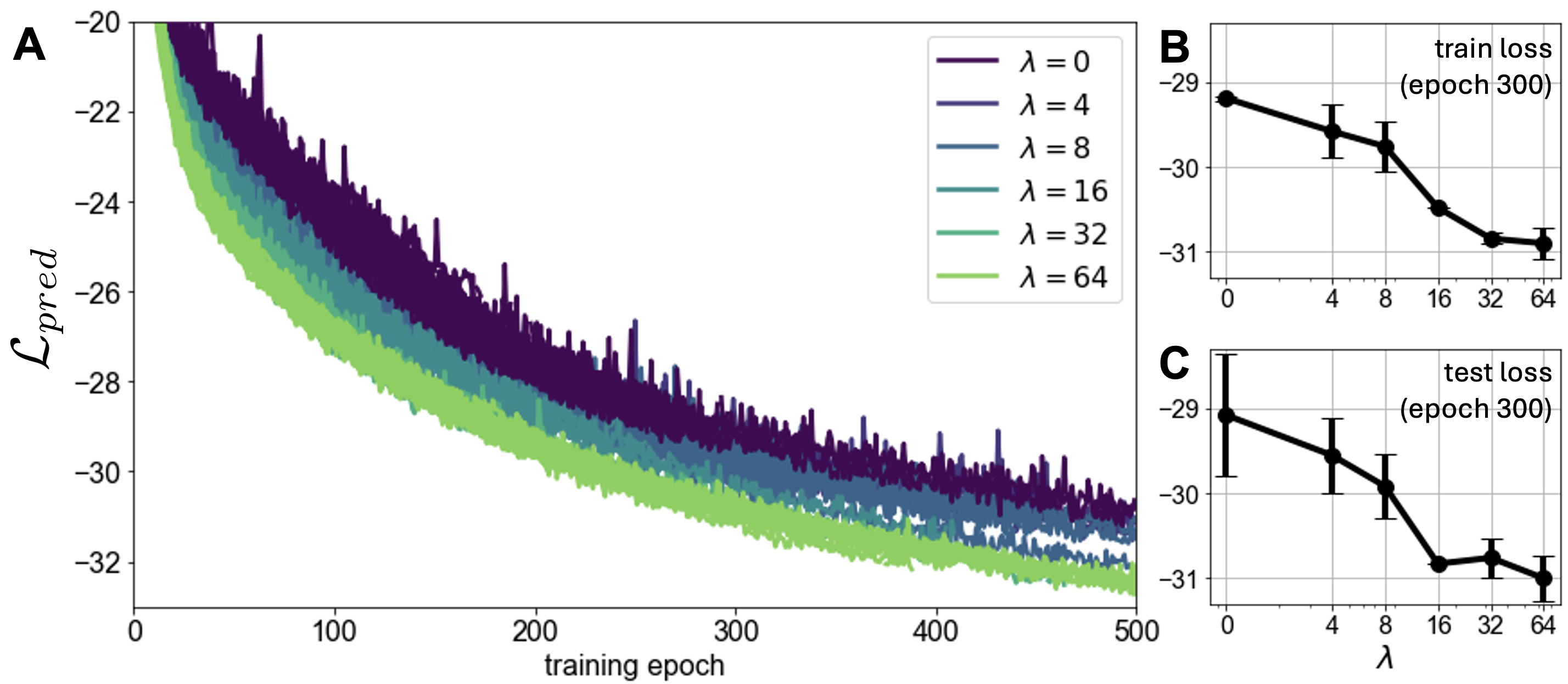

- 实验表明,该方法提升了训练和测试性能,增强了训练稳定性,并减少了分布漂移。

📝 摘要(中文)

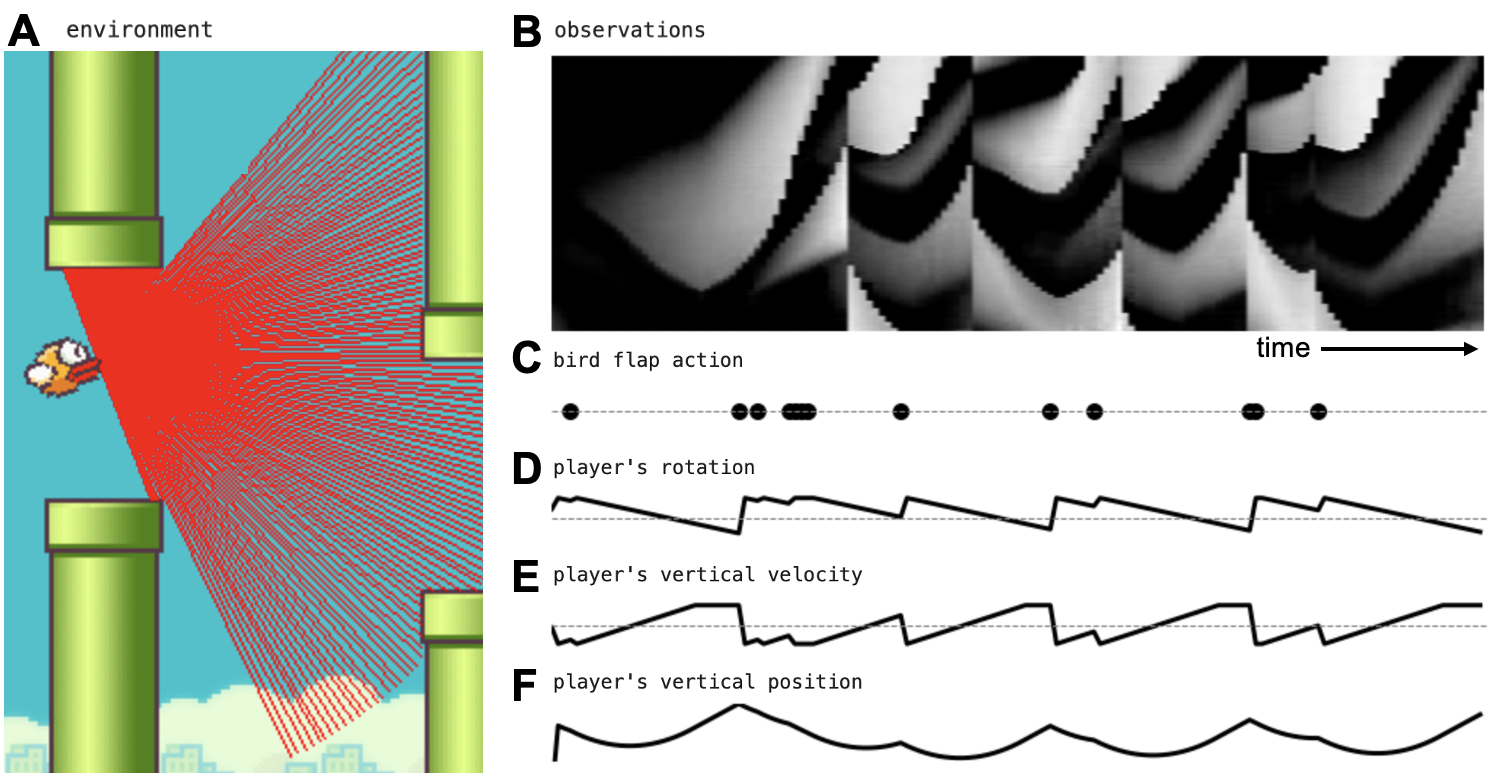

本文研究了一种深度监督技术,旨在改进用于预测下一观测结果的端到端训练网络中的世界模型。虽然深度监督已被广泛应用于特定任务的学习,但本文侧重于改进世界模型。在基于“飞扬的小鸟”游戏的实验环境中,智能体仅接收激光雷达测量作为观测,本文探讨了向网络损失函数添加线性探针组件的效果。该附加项鼓励网络将其隐藏状态编码为真实底层世界特征的子集。实验表明,这种监督技术提高了训练和测试性能,增强了训练稳定性,并产生了更容易解码的世界特征——即使对于那些未包含在训练中的世界特征也是如此。此外,观察到使用线性探针训练的网络中的分布漂移减少,尤其是在游戏的高变异阶段(在连续管道之间飞行)。包含世界特征损失分量大致相当于将模型大小增加一倍,这表明线性探针技术在计算受限的环境中或旨在以较小模型实现最佳性能时特别有益。这些发现有助于理解如何在人工智能体中开发更强大和复杂的世界模型,为该领域的进一步发展铺平道路。

🔬 方法详解

问题定义:现有世界模型难以在复杂环境中准确预测未来状态,尤其是在观测数据有限的情况下。现有方法通常难以有效地将底层世界特征编码到模型的隐藏状态中,导致推理能力不足。

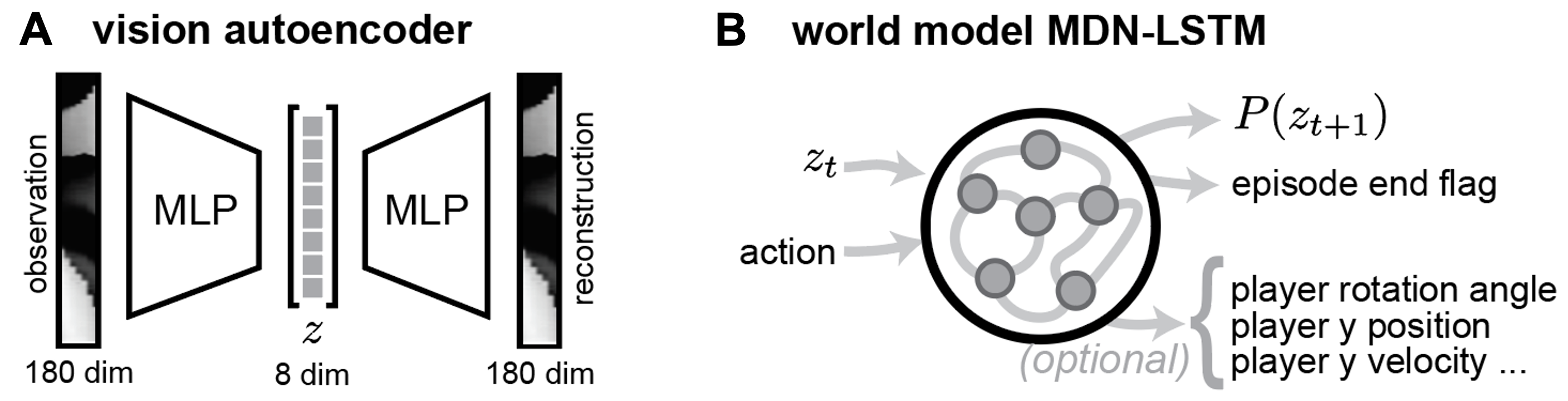

核心思路:本文的核心思路是通过深度监督,利用线性探针来引导世界模型学习更具代表性的隐藏状态。线性探针作为一个额外的损失项,鼓励网络将隐藏状态编码为真实世界特征的子集,从而提高模型的推理能力和泛化能力。

技术框架:整体框架包括一个端到端训练的网络,该网络接收环境观测(例如,激光雷达数据)作为输入,并预测下一个观测。在训练过程中,除了传统的预测损失外,还添加了一个线性探针损失。线性探针损失衡量了隐藏状态与真实世界特征之间的差异,从而引导网络学习更具代表性的隐藏状态。

关键创新:关键创新在于将线性探针引入到世界模型的训练中,通过深度监督的方式,显式地鼓励网络学习底层世界特征。与传统的端到端训练方法相比,该方法能够更有效地将世界特征编码到隐藏状态中,从而提高模型的推理能力和泛化能力。

关键设计:线性探针的具体实现方式是,首先从真实环境中提取一组世界特征(例如,飞扬的小鸟的位置和速度)。然后,训练一个线性模型,将网络的隐藏状态映射到这些世界特征。线性探针损失是线性模型的预测结果与真实世界特征之间的差异。损失函数的权重是一个关键参数,需要根据具体任务进行调整。网络结构的选择也会影响模型的性能,可以尝试不同的网络结构,例如循环神经网络(RNN)或Transformer。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用线性探针进行深度监督可以显著提高世界模型的性能。具体来说,该方法提高了训练和测试性能,增强了训练稳定性,并减少了分布漂移。此外,该方法还能够产生更容易解码的世界特征,即使对于那些未包含在训练中的世界特征也是如此。研究表明,使用线性探针进行训练,效果大致相当于将模型大小增加一倍。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、游戏AI等领域。通过改进世界模型,可以使智能体更好地理解和预测环境变化,从而做出更明智的决策。该方法在计算资源受限的场景下尤其有价值,可以帮助智能体以较小的模型实现更好的性能。未来,可以将该方法扩展到更复杂的环境和任务中,例如多智能体协作和强化学习。

📄 摘要(原文)

Developing effective world models is crucial for creating artificial agents that can reason about and navigate complex environments. In this paper, we investigate a deep supervision technique for encouraging the development of a world model in a network trained end-to-end to predict the next observation. While deep supervision has been widely applied for task-specific learning, our focus is on improving the world models. Using an experimental environment based on the Flappy Bird game, where the agent receives only LIDAR measurements as observations, we explore the effect of adding a linear probe component to the network's loss function. This additional term encourages the network to encode a subset of the true underlying world features into its hidden state. Our experiments demonstrate that this supervision technique improves both training and test performance, enhances training stability, and results in more easily decodable world features -- even for those world features which were not included in the training. Furthermore, we observe a reduced distribution drift in networks trained with the linear probe, particularly during high-variability phases of the game (flying between successive pipe encounters). Including the world features loss component roughly corresponded to doubling the model size, suggesting that the linear probe technique is particularly beneficial in compute-limited settings or when aiming to achieve the best performance with smaller models. These findings contribute to our understanding of how to develop more robust and sophisticated world models in artificial agents, paving the way for further advancements in this field.