Sustainable LLM Inference for Edge AI: Evaluating Quantized LLMs for Energy Efficiency, Output Accuracy, and Inference Latency

作者: Erik Johannes Husom, Arda Goknil, Merve Astekin, Lwin Khin Shar, Andre Kåsen, Sagar Sen, Benedikt Andreas Mithassel, Ahmet Soylu

分类: cs.CY, cs.AI, cs.CL, cs.LG

发布日期: 2025-04-04

备注: 30 pages, 14 figures

💡 一句话要点

评估量化LLM在边缘AI的能效、精度与延迟,实现可持续推理。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 模型量化 边缘计算 能效优化 推理性能 Raspberry Pi 可持续AI

📋 核心要点

- 现有LLM在边缘设备部署面临计算资源、内存和能耗的挑战,限制了其广泛应用。

- 通过模型量化,特别是训练后量化和仅权重量化,降低模型大小和计算复杂度,提升推理效率。

- 在Raspberry Pi 4上评估28个量化LLM,分析能效、推理速度和精度之间的权衡,为边缘部署提供指导。

📝 摘要(中文)

由于计算约束、内存限制、推理速度和能耗,在边缘设备上部署大型语言模型(LLM)面临重大挑战。模型量化已成为一种关键技术,通过减少模型大小和计算开销来实现高效的LLM推理。本研究对Ollama库中的28个量化LLM进行了全面分析,这些模型默认应用了训练后量化(PTQ)和仅权重量化技术,并部署在边缘设备(配备4GB RAM的Raspberry Pi 4)上。我们评估了不同量化级别和任务类型下的能效、推理性能和输出精度。模型在五个标准化数据集(CommonsenseQA、BIG-Bench Hard、TruthfulQA、GSM8K和HumanEval)上进行了基准测试,并采用高分辨率、基于硬件的能量测量工具来捕获实际功耗。我们的研究结果揭示了不同量化设置中能效、推理速度和精度之间的权衡,突出了优化资源受限环境LLM部署的配置。通过将硬件级能量分析与LLM基准测试相结合,本研究为可持续AI提供了可操作的见解,弥合了现有能源感知LLM部署研究中的关键差距。

🔬 方法详解

问题定义:论文旨在解决在资源受限的边缘设备上部署大型语言模型(LLM)时面临的能耗高、推理速度慢和精度损失的问题。现有方法在边缘设备上部署LLM时,往往难以在能效、速度和精度之间取得平衡,导致实际应用受限。

核心思路:论文的核心思路是通过模型量化技术,降低LLM的计算复杂度和内存占用,从而提高推理速度和降低能耗。通过对不同量化级别和量化方法的LLM进行全面评估,找到在边缘设备上部署LLM的最佳配置,实现能效、速度和精度的优化。

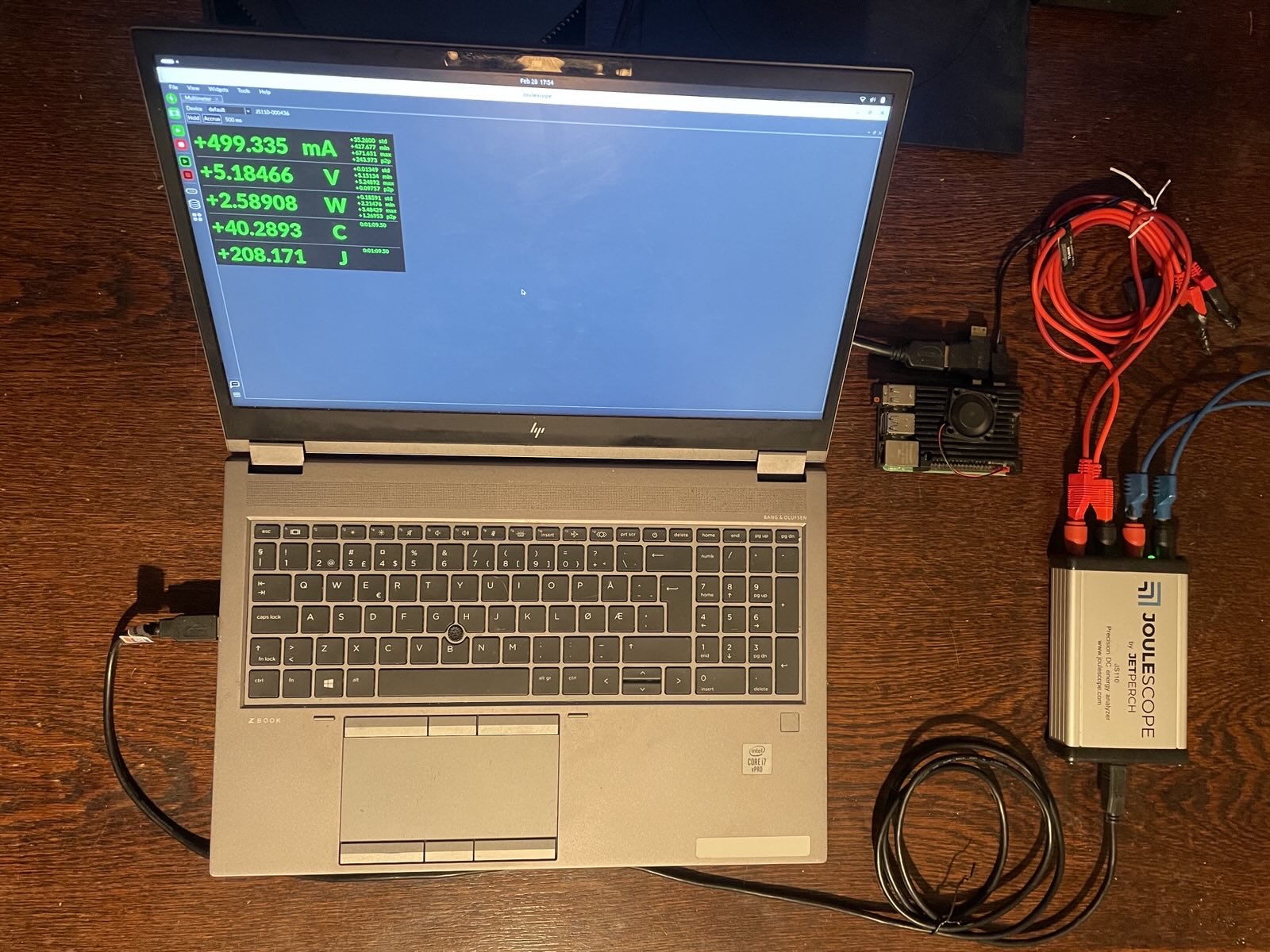

技术框架:该研究的技术框架主要包括以下几个阶段:1) 选择Ollama库中28个量化LLM,这些模型默认应用了训练后量化(PTQ)和仅权重量化技术。2) 在边缘设备(Raspberry Pi 4)上部署这些量化LLM。3) 使用五个标准化数据集(CommonsenseQA、BIG-Bench Hard、TruthfulQA、GSM8K和HumanEval)对模型进行基准测试,评估其输出精度。4) 使用高分辨率、基于硬件的能量测量工具来捕获实际功耗,评估能效。5) 分析不同量化设置下能效、推理速度和精度之间的权衡。

关键创新:该研究的关键创新在于:1) 对大量量化LLM在边缘设备上的性能进行了全面评估,提供了详细的性能数据和分析结果。2) 将硬件级能量分析与LLM基准测试相结合,提供了更准确的能耗评估。3) 揭示了不同量化设置下能效、推理速度和精度之间的权衡,为边缘设备上的LLM部署提供了可操作的指导。

关键设计:论文的关键设计包括:1) 选择Ollama库中的量化LLM,这些模型已经应用了训练后量化(PTQ)和仅权重量化技术,简化了量化过程。2) 使用Raspberry Pi 4作为边缘设备,模拟了实际的资源受限环境。3) 使用五个标准化数据集进行基准测试,保证了评估结果的可靠性和可比性。4) 使用高分辨率、基于硬件的能量测量工具,提供了准确的能耗数据。

🖼️ 关键图片

📊 实验亮点

该研究在Raspberry Pi 4上对28个量化LLM进行了评估,揭示了不同量化级别下能效、推理速度和精度之间的权衡。通过硬件级能量测量,提供了实际功耗数据。研究结果为在资源受限的边缘设备上部署LLM提供了重要的参考依据,有助于选择合适的量化配置以优化性能。

🎯 应用场景

该研究成果可应用于各种边缘AI场景,例如智能家居、自动驾驶、工业自动化等。通过优化LLM在边缘设备的部署,可以实现更高效、更节能的AI应用,降低部署成本,并提高用户体验。未来的研究可以进一步探索更先进的量化技术和硬件加速方案,以实现更可持续的边缘AI。

📄 摘要(原文)

Deploying Large Language Models (LLMs) on edge devices presents significant challenges due to computational constraints, memory limitations, inference speed, and energy consumption. Model quantization has emerged as a key technique to enable efficient LLM inference by reducing model size and computational overhead. In this study, we conduct a comprehensive analysis of 28 quantized LLMs from the Ollama library, which applies by default Post-Training Quantization (PTQ) and weight-only quantization techniques, deployed on an edge device (Raspberry Pi 4 with 4GB RAM). We evaluate energy efficiency, inference performance, and output accuracy across multiple quantization levels and task types. Models are benchmarked on five standardized datasets (CommonsenseQA, BIG-Bench Hard, TruthfulQA, GSM8K, and HumanEval), and we employ a high-resolution, hardware-based energy measurement tool to capture real-world power consumption. Our findings reveal the trade-offs between energy efficiency, inference speed, and accuracy in different quantization settings, highlighting configurations that optimize LLM deployment for resource-constrained environments. By integrating hardware-level energy profiling with LLM benchmarking, this study provides actionable insights for sustainable AI, bridging a critical gap in existing research on energy-aware LLM deployment.