Affordable AI Assistants with Knowledge Graph of Thoughts

作者: Maciej Besta, Lorenzo Paleari, Jia Hao Andrea Jiang, Robert Gerstenberger, You Wu, Jón Gunnar Hannesson, Patrick Iff, Ales Kubicek, Piotr Nyczyk, Diana Khimey, Nils Blach, Haiqiang Zhang, Tao Zhang, Peiran Ma, Grzegorz Kwaśniewski, Marcin Copik, Hubert Niewiadomski, Torsten Hoefler

分类: cs.AI, cs.CL, cs.IR, cs.LG

发布日期: 2025-04-03 (更新: 2025-10-01)

💡 一句话要点

提出知识图谱思维(KGoT)架构,降低AI助手成本并提升复杂任务成功率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱 大型语言模型 AI助手 推理 动态知识图谱

📋 核心要点

- 现有LLM驱动的AI助手成本高昂,在复杂任务(如GAIA)上的成功率有限,难以满足实际应用需求。

- KGoT通过动态构建知识图谱,将LLM推理与结构化知识相结合,降低模型成本并提升复杂任务处理能力。

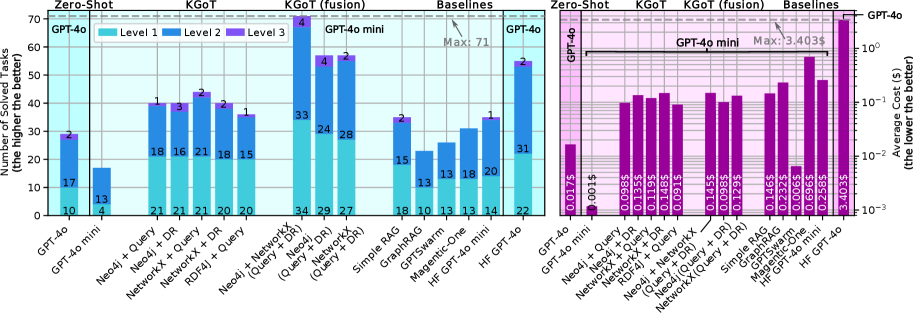

- 实验表明,KGoT在GAIA基准测试中比GPT-4o mini提升了29%的任务成功率,并降低了超过36倍的运营成本。

📝 摘要(中文)

大型语言模型(LLMs)正在革新AI助手的开发,使其能够执行跨领域的各种任务。然而,当前最先进的LLM驱动的智能体面临着严峻的挑战,包括高昂的运营成本以及在GAIA等复杂基准测试中有限的成功率。为了解决这些问题,我们提出了一种创新的AI助手架构——知识图谱思维(KGoT),它将LLM推理与动态构建的知识图谱(KGs)相结合。KGoT提取任务相关的知识并将其结构化为动态KG表示,并通过数学求解器、网络爬虫和Python脚本等外部工具进行迭代增强。这种结构化的任务相关知识表示使得低成本模型能够有效地解决复杂任务,同时最大限度地减少偏差和噪声。例如,在GAIA基准测试中,KGoT的任务成功率比使用GPT-4o mini的Hugging Face Agents提高了29%。此外,利用较小的模型可将运营成本降低36倍以上(与GPT-4o相比)。其他模型(例如,Qwen2.5-32B和Deepseek-R1-70B)和基准测试(例如,SimpleQA)的改进也类似。KGoT为AI助手提供了一种可扩展、经济实惠、通用且高性能的解决方案。

🔬 方法详解

问题定义:论文旨在解决当前大型语言模型驱动的AI助手在复杂任务中表现不佳,且运营成本过高的问题。现有方法依赖于大型模型进行推理,导致成本居高不下,并且在处理需要外部知识的任务时容易出错。

核心思路:论文的核心思路是将大型语言模型的推理能力与动态构建的知识图谱相结合。通过知识图谱来结构化地表示任务相关的知识,从而降低对大型模型的依赖,并提高任务的成功率。这种方法旨在利用较小的模型,通过外部工具和知识图谱的辅助,实现与大型模型相当甚至更好的性能。

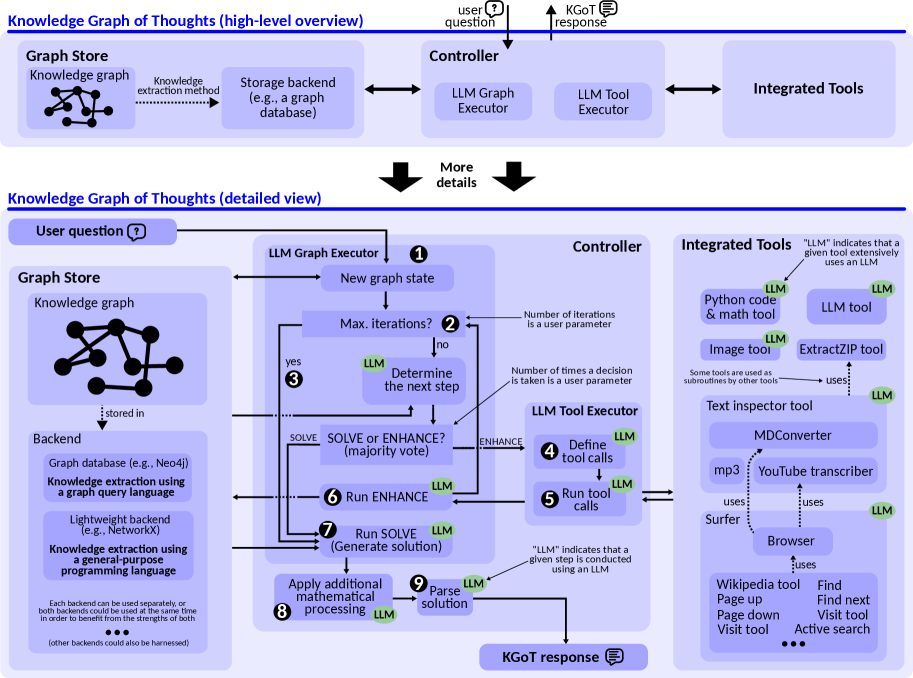

技术框架:KGoT的整体架构包含以下几个主要模块:1) 任务理解模块:使用LLM理解用户提出的任务。2) 知识提取模块:从任务描述中提取相关的知识,并构建初始的知识图谱。3) 知识增强模块:利用外部工具(如数学求解器、网络爬虫、Python脚本)来增强知识图谱,补充缺失的信息。4) 推理模块:利用LLM在知识图谱上进行推理,得出最终的答案。5) 迭代优化模块:根据推理结果,不断优化知识图谱,提高推理的准确性。

关键创新:最重要的技术创新点在于动态构建和增强知识图谱。与静态知识图谱不同,KGoT的知识图谱是根据任务动态构建的,并且可以通过外部工具进行迭代增强。这种动态性和可扩展性使得KGoT能够适应各种复杂的任务,并不断提高性能。与现有方法的本质区别在于,KGoT不是直接依赖大型模型进行推理,而是利用知识图谱来辅助推理,从而降低了对大型模型的依赖。

关键设计:KGoT的关键设计包括:1) 知识图谱的表示方式:使用三元组(subject, predicate, object)来表示知识。2) 知识提取策略:使用LLM来提取任务相关的实体和关系。3) 知识增强策略:根据任务的需要,选择合适的外部工具来增强知识图谱。4) 推理策略:使用LLM在知识图谱上进行推理,并生成最终的答案。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

KGoT在GAIA基准测试中,相较于使用GPT-4o mini的Hugging Face Agents,任务成功率提升了29%。同时,使用较小模型的情况下,运营成本降低了超过36倍(与GPT-4o相比)。在其他模型(如Qwen2.5-32B和Deepseek-R1-70B)和基准测试(如SimpleQA)上也取得了类似的改进。

🎯 应用场景

KGoT架构具有广泛的应用前景,可用于构建各种智能助手,例如:智能客服、智能问答系统、智能教育平台等。该研究降低了AI助手的开发和运营成本,使得AI技术能够更广泛地应用于各个领域,并有望推动人机交互方式的变革。

📄 摘要(原文)

Large Language Models (LLMs) are revolutionizing the development of AI assistants capable of performing diverse tasks across domains. However, current state-of-the-art LLM-driven agents face significant challenges, including high operational costs and limited success rates on complex benchmarks like GAIA. To address these issues, we propose Knowledge Graph of Thoughts (KGoT), an innovative AI assistant architecture that integrates LLM reasoning with dynamically constructed knowledge graphs (KGs). KGoT extracts and structures task-relevant knowledge into a dynamic KG representation, iteratively enhanced through external tools such as math solvers, web crawlers, and Python scripts. Such structured representation of task-relevant knowledge enables low-cost models to solve complex tasks effectively while also minimizing bias and noise. For example, KGoT achieves a 29% improvement in task success rates on the GAIA benchmark compared to Hugging Face Agents with GPT-4o mini. Moreover, harnessing a smaller model dramatically reduces operational costs by over 36x compared to GPT-4o. Improvements for other models (e.g., Qwen2.5-32B and Deepseek-R1-70B) and benchmarks (e.g., SimpleQA) are similar. KGoT offers a scalable, affordable, versatile, and high-performing solution for AI assistants.