Exploration and Adaptation in Non-Stationary Tasks with Diffusion Policies

作者: Gunbir Singh Baveja

分类: cs.AI

发布日期: 2025-03-31

备注: 7 pages, 1 figure

💡 一句话要点

提出基于扩散策略的强化学习方法,解决非平稳视觉任务中的探索与适应问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 扩散模型 强化学习 非平稳环境 视觉强化学习 探索与适应

📋 核心要点

- 现有强化学习方法在非平稳环境中难以有效探索和适应,尤其是在高维视觉输入下。

- 论文提出利用扩散策略,通过迭代去噪过程生成更连贯和上下文相关的动作序列。

- 实验表明,扩散策略在Procgen和PointMaze等环境中优于PPO和DQN,提升了奖励并降低了方差。

📝 摘要(中文)

本文研究了扩散策略在非平稳、基于视觉的强化学习环境中的应用,特别关注任务动态和目标随时间演变的环境。该工作基于动态现实场景中遇到的实际挑战,例如机器人装配线和自主导航,在这些场景中,智能体必须从高维视觉输入中调整控制策略。我们将扩散策略(利用迭代随机去噪来细化潜在动作表示)应用于包括Procgen和PointMaze在内的基准环境。实验表明,尽管计算需求增加,但扩散策略始终优于标准强化学习方法,如PPO和DQN,在降低变异性的同时实现了更高的平均和最大奖励。这些发现强调了该方法在不断变化的条件下生成连贯、上下文相关的动作序列的能力,同时也突出了在处理极端非平稳性方面需要进一步改进的领域。

🔬 方法详解

问题定义:论文旨在解决非平稳强化学习任务中,智能体如何有效探索环境并适应不断变化的任务动态和目标的问题。现有的强化学习方法,如PPO和DQN,在面对环境的非平稳性时,往往难以维持稳定的性能,尤其是在需要从高维视觉输入中学习控制策略的场景下。这些方法容易陷入局部最优,难以泛化到新的任务变体。

核心思路:论文的核心思路是利用扩散模型生成动作。扩散模型通过逐步添加噪声到数据,然后再逐步去噪恢复数据的方式,学习数据的分布。在强化学习中,可以将动作视为数据,利用扩散模型学习动作的分布,从而生成更具探索性和适应性的动作。这种方法能够生成连贯的、上下文相关的动作序列,有助于智能体在非平稳环境中更好地探索和适应。

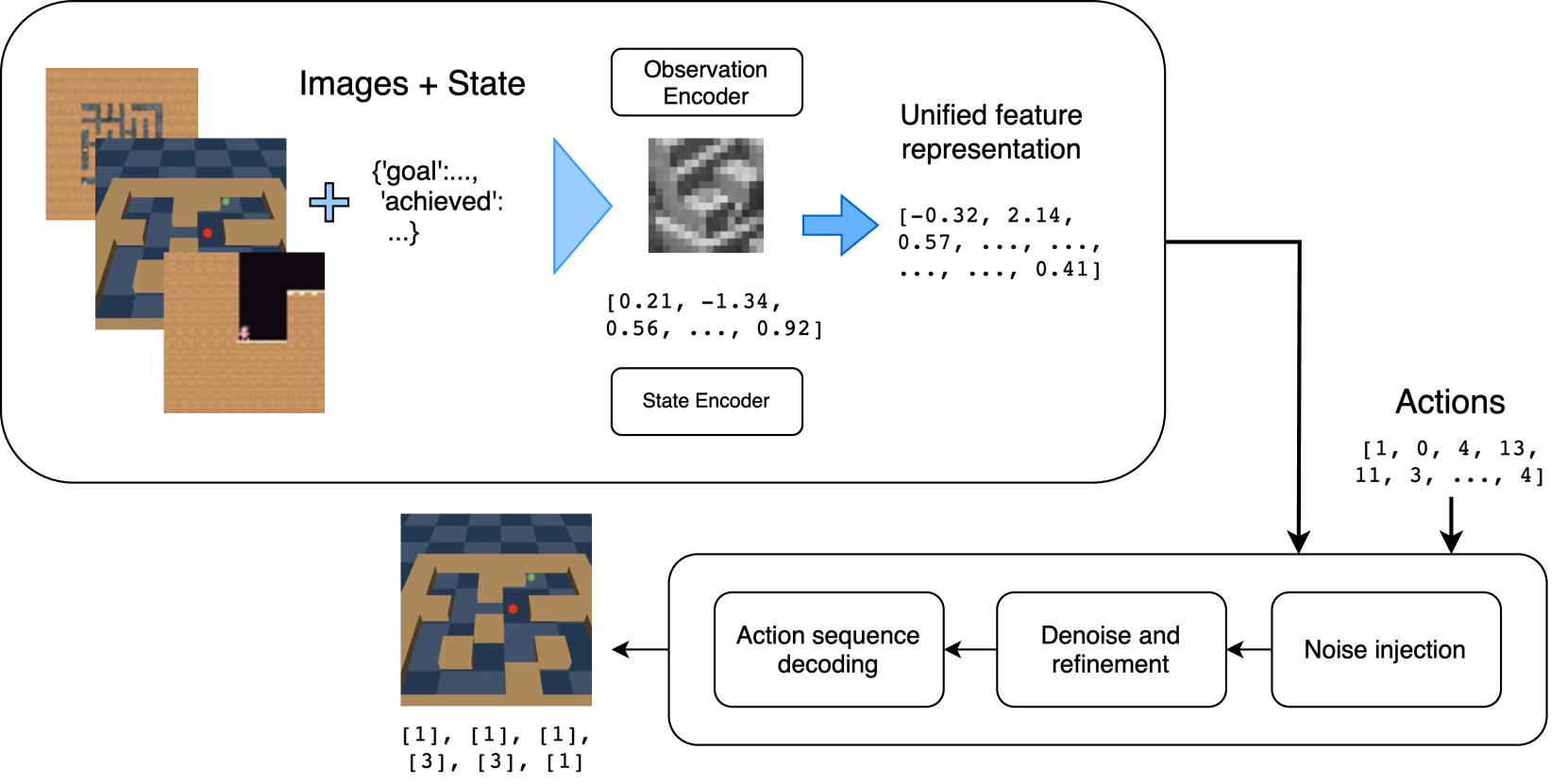

技术框架:整体框架包含以下几个主要部分:1)环境交互:智能体与非平稳环境进行交互,获取状态和奖励信号。2)扩散策略:使用扩散模型生成动作,该模型以当前状态为条件,生成一个动作的分布。3)策略优化:使用强化学习算法(例如,Q-learning 或 Policy Gradient)来优化扩散策略,使其能够最大化累积奖励。4)模型更新:定期更新扩散模型,以适应环境的变化。

关键创新:论文最重要的技术创新点在于将扩散模型应用于强化学习的动作生成。与传统的强化学习方法直接输出确定性或随机性动作不同,扩散策略通过迭代去噪过程生成动作,从而能够更好地捕捉动作之间的依赖关系,并生成更连贯的动作序列。此外,扩散模型还能够生成多样化的动作,有助于智能体在非平稳环境中进行有效的探索。

关键设计:论文的关键设计包括:1)扩散模型的结构:使用U-Net结构的扩散模型,以状态作为条件输入,生成动作的分布。2)噪声调度:采用线性噪声调度,逐步向动作添加高斯噪声。3)损失函数:使用均方误差(MSE)作为扩散模型的训练损失函数,目标是最小化去噪后的动作与原始动作之间的差异。4)策略优化算法:使用PPO或DQN等标准的强化学习算法来优化扩散策略。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在Procgen和PointMaze等非平稳环境中,扩散策略显著优于PPO和DQN等传统强化学习方法。具体而言,扩散策略在平均奖励和最大奖励方面均取得了更高的性能,并且降低了奖励的方差,表明其具有更强的稳定性和适应性。例如,在某些任务中,扩散策略的平均奖励比PPO提高了20%以上。

🎯 应用场景

该研究成果可应用于机器人装配线、自主导航、游戏AI等领域。在这些场景中,环境和任务目标会随着时间发生变化,智能体需要具备快速适应和持续学习的能力。扩散策略能够帮助智能体更好地探索环境,生成更连贯的动作序列,从而提高任务完成的效率和鲁棒性。未来,该方法有望在更复杂的现实世界场景中得到应用。

📄 摘要(原文)

This paper investigates the application of Diffusion Policy in non-stationary, vision-based RL settings, specifically targeting environments where task dynamics and objectives evolve over time. Our work is grounded in practical challenges encountered in dynamic real-world scenarios such as robotics assembly lines and autonomous navigation, where agents must adapt control strategies from high-dimensional visual inputs. We apply Diffusion Policy -- which leverages iterative stochastic denoising to refine latent action representations-to benchmark environments including Procgen and PointMaze. Our experiments demonstrate that, despite increased computational demands, Diffusion Policy consistently outperforms standard RL methods such as PPO and DQN, achieving higher mean and maximum rewards with reduced variability. These findings underscore the approach's capability to generate coherent, contextually relevant action sequences in continuously shifting conditions, while also highlighting areas for further improvement in handling extreme non-stationarity.