GazeLLM: Multimodal LLMs incorporating Human Visual Attention

作者: Jun Rekimoto

分类: cs.HC, cs.AI, cs.CV

发布日期: 2025-03-31

期刊: Augmented Humans 2025

💡 一句话要点

GazeLLM:融合人类视觉注意力的多模态LLM,高效处理第一人称视频

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态LLM 第一人称视频 眼动追踪 视觉注意力 人机交互

📋 核心要点

- 现有MLLM处理高分辨率长视频时,面临计算资源需求大和降低分辨率导致信息损失的挑战。

- GazeLLM利用眼动追踪数据,将第一人称视频分解为注视区域,聚焦于人类视觉关注的关键信息。

- 实验表明,GazeLLM在显著降低视频数据输入量的情况下,实现了与全分辨率图像相当甚至更优的任务理解能力。

📝 摘要(中文)

大型语言模型(LLM)正朝着多模态LLM(MLLM)发展,能够处理图像、音频、视频和文本。结合第一人称视频,MLLM在理解人类活动方面展现出巨大潜力,从而支持人机交互和人类增强应用,如活动辅助、现实世界智能体以及技能向机器人或他人的转移。然而,处理高分辨率、长时程视频会产生庞大的潜在表征,导致显著的内存和处理需求,限制了MLLM能够管理的视频长度和分辨率。降低视频分辨率虽然可以减少内存使用,但通常会损害理解能力。本文提出了一种通过整合眼动追踪数据来优化第一人称视频分析的方法,将视频分解为注视焦点区域。通过选择性地处理这些注视焦点输入,我们的方法实现了与处理全分辨率完整图像相当甚至更好的任务理解,但显著减少了视频数据输入(像素数减少到十分之一),为使用MLLM解释和利用人类技能提供了一种高效的解决方案。

🔬 方法详解

问题定义:现有方法在处理第一人称视角视频时,需要处理大量的冗余信息,导致计算资源消耗巨大,并且降低视频分辨率会损失关键信息,影响模型理解人类活动的能力。因此,需要一种方法能够在降低计算成本的同时,保留关键信息,提升模型对人类活动的理解能力。

核心思路:论文的核心思路是利用人类的视觉注意力机制,通过眼动追踪技术确定视频中的注视区域,只处理这些区域的信息。人类的视觉注意力会聚焦于场景中的关键信息,因此,通过处理注视区域的信息,可以有效地降低计算成本,同时保留关键信息。

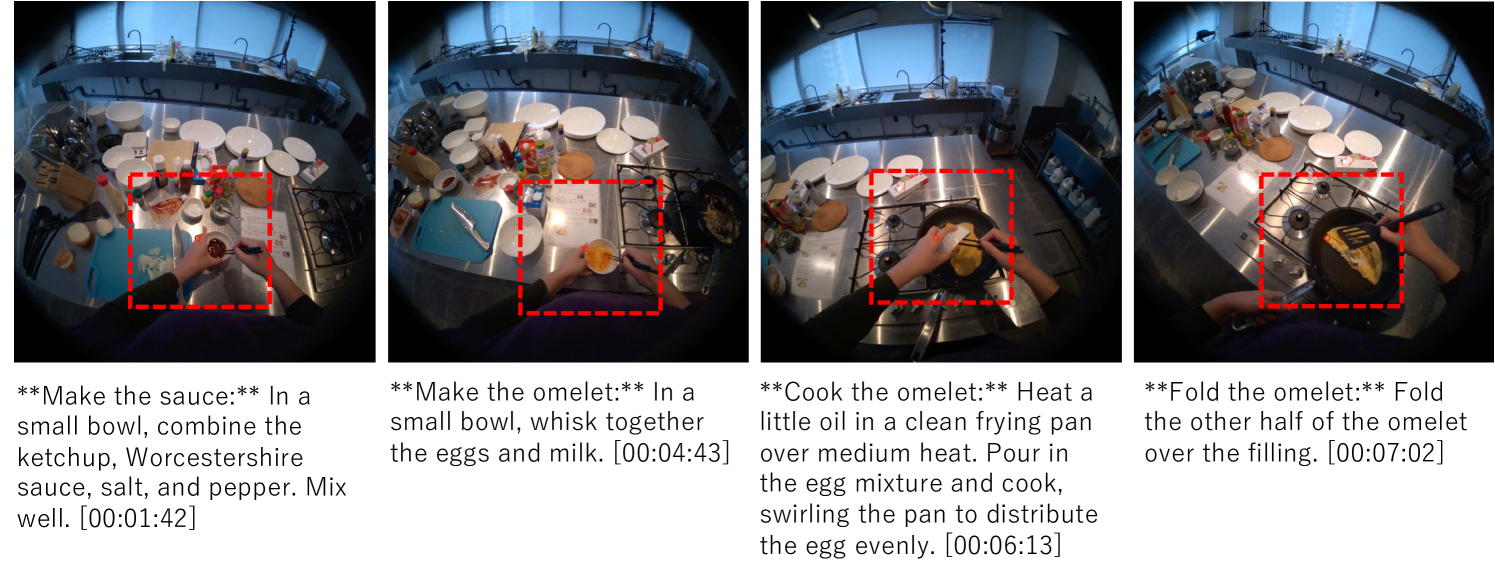

技术框架:GazeLLM的整体框架包括以下几个主要步骤:1) 使用眼动追踪设备记录用户的眼动数据。2) 将第一人称视角视频与眼动数据进行对齐,确定每一帧视频中的注视区域。3) 将视频分解为多个子区域,并根据注视区域选择性地输入到MLLM中。4) MLLM对输入的注视区域信息进行处理,完成对人类活动的理解和分析。

关键创新:GazeLLM的关键创新在于将眼动追踪技术与MLLM相结合,利用人类的视觉注意力机制来优化视频处理过程。与传统的处理整个视频帧的方法相比,GazeLLM只需要处理注视区域的信息,从而显著降低了计算成本,同时保留了关键信息。

关键设计:论文中没有详细说明具体的网络结构和损失函数等技术细节,但可以推测,关键设计可能包括:1) 如何有效地将眼动数据与视频帧进行对齐。2) 如何选择合适的子区域划分方法,以确保注视区域的信息能够被完整地捕捉。3) 如何设计损失函数,以鼓励模型关注注视区域的信息。这些具体的技术细节有待进一步研究。

🖼️ 关键图片

📊 实验亮点

GazeLLM通过整合眼动追踪数据,显著降低了视频数据输入量(像素数减少到十分之一),同时实现了与处理全分辨率完整图像相当甚至更好的任务理解。这意味着GazeLLM能够在计算资源有限的情况下,有效地处理第一人称视角视频,为MLLM在实际应用中提供了更高效的解决方案。具体的性能数据和对比基线需要在论文中查找。

🎯 应用场景

GazeLLM具有广泛的应用前景,例如:可以应用于人机交互领域,帮助机器更好地理解人类的意图和行为;可以应用于机器人领域,使机器人能够模仿人类的技能;可以应用于教育领域,帮助学生更好地学习和掌握知识;还可以应用于医疗领域,辅助医生进行诊断和治疗。该研究有望推动人机交互、机器人、教育和医疗等领域的发展。

📄 摘要(原文)

Large Language Models (LLMs) are advancing into Multimodal LLMs (MLLMs), capable of processing image, audio, and video as well as text. Combining first-person video, MLLMs show promising potential for understanding human activities through video and audio, enabling many human-computer interaction and human-augmentation applications such as human activity support, real-world agents, and skill transfer to robots or other individuals. However, handling high-resolution, long-duration videos generates large latent representations, leading to substantial memory and processing demands, limiting the length and resolution MLLMs can manage. Reducing video resolution can lower memory usage but often compromises comprehension. This paper introduces a method that optimizes first-person video analysis by integrating eye-tracking data, and proposes a method that decomposes first-person vision video into sub areas for regions of gaze focus. By processing these selectively gazed-focused inputs, our approach achieves task comprehension equivalent to or even better than processing the entire image at full resolution, but with significantly reduced video data input (reduce the number of pixels to one-tenth), offering an efficient solution for using MLLMs to interpret and utilize human skills.