DebFlow: Automating Agent Creation via Agent Debate

作者: Jinwei Su, Yinghui Xia, Yiqun Duan, Jun Du, Jianuo Huang, Tianyu Shi, Lewei He

分类: cs.AI

发布日期: 2025-03-31 (更新: 2025-09-19)

💡 一句话要点

DebFlow:通过智能体辩论自动创建Agent工作流,提升推理能力并降低资源消耗。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 智能体辩论 工作流生成 大型语言模型 反思学习 自动化Agent

📋 核心要点

- 现有工作流生成方法推理能力不足,计算和资源需求高昂,限制了其应用。

- DebFlow利用辩论机制优化工作流,并结合反思机制从历史经验中学习,提升性能。

- 实验表明,DebFlow在多个数据集上优于现有方法,训练资源消耗降低37%,辩论机制至关重要。

📝 摘要(中文)

本文提出了一种名为DebFlow的框架,旨在通过辩论机制优化工作流,并结合反思机制,根据先前的经验进行改进,从而解决现有方法推理能力有限、计算需求高和资源需求大的问题。该方法在包括HotpotQA、MATH和ALFWorld在内的六个基准数据集上进行了评估,结果表明,与最新的基线方法相比,DebFlow的平均性能提高了3%,证明了其在不同问题领域中的有效性。此外,在训练过程中,该框架的资源消耗比最先进的基线方法降低了37%。消融研究表明,移除辩论组件会导致两个基准数据集的性能下降4%,远大于移除反思组件时观察到的2%的下降,这有力地证明了辩论在增强框架性能方面的关键作用,同时也突出了反思对整体优化的辅助贡献。

🔬 方法详解

问题定义:现有基于大型语言模型(LLMs)的工作流生成方法,在复杂推理任务中表现出推理能力的局限性,同时需要大量的计算资源和数据支持,导致训练成本高昂,难以部署到资源受限的环境中。因此,需要一种更高效、更具推理能力的工作流生成方法。

核心思路:DebFlow的核心思路是引入智能体辩论机制,让多个智能体针对同一个问题提出不同的解决方案,并通过辩论来互相评估和改进这些方案。同时,引入反思机制,让智能体能够从之前的辩论经验中学习,从而不断提升其解决问题的能力。这种设计模仿了人类解决问题的过程,通过集思广益和反思来找到最佳方案。

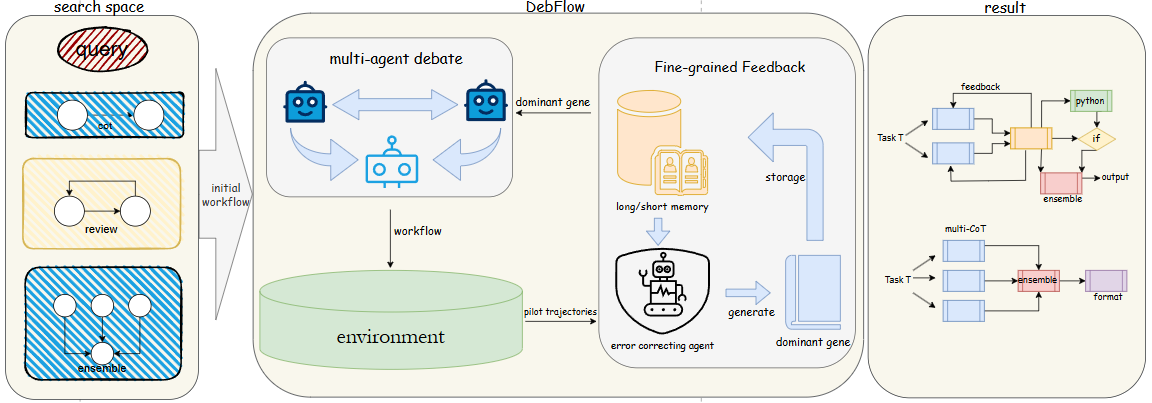

技术框架:DebFlow框架主要包含以下几个阶段:1) 问题提出:给定一个需要解决的问题。2) 方案生成:多个智能体独立地提出解决该问题的方案。3) 辩论:智能体之间互相评估和辩论彼此的方案,指出方案的优点和缺点。4) 方案改进:根据辩论的结果,智能体改进自己的方案。5) 反思:智能体反思整个解决问题的过程,总结经验教训。整个流程迭代多次,直到找到一个满意的解决方案。

关键创新:DebFlow的关键创新在于引入了智能体辩论机制。与传统的单智能体工作流生成方法相比,DebFlow能够利用多个智能体的智慧,从而生成更优的工作流。此外,反思机制也使得智能体能够不断学习和改进,从而提升其解决问题的能力。

关键设计:DebFlow中,每个智能体都由一个大型语言模型(LLM)驱动。辩论过程通过提示工程(Prompt Engineering)实现,例如,设计特定的提示语来引导智能体进行评估、反驳和改进。反思机制则通过将历史辩论记录作为输入,让LLM总结经验教训来实现。具体的参数设置和网络结构取决于所使用的大型语言模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DebFlow在六个基准数据集上取得了显著的性能提升,平均性能比最先进的基线方法提高了3%。更重要的是,DebFlow在训练过程中显著降低了资源消耗,比基线方法降低了37%。消融实验进一步验证了辩论机制的关键作用,移除辩论组件导致性能显著下降,表明辩论是DebFlow性能提升的主要驱动力。

🎯 应用场景

DebFlow具有广泛的应用前景,可用于自动化任务规划、智能决策支持、代码生成、问题求解等领域。例如,在机器人领域,DebFlow可以用于自动生成机器人的运动规划方案;在金融领域,可以用于辅助投资决策;在软件开发领域,可以用于自动生成代码。该研究有助于降低人工智能应用的开发成本,提高人工智能系统的智能化水平。

📄 摘要(原文)

Large language models (LLMs) have demonstrated strong potential and impressive performance in automating the generation and optimization of workflows. However, existing approaches are marked by limited reasoning capabilities, high computational demands, and significant resource requirements. To address these issues, we propose DebFlow, a framework that employs a debate mechanism to optimize workflows and integrates reflexion to improve based on previous experiences. We evaluated our method across six benchmark datasets, including HotpotQA, MATH, and ALFWorld. Our approach achieved a 3\% average performance improvement over the latest baselines, demonstrating its effectiveness in diverse problem domains. In particular, during training, our framework reduces resource consumption by 37\% compared to the state-of-the-art baselines. Additionally, we performed ablation studies. Removing the Debate component resulted in a 4\% performance drop across two benchmark datasets, significantly greater than the 2\% drop observed when the Reflection component was removed. These findings strongly demonstrate the critical role of Debate in enhancing framework performance, while also highlighting the auxiliary contribution of reflexion to overall optimization.