Ethereum Price Prediction Employing Large Language Models for Short-term and Few-shot Forecasting

作者: Eftychia Makri, Georgios Palaiokrassas, Sarah Bouraga, Antigoni Polychroniadou, Leandros Tassiulas

分类: cs.AI, cs.CE

发布日期: 2025-03-29

💡 一句话要点

利用大型语言模型进行以太坊短期和少样本价格预测

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 以太坊价格预测 大型语言模型 少样本学习 时间序列分析 迁移学习

📋 核心要点

- 现有时间序列模型在加密货币价格预测中面临数据稀缺的挑战,限制了模型的泛化能力和预测精度。

- 该论文提出一种新颖方法,通过微调预训练的大型语言模型(LLM),使其适应以太坊价格时间序列数据的特性,从而实现少样本学习。

- 实验结果表明,选择性冻结LLM某些层的方法,在多个评估指标上超越了传统和先进模型,证明了其有效性和鲁棒性。

📝 摘要(中文)

加密货币以其创新的区块链技术和剧烈的价格波动改变了金融市场,为预测分析带来了挑战和机遇。以太坊作为领先的加密货币之一,经历了显著的市场波动,使其价格预测成为一个有吸引力但又复杂的问题。本文全面研究了大型语言模型(LLM)在以太坊价格短期和少样本预测场景中的有效性。训练时间序列分析模型的主要挑战是缺乏数据。我们通过一种新颖的方法来解决这个问题,该方法将现有的在数十亿个token的自然语言或图像上预训练的LLM适应于以太坊价格时间序列数据的独特特征。通过彻底的实验并与传统和当代模型进行比较,我们的结果表明,选择性地冻结预训练LLM的某些层可以在该领域实现最先进的性能。这种方法在包括均方误差(MSE)、平均绝对误差(MAE)和均方根误差(RMSE)在内的多个指标上始终优于基准,证明了其有效性和鲁棒性。我们的研究不仅为LLM的现有知识体系做出了贡献,还为加密货币预测领域提供了实践见解。预训练LLM处理以太坊价格性质的适应性为未来的研究指明了一个有希望的方向,可能包括整合情感分析以进一步提高预测准确性。

🔬 方法详解

问题定义:论文旨在解决以太坊价格的短期预测问题,尤其是在数据量有限的少样本场景下。传统的时间序列模型和一些深度学习模型在面对加密货币价格的波动性和非线性特征时,往往表现不佳,且需要大量数据进行训练。

核心思路:核心思路是利用预训练的大型语言模型(LLM)的强大表征能力,通过微调使其适应以太坊价格时间序列数据的特性。LLM在海量文本数据上预训练,学习到了丰富的通用知识,可以作为良好的特征提取器,从而减少对大量特定领域数据的依赖。

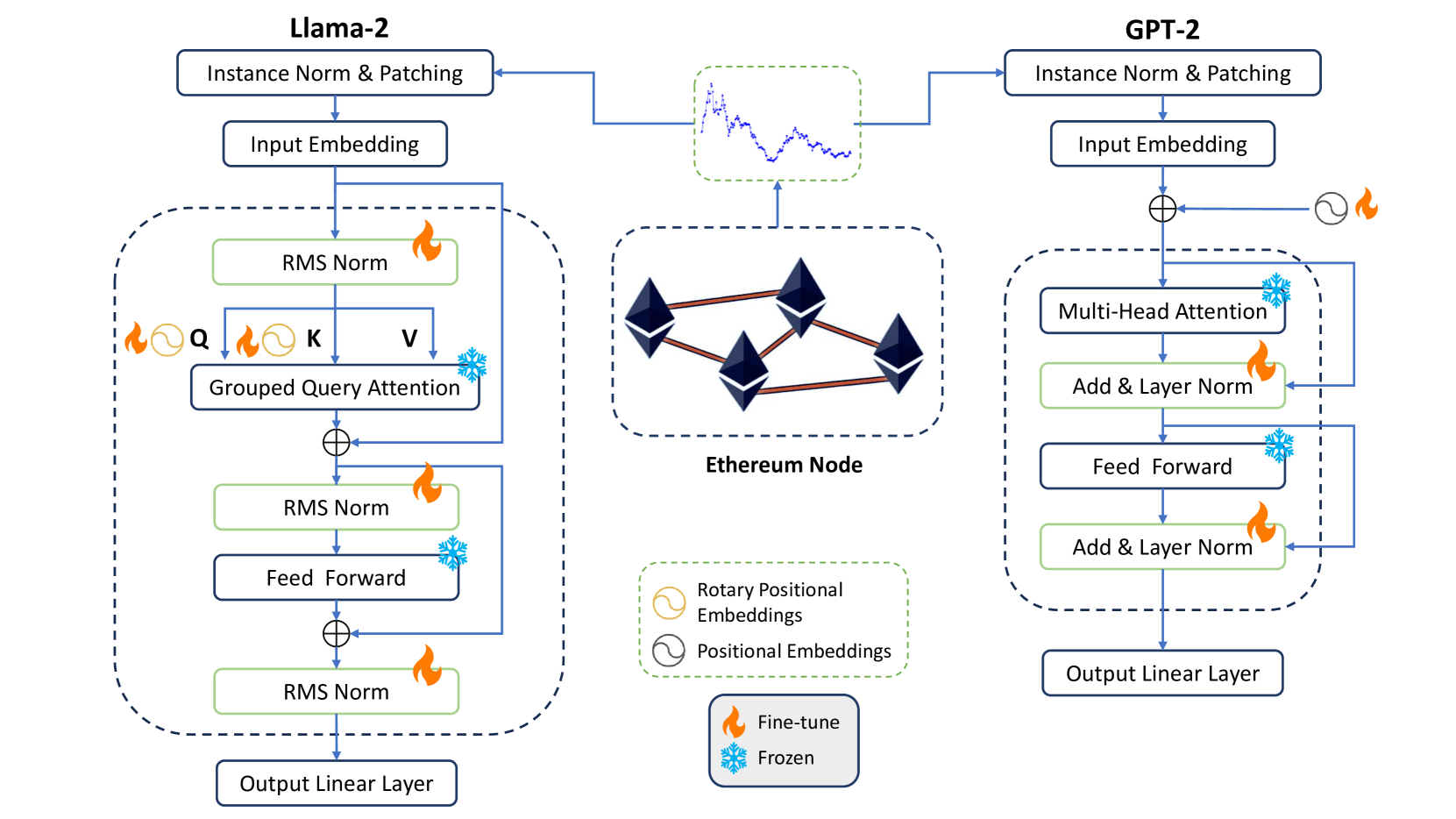

技术框架:整体框架包括以下几个阶段:1)数据预处理:对以太坊价格时间序列数据进行清洗、归一化等处理。2)模型选择:选择合适的预训练LLM作为基础模型。3)模型微调:在以太坊价格数据上对LLM进行微调,使其适应时间序列预测任务。4)模型评估:使用MSE、MAE、RMSE等指标评估模型的预测性能。

关键创新:关键创新在于将预训练LLM应用于加密货币价格预测,并提出了一种选择性冻结LLM某些层的微调策略。这种策略可以在保留LLM通用知识的同时,使其更好地适应特定领域的数据,从而提高预测精度。与传统方法相比,该方法能够利用LLM的预训练知识,减少对大量训练数据的需求。

关键设计:论文中一个关键的设计是选择性冻结LLM的某些层。具体来说,作者可能冻结了LLM的底层,保留其通用的语言表征能力,而只对高层进行微调,使其适应以太坊价格数据的特性。损失函数可能采用了均方误差(MSE)或平均绝对误差(MAE),以衡量预测值与真实值之间的差距。具体的网络结构细节(如LLM的具体架构)未知。

🖼️ 关键图片

📊 实验亮点

该研究通过实验证明,选择性冻结预训练LLM某些层的方法,在以太坊价格预测任务中取得了state-of-the-art的性能。具体而言,该方法在MSE、MAE和RMSE等多个指标上均优于传统的时间序列模型和一些深度学习模型,表明了其有效性和鲁棒性。具体的性能提升幅度未知。

🎯 应用场景

该研究成果可应用于加密货币交易策略制定、风险管理和投资组合优化。通过准确预测以太坊价格,投资者可以更好地把握市场机会,降低投资风险。此外,该方法还可以推广到其他加密货币或金融时间序列数据的预测,具有广泛的应用前景。

📄 摘要(原文)

Cryptocurrencies have transformed financial markets with their innovative blockchain technology and volatile price movements, presenting both challenges and opportunities for predictive analytics. Ethereum, being one of the leading cryptocurrencies, has experienced significant market fluctuations, making its price prediction an attractive yet complex problem. This paper presents a comprehensive study on the effectiveness of Large Language Models (LLMs) in predicting Ethereum prices for short-term and few-shot forecasting scenarios. The main challenge in training models for time series analysis is the lack of data. We address this by leveraging a novel approach that adapts existing pre-trained LLMs on natural language or images from billions of tokens to the unique characteristics of Ethereum price time series data. Through thorough experimentation and comparison with traditional and contemporary models, our results demonstrate that selectively freezing certain layers of pre-trained LLMs achieves state-of-the-art performance in this domain. This approach consistently surpasses benchmarks across multiple metrics, including Mean Squared Error (MSE), Mean Absolute Error (MAE), and Root Mean Squared Error (RMSE), demonstrating its effectiveness and robustness. Our research not only contributes to the existing body of knowledge on LLMs but also provides practical insights in the cryptocurrency prediction domain. The adaptability of pre-trained LLMs to handle the nature of Ethereum prices suggests a promising direction for future research, potentially including the integration of sentiment analysis to further refine forecasting accuracy.