Large Language Models Are Unreliable for Cyber Threat Intelligence

作者: Emanuele Mezzi, Fabio Massacci, Katja Tuma

分类: cs.CR, cs.AI, cs.LG

发布日期: 2025-03-29 (更新: 2025-11-12)

DOI: 10.1007/978-3-032-00627-1_17

💡 一句话要点

评估LLM在网络威胁情报中的可靠性,揭示其不一致性和过度自信问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 网络威胁情报 可靠性评估 一致性 置信度 零样本学习 少样本学习

📋 核心要点

- 现有方法难以有效处理网络安全领域海量且异构的威胁情报数据,自动化程度不足。

- 论文提出一种评估LLM在CTI任务中性能、一致性和置信度的方法,考察其适用性。

- 实验表明,LLM在实际规模的威胁情报报告上表现不佳,且存在不一致和过度自信的问题。

📝 摘要(中文)

大量研究表明,大型语言模型(LLM)可以通过自动化网络威胁情报(CTI)任务,来应对网络安全领域的数据洪流。本文提出了一种评估方法,该方法不仅允许在零样本学习、少样本学习和微调的情况下测试LLM在CTI任务上的表现,还可以量化其一致性和置信度。我们使用三个最先进的LLM和一个包含350份威胁情报报告的数据集进行了实验,并提供了新的证据,表明依赖LLM进行CTI存在潜在的安全风险。结果表明,LLM无法保证在实际规模的报告上获得足够的性能,同时还存在不一致和过度自信的问题。少样本学习和微调仅能部分改善结果,因此对在缺乏标记数据集且置信度至关重要的CTI场景中使用LLM的可能性提出了质疑。

🔬 方法详解

问题定义:论文旨在评估大型语言模型(LLM)在网络威胁情报(CTI)任务中的可靠性。现有方法依赖人工分析,效率低下,而直接应用LLM可能存在风险,因为LLM的性能、一致性和置信度未经充分验证。现有的CTI数据集通常规模较小,难以充分评估LLM在真实场景下的表现。

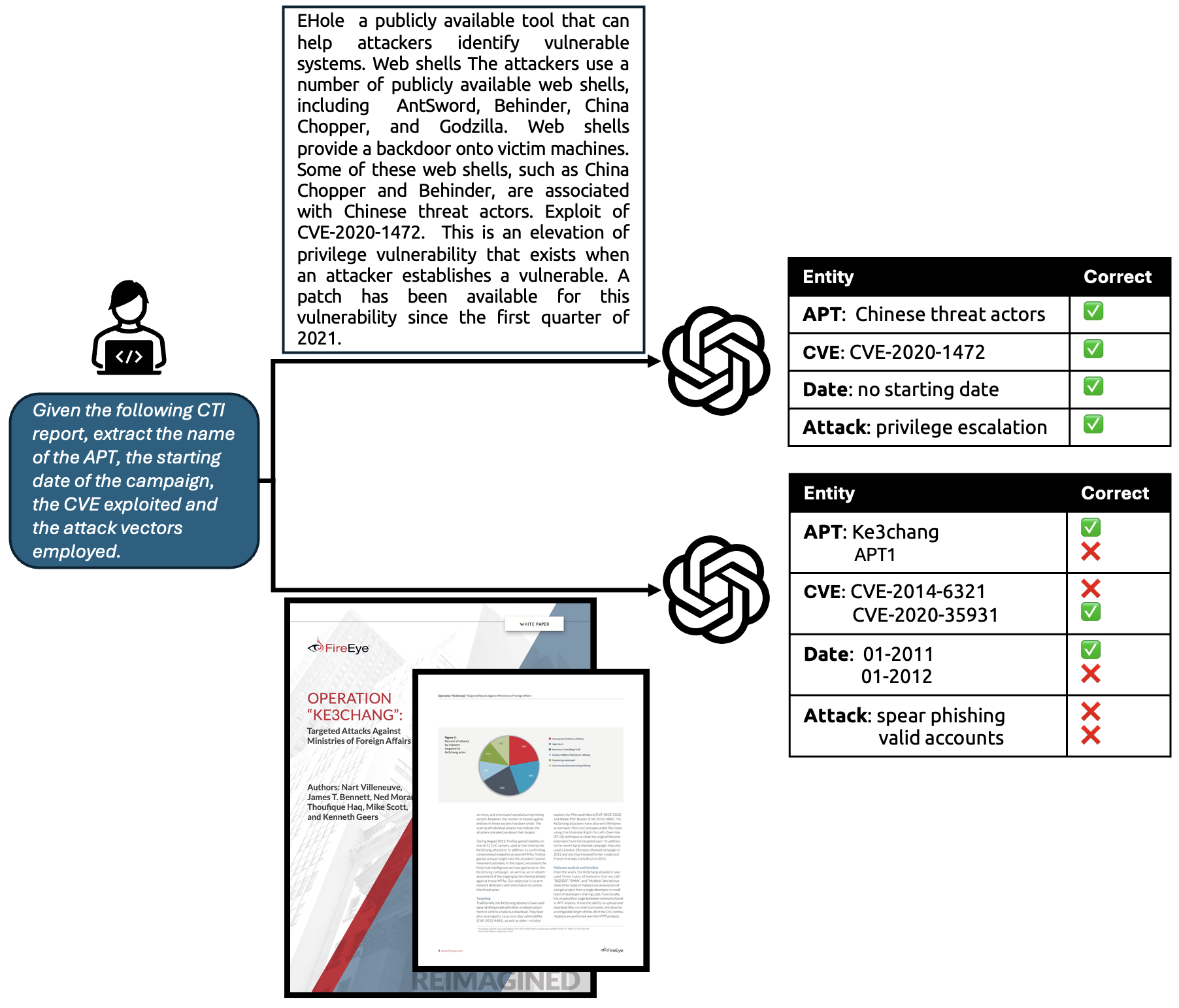

核心思路:论文的核心思路是设计一个全面的评估框架,用于量化LLM在CTI任务中的性能、一致性和置信度。通过在真实规模的威胁情报报告上进行实验,揭示LLM在实际应用中可能存在的问题,例如不一致性和过度自信。该评估框架旨在帮助安全从业人员更好地了解LLM的局限性,并谨慎地将其应用于CTI任务。

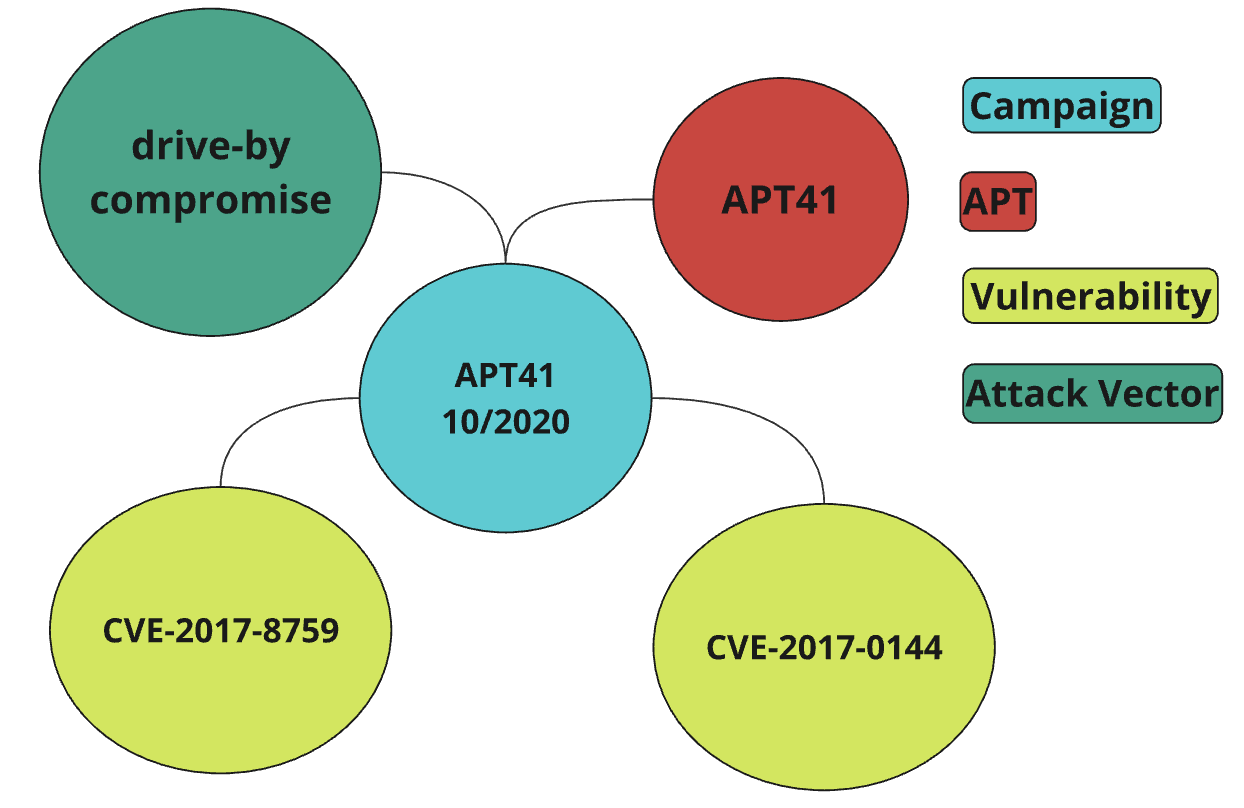

技术框架:论文的评估框架主要包含以下几个阶段:1) 数据集构建:使用包含350份威胁情报报告的数据集。2) LLM选择:选择三个最先进的LLM进行实验。3) 任务定义:定义CTI任务,例如威胁类型识别、恶意软件家族分类等。4) 评估指标:设计评估指标,包括准确率、一致性得分和置信度得分。5) 实验设置:进行零样本学习、少样本学习和微调实验。6) 结果分析:分析实验结果,评估LLM的性能、一致性和置信度。

关键创新:论文的关键创新在于提出了一种全面的评估方法,可以量化LLM在CTI任务中的一致性和置信度。与现有研究相比,该方法更加关注LLM在实际应用中的可靠性,而不仅仅是性能。此外,论文还使用了真实规模的威胁情报报告进行实验,更贴近实际应用场景。

关键设计:论文的关键设计包括:1) 一致性评估:通过多次运行LLM并比较结果,评估其一致性。2) 置信度评估:分析LLM输出的概率分布,评估其置信度。3) 实验设置:设计零样本学习、少样本学习和微调实验,考察不同学习范式下LLM的性能。4) 数据集选择:选择包含350份威胁情报报告的数据集,保证实验的规模和真实性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM在实际规模的威胁情报报告上表现不佳,准确率低于预期。更重要的是,LLM表现出不一致性和过度自信的问题,即使在错误的情况下也给出高置信度的预测。少样本学习和微调仅能部分改善结果,无法根本解决LLM的可靠性问题。例如,在威胁类型识别任务中,LLM的一致性得分仅为0.6,表明其预测结果不稳定。

🎯 应用场景

该研究成果可应用于网络安全领域,帮助安全分析师评估和选择合适的LLM用于自动化CTI任务。通过量化LLM的可靠性,可以降低因LLM误判而导致的安全风险。未来的研究可以探索如何提高LLM在CTI任务中的一致性和置信度,例如通过引入外部知识或使用更鲁棒的训练方法。

📄 摘要(原文)

Several recent works have argued that Large Language Models (LLMs) can be used to tame the data deluge in the cybersecurity field, by improving the automation of Cyber Threat Intelligence (CTI) tasks. This work presents an evaluation methodology that other than allowing to test LLMs on CTI tasks when using zero-shot learning, few-shot learning and fine-tuning, also allows to quantify their consistency and their confidence level. We run experiments with three state-of-the-art LLMs and a dataset of 350 threat intelligence reports and present new evidence of potential security risks in relying on LLMs for CTI. We show how LLMs cannot guarantee sufficient performance on real-size reports while also being inconsistent and overconfident. Few-shot learning and fine-tuning only partially improve the results, thus posing doubts about the possibility of using LLMs for CTI scenarios, where labelled datasets are lacking and where confidence is a fundamental factor.