Trade-offs in Large Reasoning Models: An Empirical Analysis of Deliberative and Adaptive Reasoning over Foundational Capabilities

作者: Weixiang Zhao, Xingyu Sui, Jiahe Guo, Yulin Hu, Yang Deng, Yanyan Zhao, Xuda Zhi, Yongbo Huang, Hao He, Wanxiang Che, Ting Liu, Bing Qin

分类: cs.AI, cs.CL

发布日期: 2025-03-23 (更新: 2025-11-19)

备注: To appear at AAAI 2026

💡 一句话要点

大型推理模型中深思熟虑与自适应推理的权衡研究

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型推理模型 自适应推理 深思熟虑 推理成本 基础能力

📋 核心要点

- 现有大型推理模型在获得深思熟虑能力的同时,牺牲了基础能力,如帮助性和无害性,并增加了推理成本。

- 论文提出自适应推理,通过零思考、少思考和总结思考等模式,动态分配计算资源,以缓解上述问题。

- 实验表明,自适应推理能够有效平衡推理能力和基础能力,并降低推理成本,提升模型通用性。

📝 摘要(中文)

大型推理模型(LRM),如OpenAI的o1/o3和DeepSeek-R1,在专业推理任务中通过类人深思熟虑和长链思维推理展现了卓越的性能。然而,我们对不同模型家族(DeepSeek、Qwen和LLaMA)和规模(7B到32B)的系统评估表明,获得这些深思熟虑的推理能力会显著降低LRM的基础能力,包括有益性和无害性的显著下降,以及推理成本的大幅增加。重要的是,我们证明了自适应推理——采用诸如零思考、少思考和总结思考等模式——可以有效地缓解这些缺点。我们的经验性见解强调了开发更通用的LRM的关键需求,这些LRM能够根据特定任务特征动态地分配推理时计算资源。

🔬 方法详解

问题定义:论文旨在解决大型推理模型(LRM)在追求更强的推理能力时,基础能力下降以及推理成本增加的问题。现有方法,即一味地增加模型规模和采用更复杂的推理链,虽然提升了特定任务的性能,但忽略了模型通用性和效率,导致在其他任务上的表现下降,并且计算资源消耗巨大。

核心思路:论文的核心思路是引入自适应推理机制,使模型能够根据不同的任务特性,动态地选择合适的推理模式。这种方法旨在平衡模型的推理能力和基础能力,同时降低推理成本,提升模型的通用性和效率。

技术框架:整体框架包含三个主要部分:1) 任务特征分析模块,用于识别任务的复杂度和所需推理深度;2) 推理模式选择模块,根据任务特征选择合适的推理模式,包括零思考、少思考和总结思考等;3) 推理执行模块,根据选择的推理模式执行推理过程,并输出结果。

关键创新:论文的关键创新在于提出了自适应推理的概念,并设计了相应的推理模式选择机制。与传统的固定推理模式相比,自适应推理能够根据任务的实际需求,动态地调整推理深度和计算资源分配,从而在保证推理性能的同时,降低计算成本,提升模型的通用性。

关键设计:推理模式选择模块是关键设计之一,它基于任务特征(例如,输入文本的长度、关键词的数量等)和模型的先验知识,使用一个轻量级的分类器来预测最佳的推理模式。此外,论文还设计了不同的推理模式,例如,零思考模式直接输出结果,少思考模式进行简短的推理,总结思考模式则首先对输入进行总结,然后再进行推理。这些模式的设计旨在满足不同任务的需求,并降低计算成本。

🖼️ 关键图片

📊 实验亮点

实验结果表明,自适应推理能够在保证推理性能的同时,显著降低计算成本。例如,在某些任务上,自适应推理能够达到与深思熟虑推理相当的性能,但计算成本降低了20%-30%。此外,自适应推理还能够提升模型的基础能力,例如帮助性和无害性,使其在更广泛的应用场景中表现更佳。

🎯 应用场景

该研究成果可应用于各种需要大型语言模型进行推理的场景,例如智能客服、自动问答、机器翻译、代码生成等。通过自适应推理,可以根据任务的复杂程度动态调整推理深度,在保证性能的同时降低计算成本,提高用户体验和系统效率。未来,该技术有望推动更智能、更高效的AI应用发展。

📄 摘要(原文)

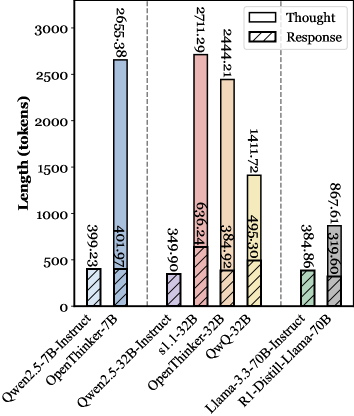

Recent advancements in Large Reasoning Models (LRMs), such as OpenAI's o1/o3 and DeepSeek-R1, have demonstrated remarkable performance in specialized reasoning tasks through human-like deliberative thinking and long chain-of-thought reasoning. However, our systematic evaluation across various model families (DeepSeek, Qwen, and LLaMA) and scales (7B to 32B) reveals that acquiring these deliberative reasoning capabilities significantly reduces the foundational capabilities of LRMs, including notable declines in helpfulness and harmlessness, alongside substantially increased inference costs. Importantly, we demonstrate that adaptive reasoning -- employing modes like Zero-Thinking, Less-Thinking, and Summary-Thinking -- can effectively alleviate these drawbacks. Our empirical insights underline the critical need for developing more versatile LRMs capable of dynamically allocating inference-time compute according to specific task characteristics.