Do Chains-of-Thoughts of Large Language Models Suffer from Hallucinations, Cognitive Biases, or Phobias in Bayesian Reasoning?

作者: Roberto Araya

分类: cs.AI

发布日期: 2025-03-19

备注: 24 pages, 3 figures

💡 一句话要点

研究表明大型语言模型的思维链在贝叶斯推理中存在幻觉和认知偏差。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 思维链 贝叶斯推理 认知偏差 提示工程

📋 核心要点

- 大型语言模型在贝叶斯推理中存在认知偏差,无法有效利用生态有效的策略。

- 通过提示诱导LLM使用自然频率等策略,以期克服其在贝叶斯推理中的偏差。

- 实验发现LLM虽能整合这些策略,但并不稳定,仍偏好符号推理,规避生态有效策略。

📝 摘要(中文)

学习推理和仔细解释论点对于学生的认知、数学和计算思维发展至关重要,尤其是在不确定性和贝叶斯推理问题中。 新一代大型语言模型(LLM)能够使用思维链(CoT)进行推理,这为通过与它们的人工内部声音对话来学习推理提供了一个绝佳的机会,从而学习贝叶斯推理。 此外,鉴于不同的LLM有时会得出相反的解决方案,CoT通过详细比较推理过程,为深度学习创造了机会。 然而,与人类不同,我们发现它们不会自主地使用生态有效的策略(如自然频率、整体对象和具身启发式)进行解释。 这很遗憾,因为这些策略可以帮助人类避免关键错误,并且在贝叶斯推理中已被证明具有教学价值。 为了克服这些偏差并帮助理解和学习,我们加入了提示,以诱导LLM使用这些策略。 我们发现具有CoT的LLM会整合它们,但并不一致。 它们表现出对符号推理的持续偏见,以及对生态有效策略的避免或恐惧。

🔬 方法详解

问题定义:论文旨在研究大型语言模型(LLM)在使用思维链(CoT)进行贝叶斯推理时,是否存在幻觉、认知偏差或恐惧症等问题。现有方法,即直接使用LLM进行推理,存在无法有效利用生态有效策略(如自然频率、整体对象和具身启发式)的痛点,导致推理结果不准确,与人类的认知方式存在差异。

核心思路:论文的核心思路是通过提示工程,诱导LLM在使用CoT进行贝叶斯推理时,采用生态有效的策略。通过这种方式,期望能够减轻LLM的认知偏差,使其推理过程更接近人类的认知方式,从而提高推理的准确性和可靠性。

技术框架:论文的技术框架主要包括以下几个阶段:1) 设计包含贝叶斯推理问题的提示;2) 在提示中加入引导LLM使用生态有效策略的指令;3) 使用LLM生成CoT推理过程;4) 分析LLM的推理过程,评估其是否有效利用了生态有效策略,以及是否存在认知偏差。

关键创新:论文的关键创新在于,它首次系统性地研究了LLM在使用CoT进行贝叶斯推理时存在的认知偏差问题,并提出了通过提示工程来减轻这些偏差的方法。此外,论文还深入分析了LLM对不同推理策略的偏好,揭示了其与人类认知方式的差异。

关键设计:论文的关键设计包括:1) 提示的设计,需要确保问题清晰、明确,同时包含引导LLM使用特定策略的指令;2) 评估指标的选择,需要能够准确衡量LLM是否有效利用了生态有效策略,以及是否存在认知偏差;3) 对比实验的设计,需要能够区分不同提示策略的效果,以及LLM在不同策略下的表现。

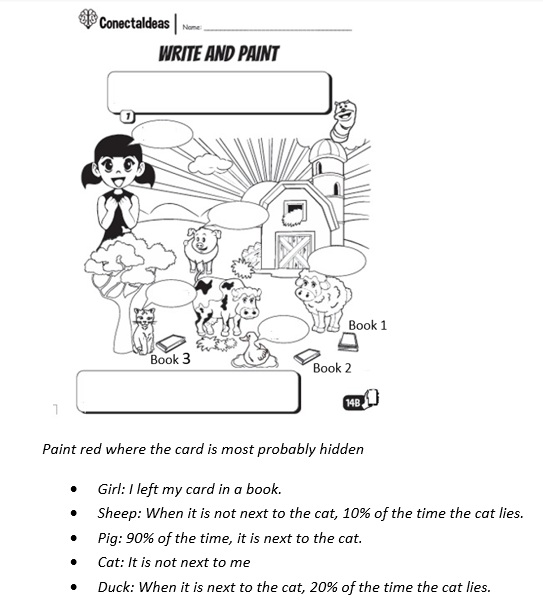

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过提示可以诱导LLM使用生态有效的策略,但LLM的偏好并不稳定,仍然倾向于符号推理。这表明LLM在贝叶斯推理中存在固有的认知偏差,需要进一步的研究来解决。该研究揭示了LLM在认知推理方面与人类的差异,为开发更智能、更可靠的AI系统提供了重要的参考。

🎯 应用场景

该研究成果可应用于教育领域,辅助学生学习贝叶斯推理,通过与LLM的对话,深入理解推理过程。此外,该研究还可用于开发更可靠的AI决策系统,尤其是在涉及风险评估和不确定性决策的场景中,例如医疗诊断、金融风险管理等。未来的研究可以探索更有效的提示策略,进一步减轻LLM的认知偏差。

📄 摘要(原文)

Learning to reason and carefully explain arguments is central to students' cognitive, mathematical, and computational thinking development. This is particularly challenging in problems under uncertainty and in Bayesian reasoning. With the new generation of large language models (LLMs) capable of reasoning using Chain-of-Thought (CoT), there is an excellent opportunity to learn with them as they explain their reasoning through a dialogue with their artificial internal voice. It is an engaging and excellent opportunity to learn Bayesian reasoning. Furthermore, given that different LLMs sometimes arrive at opposite solutions, CoT generates opportunities for deep learning by detailed comparisons of reasonings. However, unlike humans, we found that they do not autonomously explain using ecologically valid strategies like natural frequencies, whole objects, and embodied heuristics. This is unfortunate, as these strategies help humans avoid critical mistakes and have proven pedagogical value in Bayesian reasoning. In order to overcome these biases and aid understanding and learning, we included prompts that induce LLMs to use these strategies. We found that LLMs with CoT incorporate them but not consistently. They show persistent biases towards symbolic reasoning and avoidance or phobia of ecologically valid strategies.