Visualizing Thought: Conceptual Diagrams Enable Robust Planning in LMMs

作者: Nasim Borazjanizadeh, Roei Herzig, Eduard Oks, Trevor Darrell, Rogerio Feris, Leonid Karlinsky

分类: cs.AI

发布日期: 2025-03-14 (更新: 2025-09-29)

💡 一句话要点

提出Visual Thinking框架,利用概念图提升LMM在复杂规划任务中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 概念图 大型多模态模型 组合规划 推理框架 Graph-of-Thought

📋 核心要点

- 大型语言模型(LLM)和大型多模态模型(LMM)在复杂多步任务中,主要依赖文本推理,效果受限。

- Visual Thinking框架通过让LMM生成并利用概念图进行推理,结合文本和图解,提升组合规划能力。

- 实验表明,该方法在多个PDDL规划领域显著提升LMM性能,优于纯文本推理方法,尤其在深层任务中。

📝 摘要(中文)

本文提出了一种名为Visual Thinking的通用框架,该框架通过让大型多模态模型(LMM)利用自生成的概念图进行多链推理,从而显著增强其组合规划能力。该方法仅需任务的自然语言描述,无需人工干预。它将文本和图解推理集成到一个优化的Graph-of-Thought推理框架中,并通过束搜索和深度回溯进行增强。在多个具有挑战性的PDDL规划领域进行的评估表明,该方法显著提高了LMM的性能(例如,在Blocksworld中,GPT-4o从35.5%提高到90.2%),并且始终优于纯文本的基于搜索的推理方法。在解决方案深度高达40的更困难的领域中,它也超过了o1-preview推理模型(例如,在Floor Tiles中提高了16个百分点)。这些结果证明了概念图作为LMM中推理媒介的强大能力。

🔬 方法详解

问题定义:现有的大型语言模型和多模态模型在处理复杂的多步骤规划任务时,主要依赖于文本推理,这种方式在处理需要抽象和空间推理的问题时存在局限性。模型的性能受到文本表示能力的限制,难以有效地进行组合规划。

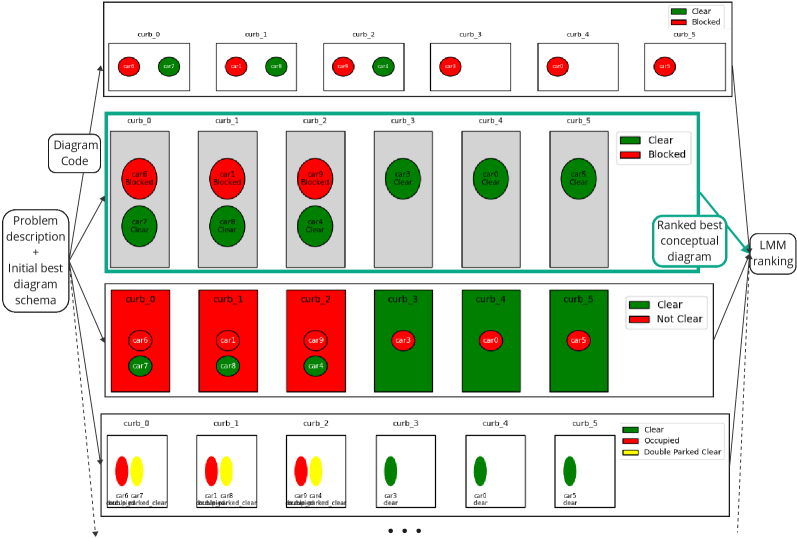

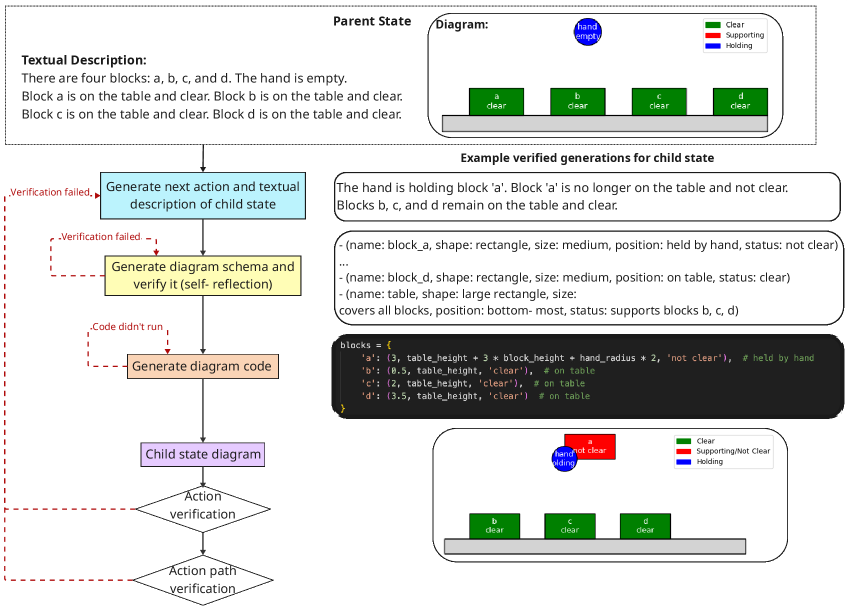

核心思路:论文的核心思路是引入概念图作为LMM的推理媒介。概念图能够抽象掉不相关的细节,有效地捕捉实体之间的交互关系,从而帮助LMM更好地理解和解决问题。通过将文本推理和图解推理相结合,可以显著提升LMM的规划能力。

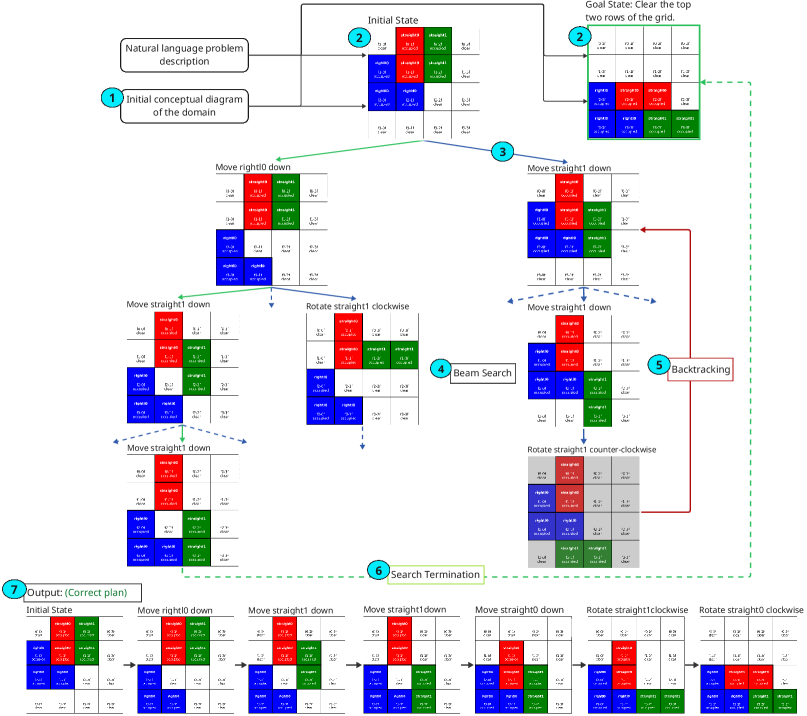

技术框架:Visual Thinking框架主要包含以下几个阶段:1) 任务描述输入:接收任务的自然语言描述。2) 概念图生成:LMM根据任务描述生成一系列概念图,每个概念图代表一个中间状态或步骤。3) Graph-of-Thought推理:利用生成的概念图构建一个图结构,其中节点代表状态,边代表动作。4) 搜索优化:采用束搜索和深度回溯等方法,在图结构中搜索最优的规划路径。5) 动作执行:根据搜索到的规划路径,执行相应的动作。

关键创新:该方法最重要的创新点在于将概念图引入到LMM的推理过程中,并构建了一个能够有效利用概念图进行推理的Graph-of-Thought框架。与传统的纯文本推理方法相比,该方法能够更好地处理需要抽象和空间推理的问题,从而显著提升LMM的规划能力。

关键设计:在概念图生成阶段,需要设计合适的prompt,引导LMM生成高质量的概念图。在Graph-of-Thought推理阶段,需要设计合适的搜索策略,以在复杂的图结构中高效地搜索最优路径。束搜索的宽度和深度回溯的步长是需要仔细调整的关键参数。此外,如何有效地融合文本信息和图解信息也是一个重要的设计考虑。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Visual Thinking框架在多个PDDL规划领域显著提升了LMM的性能。例如,在Blocksworld任务中,GPT-4o的性能从35.5%提高到90.2%。在Floor Tiles任务中,该方法比o1-preview推理模型提高了16个百分点。这些结果表明,概念图作为推理媒介在LMM中具有强大的潜力。

🎯 应用场景

该研究成果可应用于机器人导航、游戏AI、任务规划等领域。例如,在机器人导航中,机器人可以利用概念图来理解环境和规划路径;在游戏AI中,AI可以利用概念图来制定游戏策略。该研究有望提升人工智能系统在复杂环境下的决策能力,并推动人工智能技术在更多领域的应用。

📄 摘要(原文)

Human reasoning relies on constructing and manipulating mental models -- simplified internal representations of situations used to understand and solve problems. Conceptual diagrams (e.g., a sketch drawn to aid reasoning) externalize these mental models, abstracting irrelevant details to efficiently capture how entities interact. In contrast, Large Language Models (LLMs) and Large MultiModal Models (LMMs) predominantly reason through text, limiting their effectiveness on complex multi-step tasks. In this paper, we propose Visual Thinking, a generalizable framework that enables LMMs to reason through multiple chains of self-generated conceptual diagrams, significantly enhancing their combinatorial planning capabilities. Our approach requires no human input beyond the natural language description of the task. It integrates textual and diagrammatic reasoning within an optimized Graph-of-Thought inference framework, enhanced by beam search and depth-wise backtracking. Evaluated on multiple challenging PDDL planning domains, our method substantially improves LMM performance (e.g., GPT-4o: 35.5% -> 90.2% in Blocksworld) and consistently outperforms text-only search-based inference methods. On more difficult domains with solution depths up to 40, it also surpasses the o1-preview reasoning model (e.g., 16 percentage points improvement in Floor Tiles). These results demonstrate the power of conceptual diagrams as a reasoning medium in LMMs.