LLM-Guided Indoor Navigation with Multimodal Map Understanding

作者: Alberto Coffrini, Paolo Barsocchi, Francesco Furfari, Antonino Crivello, Alessio Ferrari

分类: cs.AI, cs.CL, cs.LG

发布日期: 2025-03-12 (更新: 2025-06-19)

备注: 7 pages, 3 figures, 5 tables

💡 一句话要点

利用LLM和多模态地图理解实现室内导航

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 室内导航 大型语言模型 多模态学习 ChatGPT 自然语言生成

📋 核心要点

- 现有室内导航方案难以适应复杂环境,且依赖专用硬件,限制了其通用性和易用性。

- 利用大型语言模型ChatGPT,从室内地图图像生成自然语言导航指令,实现上下文感知的个性化导航。

- 实验结果表明,该方法在不同真实环境中表现良好,平均正确指示率达到86.59%,最高可达97.14%。

📝 摘要(中文)

室内导航由于复杂的布局和GNSS信号的缺失而面临独特的挑战。现有的解决方案通常难以进行上下文适应,并且通常需要专用硬件。本文探讨了大型语言模型(LLM),即ChatGPT,从室内地图图像生成自然、感知上下文的导航指令的潜力。我们设计并评估了不同真实环境下的测试用例,分析了LLM在解释空间布局、处理用户约束和规划高效路线方面的有效性。我们的研究结果表明,LLM在支持个性化室内导航方面具有潜力,平均正确指示率为86.59%,最高可达97.14%。所提出的系统实现了高精度和推理性能。这些结果对人工智能驱动的导航和辅助技术具有重要意义。

🔬 方法详解

问题定义:室内导航面临GNSS信号缺失和环境复杂性带来的挑战。现有方法通常依赖于预先构建的地图或专用传感器,难以适应动态变化的环境,并且缺乏对用户意图的理解,导致导航指令不够自然和个性化。

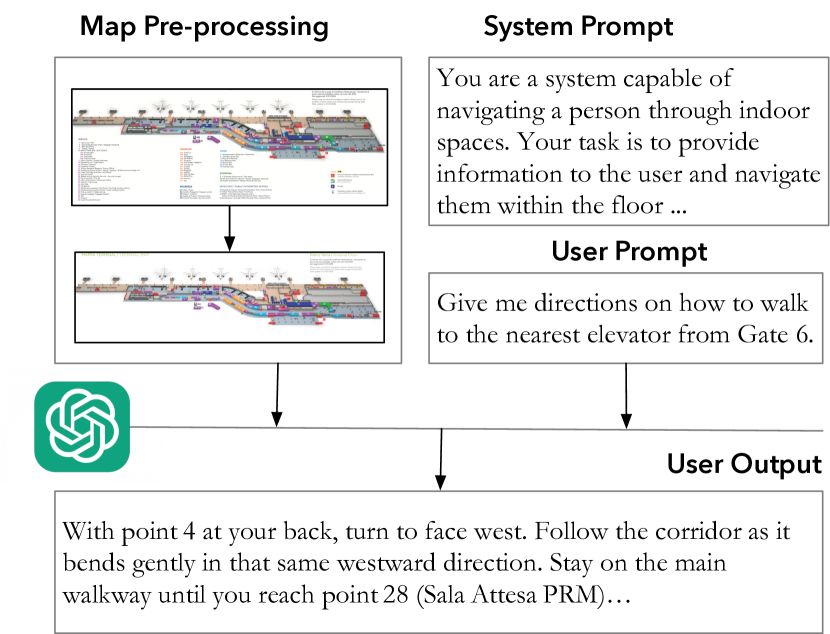

核心思路:利用大型语言模型(LLM)强大的语言理解和生成能力,将室内地图图像作为输入,生成自然语言导航指令。通过让LLM理解空间布局、用户约束和目标位置,实现上下文感知的导航。

技术框架:该系统主要包含两个阶段:1) 多模态输入:将室内地图图像和用户约束(例如,避免楼梯)输入到LLM。2) 指令生成:LLM基于输入信息,生成自然语言导航指令。整个流程无需额外的专用硬件或预先构建的详细地图。

关键创新:该方法的核心创新在于利用LLM的零样本学习能力,直接从地图图像生成导航指令,无需针对特定环境进行训练或微调。这使得该方法具有很强的泛化能力和适应性。与传统方法相比,该方法更加灵活、易于部署,并且能够更好地理解用户意图。

关键设计:论文中没有详细说明LLM的具体prompt设计或微调策略。关键在于如何有效地将地图图像信息编码并输入到LLM中,以及如何设计prompt来引导LLM生成高质量的导航指令。实验中使用了ChatGPT,但没有提及任何参数设置或损失函数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在不同真实室内环境中取得了良好的导航效果,平均正确指示率为86.59%,最高可达97.14%。这表明LLM在理解空间布局和生成自然语言导航指令方面具有很强的潜力。该方法无需针对特定环境进行训练,具有很强的泛化能力。

🎯 应用场景

该研究成果可应用于智能建筑、商场、医院等室内环境的导航服务,为用户提供个性化、自然的导航体验。尤其对于老年人、残疾人等弱势群体,该技术可以提供更便捷、安全的辅助导航服务。未来,该技术还可以与机器人、AR/VR等技术结合,实现更智能化的室内导航和交互。

📄 摘要(原文)

Indoor navigation presents unique challenges due to complex layouts and the unavailability of GNSS signals. Existing solutions often struggle with contextual adaptation, and typically require dedicated hardware. In this work, we explore the potential of a Large Language Model (LLM), i.e., ChatGPT, to generate natural, context-aware navigation instructions from indoor map images. We design and evaluate test cases across different real-world environments, analyzing the effectiveness of LLMs in interpreting spatial layouts, handling user constraints, and planning efficient routes. Our findings demonstrate the potential of LLMs for supporting personalized indoor navigation, with an average of 86.59% correct indications and a maximum of 97.14%. The proposed system achieves high accuracy and reasoning performance. These results have key implications for AI-driven navigation and assistive technologies.