Towards Reasoning Era: A Survey of Long Chain-of-Thought for Reasoning Large Language Models

作者: Qiguang Chen, Libo Qin, Jinhao Liu, Dengyun Peng, Jiannan Guan, Peng Wang, Mengkang Hu, Yuhang Zhou, Te Gao, Wanxiang Che

分类: cs.AI, cs.CL

发布日期: 2025-03-12 (更新: 2025-07-18)

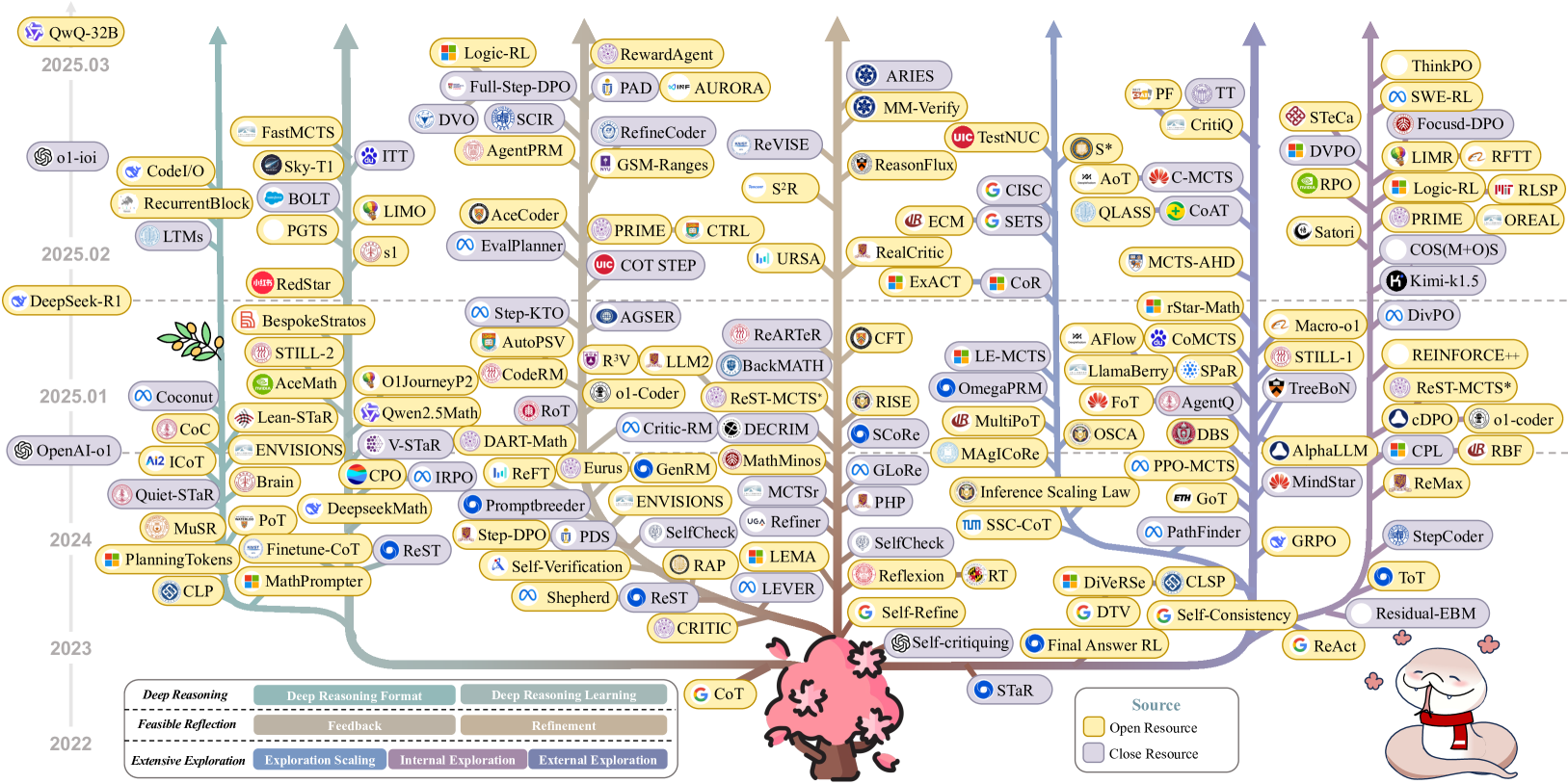

备注: Paper list and Github tutorial are available at https://github.com/LightChen233/Awesome-Long-Chain-of-Thought-Reasoning. Update 250+ New Reference

💡 一句话要点

综述长链思考(Long CoT)在推理大语言模型中的应用,并提出未来研究方向。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长链思考 大语言模型 推理能力 深度推理 多模态推理

📋 核心要点

- 现有方法在复杂推理任务中面临挑战,尤其是在需要深度和多步骤推理的场景下,短链思考(Short CoT)方法存在局限性。

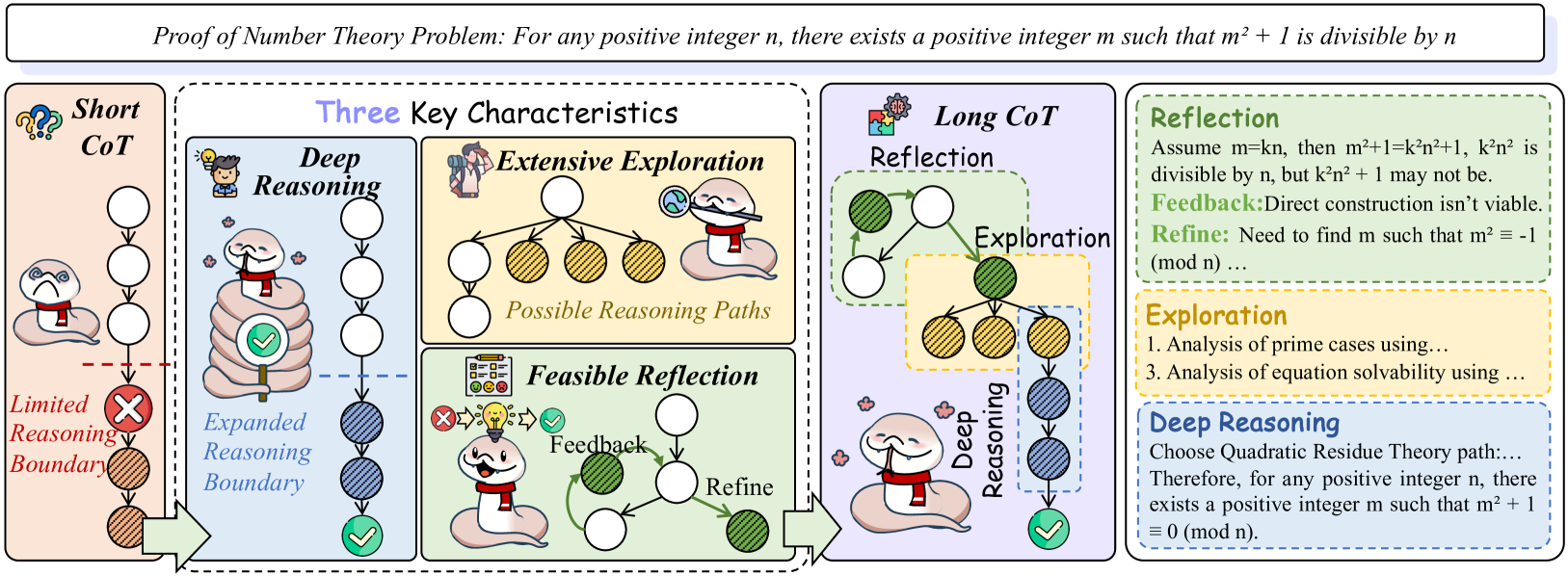

- 论文提出对长链思考(Long CoT)进行系统性分析,区分其与短链思考的差异,并总结其关键特征:深度推理、广泛探索和可行性反思。

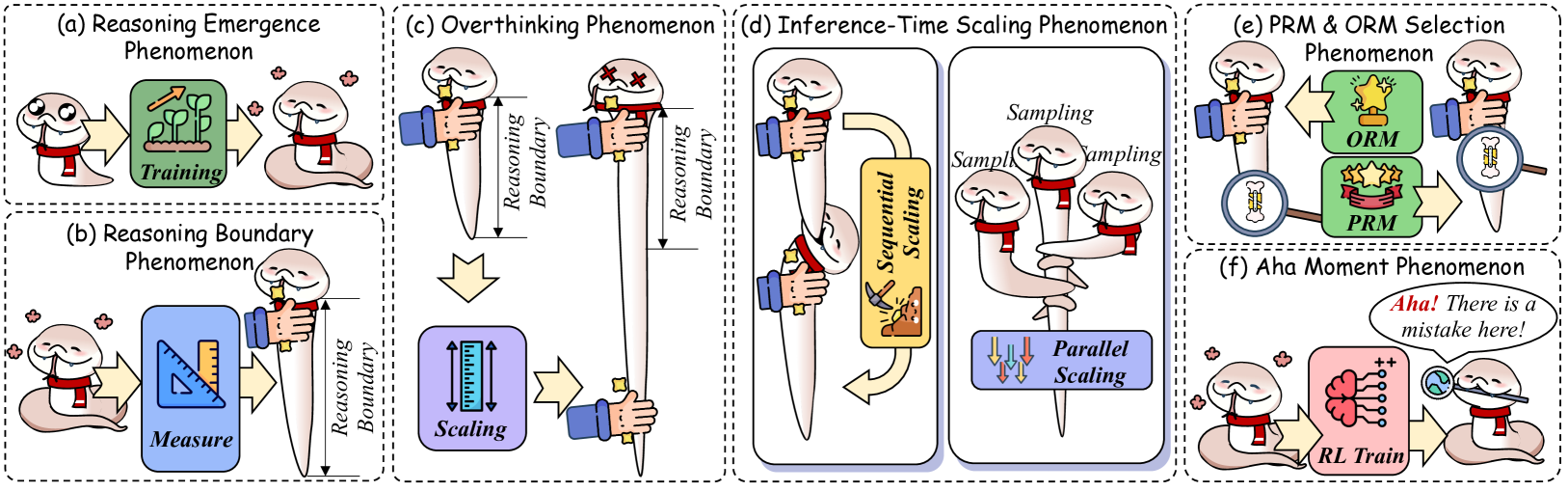

- 通过分析Long CoT的涌现现象,如过度思考和推理时缩放,为未来研究方向提供指导,包括多模态推理和效率提升。

📝 摘要(中文)

近年来,OpenAI-O1和DeepSeek-R1等推理大语言模型(RLLMs)在数学和编程等复杂领域展现出卓越能力。长链思考(Long CoT)是其成功的关键因素,它增强了推理能力并能解决复杂问题。然而,目前缺乏对Long CoT的全面综述,这限制了我们对其与传统短链思考(Short CoT)区别的理解,并使关于“过度思考”和“推理时缩放”等问题的讨论复杂化。本综述旨在填补这一空白,提供关于Long CoT的统一视角。(1) 我们首先区分Long CoT和Short CoT,并提出一种新的分类法来对当前的推理范式进行分类。(2) 其次,我们探讨Long CoT的关键特征:深度推理、广泛探索和可行性反思,这些特征使模型能够处理更复杂的任务,并产生比浅层的Short CoT更有效、更连贯的结果。(3) 然后,我们研究了Long CoT涌现的关键现象,包括过度思考和推理时缩放,从而深入了解这些过程在实践中的表现。(4) 最后,我们确定了重要的研究差距,并强调了有希望的未来方向,包括多模态推理的集成、效率改进和增强的知识框架。通过提供结构化的概述,本综述旨在激发未来的研究,并进一步发展人工智能中的逻辑推理。

🔬 方法详解

问题定义:现有的大语言模型在复杂推理任务中,特别是需要深度和多步骤推理的任务中,表现仍然存在不足。传统的短链思考(Short CoT)方法难以应对这些复杂场景,容易出现推理中断或错误。因此,如何提升大语言模型在复杂推理任务中的能力成为一个重要问题。

核心思路:论文的核心思路是对长链思考(Long CoT)进行深入研究,将其与短链思考(Short CoT)区分开来,并分析其关键特征。通过理解Long CoT的优势,可以更好地指导模型的设计和训练,从而提升其在复杂推理任务中的表现。

技术框架:论文构建了一个关于Long CoT的分类体系,并探讨了其关键特征,包括深度推理、广泛探索和可行性反思。此外,论文还分析了Long CoT的涌现现象,如过度思考和推理时缩放。整体框架旨在提供一个对Long CoT的全面理解,并为未来的研究方向提供指导。

关键创新:论文的主要创新在于对Long CoT的系统性分析和总结。通过区分Long CoT和Short CoT,并提出Long CoT的关键特征,论文为理解和应用Long CoT提供了新的视角。此外,对Long CoT涌现现象的分析也为未来的研究提供了重要的启示。

关键设计:论文并没有提出具体的模型或算法设计,而是一个综述性的研究。因此,没有涉及具体的参数设置、损失函数或网络结构等技术细节。论文的重点在于对Long CoT的理论分析和总结,为未来的模型设计和训练提供指导。

🖼️ 关键图片

📊 实验亮点

该论文是一篇综述性文章,主要贡献在于对长链思考(Long CoT)进行了系统性的分析和总结,区分了Long CoT和Short CoT,并提出了Long CoT的关键特征。虽然没有具体的实验数据,但该综述为未来的研究方向提供了重要的指导,例如多模态推理和效率提升。

🎯 应用场景

该研究成果可应用于需要复杂推理能力的各种场景,例如数学问题求解、代码生成、逻辑推理、医疗诊断等。通过提升大语言模型的推理能力,可以提高这些应用场景的效率和准确性,并为人工智能的发展带来更广阔的前景。

📄 摘要(原文)

Recent advancements in reasoning with large language models (RLLMs), such as OpenAI-O1 and DeepSeek-R1, have demonstrated their impressive capabilities in complex domains like mathematics and coding. A central factor in their success lies in the application of long chain-of-thought (Long CoT) characteristics, which enhance reasoning abilities and enable the solution of intricate problems. However, despite these developments, a comprehensive survey on Long CoT is still lacking, limiting our understanding of its distinctions from traditional short chain-of-thought (Short CoT) and complicating ongoing debates on issues like "overthinking" and "inference-time scaling." This survey seeks to fill this gap by offering a unified perspective on Long CoT. (1) We first distinguish Long CoT from Short CoT and introduce a novel taxonomy to categorize current reasoning paradigms. (2) Next, we explore the key characteristics of Long CoT: deep reasoning, extensive exploration, and feasible reflection, which enable models to handle more complex tasks and produce more efficient, coherent outcomes compared to the shallower Short CoT. (3) We then investigate key phenomena such as the emergence of Long CoT with these characteristics, including overthinking, and inference-time scaling, offering insights into how these processes manifest in practice. (4) Finally, we identify significant research gaps and highlight promising future directions, including the integration of multi-modal reasoning, efficiency improvements, and enhanced knowledge frameworks. By providing a structured overview, this survey aims to inspire future research and further the development of logical reasoning in artificial intelligence.