Effective and Efficient Jailbreaks of Black-Box LLMs with Cross-Behavior Attacks

作者: Vasudev Gohil

分类: cs.CR, cs.AI, cs.CL

发布日期: 2025-03-12 (更新: 2025-12-31)

备注: Code is at https://github.com/gohil-vasudev/JCB

💡 一句话要点

提出JCB:一种高效的黑盒LLM越狱方法,利用跨行为攻击提升攻击效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 越狱攻击 黑盒攻击 跨行为攻击 安全漏洞 红队测试 提示工程

📋 核心要点

- 现有LLM红队方法在越狱攻击中面临成功率低、计算成本高的挑战,难以高效发现有效的越狱提示。

- JCB方法通过跨行为攻击,利用过去成功越狱的经验来提升新行为的越狱效率,无需依赖辅助LLM进行提示优化。

- 实验结果表明,JCB在显著减少查询次数的同时,提高了攻击成功率,并在Llama-2-7B等模型上表现出优异的性能。

📝 摘要(中文)

大型语言模型(LLM)虽然取得了显著进展,但仍然存在越狱风险,即可能被诱导出有害和有毒内容。现有的红队方法在发现这些漏洞方面取得了一些进展,但成功率有限,且计算和经济成本高昂。为了解决这个问题,我们提出了一种名为JCB的黑盒越狱方法,它利用跨行为攻击自动且高效地找到成功的越狱提示。JCB利用过去行为的成功经验来帮助越狱新的行为,从而显著提高攻击效率。此外,JCB不依赖于耗时和/或成本高昂的辅助LLM调用来发现/优化越狱提示,使其具有很高的效率和可扩展性。全面的实验评估表明,JCB明显优于相关基线,查询次数减少高达94%,同时平均攻击成功率提高12.9%。JCB在Llama-2-7B上实现了高达37%的攻击成功率,Llama-2-7B是最具弹性的LLM之一,并且在不同的LLM之间表现出良好的零样本迁移能力。

🔬 方法详解

问题定义:论文旨在解决黑盒场景下,高效越狱大型语言模型(LLMs)的问题。现有方法,如基于梯度的方法,无法应用于黑盒模型。而基于搜索的方法,例如遗传算法,通常需要大量的查询才能找到有效的越狱提示,计算成本高昂,效率低下。

核心思路:论文的核心思路是利用“跨行为攻击”的思想。即,如果一个提示成功地诱导LLM产生了某种有害行为,那么这个提示很可能经过一定的修改后,也能诱导LLM产生其他类似的有害行为。通过复用和迁移已知的成功越狱经验,可以显著减少搜索空间,提高越狱效率。

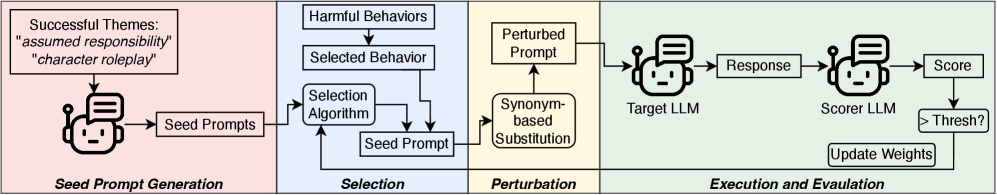

技术框架:JCB方法的整体框架包含以下几个主要阶段: 1. 行为定义:定义一系列需要攻击的有害行为。 2. 初始提示生成:为每个行为生成一组初始提示。 3. 跨行为攻击:对于每个行为,利用其他行为的成功越狱提示进行变异和组合,生成新的提示。 4. 提示评估:使用黑盒LLM评估每个提示的有效性。 5. 迭代优化:重复步骤3和4,直到达到预定的攻击成功率或查询次数上限。

关键创新:JCB的关键创新在于其跨行为攻击策略。与传统的独立搜索每个行为的越狱提示的方法不同,JCB通过共享和迁移不同行为的成功经验,显著提高了攻击效率。此外,JCB不需要调用额外的LLM进行提示优化,进一步降低了计算成本。

关键设计:论文中没有详细描述具体的参数设置或损失函数,因为这是一个黑盒攻击方法,不依赖于模型的内部信息。关键的设计在于如何有效地变异和组合已知的成功越狱提示,以生成新的提示。具体的变异策略和组合方法可能包括: * 关键词替换:将提示中的关键词替换为与目标行为相关的其他关键词。 * 句子重组:重新排列提示中的句子顺序。 * 添加/删除句子:在提示中添加或删除一些句子。 * 提示融合:将来自不同行为的成功提示融合在一起。

🖼️ 关键图片

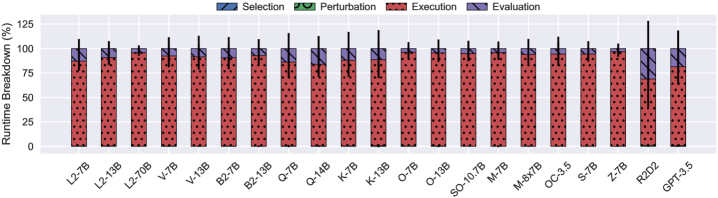

📊 实验亮点

JCB方法在实验中表现出显著的优势,相较于基线方法,查询次数减少高达94%,同时平均攻击成功率提高12.9%。在Llama-2-7B这一具有较强防御能力的LLM上,JCB也实现了37%的攻击成功率。此外,JCB还展现出良好的零样本迁移能力,即在一个LLM上训练的越狱提示可以成功地应用于其他LLM。

🎯 应用场景

该研究成果可应用于提升LLM的安全性和鲁棒性,帮助开发者和安全研究人员更有效地发现和修复LLM中的安全漏洞。通过自动化越狱测试,可以更全面地评估LLM的潜在风险,并指导模型的安全对齐工作,降低LLM被恶意利用的风险。此外,该方法也可以用于评估不同LLM的安全性能,为用户选择更安全的LLM提供参考。

📄 摘要(原文)

Despite recent advancements in Large Language Models (LLMs) and their alignment, they can still be jailbroken, i.e., harmful and toxic content can be elicited from them. While existing red-teaming methods have shown promise in uncovering such vulnerabilities, these methods struggle with limited success and high computational and monetary costs. To address this, we propose a black-box Jailbreak method with Cross-Behavior attacks (JCB), that can automatically and efficiently find successful jailbreak prompts. JCB leverages successes from past behaviors to help jailbreak new behaviors, thereby significantly improving the attack efficiency. Moreover, JCB does not rely on time- and/or cost-intensive calls to auxiliary LLMs to discover/optimize the jailbreak prompts, making it highly efficient and scalable. Comprehensive experimental evaluations show that JCB significantly outperforms related baselines, requiring up to 94% fewer queries while still achieving 12.9% higher average attack success. JCB also achieves a notably high 37% attack success rate on Llama-2-7B, one of the most resilient LLMs, and shows promising zero-shot transferability across different LLMs.