Static Program Analysis Guided LLM Based Unit Test Generation

作者: Sujoy Roychowdhury, Giriprasad Sridhara, A K Raghavan, Joy Bose, Sourav Mazumdar, Hamender Singh, Srinivasan Bajji Sugumaran, Ricardo Britto

分类: cs.SE, cs.AI

发布日期: 2025-03-07

💡 一句话要点

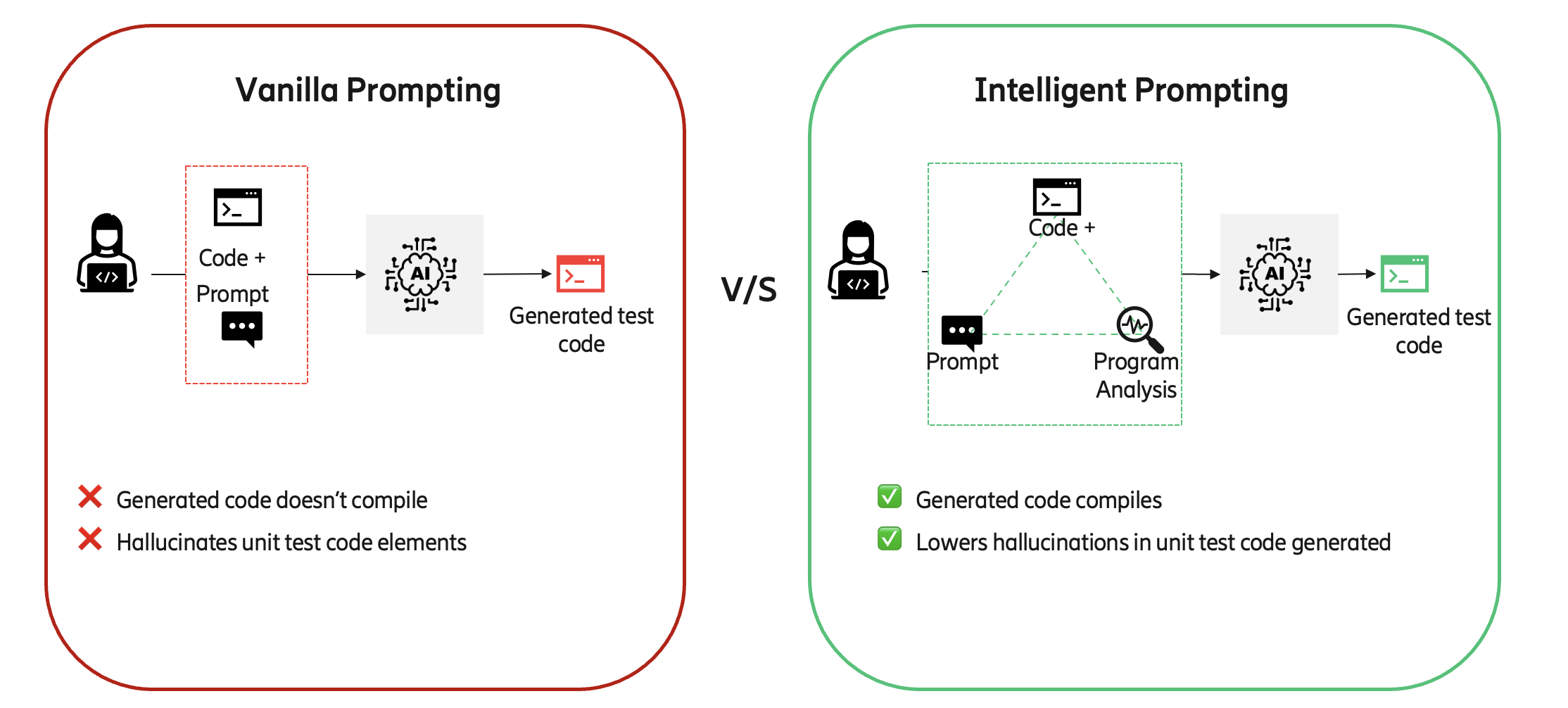

提出静态程序分析引导的LLM单元测试生成方法,提升测试代码质量。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 单元测试生成 大型语言模型 静态程序分析 软件测试 自动化测试

📋 核心要点

- 现有LLM单元测试生成方法依赖示例用法或完整类,面临缺乏示例和可扩展性问题。

- 利用静态程序分析提取简洁精确的上下文信息,增强LLM的提示,提升测试代码生成效果。

- 在大型商业和开源Java项目上的验证表明,该方法能够有效提升单元测试代码的质量。

📝 摘要(中文)

本文提出了一种新颖的方法,利用大型语言模型(LLM)自动生成Java方法的单元测试。现有的基于LLM的方法依赖于被测方法(焦点方法)的示例用法,或者将焦点方法的整个类作为输入提示和上下文。前一种方法通常由于缺乏示例用法而不可行,尤其对于新编写的焦点方法。后一种方法的可扩展性不足;焦点方法的复杂性越高,关联类越大,生成足够的测试代码就越困难(由于超出底层LLM的提示和上下文长度等因素)。我们证明,通过程序分析获得的简洁和精确的上下文信息来增强提示,可以提高通过LLM生成单元测试代码的有效性。我们在一个大型商业Java项目和一个流行的开源Java项目上验证了我们的方法。

🔬 方法详解

问题定义:现有基于LLM的单元测试生成方法存在局限性。依赖示例用法的方法在新方法上不可行,而直接输入整个类的方法则面临可扩展性问题,因为大型复杂类容易超出LLM的上下文长度限制,导致生成的测试代码质量下降。

核心思路:论文的核心思路是通过静态程序分析提取被测方法(焦点方法)的关键上下文信息,并将其作为提示的一部分输入LLM。这种方法旨在提供LLM生成测试代码所需的必要信息,同时避免输入过多冗余信息,从而提高生成效率和测试代码质量。

技术框架:该方法包含以下几个主要步骤:1) 对焦点方法进行静态程序分析,提取关键上下文信息,例如方法签名、参数类型、返回值类型、依赖关系等。2) 将提取的上下文信息与自然语言提示相结合,构建LLM的输入提示。3) 使用LLM生成单元测试代码。4) 对生成的测试代码进行评估和验证。

关键创新:该方法最重要的创新点在于利用静态程序分析来指导LLM的单元测试生成过程。与现有方法相比,该方法能够更有效地利用LLM的能力,生成更准确、更全面的单元测试代码。通过程序分析提取的上下文信息能够帮助LLM更好地理解被测方法的行为,从而生成更有效的测试用例。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构,因为该方法主要关注如何利用静态程序分析来增强LLM的提示。关键设计在于如何选择合适的静态程序分析技术,以及如何将分析结果有效地融入到LLM的提示中。具体实现可能涉及使用现有的静态分析工具,并设计合适的提示模板。

🖼️ 关键图片

📊 实验亮点

论文在一个大型商业Java项目和一个流行的开源Java项目上验证了该方法。实验结果表明,通过静态程序分析增强LLM的提示,能够显著提高生成的单元测试代码的质量,例如覆盖率、代码正确性等方面。具体的性能数据和提升幅度在摘要中未明确给出,需要在论文正文中查找。

🎯 应用场景

该研究成果可应用于软件开发过程中的自动化单元测试生成,提高测试效率,降低测试成本,并提升软件质量。尤其适用于大型复杂Java项目的单元测试,能够有效解决现有方法的可扩展性问题。未来可扩展到其他编程语言和测试类型。

📄 摘要(原文)

We describe a novel approach to automating unit test generation for Java methods using large language models (LLMs). Existing LLM-based approaches rely on sample usage(s) of the method to test (focal method) and/or provide the entire class of the focal method as input prompt and context. The former approach is often not viable due to the lack of sample usages, especially for newly written focal methods. The latter approach does not scale well enough; the bigger the complexity of the focal method and larger associated class, the harder it is to produce adequate test code (due to factors such as exceeding the prompt and context lengths of the underlying LLM). We show that augmenting prompts with \emph{concise} and \emph{precise} context information obtained by program analysis %of the focal method increases the effectiveness of generating unit test code through LLMs. We validate our approach on a large commercial Java project and a popular open-source Java project.