Ontology Generation using Large Language Models

作者: Anna Sofia Lippolis, Mohammad Javad Saeedizade, Robin Keskisärkkä, Sara Zuppiroli, Miguel Ceriani, Aldo Gangemi, Eva Blomqvist, Andrea Giovanni Nuzzolese

分类: cs.AI

发布日期: 2025-03-07

备注: 2 figures and 3 tables. 20 pages

💡 一句话要点

提出两种Prompting方法,利用大语言模型自动生成高质量OWL本体

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 本体生成 Prompting技术 OWL本体 知识图谱

📋 核心要点

- 本体工程复杂且易错,现有方法难以高效生成高质量本体,限制了知识图谱构建和应用。

- 提出Memoryless CQbyCQ和Ontogenia两种Prompting技术,指导LLM从用户故事和能力问题生成本体。

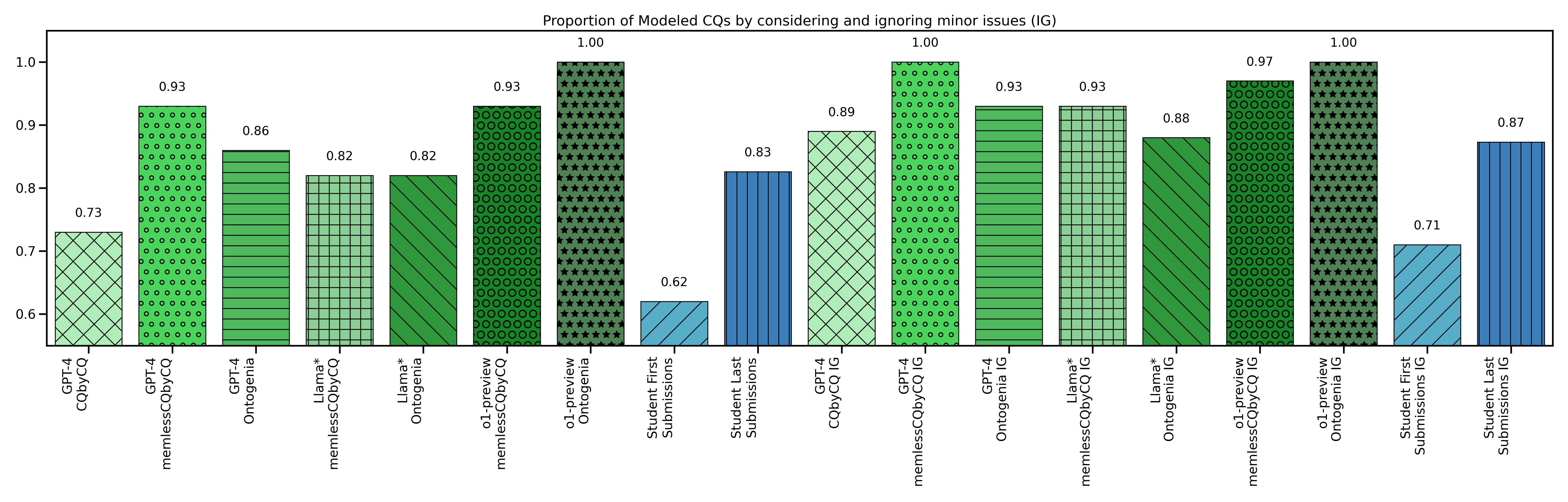

- 实验表明,使用Ontogenia的OpenAI o1-preview模型性能显著提升,建模能力优于新手本体工程师。

📝 摘要(中文)

本体工程是一个复杂、耗时且容易出错的过程,即使对于经验丰富的本体工程师也是如此。本文探讨了大型语言模型(LLM)直接从用户故事和能力问题描述的本体需求中生成有效的OWL本体草案的潜力。我们的主要贡献是提出并评估了两种用于自动本体开发的新Prompting技术:Memoryless CQbyCQ和Ontogenia。我们还强调了本体评估的三个结构标准的重要性,以及专家的定性评估,突出了多维度评估对于捕捉生成本体的质量和可用性的必要性。我们的实验在一个包含十个本体、100个不同的CQ和29个不同的用户故事的基准数据集上进行,比较了三种LLM使用两种Prompting技术的性能。结果表明,与当前LLM支持的本体工程技术相比,性能有所提高。更具体地说,使用Ontogenia的OpenAI o1-preview模型生成的本体质量足以满足本体工程师的需求,在建模能力方面明显优于新手本体工程师。然而,我们仍然注意到一些常见的错误和结果质量的可变性,在使用LLM进行本体创作支持时,需要考虑到这一点。我们讨论了这些局限性,并提出了未来研究的方向。

🔬 方法详解

问题定义:论文旨在解决本体工程中本体构建效率低、易出错的问题。现有本体构建方法依赖于人工,耗时耗力,且对本体工程师的专业知识要求高。利用LLM自动生成本体面临挑战,例如如何有效地引导LLM理解本体需求并生成符合规范的本体结构。

核心思路:论文的核心思路是利用Prompting技术,将本体需求(用户故事和能力问题)转化为LLM能够理解的指令,从而引导LLM生成高质量的OWL本体。通过精心设计的Prompt,可以控制LLM的输出,使其更符合本体工程的要求。

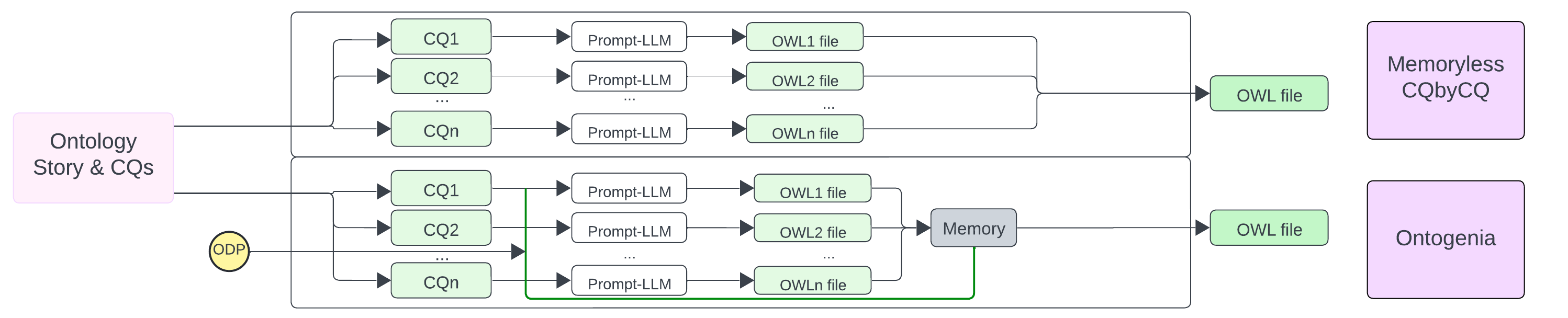

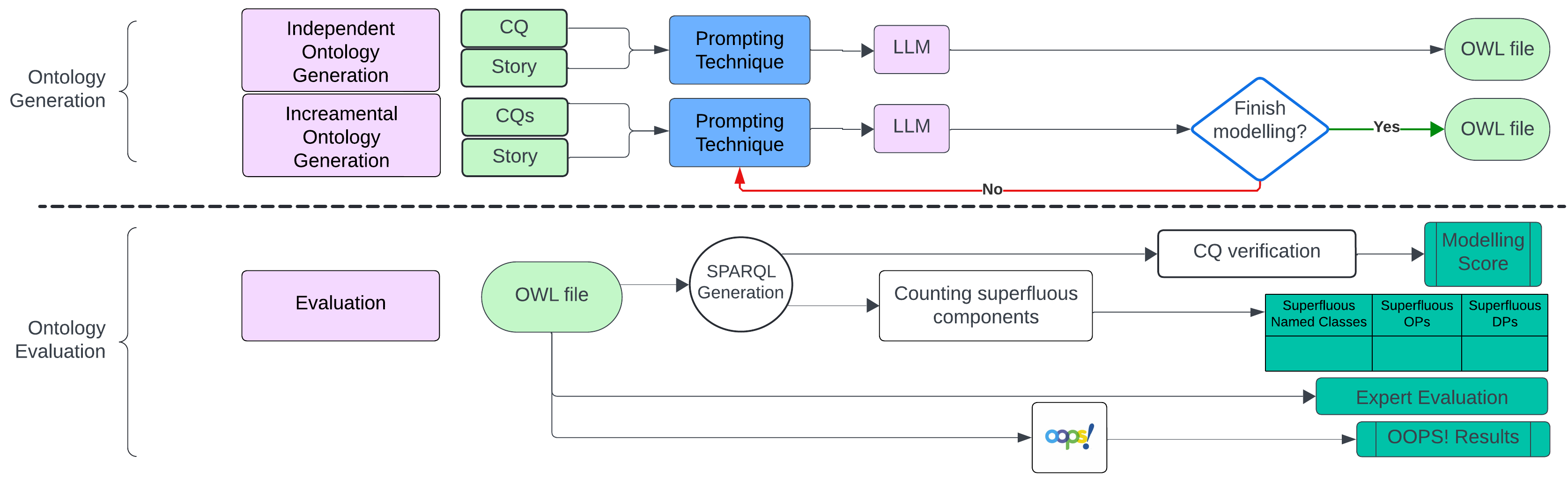

技术框架:论文提出了两种Prompting技术:Memoryless CQbyCQ和Ontogenia。Memoryless CQbyCQ 是一种基于能力问题(CQ)的逐个生成方法,每个CQ都被独立地用于生成本体的一部分。Ontogenia 是一种更全面的方法,它结合了用户故事和能力问题,并使用更复杂的Prompt来指导LLM生成完整的本体。整体流程包括:1) 定义本体需求(用户故事和能力问题);2) 使用Prompting技术将需求转化为LLM的输入;3) LLM生成OWL本体;4) 评估生成的本体的质量。

关键创新:论文的关键创新在于提出了两种新的Prompting技术,特别是Ontogenia,它能够更有效地引导LLM生成高质量的OWL本体。与现有方法相比,Ontogenia能够更好地利用用户故事和能力问题的信息,生成更完整、更符合需求的本体。

关键设计:论文的关键设计包括Prompt的具体内容和结构。Ontogenia的Prompt设计考虑了用户故事和能力问题的语义信息,并使用了特定的关键词和指令来引导LLM生成本体的概念、属性和关系。此外,论文还强调了本体评估的重要性,并提出了三个结构标准用于评估生成本体的质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用Ontogenia的OpenAI o1-preview模型生成的本体质量显著提升,在建模能力方面明显优于新手本体工程师。该模型在满足本体工程师的需求方面表现出色,表明LLM在本体工程领域具有巨大的潜力。与现有LLM支持的本体工程技术相比,性能有所提高。

🎯 应用场景

该研究成果可应用于知识图谱构建、语义搜索、智能问答等领域。通过自动生成本体,可以降低本体构建的成本和门槛,加速知识图谱的构建和应用。未来,该技术有望应用于更广泛的领域,例如医疗、金融、教育等,为各行业提供更智能化的服务。

📄 摘要(原文)

The ontology engineering process is complex, time-consuming, and error-prone, even for experienced ontology engineers. In this work, we investigate the potential of Large Language Models (LLMs) to provide effective OWL ontology drafts directly from ontological requirements described using user stories and competency questions. Our main contribution is the presentation and evaluation of two new prompting techniques for automated ontology development: Memoryless CQbyCQ and Ontogenia. We also emphasize the importance of three structural criteria for ontology assessment, alongside expert qualitative evaluation, highlighting the need for a multi-dimensional evaluation in order to capture the quality and usability of the generated ontologies. Our experiments, conducted on a benchmark dataset of ten ontologies with 100 distinct CQs and 29 different user stories, compare the performance of three LLMs using the two prompting techniques. The results demonstrate improvements over the current state-of-the-art in LLM-supported ontology engineering. More specifically, the model OpenAI o1-preview with Ontogenia produces ontologies of sufficient quality to meet the requirements of ontology engineers, significantly outperforming novice ontology engineers in modelling ability. However, we still note some common mistakes and variability of result quality, which is important to take into account when using LLMs for ontology authoring support. We discuss these limitations and propose directions for future research.