LLM Applications: Current Paradigms and the Next Frontier

作者: Xinyi Hou, Yanjie Zhao, Haoyu Wang

分类: cs.SE, cs.AI

发布日期: 2025-03-06 (更新: 2025-10-09)

💡 一句话要点

综述LLM应用范式,提出分层架构以应对碎片化、安全和扩展性挑战

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 LLM应用 分层架构 协议层 互操作性 安全 可扩展性 应用生态系统

📋 核心要点

- 现有LLM应用范式存在碎片化问题,包括平台锁定、通信机制缺失、部署复杂和硬件限制等。

- 论文提出一种分层架构,包含基础设施层、协议层和应用层,旨在解决现有范式的局限性,提升安全性和可扩展性。

- 论文分析了未来挑战,并提出了基于协议驱动的跨平台协作和设备集成的研究路线图,以实现开放、安全和可持续的LLM应用。

📝 摘要(中文)

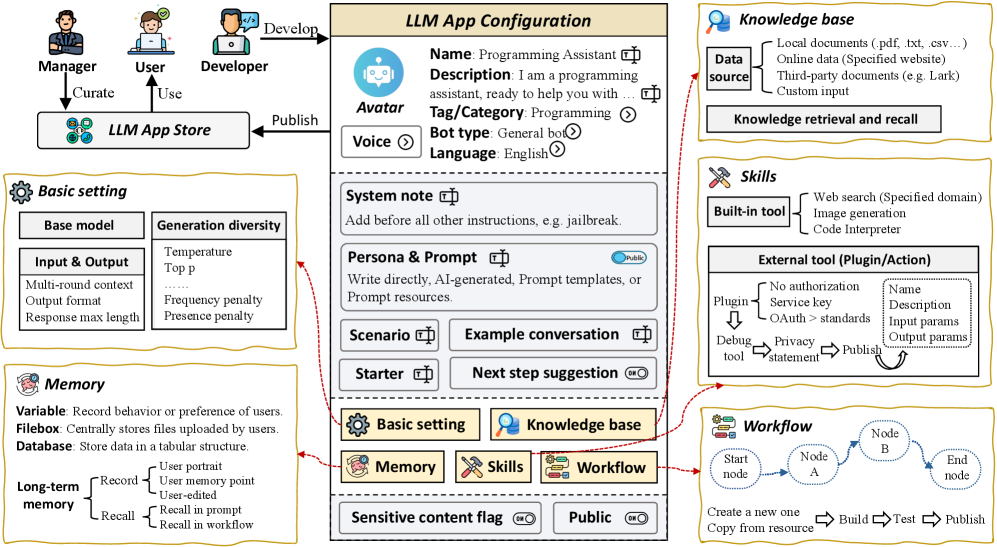

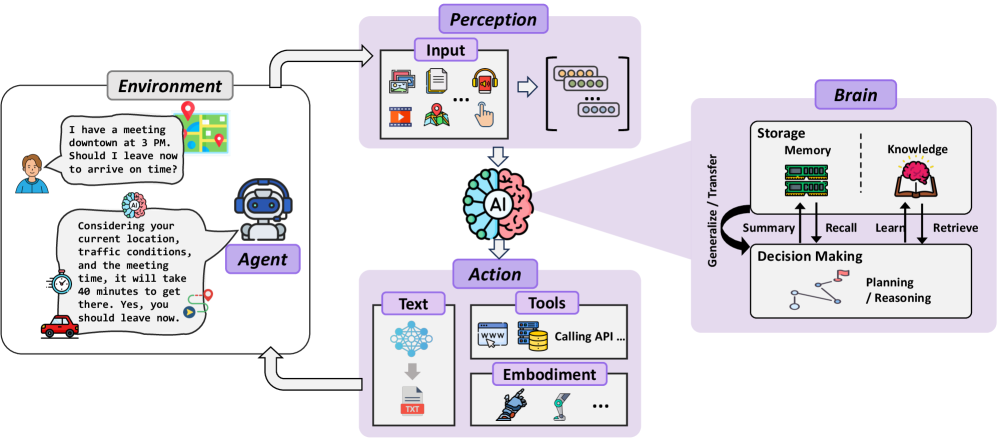

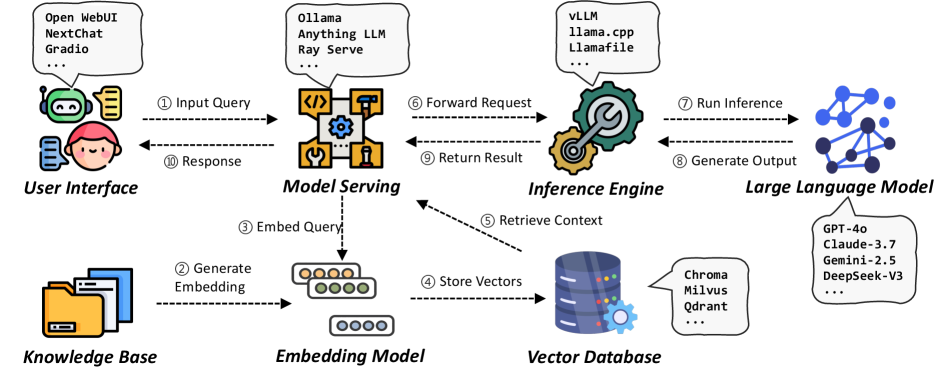

大型语言模型(LLM)的发展催生了四种主要的应用范式:LLM应用商店、LLM代理、自托管LLM服务和LLM驱动的设备。每种范式都有其优势,但也面临着共同的挑战。LLM应用商店降低了开发门槛,但导致平台锁定;LLM代理提供了自主性,但缺乏统一的通信机制;自托管LLM服务增强了控制,但增加了部署复杂性;LLM驱动的设备提高了隐私和实时性能,但受到硬件的限制。本文回顾并分析了这些范式,涵盖了架构设计、应用生态系统、研究进展以及它们面临的挑战和开放问题。在此基础上,我们概述了LLM应用的下一个前沿,通过基础设施、协议和应用这三个相互关联的层对其进行描述。我们描述了每一层的职责和作用,并展示了如何缓解现有的碎片化限制,提高安全性和可扩展性。最后,我们讨论了关键的未来挑战,识别了诸如协议驱动的跨平台协作和设备集成等机会,并提出了一个开放、安全和可持续的研究路线图。

🔬 方法详解

问题定义:现有LLM应用范式,如LLM应用商店、LLM代理、自托管LLM服务和LLM驱动的设备,虽然各有优势,但也存在共性问题。例如,LLM应用商店存在平台锁定问题,LLM代理缺乏统一的通信机制,自托管LLM服务部署复杂,LLM驱动的设备受限于硬件性能。这些问题导致LLM应用生态系统碎片化,阻碍了其进一步发展。

核心思路:论文的核心思路是通过构建一个分层架构来解决LLM应用生态系统的碎片化问题。该架构包含基础设施层、协议层和应用层。基础设施层提供底层算力支持,协议层负责定义统一的通信标准,应用层则构建各种LLM应用。通过分层解耦,可以降低各层之间的依赖性,提高系统的灵活性和可扩展性。

技术框架:该架构包含三个主要层: 1. 基础设施层:提供LLM模型训练和推理所需的算力资源,包括GPU集群、存储系统等。 2. 协议层:定义LLM应用之间的通信协议,例如数据格式、API接口等。该层旨在实现不同LLM应用之间的互操作性。 3. 应用层:构建各种基于LLM的应用,例如聊天机器人、文本生成工具、智能助手等。

关键创新:该论文的关键创新在于提出了一个分层架构来解决LLM应用生态系统的碎片化问题。通过引入协议层,实现了不同LLM应用之间的互操作性,降低了开发和部署的复杂性。此外,该架构还考虑了安全性和可扩展性,为LLM应用的未来发展奠定了基础。

关键设计:协议层是该架构的关键。协议层需要定义一套统一的通信标准,包括数据格式、API接口、安全机制等。协议的设计需要考虑到不同LLM应用的特点,例如数据类型、计算需求等。此外,协议还需要支持动态扩展,以适应未来LLM技术的发展。

🖼️ 关键图片

📊 实验亮点

该论文提出了一个分层架构,旨在解决LLM应用生态系统的碎片化问题,并提升安全性和可扩展性。虽然论文没有提供具体的实验数据,但其提出的分层架构为LLM应用的未来发展提供了一个新的方向,具有重要的理论和实践意义。该架构通过引入协议层,实现了不同LLM应用之间的互操作性,降低了开发和部署的复杂性。

🎯 应用场景

该研究成果可应用于构建更加开放、安全和可扩展的LLM应用生态系统。例如,可以基于该架构开发跨平台的LLM应用,实现不同设备之间的互联互通。此外,该研究还可以促进LLM技术在各个领域的应用,例如智能客服、智能家居、自动驾驶等。

📄 摘要(原文)

The development of large language models (LLMs) has given rise to four major application paradigms: LLM app stores, LLM agents, self-hosted LLM services, and LLM-powered devices. Each has its advantages but also shares common challenges. LLM app stores lower the barrier to development but lead to platform lock-in; LLM agents provide autonomy but lack a unified communication mechanism; self-hosted LLM services enhance control but increase deployment complexity; and LLM-powered devices improve privacy and real-time performance but are limited by hardware. This paper reviews and analyzes these paradigms, covering architecture design, application ecosystem, research progress, as well as the challenges and open problems they face. Based on this, we outline the next frontier of LLM applications, characterizing them through three interconnected layers: infrastructure, protocol, and application. We describe their responsibilities and roles of each layer and demonstrate how to mitigate existing fragmentation limitations and improve security and scalability. Finally, we discuss key future challenges, identify opportunities such as protocol-driven cross-platform collaboration and device integration, and propose a research roadmap for openness, security, and sustainability.