Societal Alignment Frameworks Can Improve LLM Alignment

作者: Karolina Stańczak, Nicholas Meade, Mehar Bhatia, Hattie Zhou, Konstantin Böttinger, Jeremy Barnes, Jason Stanley, Jessica Montgomery, Richard Zemel, Nicolas Papernot, Nicolas Chapados, Denis Therien, Timothy P. Lillicrap, Ana Marasović, Sylvie Delacroix, Gillian K. Hadfield, Siva Reddy

分类: cs.CY, cs.AI, cs.CL

发布日期: 2025-02-27

💡 一句话要点

引入社会对齐框架以提升大型语言模型的对齐效果

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 对齐 社会对齐框架 价值观 不确定性 参与式设计 伦理 社会规范

📋 核心要点

- 当前LLM对齐方法未能充分捕捉人类价值观的复杂性,导致目标不明确和不完整契约问题。

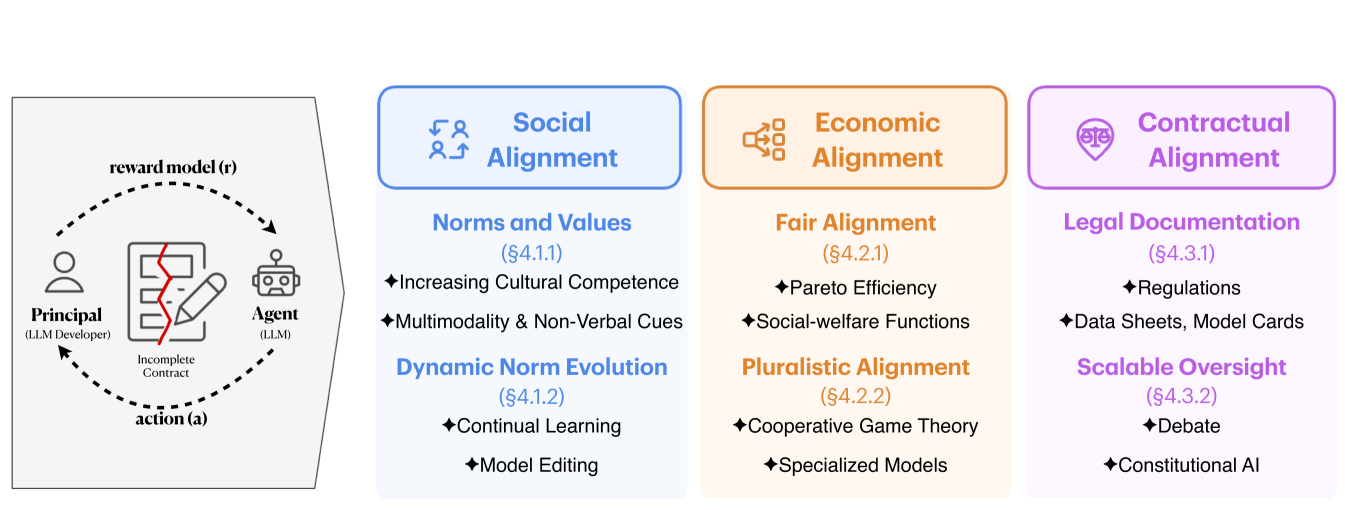

- 论文提出将社会对齐框架(包括社会、经济和契约对齐)的见解融入LLM对齐,以应对上述挑战。

- 论文探讨了不确定性在LLM对齐中的表现,并强调了参与式对齐界面设计的重要性。

📝 摘要(中文)

大型语言模型(LLM)的最新进展主要集中在生成符合人类期望并与共同价值观对齐的响应,这一过程被称为对齐。然而,由于人类价值观的复杂性与旨在解决这些问题的技术方法的狭隘性之间存在固有的脱节,LLM的对齐仍然具有挑战性。当前的对齐方法通常导致目标设定不明确,反映了不完整契约这一更广泛的问题,即模型开发者与模型之间指定一个涵盖LLM对齐中每个场景的契约是不切实际的。在本文中,我们认为改进LLM对齐需要结合来自社会对齐框架的见解,包括社会、经济和契约对齐,并讨论了来自这些领域的潜在解决方案。鉴于不确定性在社会对齐框架中的作用,我们随后研究了它在LLM对齐中的表现。最后,我们通过提供关于LLM对齐的替代观点来结束我们的讨论,将目标的不明确性视为机会,而不是完美地指定它们。除了LLM对齐的技术改进之外,我们还讨论了参与式对齐界面设计的必要性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)对齐过程中目标不明确、无法完全捕捉人类价值观的问题。现有方法往往依赖于狭隘的技术手段,导致模型行为与社会期望不符,存在不完整契约的风险,即无法预先定义所有可能场景下的模型行为准则。

核心思路:论文的核心思路是将社会对齐框架的理论和方法引入LLM对齐。社会对齐框架涵盖社会、经济和契约等多个维度,能够更全面地考虑人类价值观和社会规范,从而指导LLM的训练和行为。通过借鉴社会科学的理论,可以更好地理解和处理LLM对齐中的不确定性和复杂性。

技术框架:论文并没有提出一个具体的、可直接实现的算法框架,而是提供了一个概念框架,指导LLM对齐的研究方向。该框架强调以下几个方面:1) 借鉴社会对齐框架的理论,例如社会契约论、经济激励机制等;2) 关注LLM对齐中的不确定性,并设计相应的应对策略;3) 强调参与式对齐界面设计,允许用户参与到LLM的对齐过程中。

关键创新:论文的关键创新在于将LLM对齐问题置于更广阔的社会背景下进行思考,并提出了社会对齐框架这一新的视角。这与以往主要关注技术细节的LLM对齐研究形成了鲜明对比。论文强调,LLM对齐不仅仅是一个技术问题,更是一个社会问题,需要综合考虑伦理、法律、经济等多个因素。

关键设计:论文没有提供具体的算法或模型设计细节。其主要贡献在于提出了一个概念框架,指导未来的研究方向。未来的研究可以借鉴社会对齐框架的理论,设计新的损失函数、训练方法和评估指标,以提升LLM的对齐效果。

🖼️ 关键图片

📊 实验亮点

该论文属于理论性文章,没有提供具体的实验结果。其主要贡献在于提出了一个新颖的视角,即利用社会对齐框架来提升LLM的对齐效果。论文强调了LLM对齐的复杂性和挑战性,并呼吁研究者们从更广阔的社会背景下思考LLM对齐问题。

🎯 应用场景

该研究成果可应用于各种需要与人类价值观对齐的LLM应用场景,例如智能客服、内容生成、教育辅导等。通过提升LLM的对齐效果,可以减少模型产生有害或不当内容的风险,提高用户满意度,并促进LLM在社会中的广泛应用。未来的研究可以进一步探索社会对齐框架在LLM对齐中的具体应用方法,并开发相应的工具和平台。

📄 摘要(原文)

Recent progress in large language models (LLMs) has focused on producing responses that meet human expectations and align with shared values - a process coined alignment. However, aligning LLMs remains challenging due to the inherent disconnect between the complexity of human values and the narrow nature of the technological approaches designed to address them. Current alignment methods often lead to misspecified objectives, reflecting the broader issue of incomplete contracts, the impracticality of specifying a contract between a model developer, and the model that accounts for every scenario in LLM alignment. In this paper, we argue that improving LLM alignment requires incorporating insights from societal alignment frameworks, including social, economic, and contractual alignment, and discuss potential solutions drawn from these domains. Given the role of uncertainty within societal alignment frameworks, we then investigate how it manifests in LLM alignment. We end our discussion by offering an alternative view on LLM alignment, framing the underspecified nature of its objectives as an opportunity rather than perfect their specification. Beyond technical improvements in LLM alignment, we discuss the need for participatory alignment interface designs.