Simulation of Language Evolution under Regulated Social Media Platforms: A Synergistic Approach of Large Language Models and Genetic Algorithms

作者: Jinyu Cai, Yusei Ishimizu, Mingyue Zhang, Munan Li, Jialong Li, Kenji Tei

分类: cs.SI, cs.AI, cs.NE

发布日期: 2025-02-26

备注: The manuscript has been submitted to IEEE Transactions on Computational Social Systems

💡 一句话要点

提出基于LLM和遗传算法的框架,模拟社交媒体监管下的语言进化。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言演化 大型语言模型 遗传算法 社交媒体监管 内容审核

📋 核心要点

- 社交媒体平台的内容审核策略促使用户产生规避监管的语言策略,现有方法难以有效模拟这种动态演化过程。

- 论文提出一种基于LLM驱动的遗传算法框架,模拟用户和监管者之间的语言博弈,从而研究语言策略的演化。

- 实验表明,该框架能有效提升对话的流畅性和信息传递的准确性,用户研究也验证了生成对话的真实性。

📝 摘要(中文)

本文提出了一种基于大型语言模型(LLM)的多智能体框架,用于模拟监管约束下语言策略的迭代演化。在该框架中,参与者智能体作为社交媒体用户,不断演化其语言表达,而监管者智能体通过评估策略违规来模拟平台级监管。为了实现更真实的模拟,我们采用语言策略(约束和表达)的双重设计来区分冲突目标,并利用LLM驱动的遗传算法(GA)进行语言策略的选择、变异和交叉。该框架在两个不同的场景中进行了评估:一个抽象的密码游戏和一个真实的模拟非法宠物交易场景。实验结果表明,随着对话轮数的增加,不间断对话轮数和信息传输的准确性都显著提高。此外,一项包含40名参与者的用户研究验证了生成对话和策略的真实世界相关性。消融研究验证了GA的重要性,强调了其对长期适应性和改善整体结果的贡献。

🔬 方法详解

问题定义:社交媒体平台的内容审核策略与用户规避策略之间的对抗是一个动态演化过程。现有方法难以捕捉这种演化的复杂性,尤其是在模拟用户创造性地规避审查方面存在不足。论文旨在模拟这种语言演化过程,研究在监管约束下,用户如何调整语言策略以传递信息。

核心思路:论文的核心思路是将语言演化建模为一个多智能体博弈过程,其中用户智能体试图传递信息,而监管者智能体试图检测违规行为。通过让这些智能体在LLM的驱动下进行交互,并利用遗传算法来优化语言策略,从而模拟语言的演化过程。这种设计允许智能体学习和适应彼此的策略,从而产生更真实和动态的语言演化。

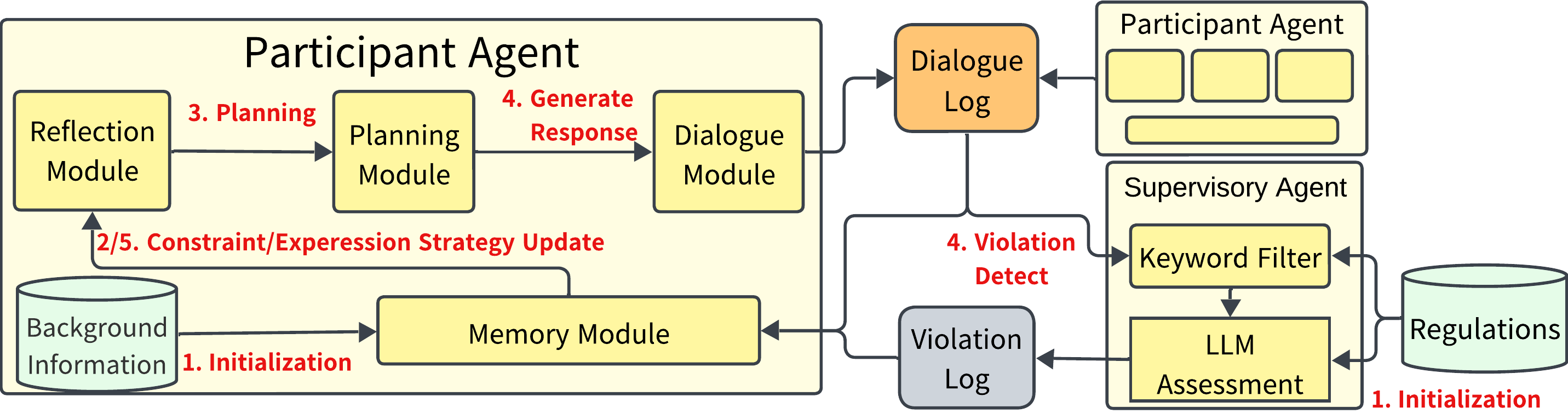

技术框架:该框架包含以下主要模块:1) 用户智能体:负责生成和演化表达策略,目标是传递信息。2) 监管者智能体:负责评估用户智能体的表达,判断是否违反平台政策。3) LLM驱动的遗传算法:用于选择、变异和交叉用户智能体的语言策略,从而实现策略的迭代演化。4) 评估模块:用于评估对话的质量和信息传递的准确性。

关键创新:该论文的关键创新在于:1) 提出了一个基于LLM和遗传算法的框架,用于模拟社交媒体监管下的语言演化。2) 采用了语言策略的双重设计(约束和表达),区分了冲突的目标。3) 利用LLM驱动的遗传算法来优化语言策略,从而实现更有效的策略演化。与现有方法相比,该方法能够更好地捕捉语言演化的动态性和复杂性。

关键设计:在遗传算法中,适应度函数的设计至关重要,它需要平衡信息传递的准确性和规避监管的成功率。论文可能采用了加权平均的方式来结合这两个目标。此外,LLM的选择和prompt的设计也会影响生成语言的质量和多样性。具体的参数设置(如遗传算法的种群大小、变异率、交叉率)需要根据实验结果进行调整。

🖼️ 关键图片

📊 实验亮点

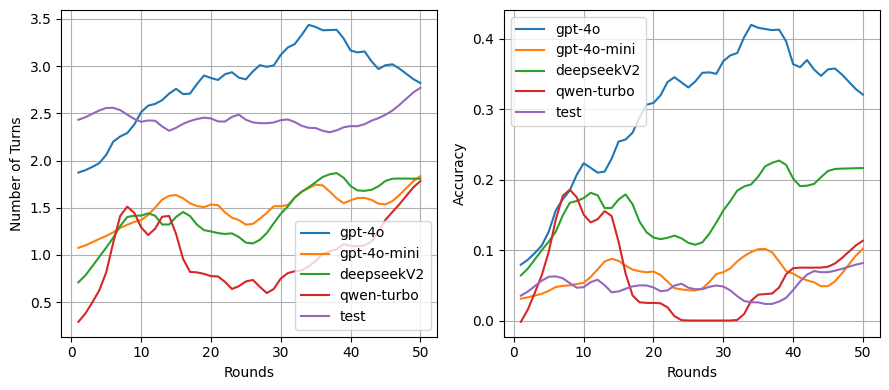

实验结果表明,随着对话轮数的增加,不间断对话轮数和信息传输的准确性都显著提高。用户研究验证了生成对话和策略的真实世界相关性。消融研究表明,遗传算法对长期适应性和改善整体结果至关重要。具体性能数据(例如,信息传输准确率的提升幅度)需要在论文中查找。

🎯 应用场景

该研究可应用于社交媒体平台的内容审核策略优化、网络舆情分析、以及理解语言在对抗环境下的演化规律。通过模拟不同监管策略下的语言演化,平台可以更好地预测和应对用户规避行为,从而提升内容审核的效率和准确性。此外,该研究还可以帮助理解虚假信息传播的机制,并为开发更有效的反欺诈技术提供理论基础。

📄 摘要(原文)

Social media platforms frequently impose restrictive policies to moderate user content, prompting the emergence of creative evasion language strategies. This paper presents a multi-agent framework based on Large Language Models (LLMs) to simulate the iterative evolution of language strategies under regulatory constraints. In this framework, participant agents, as social media users, continuously evolve their language expression, while supervisory agents emulate platform-level regulation by assessing policy violations. To achieve a more faithful simulation, we employ a dual design of language strategies (constraint and expression) to differentiate conflicting goals and utilize an LLM-driven GA (Genetic Algorithm) for the selection, mutation, and crossover of language strategies. The framework is evaluated using two distinct scenarios: an abstract password game and a realistic simulated illegal pet trade scenario. Experimental results demonstrate that as the number of dialogue rounds increases, both the number of uninterrupted dialogue turns and the accuracy of information transmission improve significantly. Furthermore, a user study with 40 participants validates the real-world relevance of the generated dialogues and strategies. Moreover, ablation studies validate the importance of the GA, emphasizing its contribution to long-term adaptability and improved overall results.