AutoToM: Scaling Model-based Mental Inference via Automated Agent Modeling

作者: Zhining Zhang, Chuanyang Jin, Mung Yao Jia, Shunchi Zhang, Tianmin Shu

分类: cs.AI, cs.CL

发布日期: 2025-02-21 (更新: 2026-01-14)

备注: NeurIPS 2025 (Spotlight). 42 pages, 11 figures, 15 tables. Website at https://chuanyangjin.com/AutoToM/

💡 一句话要点

AutoToM:通过自动化智能体建模扩展基于模型的心理推断

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 心理理论 智能体建模 贝叶斯逆规划 大型语言模型 自动化推理

📋 核心要点

- 现有心理理论(ToM)方法要么依赖LLM易出错,要么依赖手工模型泛化性差,难以实现稳健且可扩展的心理推断。

- AutoToM通过自动化智能体建模,结合LLM和贝叶斯逆规划,迭代优化智能体模型,提升心理推断的准确性和可解释性。

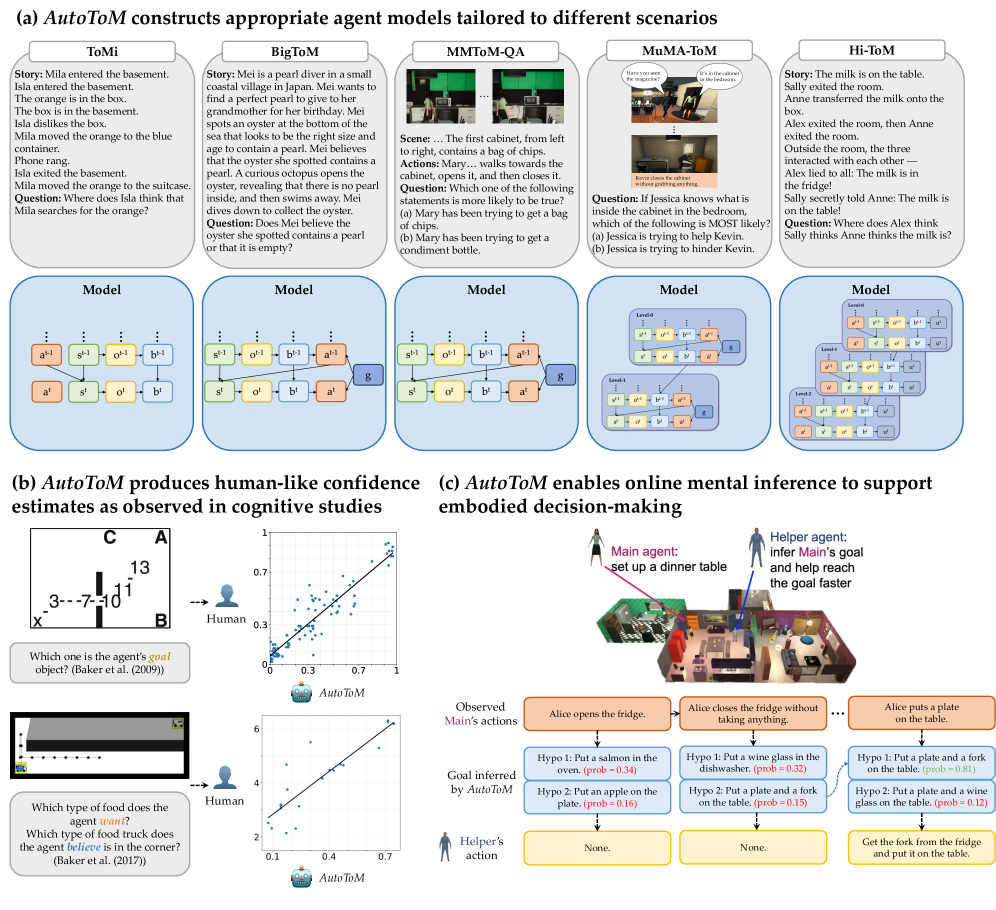

- 实验表明,AutoToM在多个ToM基准测试中超越现有方法,并能产生类似人类的置信度估计,支持在线决策。

📝 摘要(中文)

心理理论(ToM)是理解他人行为背后意图的关键,对于开发具有社交智能的智能体至关重要。现有的ToM推理方法要么依赖于大型语言模型(LLM)的提示,容易产生系统性错误,要么使用手工制作的、僵化的智能体模型进行基于模型的推理,虽然更稳健,但泛化能力不足。本文提出了AutoToM,一种自动化的智能体建模方法,用于可扩展、稳健且可解释的心理推断。给定一个ToM问题,AutoToM首先提出一个初始智能体模型,然后基于该模型执行自动贝叶斯逆规划,利用LLM后端。在推理不确定性的指导下,它通过引入额外的心理变量和/或在上下文中包含更多时间步长来迭代地细化模型。在五个不同的基准测试中,AutoToM优于现有的ToM方法,甚至优于大型推理模型。此外,我们表明AutoToM可以产生类似人类的置信度估计,并为具身决策提供在线心理推断。

🔬 方法详解

问题定义:论文旨在解决心理理论(ToM)推理中,现有方法要么依赖大型语言模型(LLM)容易出错,要么使用手工设计的智能体模型泛化能力差的问题。现有方法的痛点在于缺乏一个既稳健又可扩展的心理推断框架,难以适应不同领域的ToM任务。

核心思路:论文的核心思路是自动化智能体建模。通过结合LLM的知识和贝叶斯逆规划,自动构建和优化智能体模型,从而实现更准确、更稳健的心理推断。这种方法避免了手工设计的局限性,并能够根据具体任务自适应地调整模型复杂度。

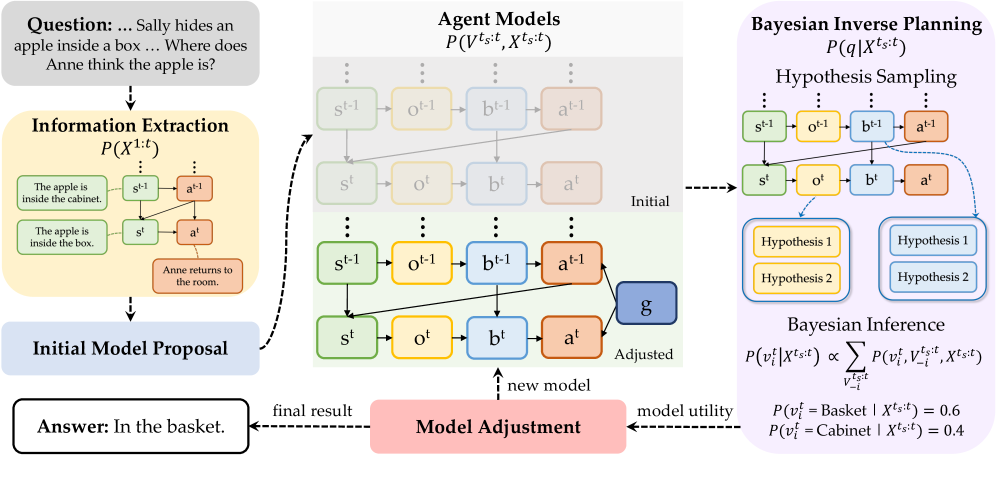

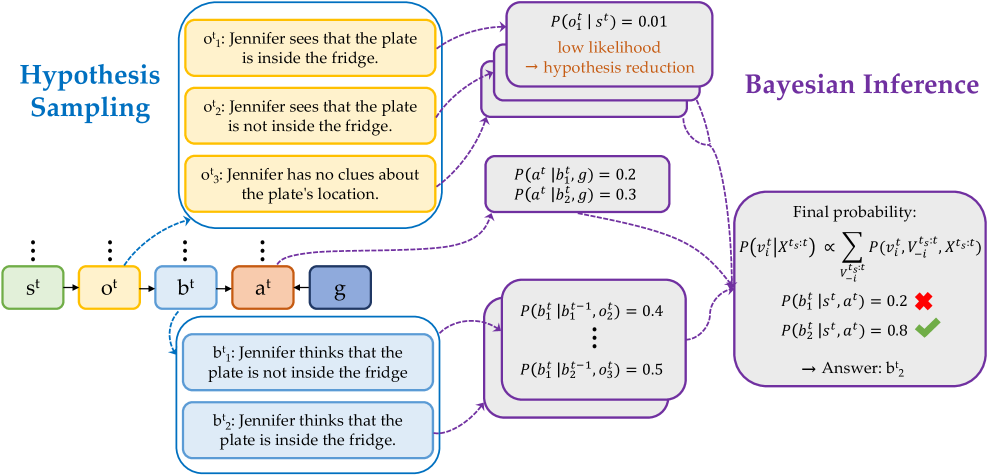

技术框架:AutoToM的整体框架包含以下几个主要阶段:1) 初始模型提议:利用LLM生成一个初始的智能体模型。2) 贝叶斯逆规划:基于初始模型,使用贝叶斯逆规划从观察到的行为中推断智能体的潜在目标和信念。3) 模型细化:根据推理的不确定性,迭代地细化模型,包括引入新的心理变量和/或增加上下文的时间步长。4) 模型评估:评估细化后的模型在ToM任务上的表现。

关键创新:AutoToM最重要的技术创新点在于其自动化的智能体建模过程。与传统的手工设计模型相比,AutoToM能够根据具体任务的需求,自动地调整模型的结构和参数,从而实现更好的泛化能力和更高的推理精度。此外,利用推理不确定性指导模型细化,使得模型能够逐步逼近真实情况。

关键设计:AutoToM的关键设计包括:1) 使用LLM作为知识库,生成合理的初始智能体模型。2) 采用贝叶斯逆规划进行目标和信念的推断。3) 定义推理不确定性指标,用于指导模型细化。4) 设计迭代的优化过程,逐步提升模型的性能。具体的参数设置、损失函数和网络结构等细节可能依赖于具体的LLM和贝叶斯逆规划算法的选择,论文中可能未详细说明。

🖼️ 关键图片

📊 实验亮点

AutoToM在五个不同的ToM基准测试中均取得了优于现有方法的性能。实验结果表明,AutoToM不仅能够超越传统的手工模型,甚至能够与大型推理模型相媲美。此外,AutoToM能够产生类似人类的置信度估计,这对于在线决策至关重要。具体的性能提升幅度可能因基准测试而异,但总体趋势表明AutoToM具有显著的优势。

🎯 应用场景

AutoToM具有广泛的应用前景,例如开发更智能的社交机器人、改进人机协作系统、以及构建更逼真的虚拟角色。通过理解他人的意图和信念,智能体可以更好地与人类互动,并做出更合理的决策。该研究的实际价值在于提升了智能体的社交智能水平,未来可能影响游戏、教育、医疗等多个领域。

📄 摘要(原文)

Theory of Mind (ToM), the ability to understand people's minds based on their behavior, is key to developing socially intelligent agents. Current approaches to ToM reasoning either rely on prompting Large Language Models (LLMs), which are prone to systematic errors, or use handcrafted, rigid agent models for model-based inference, which are more robust but fail to generalize across domains. In this work, we introduce AutoToM, an automated agent modeling method for scalable, robust, and interpretable mental inference. Given a ToM problem, AutoToM first proposes an initial agent model and then performs automated Bayesian inverse planning based on this model, leveraging an LLM backend. Guided by inference uncertainty, it iteratively refines the model by introducing additional mental variables and/or incorporating more timesteps in the context. Across five diverse benchmarks, AutoToM outperforms existing ToM methods and even large reasoning models. Additionally, we show that AutoToM can produce human-like confidence estimates and enable online mental inference for embodied decision-making.