KIMAs: A Configurable Knowledge Integrated Multi-Agent System

作者: Zitao Li, Fei Wei, Yuexiang Xie, Dawei Gao, Weirui Kuang, Zhijian Ma, Bingchen Qian, Yaliang Li, Bolin Ding

分类: cs.AI, cs.MA

发布日期: 2025-02-13

💡 一句话要点

KIMAs:一个可配置的知识集成多智能体系统,用于构建知识密集型应用。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识密集型应用 多智能体系统 检索增强生成 上下文管理 知识路由

📋 核心要点

- 现有RAG框架在处理异构数据、上下文管理和低延迟响应方面存在不足,难以满足实际应用需求。

- KIMAs通过集成上下文管理、知识路由、过滤生成和并行执行等机制,实现灵活的知识集成和高效的多智能体协作。

- KIMAs已成功应用于三个实际运行的应用,证明了其在构建知识密集型应用方面的有效性和可靠性。

📝 摘要(中文)

本文介绍了一个可配置的知识集成多智能体系统KIMAs,旨在解决现有基于检索增强生成(RAG)的知识密集型应用在处理异构数据、管理对话上下文和满足低延迟响应时间方面的挑战。KIMAs具有灵活可配置的系统,集成了多样化的知识来源,包括:上下文管理和查询重写机制,以提高检索准确性和多轮对话的连贯性;高效的知识路由和检索;简单有效的过滤和参考生成机制;以及优化的可并行多智能体流水线执行。该工作为在实际环境中推进LLM的部署提供了一个可扩展的框架。为了展示KIMAs如何帮助开发者构建不同规模和侧重点的知识密集型应用,本文演示了如何配置该系统以应用于三个已在实践中运行并具有可靠性能的应用。

🔬 方法详解

问题定义:现有基于RAG的知识密集型应用在实际场景中面临诸多挑战。首先,知识来源异构,包括不同的主题和格式,难以统一处理。其次,对话上下文管理复杂,需要维护多轮对话的连贯性。最后,对响应时间有较高要求,需要保证低延迟。

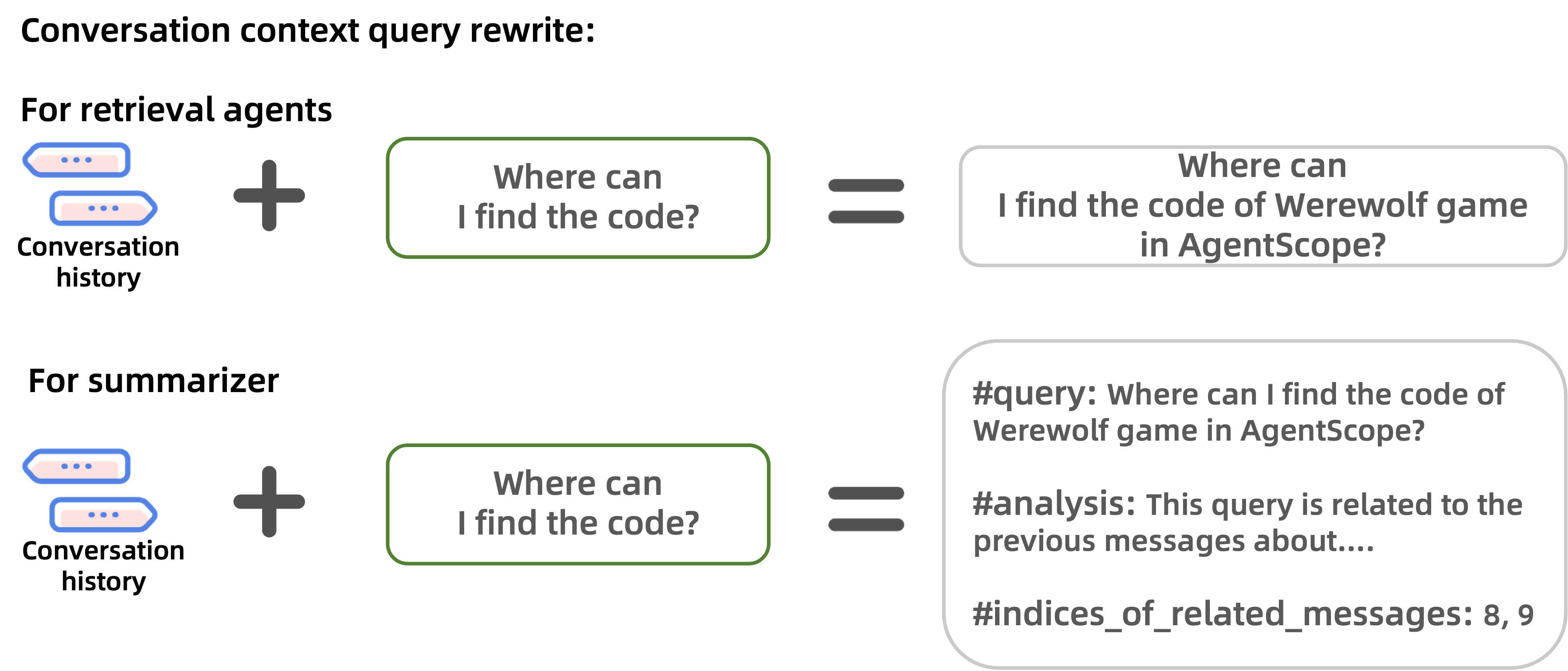

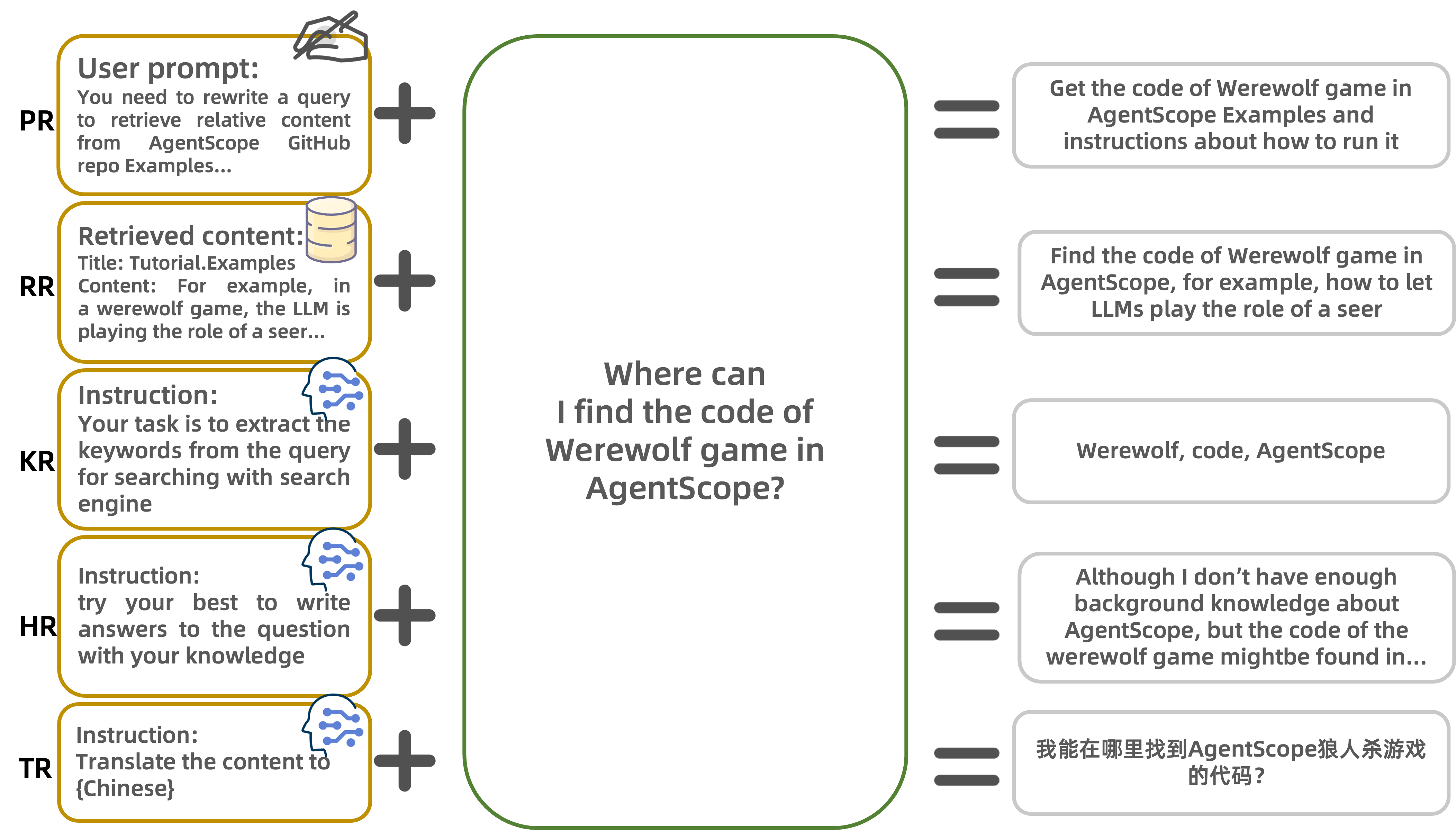

核心思路:KIMAs的核心思路是构建一个可配置的多智能体系统,将知识集成、检索、过滤和生成等任务分解为多个独立的智能体,并通过灵活的配置实现不同应用场景的定制化。通过上下文管理和查询重写提高检索准确性,通过知识路由实现高效检索,通过过滤和参考生成提高生成质量,通过并行执行降低响应时间。

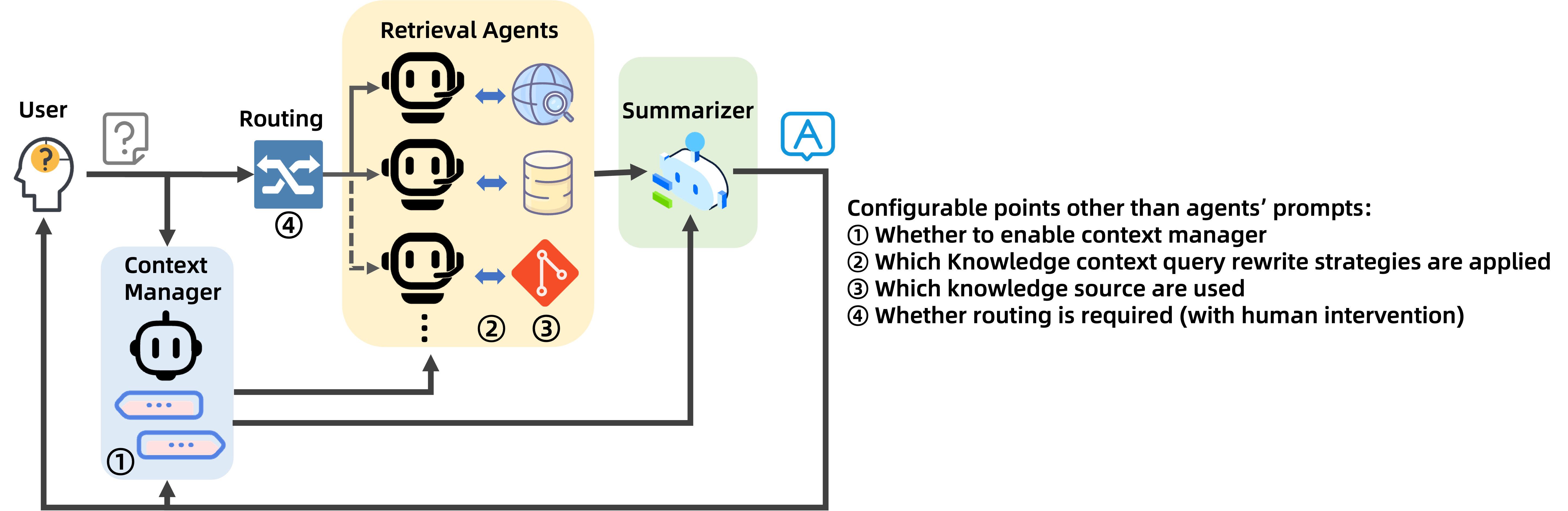

技术框架:KIMAs的整体架构是一个多智能体流水线,包含以下主要模块:1) 上下文管理模块:负责维护对话历史,进行查询重写,提高检索准确性。2) 知识路由模块:根据查询内容选择合适的知识源。3) 知识检索模块:从选定的知识源中检索相关信息。4) 过滤模块:过滤掉无关或冗余的信息。5) 参考生成模块:根据检索到的信息生成最终回复。6) 多智能体调度模块:负责协调各个智能体的执行,实现并行化。

关键创新:KIMAs的关键创新在于其可配置的多智能体架构,允许开发者根据不同的应用场景灵活配置各个智能体的功能和参数。这种可配置性使得KIMAs能够适应各种复杂的知识密集型应用,而传统的RAG框架通常只能处理特定类型的知识源和任务。

关键设计:KIMAs的关键设计包括:1) 上下文管理模块使用Transformer模型进行查询重写,提高检索准确性。2) 知识路由模块使用分类模型选择合适的知识源。3) 多智能体调度模块使用有向无环图(DAG)描述智能体之间的依赖关系,实现并行化执行。具体参数设置和损失函数等细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文展示了KIMAs在三个实际应用中的性能表现,证明了其在处理异构数据、管理对话上下文和满足低延迟响应时间方面的优势。虽然论文中没有给出具体的性能数据和对比基线,但强调了KIMAs在实际应用中的可靠性能,表明其具有很强的实用价值。

🎯 应用场景

KIMAs可应用于各种知识密集型对话系统,例如智能客服、教育辅导、医疗咨询等。该系统能够帮助开发者快速构建具有高质量回复和低延迟响应的知识密集型应用,提升用户体验,并降低开发成本。未来,KIMAs有望成为构建下一代智能对话系统的关键基础设施。

📄 摘要(原文)

Knowledge-intensive conversations supported by large language models (LLMs) have become one of the most popular and helpful applications that can assist people in different aspects. Many current knowledge-intensive applications are centered on retrieval-augmented generation (RAG) techniques. While many open-source RAG frameworks facilitate the development of RAG-based applications, they often fall short in handling practical scenarios complicated by heterogeneous data in topics and formats, conversational context management, and the requirement of low-latency response times. This technical report presents a configurable knowledge integrated multi-agent system, KIMAs, to address these challenges. KIMAs features a flexible and configurable system for integrating diverse knowledge sources with 1) context management and query rewrite mechanisms to improve retrieval accuracy and multi-turn conversational coherency, 2) efficient knowledge routing and retrieval, 3) simple but effective filter and reference generation mechanisms, and 4) optimized parallelizable multi-agent pipeline execution. Our work provides a scalable framework for advancing the deployment of LLMs in real-world settings. To show how KIMAs can help developers build knowledge-intensive applications with different scales and emphases, we demonstrate how we configure the system to three applications already running in practice with reliable performance.