YNote: A Novel Music Notation for Fine-Tuning LLMs in Music Generation

作者: Shao-Chien Lu, Chen-Chen Yeh, Hui-Lin Cho, Chun-Chieh Hsu, Tsai-Ling Hsu, Cheng-Han Wu, Timothy K. Shih, Yu-Cheng Lin

分类: cs.SD, cs.AI, eess.AS

发布日期: 2025-02-12

💡 一句话要点

提出YNote:一种用于微调LLM音乐生成的新型音乐符号表示方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 音乐生成 大型语言模型 音乐符号表示 YNote 微调 GPT-2 BLEU ROUGE

📋 核心要点

- 现有音乐符号表示方法(如MIDI等)结构复杂,可变性高,难以有效微调LLM进行音乐生成。

- 论文提出YNote,一种仅用四个字符表示音符及其音高的简化音乐符号系统,保证一致性。

- 实验表明,使用YNote微调GPT-2后,音乐生成质量显著提升,BLEU和ROUGE分数分别达到0.883和0.766。

📝 摘要(中文)

本文提出了一种名为YNote的简化音乐符号系统,旨在解决现有音乐符号(如MIDI、ABC Notation和MusicXML)过于复杂,难以有效微调大型语言模型(LLM)进行音乐生成的问题。这些现有格式由于其可变性和复杂结构,机器和人类都难以解释。YNote仅使用四个字符来表示音符及其音高,其固定格式确保了一致性,易于阅读,更适合微调LLM。实验结果表明,在YNote编码的数据集上微调GPT-2 (124M)后,BLEU和ROUGE分数分别达到0.883和0.766。仅使用两个音符作为提示,该模型就能够生成连贯且风格相关的音乐。YNote为机器学习应用提供了一种实用的音乐符号替代方案,并有潜力显著提高使用LLM进行音乐生成的质量。

🔬 方法详解

问题定义:现有音乐符号系统,如MIDI、ABC Notation和MusicXML,在用于微调大型语言模型(LLM)进行音乐生成时存在困难。这些格式的复杂结构和高度可变性使得它们难以被机器解析和理解,从而限制了LLM的学习效率和生成质量。因此,需要一种更简洁、一致的音乐符号表示方法,以便更好地训练LLM。

核心思路:论文的核心思路是设计一种极简的音乐符号系统,即YNote,它使用固定格式和有限的字符集来表示音乐信息。通过简化音乐表示,降低了LLM学习的难度,使其能够更快地捕捉音乐的结构和风格。这种设计旨在提高LLM在音乐生成任务中的性能和效率。

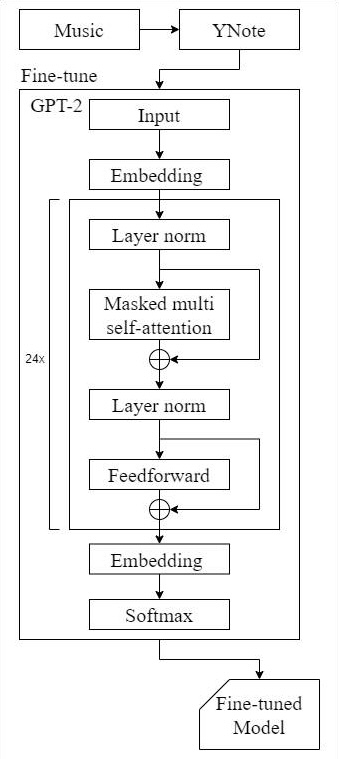

技术框架:整体框架包括以下几个步骤:1) 将现有的音乐数据转换为YNote格式。2) 使用YNote编码的音乐数据微调预训练的LLM(例如GPT-2)。3) 使用微调后的LLM生成新的音乐片段。4) 对生成的音乐进行评估,例如使用BLEU和ROUGE等指标。

关键创新:YNote的关键创新在于其极简的设计理念。与传统的音乐符号系统相比,YNote只使用四个字符来表示一个音符及其音高,大大降低了表示的复杂性。这种简化使得LLM更容易学习和生成音乐,同时也方便了人类的阅读和理解。此外,YNote的固定格式保证了一致性,避免了歧义,进一步提高了LLM的学习效率。

关键设计:YNote使用四个字符来表示一个音符,具体表示方式未知。实验中,作者使用GPT-2 (124M) 作为LLM,并在YNote编码的数据集上进行微调。使用了BLEU和ROUGE分数作为评估指标。具体的损失函数、网络结构等技术细节未在摘要中提及,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用YNote编码的数据集微调GPT-2 (124M)后,BLEU和ROUGE分数分别达到0.883和0.766。这意味着生成的音乐在语法和内容上都与训练数据高度相似。此外,仅使用两个音符作为提示,该模型就能够生成连贯且风格相关的音乐,表明YNote能够有效地帮助LLM学习音乐的结构和风格。

🎯 应用场景

YNote的应用场景广泛,包括辅助音乐创作、音乐教育、音乐治疗等。它可以作为一种通用的音乐表示方法,用于各种音乐相关的机器学习任务,例如音乐风格迁移、音乐续写、音乐情感识别等。YNote的简化设计使得非专业人士也能轻松理解和使用,从而降低了音乐创作的门槛,促进了音乐的普及和发展。

📄 摘要(原文)

The field of music generation using Large Language Models (LLMs) is evolving rapidly, yet existing music notation systems, such as MIDI, ABC Notation, and MusicXML, remain too complex for effective fine-tuning of LLMs. These formats are difficult for both machines and humans to interpret due to their variability and intricate structure. To address these challenges, we introduce YNote, a simplified music notation system that uses only four characters to represent a note and its pitch. YNote's fixed format ensures consistency, making it easy to read and more suitable for fine-tuning LLMs. In our experiments, we fine-tuned GPT-2 (124M) on a YNote-encoded dataset and achieved BLEU and ROUGE scores of 0.883 and 0.766, respectively. With just two notes as prompts, the model was able to generate coherent and stylistically relevant music. We believe YNote offers a practical alternative to existing music notations for machine learning applications and has the potential to significantly enhance the quality of music generation using LLMs.