Fostering Appropriate Reliance on Large Language Models: The Role of Explanations, Sources, and Inconsistencies

作者: Sunnie S. Y. Kim, Jennifer Wortman Vaughan, Q. Vera Liao, Tania Lombrozo, Olga Russakovsky

分类: cs.HC, cs.AI

发布日期: 2025-02-12

备注: CHI 2025. This version includes the appendix

💡 一句话要点

通过解释、来源和不一致性来促进对大型语言模型的适当依赖

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 人机交互 可信赖AI 解释性AI 用户依赖性

📋 核心要点

- 大型语言模型可能产生看似合理但错误的答案,导致用户过度信任,这是当前LLM应用中的一个重要问题。

- 该研究通过分析解释、来源和不一致性等因素,旨在理解和调节用户对LLM输出的依赖程度。

- 实验结果表明,解释会增加依赖性,而提供来源或揭示不一致性可以降低对错误答案的依赖。

📝 摘要(中文)

大型语言模型(LLM)会产生流畅且令人信服的错误回答,从而增加了用户过度依赖这些回答的风险。减轻这种过度依赖是一个关键挑战。通过一项“边想边说”的研究,参与者使用LLM驱动的应用程序来回答客观问题,我们识别出LLM响应中影响用户依赖性的几个特征:解释(答案的支持细节)、解释中的不一致性以及来源。通过一项大规模、预注册的对照实验(N=308),我们分离并研究了这些特征对用户的依赖性、准确性和其他指标的影响。我们发现,解释的存在会增加对正确和错误回答的依赖。然而,当提供来源或解释出现不一致时,我们观察到对错误回答的依赖性降低。我们讨论了这些发现对促进对LLM的适当依赖的意义。

🔬 方法详解

问题定义:该论文旨在解决用户过度依赖大型语言模型(LLM)的问题,尤其是在LLM生成看似合理但实际上错误的答案时。现有方法未能有效引导用户区分LLM输出的正确与错误,导致用户盲目信任LLM的回答,从而可能产生负面影响。

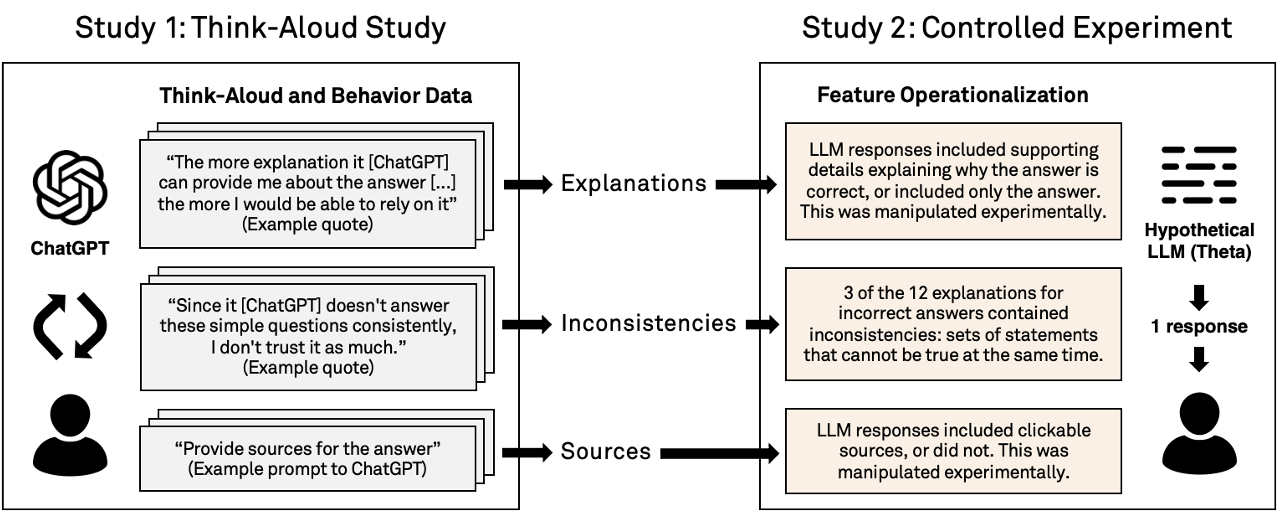

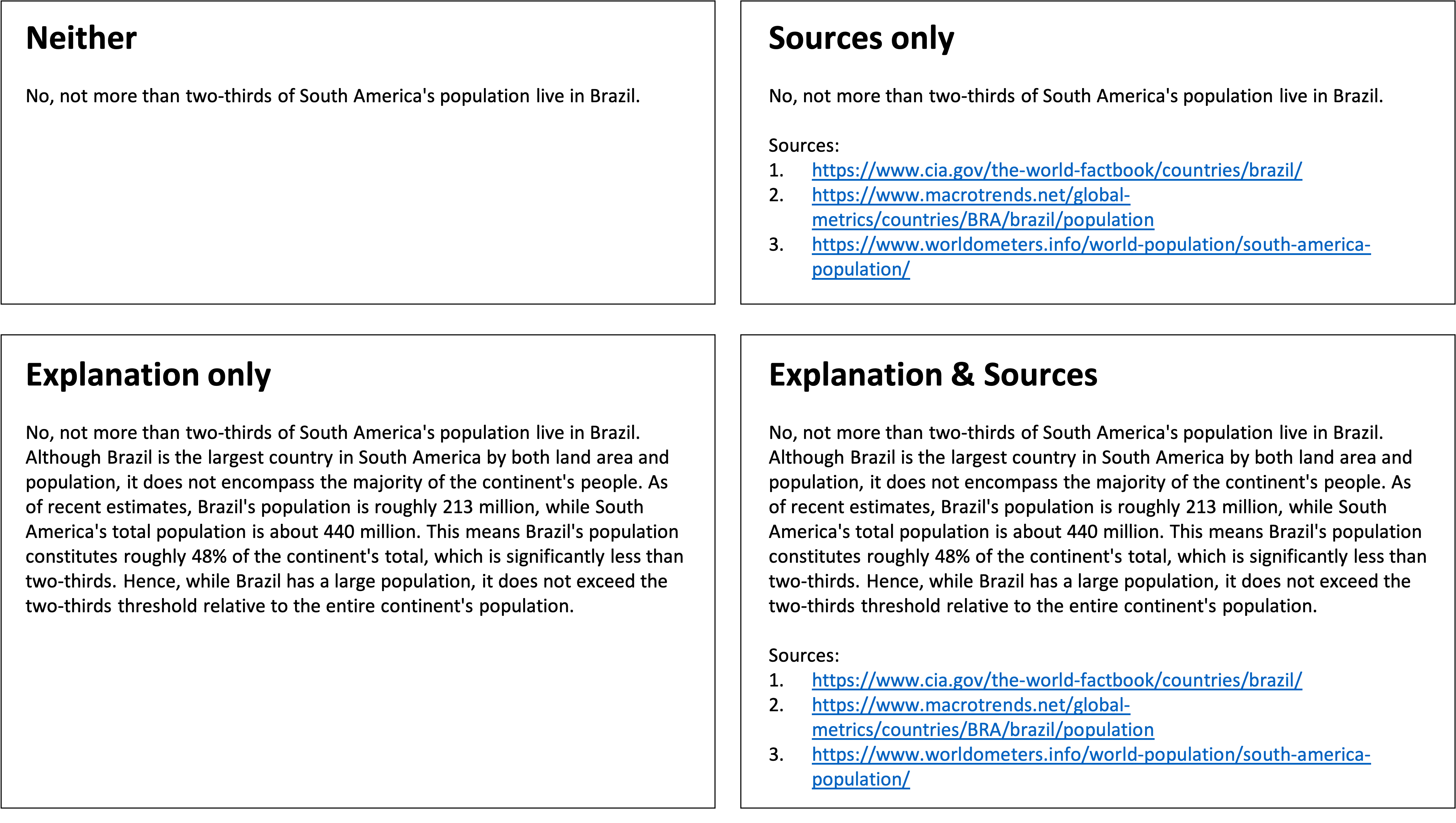

核心思路:论文的核心思路是通过操纵LLM输出的几个关键特征(解释、来源和不一致性)来影响用户对LLM回答的信任程度。通过提供解释来增加用户的理解,通过提供来源来增加用户的信心,并通过引入不一致性来降低用户的信任,从而引导用户更理性地使用LLM。

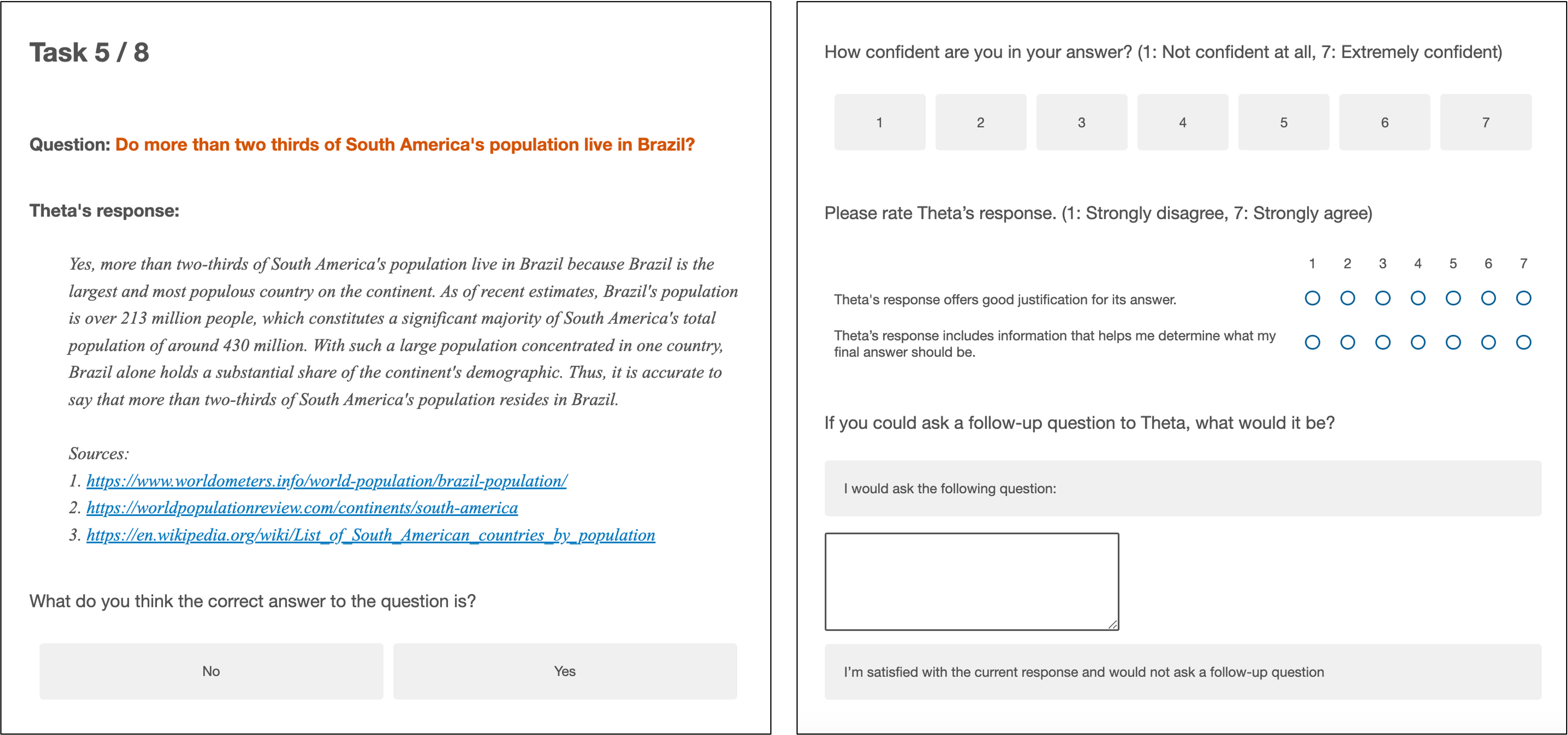

技术框架:该研究采用了混合方法,包括一项“边想边说”的定性研究和一项大规模的定量实验。定性研究用于识别影响用户依赖性的关键因素,定量实验则用于验证这些因素的影响。实验中,参与者使用一个LLM驱动的应用程序来回答客观问题,并根据LLM提供的回答做出判断。研究人员操纵LLM回答中的解释、来源和不一致性,并测量参与者的依赖性、准确性和其他指标。

关键创新:该研究的关键创新在于系统地研究了LLM输出的解释、来源和不一致性对用户依赖性的影响。以往的研究主要关注LLM本身的性能,而该研究则关注用户与LLM的交互方式,并试图通过改变LLM的输出方式来引导用户更合理地使用LLM。

关键设计:实验设计中,研究人员精心控制了LLM回答的质量,确保存在一定比例的错误答案。解释的生成方式未知,但目标是提供支持答案的细节。来源的提供方式也未知,但目标是增加用户对答案的信心。不一致性的引入方式未知,但目标是降低用户对答案的信任。实验指标包括用户的依赖性(即用户接受LLM回答的程度)、准确性(即用户回答正确的程度)和其他指标(如用户对LLM的信任程度)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提供解释会显著增加用户对LLM回答的依赖性,无论答案是否正确。然而,当提供来源或解释出现不一致时,用户对错误答案的依赖性会显著降低。这些发现为设计更负责任和可信赖的LLM应用提供了重要启示。

🎯 应用场景

该研究成果可应用于各种LLM驱动的应用场景,例如智能客服、教育辅助、信息检索等。通过合理设计LLM的输出方式,可以引导用户更理性地使用LLM,避免过度依赖,从而提高用户体验和决策质量。未来的研究可以进一步探索其他影响用户依赖性的因素,并开发更有效的引导策略。

📄 摘要(原文)

Large language models (LLMs) can produce erroneous responses that sound fluent and convincing, raising the risk that users will rely on these responses as if they were correct. Mitigating such overreliance is a key challenge. Through a think-aloud study in which participants use an LLM-infused application to answer objective questions, we identify several features of LLM responses that shape users' reliance: explanations (supporting details for answers), inconsistencies in explanations, and sources. Through a large-scale, pre-registered, controlled experiment (N=308), we isolate and study the effects of these features on users' reliance, accuracy, and other measures. We find that the presence of explanations increases reliance on both correct and incorrect responses. However, we observe less reliance on incorrect responses when sources are provided or when explanations exhibit inconsistencies. We discuss the implications of these findings for fostering appropriate reliance on LLMs.