Large Language Model Guided Self-Debugging Code Generation

作者: Muntasir Adnan, Zhiwei Xu, Carlos C. N. Kuhn

分类: cs.SE, cs.AI

发布日期: 2025-02-05 (更新: 2025-06-21)

💡 一句话要点

PyCapsule:基于大语言模型引导的自调试代码生成框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码生成 大型语言模型 自调试 双代理 Python 自动化编程 错误纠正

📋 核心要点

- 现有代码生成方法在计算效率方面面临挑战,并且缺乏强大的代码解析和错误纠正机制。

- PyCapsule框架采用双代理流水线和自调试模块,通过提示推理、迭代错误处理和用例测试来提高代码生成的质量。

- 实验表明,PyCapsule在多个代码生成基准测试中显著优于现有方法,成功率提升高达24.4%。

📝 摘要(中文)

本文提出了一种名为PyCapsule的新型框架,用于Python代码生成。该框架采用简单而有效的双代理流水线和高效的自调试模块。PyCapsule具有精巧的提示推理、迭代错误处理和用例测试等特性,确保了代码生成的高稳定性、安全性和正确性。实验结果表明,与现有最佳方法相比,PyCapsule在HumanEval数据集上成功率提高了5.7%,在HumanEval-ET上提高了10.3%,在BigCodeBench上提高了24.4%。同时,观察到在保留有限且嘈杂的错误反馈的情况下,随着自调试尝试次数的增加,归一化成功率有所下降。PyCapsule展示了在推进人工智能系统轻量级和高效代码生成方面的广泛影响。

🔬 方法详解

问题定义:论文旨在解决自动代码生成中计算效率低和缺乏有效错误纠正机制的问题。现有方法在处理复杂任务时,往往需要大量的计算资源,并且在代码出现错误时,难以进行有效的调试和修复。

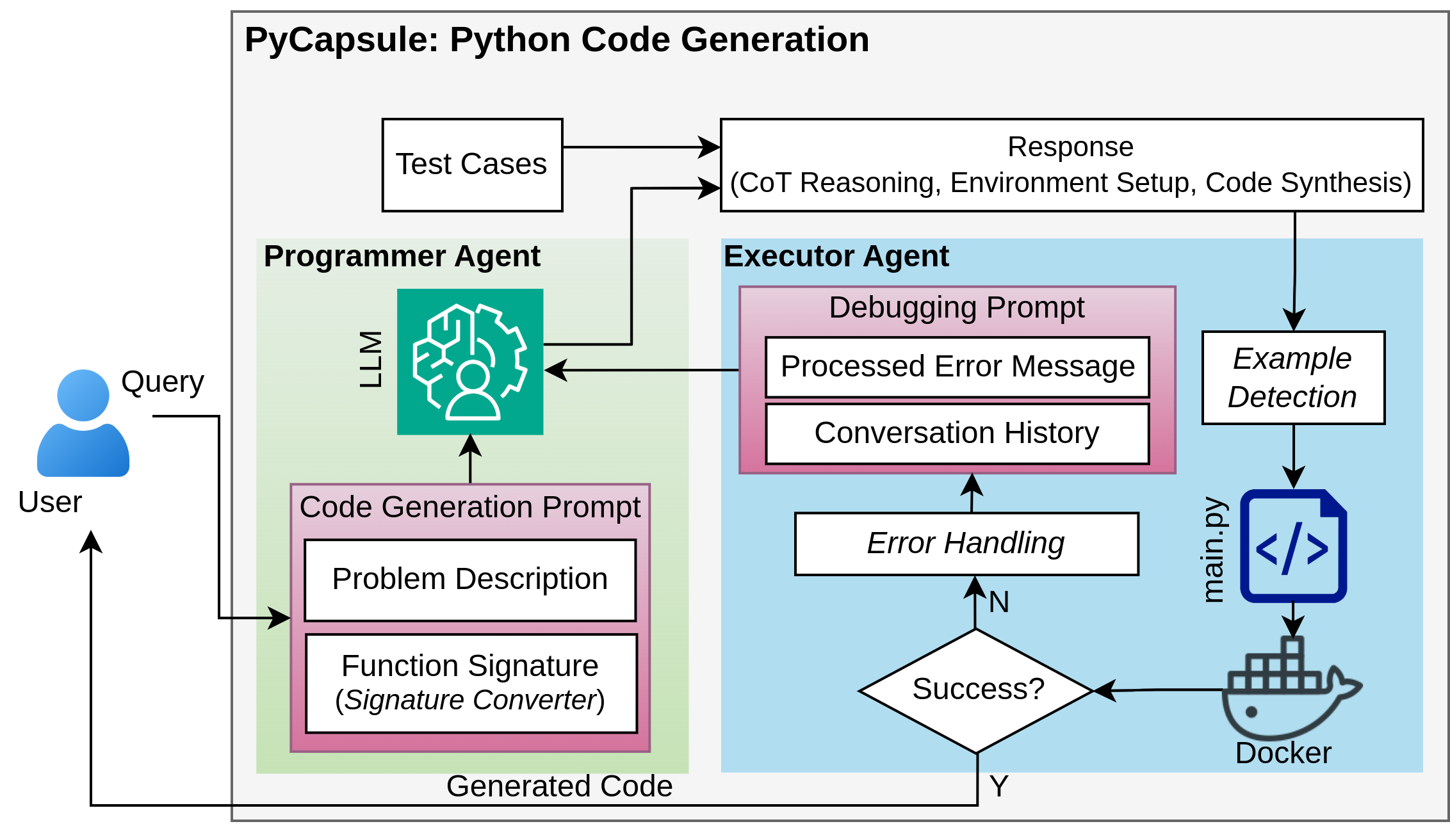

核心思路:PyCapsule的核心思路是利用大型语言模型(LLM)的强大推理能力,构建一个双代理流水线,其中一个代理负责生成代码,另一个代理负责评估和调试代码。通过迭代的错误处理和用例测试,逐步提高代码的质量和正确性。

技术框架:PyCapsule框架包含两个主要代理:代码生成代理和代码调试代理。代码生成代理根据给定的提示生成Python代码。代码调试代理接收生成的代码和错误信息,并尝试修复代码中的错误。框架还包括一个用例测试模块,用于验证生成的代码是否满足给定的要求。整个过程是迭代的,直到代码通过所有测试或达到最大迭代次数。

关键创新:PyCapsule的关键创新在于其双代理流水线和自调试机制。通过将代码生成和调试任务分离,并利用LLM的推理能力进行错误修复,可以显著提高代码生成的效率和质量。此外,框架的迭代错误处理和用例测试机制,可以确保生成的代码具有较高的稳定性和安全性。

关键设计:PyCapsule的具体实现细节未知,论文中可能涉及提示工程的设计,例如如何构建有效的提示来引导LLM生成高质量的代码。此外,代码调试代理的实现方式,例如如何利用LLM的知识来识别和修复代码中的错误,也是一个关键的设计考虑因素。用例测试模块的具体实现,例如如何生成有效的测试用例来验证代码的正确性,也是重要的技术细节。

🖼️ 关键图片

📊 实验亮点

PyCapsule在HumanEval、HumanEval-ET和BigCodeBench等代码生成基准测试中取得了显著的性能提升。具体而言,与现有最佳方法相比,PyCapsule在HumanEval上成功率提高了5.7%,在HumanEval-ET上提高了10.3%,在BigCodeBench上提高了24.4%。这些结果表明,PyCapsule框架在代码生成方面具有显著的优势。

🎯 应用场景

PyCapsule框架可应用于各种需要自动代码生成的场景,例如软件开发、自动化测试、数据分析等。它可以帮助开发者快速生成高质量的代码,提高开发效率,降低开发成本。此外,该框架还可以用于教育领域,帮助学生学习编程,提高编程能力。未来,该研究有望推动人工智能系统在代码生成方面的应用,并促进软件开发的自动化和智能化。

📄 摘要(原文)

Automated code generation is gaining significant importance in intelligent computer programming and system deployment. However, current approaches often face challenges in computational efficiency and lack robust mechanisms for code parsing and error correction. In this work, we propose a novel framework, PyCapsule, with a simple yet effective two-agent pipeline and efficient self-debugging modules for Python code generation. PyCapsule features sophisticated prompt inference, iterative error handling, and case testing, ensuring high generation stability, safety, and correctness. Empirically, PyCapsule achieves up to 5.7% improvement of success rate on HumanEval, 10.3% on HumanEval-ET, and 24.4% on BigCodeBench compared to the state-of-art methods. We also observe a decrease in normalized success rate given more self-debugging attempts, potentially affected by limited and noisy error feedback in retention. PyCapsule demonstrates broader impacts on advancing lightweight and efficient code generation for artificial intelligence systems.