Classroom Simulacra: Building Contextual Student Generative Agents in Online Education for Learning Behavioral Simulation

作者: Songlin Xu, Hao-Ning Wen, Hongyi Pan, Dallas Dominguez, Dongyin Hu, Xinyu Zhang

分类: cs.HC, cs.AI, cs.LG

发布日期: 2025-02-04

备注: 26 pages

💡 一句话要点

提出可迁移迭代反思模块,构建在线教育情境下学生生成式Agent,用于学习行为模拟。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 在线教育 学生行为模拟 生成式Agent 大型语言模型 迭代反思

📋 核心要点

- 现有学生行为模拟方法忽略了课程材料的影响,主要原因是缺乏细粒度标注数据和模型处理长文本的能力不足。

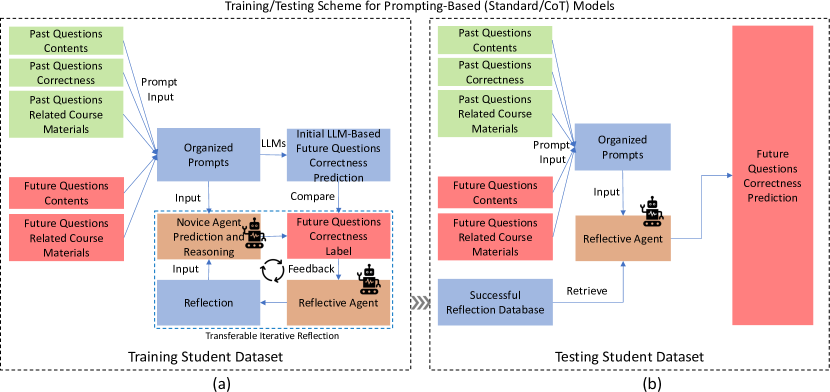

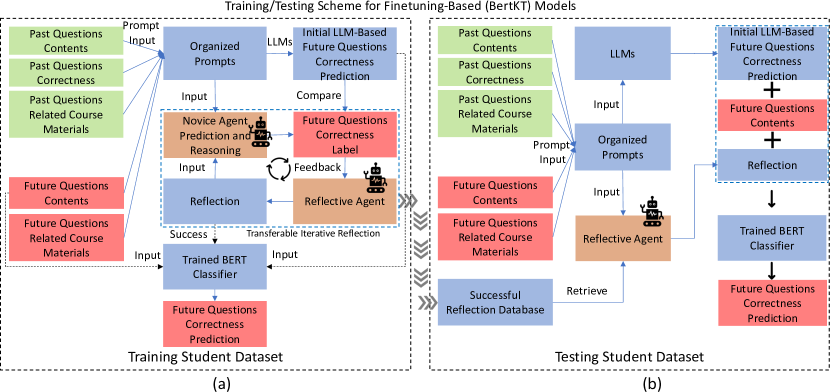

- 论文提出可迁移迭代反思(TIR)模块,增强大型语言模型(LLM)在模拟学习行为方面的能力,适用于prompting和finetuning两种范式。

- 实验结果表明,TIR模块使LLM能够更准确地模拟学生行为,优于传统深度学习模型,并能捕捉学习动态和学生间关联。

📝 摘要(中文)

学生模拟通过与虚拟学生互动,帮助教育者改进教学。然而,由于缺乏细粒度标注的课程材料数据集,以及现有模拟模型在处理超长文本数据方面的局限性,大多数现有方法忽略了课程材料的调节效应。为了解决这些挑战,我们首先运行了一个为期6周的教育研讨会,招募了60名学生,并使用定制的在线教育系统收集细粒度数据,该系统记录了学生在与讲座材料交互时的学习行为。其次,我们提出了一种可迁移的迭代反思(TIR)模块,该模块增强了基于提示和基于微调的大型语言模型(LLM),用于模拟学习行为。综合实验表明,即使在演示数据有限的情况下,TIR也能使LLM执行比经典深度学习模型更准确的学生模拟。我们的TIR方法更好地捕捉了课堂中学习表现的细粒度动态和学生间的相关性,为在线教育的“数字孪生”铺平了道路。

🔬 方法详解

问题定义:现有学生行为模拟方法难以有效利用课程材料信息,无法准确模拟学生在在线学习环境中的行为。主要痛点在于缺乏足够细粒度的数据集来反映学生与课程材料的交互过程,以及现有模型难以处理长文本的课程内容,导致模拟结果与真实情况存在偏差。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大文本理解和生成能力,并引入可迁移迭代反思(TIR)模块,使LLM能够更好地理解课程材料,模拟学生的学习行为。TIR模块通过迭代地反思和调整LLM的输出,使其更贴近真实学生的行为模式。

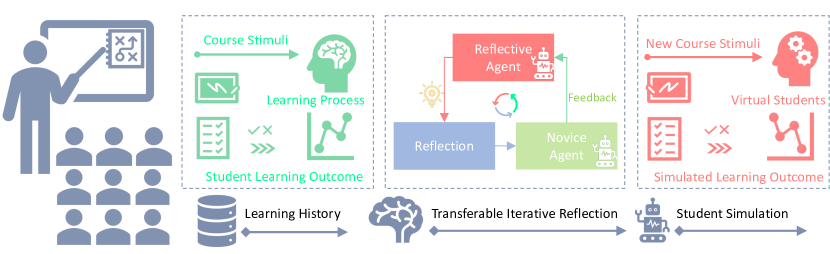

技术框架:整体框架包含数据收集和模型训练两个主要阶段。首先,通过定制的在线教育系统收集学生与课程材料交互的细粒度数据。然后,利用这些数据训练带有TIR模块的LLM。TIR模块可以集成到基于prompting或finetuning的LLM中。在模拟过程中,LLM根据课程材料和学生的历史行为生成下一步行为,TIR模块对生成的行为进行反思和调整,最终输出模拟结果。

关键创新:最重要的技术创新点是可迁移迭代反思(TIR)模块。TIR模块通过迭代地反思和调整LLM的输出,使其能够更好地捕捉学生的学习动态和学生间的相关性。与传统的深度学习模型相比,TIR模块能够更有效地利用课程材料信息,提高学生行为模拟的准确性。TIR模块的可迁移性使其可以应用于不同的LLM和不同的在线教育场景。

关键设计:TIR模块的具体实现细节未知,摘要中没有明确说明其内部结构、损失函数或参数设置。但可以推测,TIR模块可能包含一个反思机制,用于评估LLM生成的行为与真实学生行为之间的差距,并根据评估结果调整LLM的参数或输出。迭代过程可能涉及多次反思和调整,直到LLM的输出达到预期的准确度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的TIR模块能够显著提高LLM在学生行为模拟方面的准确性,优于传统的深度学习模型。即使在有限的演示数据下,TIR模块也能有效捕捉学习表现的细粒度动态和学生间的相关性。具体的性能数据和提升幅度在摘要中未明确给出,属于未知信息。

🎯 应用场景

该研究成果可应用于在线教育平台的智能教学辅助系统,帮助教师了解学生的学习情况,优化教学内容和方法。通过模拟不同学生的学习行为,可以预测学生的学习效果,并提供个性化的学习建议。此外,该技术还可以用于评估在线课程的质量,并为课程设计提供反馈。

📄 摘要(原文)

Student simulation supports educators to improve teaching by interacting with virtual students. However, most existing approaches ignore the modulation effects of course materials because of two challenges: the lack of datasets with granularly annotated course materials, and the limitation of existing simulation models in processing extremely long textual data. To solve the challenges, we first run a 6-week education workshop from N = 60 students to collect fine-grained data using a custom built online education system, which logs students' learning behaviors as they interact with lecture materials over time. Second, we propose a transferable iterative reflection (TIR) module that augments both prompting-based and finetuning-based large language models (LLMs) for simulating learning behaviors. Our comprehensive experiments show that TIR enables the LLMs to perform more accurate student simulation than classical deep learning models, even with limited demonstration data. Our TIR approach better captures the granular dynamism of learning performance and inter-student correlations in classrooms, paving the way towards a ''digital twin'' for online education.