Is Conversational XAI All You Need? Human-AI Decision Making With a Conversational XAI Assistant

作者: Gaole He, Nilay Aishwarya, Ujwal Gadiraju

分类: cs.HC, cs.AI

发布日期: 2025-01-29

备注: conditionally accepted to IUI 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出对话式XAI界面,提升用户理解与信任,但需警惕过度依赖

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可解释人工智能 对话式用户界面 人机协作 用户理解 用户信任 过度依赖 大型语言模型

📋 核心要点

- 现有XAI方法在提升用户理解方面存在不足,用户参与度较低,难以充分理解AI决策过程。

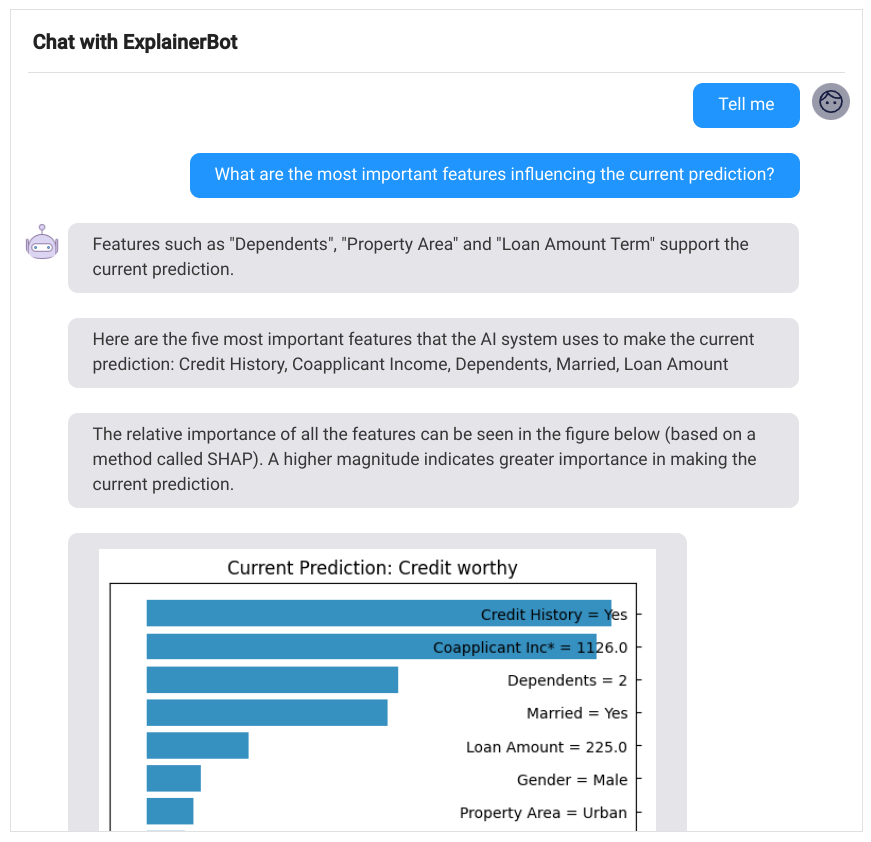

- 论文提出利用对话式用户界面增强XAI方法,通过自然语言交互提升用户参与度和对AI系统的理解。

- 实验表明,对话式XAI界面能有效提升用户对AI系统的理解和信任,但同时也可能导致用户过度依赖AI系统。

📝 摘要(中文)

可解释人工智能(XAI)方法旨在帮助人们理解AI系统如何做出预测。受对话式用户界面启发,本文提出利用对话式用户界面增强现有XAI方法,以提高用户参与度和对AI系统的理解。研究探讨了对话式XAI界面对用户理解、信任和依赖AI系统的影响。与XAI仪表盘相比,对话式XAI界面能提升用户对AI系统的理解和信任。然而,两种界面都导致用户对AI系统产生明显的过度依赖,而大型语言模型(LLM)驱动的增强对话加剧了这种过度依赖。研究认为,过度依赖的潜在原因是两种XAI界面都伴随的解释深度错觉。研究结果对设计有效的对话式XAI界面以促进适当依赖和改善人机协作具有重要意义。代码可在https://github.com/delftcrowd/IUI2025_ConvXAI找到。

🔬 方法详解

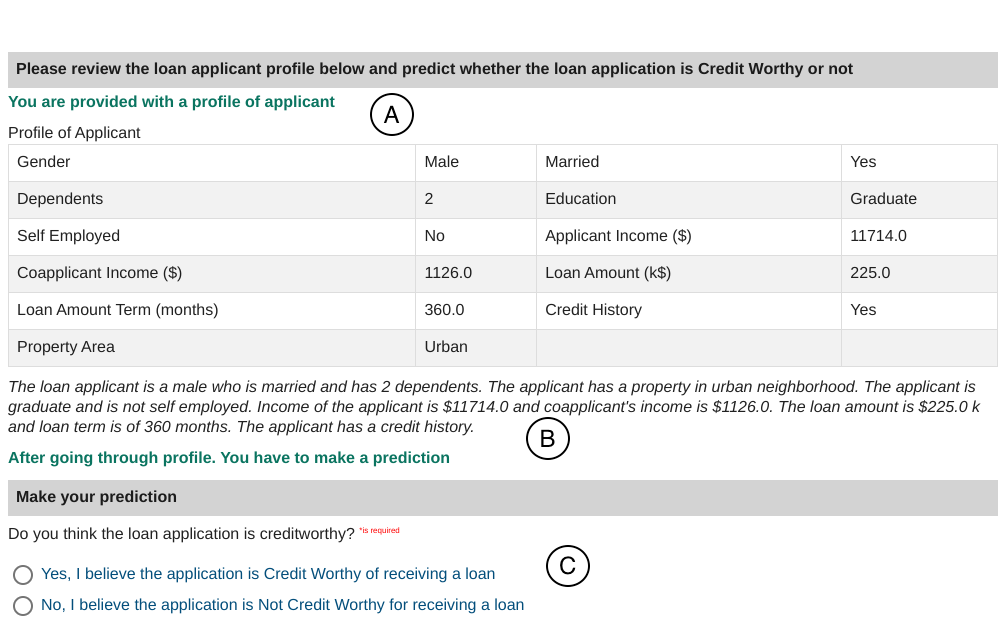

问题定义:现有XAI方法,如XAI仪表盘,虽然提供了AI决策过程的可视化解释,但在用户参与度和理解深度方面存在不足。用户可能难以主动探索和提问,导致对AI系统理解不够深入,甚至产生误解。此外,过度依赖AI系统也是一个潜在的风险。

核心思路:论文的核心思路是将对话式用户界面与现有的XAI方法相结合,构建一个对话式XAI系统。通过自然语言交互,用户可以主动提问、获取更详细的解释,从而更深入地理解AI系统的决策过程。同时,研究也关注对话式XAI界面可能带来的过度依赖问题。

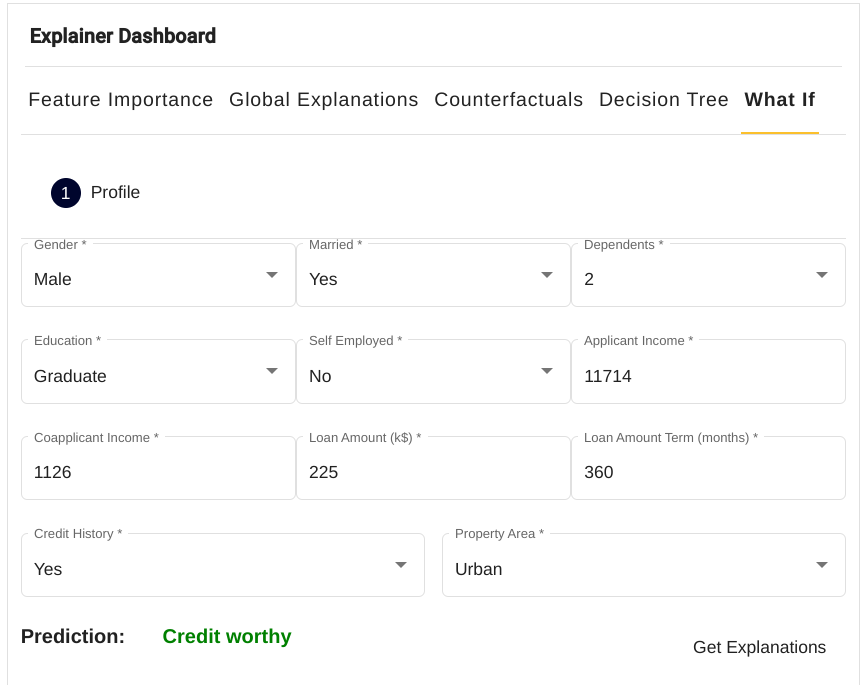

技术框架:该研究的技术框架主要包含两个部分:一是XAI模块,负责提供AI决策的解释;二是对话式用户界面模块,负责与用户进行自然语言交互。对话式用户界面可以基于规则或大型语言模型(LLM)构建。用户通过对话式界面向XAI系统提问,系统根据用户的提问,从XAI模块获取相关解释,并通过自然语言回复用户。

关键创新:该研究的关键创新在于将对话式用户界面与XAI方法相结合,探索了对话式XAI界面对用户理解、信任和依赖AI系统的影响。与传统的XAI仪表盘相比,对话式XAI界面能够提供更灵活、更个性化的解释,从而提升用户参与度和理解深度。此外,研究还关注了大型语言模型(LLM)在对话式XAI中的应用,以及可能带来的过度依赖问题。

关键设计:研究中,对话式用户界面可以采用不同的实现方式,例如基于规则的对话系统或基于大型语言模型的对话系统。基于大型语言模型的对话系统能够提供更自然、更流畅的对话体验,但也可能带来过度依赖问题。研究中可能需要设计一些机制来缓解过度依赖,例如提醒用户AI系统的局限性,鼓励用户进行独立思考等。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细说明,属于未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与XAI仪表盘相比,对话式XAI界面能够显著提升用户对AI系统的理解和信任。然而,两种界面都导致用户对AI系统产生明显的过度依赖,而大型语言模型(LLM)驱动的增强对话加剧了这种过度依赖。这表明在设计对话式XAI界面时,需要特别关注过度依赖问题,并采取相应的措施进行缓解。

🎯 应用场景

该研究成果可应用于各种需要人机协作的决策场景,例如医疗诊断、金融风控、自动驾驶等。通过提供可解释的AI决策过程,对话式XAI界面可以帮助用户更好地理解AI系统的决策依据,从而做出更明智的决策。未来,该研究可以进一步探索如何设计更有效的对话式XAI界面,以促进适当依赖和改善人机协作。

📄 摘要(原文)

Explainable artificial intelligence (XAI) methods are being proposed to help interpret and understand how AI systems reach specific predictions. Inspired by prior work on conversational user interfaces, we argue that augmenting existing XAI methods with conversational user interfaces can increase user engagement and boost user understanding of the AI system. In this paper, we explored the impact of a conversational XAI interface on users' understanding of the AI system, their trust, and reliance on the AI system. In comparison to an XAI dashboard, we found that the conversational XAI interface can bring about a better understanding of the AI system among users and higher user trust. However, users of both the XAI dashboard and conversational XAI interfaces showed clear overreliance on the AI system. Enhanced conversations powered by large language model (LLM) agents amplified over-reliance. Based on our findings, we reason that the potential cause of such overreliance is the illusion of explanatory depth that is concomitant with both XAI interfaces. Our findings have important implications for designing effective conversational XAI interfaces to facilitate appropriate reliance and improve human-AI collaboration. Code can be found at https://github.com/delftcrowd/IUI2025_ConvXAI