Instantiation-based Formalization of Logical Reasoning Tasks using Language Models and Logical Solvers

作者: Mohammad Raza, Natasa Milic-Frayling

分类: cs.AI

发布日期: 2025-01-28 (更新: 2025-07-12)

备注: IJCAI 2025

💡 一句话要点

提出语义自验证(SSV)方法,提升语言模型在逻辑推理任务中的准确性和可靠性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 逻辑推理 语言模型 形式化验证 语义自验证 人工智能 推理系统 鲁棒性 一致性验证

📋 核心要点

- 大型语言模型在逻辑推理方面存在鲁棒性问题,限制了其在实际推理系统中的应用。

- 语义自验证(SSV)方法通过一致性验证,将自然语言推理问题准确形式化为逻辑求解器可处理的形式。

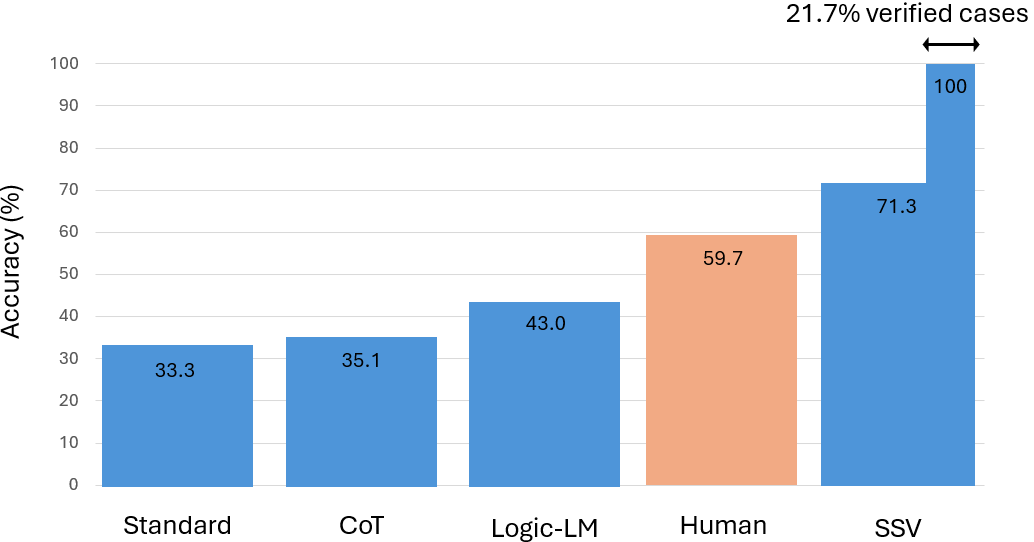

- 实验表明,SSV显著提高了推理准确性,并实现了近乎完美的验证精度,降低了人工干预的需求。

📝 摘要(中文)

大型语言模型在推理方面的鲁棒性仍然是一个重大挑战,解决这个问题对于人工智能驱动的推理系统的实际应用至关重要。我们提出了一种新的方法,即语义自验证(SSV),它解决了将语言模型与逻辑求解器的严谨性相结合的关键挑战:从自然语言到求解器的形式语言,准确地形式化推理问题。SSV使用一种基于一致性的方法,通过模型生成的并由求解器验证的具体实例来产生问题的强抽象形式化。除了显著提高超过现有技术的整体推理准确性之外,这种方法的一个关键创新是验证功能,它在大量案例中具有近乎完美的精度,正如我们在开放推理基准上所展示的那样。我们提出这种近乎确定的推理作为一种新方法,以减少许多情况下对手动验证的需求,使我们更接近更可靠和自主的人工智能推理系统。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在逻辑推理任务中鲁棒性不足的问题。现有方法难以将自然语言描述的推理问题准确地转化为逻辑求解器可以理解的形式化语言,导致推理结果不准确,需要大量人工干预进行验证。

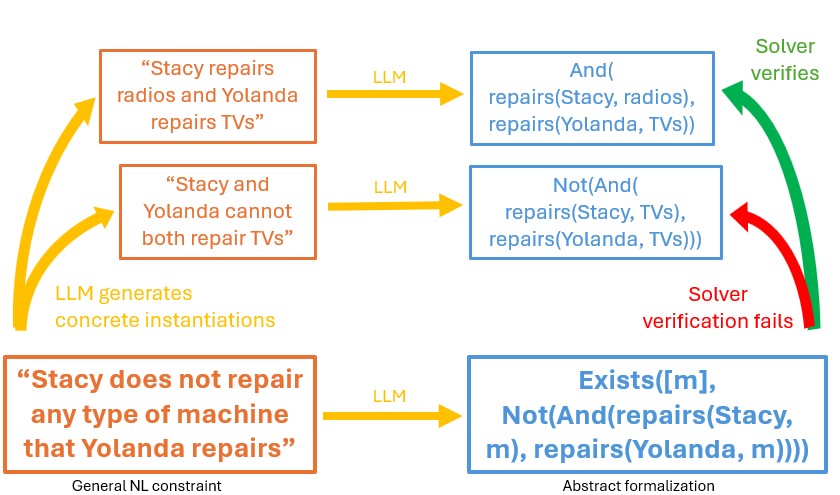

核心思路:论文的核心思路是利用语义自验证(SSV)方法,通过语言模型生成推理问题的具体实例,并使用逻辑求解器对这些实例进行验证,从而保证形式化的准确性。这种方法基于一致性,即如果一个形式化能够正确地解释多个具体实例,那么它就更有可能是正确的。

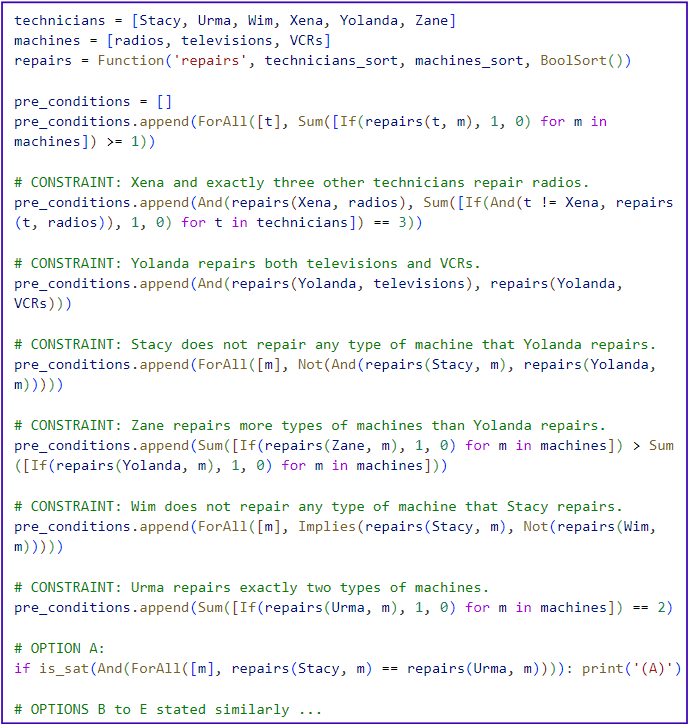

技术框架:SSV方法包含以下主要步骤:1) 语言模型生成推理问题的多个具体实例;2) 将这些实例转化为逻辑求解器可以理解的形式化语言;3) 使用逻辑求解器对这些形式化实例进行验证,判断其是否满足逻辑约束;4) 基于验证结果,选择最一致的形式化作为最终的推理问题表示。

关键创新:SSV方法最重要的创新点在于其验证机制,该机制能够以近乎完美的精度识别正确的形式化,从而显著降低了人工验证的需求。这种“近乎确定的推理”为构建更可靠和自主的人工智能推理系统提供了新的途径。

关键设计:论文中没有明确给出关键的参数设置、损失函数或网络结构等技术细节。但是,该方法依赖于语言模型生成高质量的推理实例,以及逻辑求解器进行准确的验证。因此,选择合适的语言模型和逻辑求解器,并针对特定推理任务进行优化,是至关重要的。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SSV方法在开放推理基准上显著提高了推理准确性,并且验证机制实现了近乎完美的精度。这意味着该方法能够有效地减少人工验证的需求,为构建更可靠和自主的人工智能推理系统奠定了基础。具体的性能数据和对比基线在论文中进行了详细描述(具体数值未知)。

🎯 应用场景

该研究成果可应用于需要高度可靠性和准确性的逻辑推理场景,例如智能合约验证、医疗诊断辅助、法律文本分析等。通过减少人工干预,可以提高推理系统的效率和可扩展性,并降低运营成本。未来,该方法有望推动人工智能在更多关键领域的应用。

📄 摘要(原文)

Robustness of reasoning remains a significant challenge for large language models, and addressing it is essential for the practical applicability of AI-driven reasoning systems. We introduce Semantic Self-Verification (SSV), a novel approach that addresses the key challenge in combining language models with the rigor of logical solvers: to accurately formulate the reasoning problem from natural language to the formal language of the solver. SSV uses a consistency-based approach to produce strong abstract formalizations of problems using concrete instantiations that are generated by the model and verified by the solver. In addition to significantly advancing the overall reasoning accuracy over the state-of-the-art, a key novelty that this approach presents is a feature of verification that has near-perfect precision over a significant coverage of cases, as we demonstrate on open reasoning benchmarks. We propose such near-certain reasoning as a new approach to reduce the need for manual verification in many cases, taking us closer to more dependable and autonomous AI reasoning systems.