Distilling Large Language Models for Network Active Queue Management

作者: Shiva Raj Pokhrel, Deol Satish, Jonathan Kua, Anwar Walid

分类: cs.NI, cs.AI

发布日期: 2025-01-28 (更新: 2025-09-02)

期刊: IEEE Trans on Networking, 2025

💡 一句话要点

提出AQM-LLM,利用大语言模型提升网络主动队列管理性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 主动队列管理 大语言模型 网络拥塞控制 低延迟网络 强化学习 蒸馏训练 L4S 显式拥塞通知

📋 核心要点

- 现有基于深度学习的队列管理方法难以适应动态网络,且需要大量人工工程投入。

- AQM-LLM通过蒸馏大语言模型,利用其上下文理解和模式识别能力,提升主动队列管理性能。

- 实验结果表明,AQM-LLM能够有效防止拥塞,降低延迟,并提升网络整体性能。

📝 摘要(中文)

面对日益复杂的网络流量和对超低延迟通信的需求,更智能的数据包流量管理至关重要。现有的基于深度学习的排队方法难以适应动态网络场景,且需要大量工程投入。本文提出AQM-LLM,通过少样本学习、上下文理解和模式识别等技术,利用大语言模型(LLM)改进主动队列管理(AQM),并最大限度地减少人工干预。本文以低延迟、低损耗和可扩展吞吐量(L4S)的AQM为例,通过显式拥塞通知(ECN)和周期性丢包来解决L4S架构中的拥塞预防问题,基于推测解码和强化学习蒸馏LLM构建AQM-LLM。开发了一个新的开源实验平台,在FreeBSD-14上执行L4S-AQM,提供可互操作的模块以支持LLM集成,并通过更广泛的测试促进IETF的认可。广泛的评估表明,L4S-LLM增强了队列管理,防止了拥塞,降低了延迟,并提高了网络性能,展示了LLM在提升AQM系统方面的适应性和效率。

🔬 方法详解

问题定义:现有基于深度学习的AQM方法在面对动态变化的网络环境时,泛化能力不足,需要大量针对特定场景的工程优化。此外,部署和维护这些模型也需要较高的专业知识和持续的投入。因此,如何设计一种能够适应复杂网络环境,且易于部署和维护的AQM系统是一个关键问题。

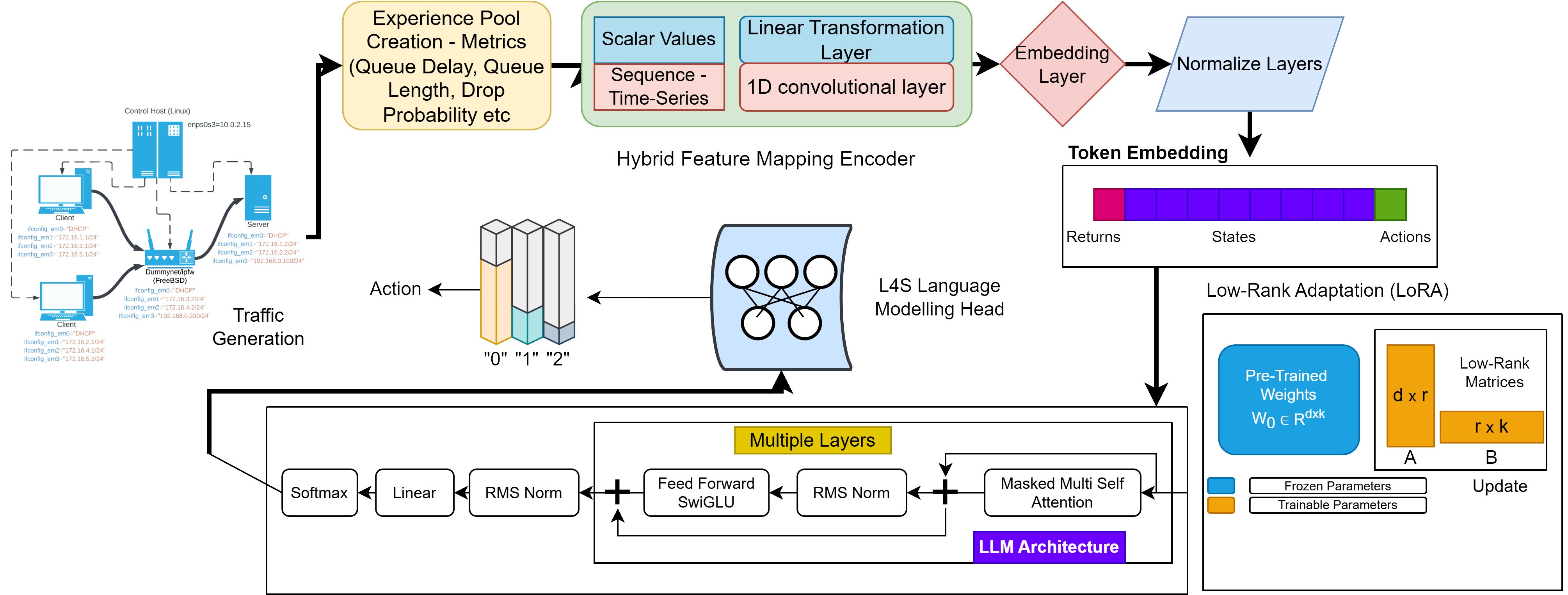

核心思路:本文的核心思路是利用大语言模型(LLM)强大的上下文理解和模式识别能力,通过少量样本学习,使LLM能够理解网络流量模式并做出相应的队列管理决策。通过蒸馏LLM,可以获得一个更小、更高效的模型,适用于网络设备上的部署。

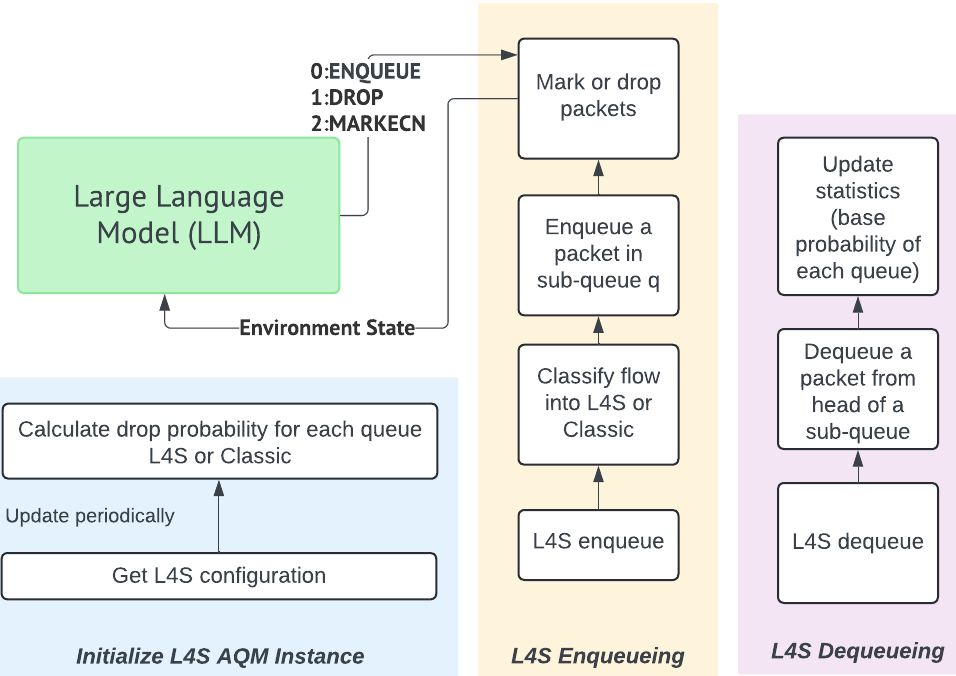

技术框架:AQM-LLM的整体框架包括以下几个主要模块:1) 数据采集模块:负责收集网络流量数据,例如队列长度、数据包到达时间等。2) LLM蒸馏模块:使用少量样本对LLM进行微调或蒸馏,使其适应AQM任务。3) 推理模块:使用蒸馏后的LLM模型进行推理,预测网络拥塞情况,并生成相应的队列管理策略。4) 执行模块:根据LLM的预测结果,调整队列长度、丢包率等参数,实现主动队列管理。

关键创新:本文的关键创新在于将大语言模型引入到网络主动队列管理领域,利用LLM的上下文理解能力来提升AQM的性能。与传统的基于规则或简单机器学习模型的AQM方法相比,AQM-LLM能够更好地适应动态变化的网络环境,并减少人工干预。

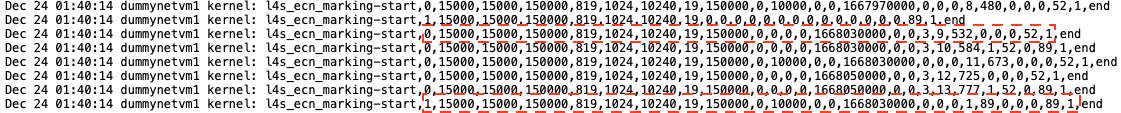

关键设计:在LLM蒸馏过程中,采用了基于强化学习的方法,以优化AQM的性能指标,例如延迟和吞吐量。此外,还使用了推测解码技术,以提高LLM的推理速度。针对L4S架构,AQM-LLM利用显式拥塞通知(ECN)和周期性丢包机制来预防拥塞。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AQM-LLM在L4S场景下能够有效防止拥塞,降低延迟,并提升网络吞吐量。与传统的AQM算法相比,AQM-LLM在动态网络环境下表现出更强的适应性和鲁棒性。具体性能数据(例如延迟降低百分比、吞吐量提升百分比)需要在论文中查找。

🎯 应用场景

AQM-LLM具有广泛的应用前景,可应用于数据中心网络、无线网络、以及各种需要高质量网络服务的场景。通过提升网络拥塞控制能力,可以显著改善用户体验,提高网络资源利用率,并为新兴的低延迟应用(如VR/AR、在线游戏)提供更好的支持。未来,该技术有望集成到路由器、交换机等网络设备中,实现智能化的网络管理。

📄 摘要(原文)

The growing complexity of network traffic and demand for ultra-low latency communication require smarter packet traffic management. Existing Deep Learning-based queuing approaches struggle with dynamic network scenarios and demand high engineering effort. We propose AQM-LLM, distilling Large Language Models (LLMs) with few-shot learning, contextual understanding, and pattern recognition to improve Active Queue Management (AQM) [RFC 9330] with minimal manual effort. We consider a specific case where AQM is Low Latency, Low Loss, and Scalable Throughput (L4S) and our design of AQM-LLM builds on speculative decoding and reinforcement-based distilling of LLM by tackling congestion prevention in the L4S architecture using Explicit Congestion Notification (ECN) [RFC 9331] and periodic packet dropping. We develop a new open-source experimental platform by executing L4S-AQM on FreeBSD-14, providing interoperable modules to support LLM integration and facilitate IETF recognition through wider testing. Our extensive evaluations show L4S-LLM enhances queue management, prevents congestion, reduces latency, and boosts network performance, showcasing LLMs' adaptability and efficiency in uplifting AQM systems.