MetaDecorator: Generating Immersive Virtual Tours through Multimodality

作者: Shuang Xie, Yang Liu, Jeannie S. A. Lee, Haiwei Dong

分类: cs.HC, cs.AI, cs.ET, cs.MM

发布日期: 2025-01-27

💡 一句话要点

MetaDecorator:通过多模态方法生成沉浸式虚拟旅游

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 虚拟旅游 图像合成 文本驱动 个性化定制 沉浸式体验

📋 核心要点

- 现有虚拟旅游缺乏个性化定制,用户体验受限于静态全景图像,沉浸感不足。

- MetaDecorator通过文本提示和图像合成,将静态全景图转化为个性化、视觉丰富的虚拟环境。

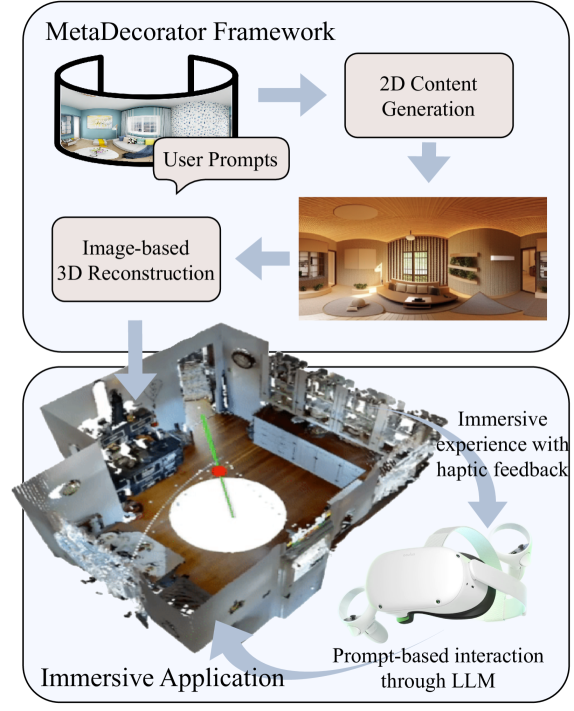

- 该框架集成了大型语言模型和触觉技术,旨在进一步提升VR应用的沉浸式体验。

📝 摘要(中文)

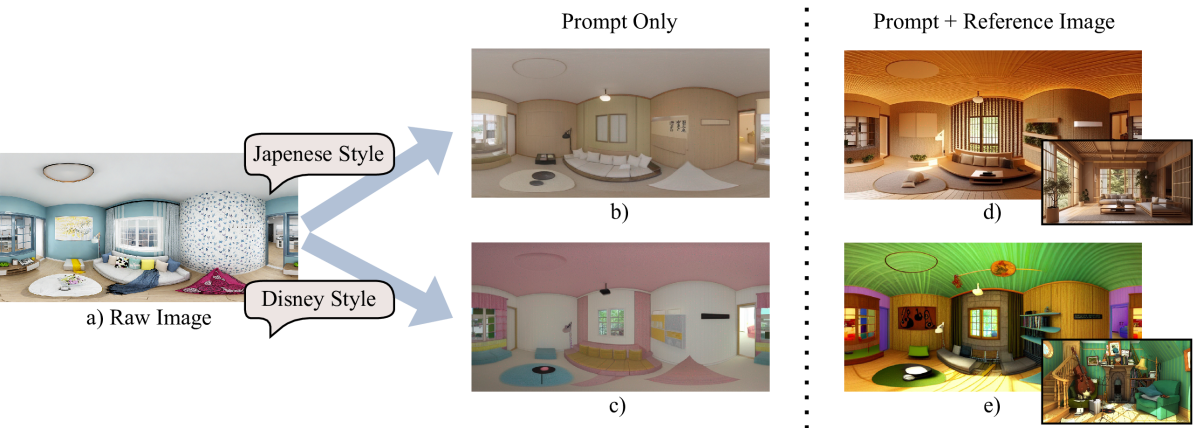

MetaDecorator是一个使用户能够个性化虚拟空间的框架。它利用文本驱动的提示和图像合成技术,装饰由360°成像设备捕获的静态全景图,将其转换为具有独特风格和视觉吸引力的环境。与传统方法相比,这显著提高了虚拟旅游的真实感和参与度。除了核心框架之外,我们还讨论了在VR应用中集成大型语言模型(LLM)和触觉技术,以提供更具沉浸感的体验。

🔬 方法详解

问题定义:现有虚拟旅游体验受限于静态的360°全景图像,缺乏个性化定制和沉浸感。用户无法根据自身喜好改变虚拟环境的风格和内容,导致体验较为单调。现有方法难以将用户的文本描述转化为具体的视觉场景,缺乏有效的图像生成和编辑能力。

核心思路:MetaDecorator的核心思路是利用文本驱动的图像合成技术,将用户的文本提示转化为对静态全景图像的装饰和修改。通过结合大型语言模型和触觉反馈,进一步增强虚拟环境的交互性和沉浸感。该方法旨在弥合文本描述和视觉场景之间的鸿沟,实现个性化虚拟旅游体验。

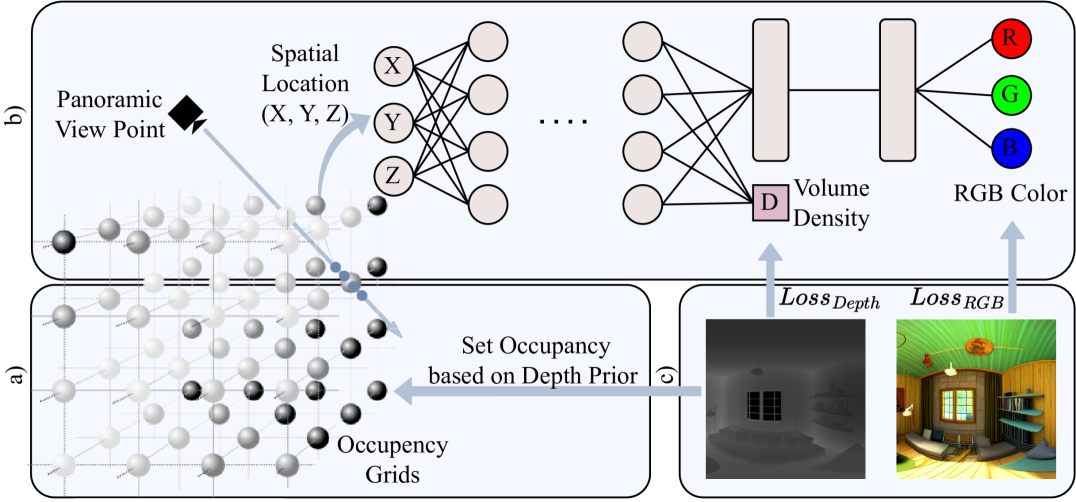

技术框架:MetaDecorator的整体框架包含以下几个主要模块:1) 360°全景图像输入模块:接收由360°成像设备捕获的静态全景图像。2) 文本提示输入模块:接收用户的文本描述,用于指定虚拟环境的风格和内容。3) 图像合成模块:根据文本提示,利用图像合成技术对全景图像进行装饰和修改。4) VR应用集成模块:将生成的个性化虚拟环境集成到VR应用中,提供沉浸式体验。5) 可选的LLM和触觉集成模块:利用大型语言模型增强交互性,利用触觉反馈增强沉浸感。

关键创新:MetaDecorator的关键创新在于将文本驱动的图像合成技术应用于360°全景图像的个性化定制。与传统的虚拟旅游方法相比,MetaDecorator能够根据用户的文本提示动态生成和修改虚拟环境,从而提供更具个性化和沉浸感的体验。此外,集成LLM和触觉反馈也是一个重要的创新点,旨在进一步提升用户体验。

关键设计:具体的技术细节未知,摘要中没有明确说明图像合成的具体方法、损失函数、网络结构等。推测可能使用了扩散模型或GAN等技术,但具体实现细节需要参考论文全文。

🖼️ 关键图片

📊 实验亮点

由于摘要信息有限,无法得知具体的实验数据和性能指标。摘要强调MetaDecorator能够显著提高虚拟旅游的真实感和参与度,但缺乏量化数据支撑。未来研究可以关注用户体验评估、图像合成质量评估等方面,提供更全面的实验结果。

🎯 应用场景

MetaDecorator可广泛应用于虚拟旅游、在线教育、远程协作、游戏娱乐等领域。用户可以根据自身需求定制虚拟环境,例如将静态的博物馆全景图装饰成充满活力的艺术展览,或将远程会议室布置成舒适的居家环境。该技术有望提升用户在虚拟空间中的参与度和沉浸感,促进虚拟现实技术的普及和应用。

📄 摘要(原文)

MetaDecorator, is a framework that empowers users to personalize virtual spaces. By leveraging text-driven prompts and image synthesis techniques, MetaDecorator adorns static panoramas captured by 360° imaging devices, transforming them into uniquely styled and visually appealing environments. This significantly enhances the realism and engagement of virtual tours compared to traditional offerings. Beyond the core framework, we also discuss the integration of Large Language Models (LLMs) and haptics in the VR application to provide a more immersive experience.