A Causality-aware Paradigm for Evaluating Creativity of Multimodal Large Language Models

作者: Zhongzhan Huang, Shanshan Zhong, Pan Zhou, Shanghua Gao, Marinka Zitnik, Liang Lin

分类: cs.AI, cs.HC

发布日期: 2025-01-25 (更新: 2025-02-23)

备注: Accepted by TPAMI. arXiv admin note: text overlap with arXiv:2312.02439

💡 一句话要点

提出LoTbench:一个因果感知的多模态大语言模型创造力评估框架

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 创造力评估 因果推理 大喜利游戏 人机交互

📋 核心要点

- 现有评估方法难以有效评估多模态大语言模型的创造力,因为创造力具有主观性、多样性和数据稀缺性。

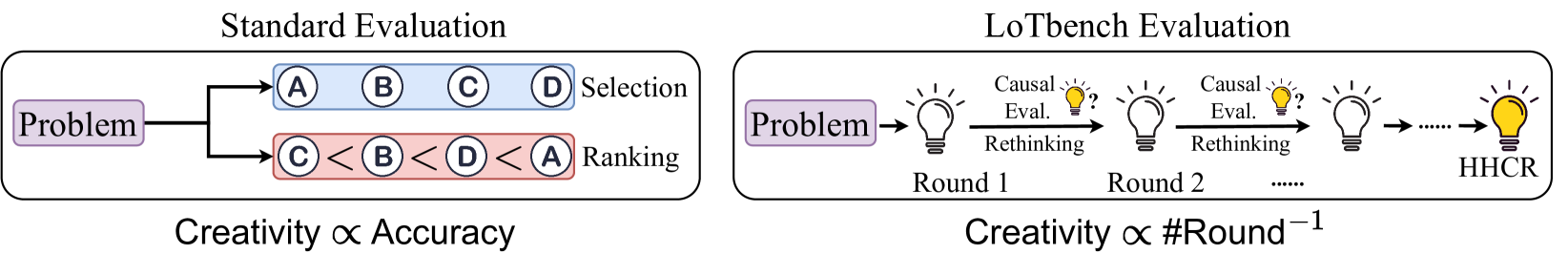

- 论文提出LoTbench,一个交互式的、因果感知的评估框架,通过“大喜利”游戏来量化和可视化MLLM的创造性思维过程。

- 实验表明,LoTbench与人类认知理论更吻合,能有效评估MLLM的创造力,并发现MLLM与人类的创造力差距并非不可逾越。

📝 摘要(中文)

为了评估多模态大语言模型(MLLM)的创造力,本文提出了一种全面的评估流程,重点关注合适的评估平台和方法。首先,作者发现“大喜利”游戏非常适合评估创造力,因为它需要幽默感、联想思维以及对文本、图像或两者的意外回应。该游戏与现代MLLM的输入输出结构一致,并拥有大量高质量、人工标注的创意回应。其次,除了使用“大喜利”游戏进行标准评估(如排序和选择)外,作者还提出了LoTbench,一个交互式的、因果感知的评估框架,以解决标准评估中的信息泄露和可解释性有限等内在风险。LoTbench不仅能更有效地量化MLLM的创造力,还能可视化潜在的创造性思维过程。实验结果表明,虽然大多数MLLM的创造力有限,但MLLM与人类之间的性能差距并非不可逾越。此外,MMMU多模态认知基准测试的结果与LoTbench之间存在很强的相关性,但与传统的创造力指标之间的联系较弱。这表明LoTbench更符合人类认知理论,突出了认知作为创造力早期阶段的关键基础,并能够桥接不同的概念。

🔬 方法详解

问题定义:现有评估方法在评估多模态大语言模型(MLLM)的创造力方面存在挑战。创造力本身具有主观性、多样性和数据稀缺性,使得设计一个客观、可靠的评估体系变得困难。传统的评估方法可能存在信息泄露的风险,并且缺乏对模型创造性思维过程的深入理解。

核心思路:论文的核心思路是利用“大喜利”游戏作为评估MLLM创造力的平台,并在此基础上构建一个交互式的、因果感知的评估框架LoTbench。“大喜利”游戏能够激发幽默感、联想思维和产生意外回应的能力,与创造力的核心要素相符。LoTbench通过因果推理来分析模型的创造性思维过程,从而提高评估的可靠性和可解释性。

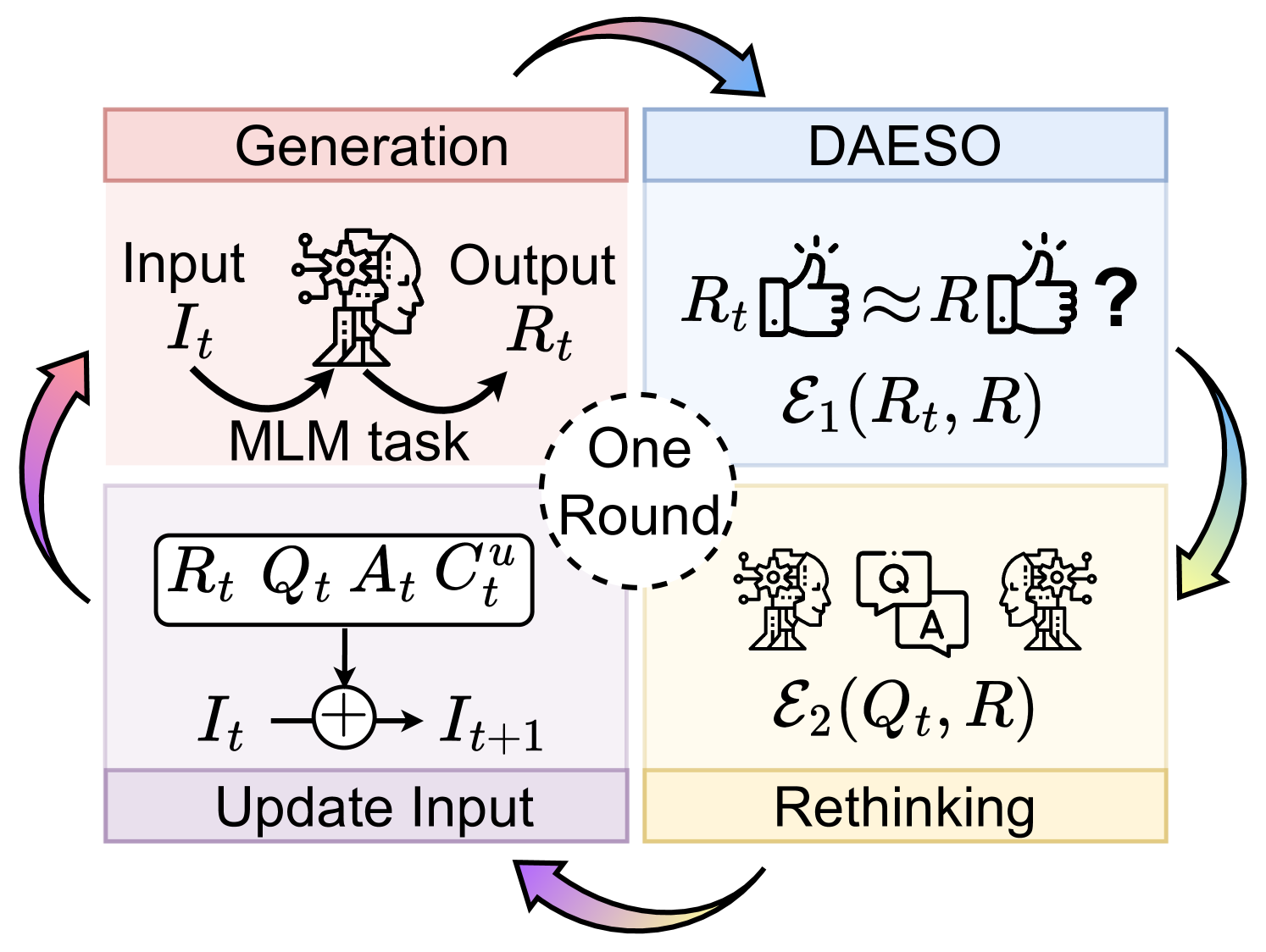

技术框架:LoTbench的整体框架包含以下几个主要模块:1) 大喜利游戏平台:提供文本、图像或两者作为输入,要求MLLM生成创造性的回应。2) 交互式评估界面:允许用户与MLLM进行交互,探索其创造性思维过程。3) 因果推理模块:分析MLLM生成的回应,识别潜在的因果关系,并评估其创造性程度。4) 可视化模块:将MLLM的创造性思维过程可视化,帮助用户理解其内在机制。

关键创新:LoTbench的关键创新在于其因果感知的评估方法。传统的评估方法通常只关注模型的输出结果,而忽略了其背后的思维过程。LoTbench通过因果推理来分析模型的创造性思维过程,从而更全面、深入地评估其创造力。此外,LoTbench的交互式评估界面允许用户与MLLM进行互动,从而更好地理解其创造性能力。

关键设计:LoTbench的关键设计包括:1) 因果推理算法:采用合适的因果推理算法来分析MLLM生成的回应,例如Do-calculus。2) 可视化方法:设计清晰、易懂的可视化方法,将MLLM的创造性思维过程呈现给用户。3) 评估指标:设计合适的评估指标来量化MLLM的创造力,例如新颖性、相关性和幽默感。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LoTbench能够有效评估MLLM的创造力,并且与MMMU多模态认知基准测试的结果具有很强的相关性,但与传统的创造力指标之间的联系较弱。这表明LoTbench更符合人类认知理论。此外,实验还发现,虽然大多数MLLM的创造力有限,但MLLM与人类之间的性能差距并非不可逾越。

🎯 应用场景

该研究成果可应用于多模态大语言模型的创造力评估与提升,例如,可以用于优化模型的训练目标,提高其在创意生成任务中的表现。此外,LoTbench框架可以推广到其他需要创造力的应用场景,如广告文案生成、艺术创作等,具有广泛的应用前景。

📄 摘要(原文)

Recently, numerous benchmarks have been developed to evaluate the logical reasoning abilities of large language models (LLMs). However, assessing the equally important creative capabilities of LLMs is challenging due to the subjective, diverse, and data-scarce nature of creativity, especially in multimodal scenarios. In this paper, we consider the comprehensive pipeline for evaluating the creativity of multimodal LLMs, with a focus on suitable evaluation platforms and methodologies. First, we find the Oogiri game, a creativity-driven task requiring humor, associative thinking, and the ability to produce unexpected responses to text, images, or both. This game aligns well with the input-output structure of modern multimodal LLMs and benefits from a rich repository of high-quality, human-annotated creative responses, making it an ideal platform for studying LLM creativity. Next, beyond using the Oogiri game for standard evaluations like ranking and selection, we propose LoTbench, an interactive, causality-aware evaluation framework, to further address some intrinsic risks in standard evaluations, such as information leakage and limited interpretability. The proposed LoTbench not only quantifies LLM creativity more effectively but also visualizes the underlying creative thought processes. Our results show that while most LLMs exhibit constrained creativity, the performance gap between LLMs and humans is not insurmountable. Furthermore, we observe a strong correlation between results from the multimodal cognition benchmark MMMU and LoTbench, but only a weak connection with traditional creativity metrics. This suggests that LoTbench better aligns with human cognitive theories, highlighting cognition as a critical foundation in the early stages of creativity and enabling the bridging of diverse concepts. https://lotbench.github.io