Data Center Cooling System Optimization Using Offline Reinforcement Learning

作者: Xianyuan Zhan, Xiangyu Zhu, Peng Cheng, Xiao Hu, Ziteng He, Hanfei Geng, Jichao Leng, Huiwen Zheng, Chenhui Liu, Tianshun Hong, Yan Liang, Yunxin Liu, Feng Zhao

分类: cs.AI, cs.LG, eess.SY

发布日期: 2025-01-25 (更新: 2025-02-14)

备注: Accepted in ICLR 2025

💡 一句话要点

提出基于物理信息的离线强化学习框架,优化数据中心冷却系统能耗。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 离线强化学习 数据中心 冷却系统优化 图神经网络 物理信息

📋 核心要点

- 数据中心冷却系统能耗巨大,优化面临缺乏仿真环境、数据有限和安全要求高等挑战。

- 提出基于物理信息的离线强化学习框架,利用图神经网络建模数据中心动态模式,实现高效策略学习。

- 在实际数据中心部署验证,实现14%~21%的节能,且满足安全约束,展示了离线强化学习的潜力。

📝 摘要(中文)

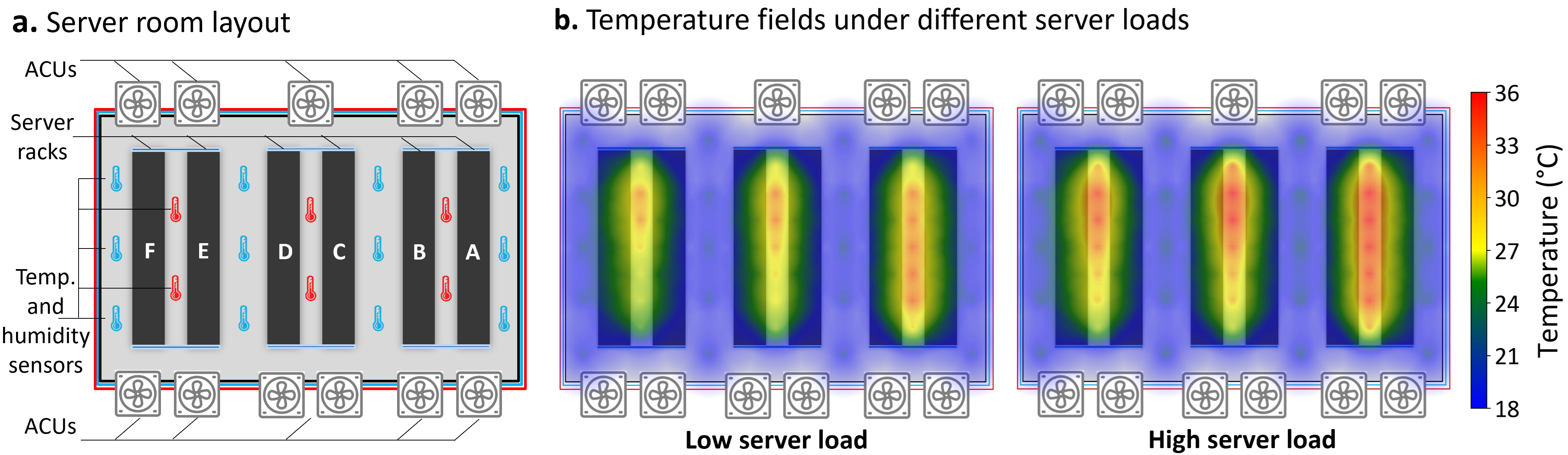

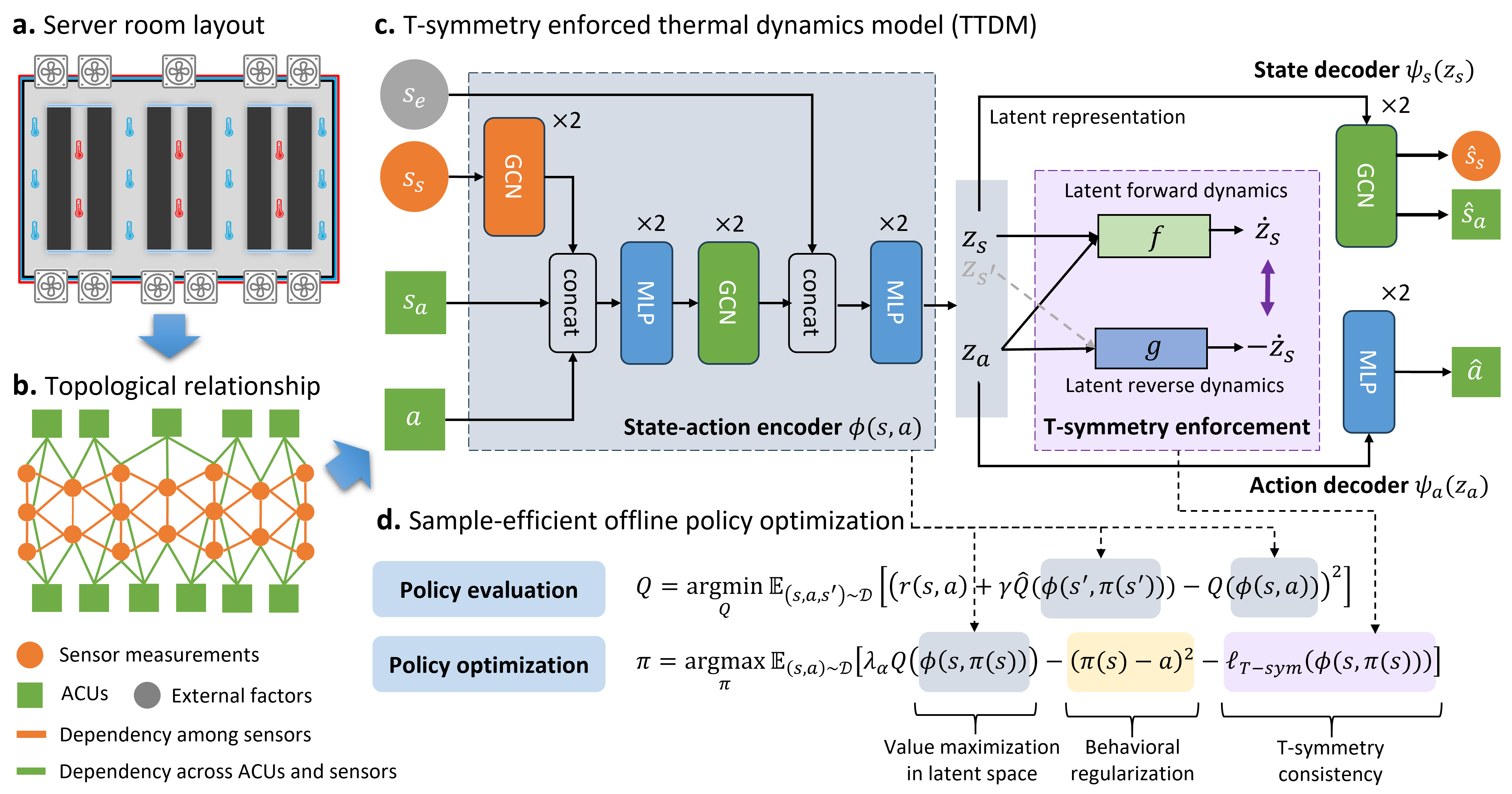

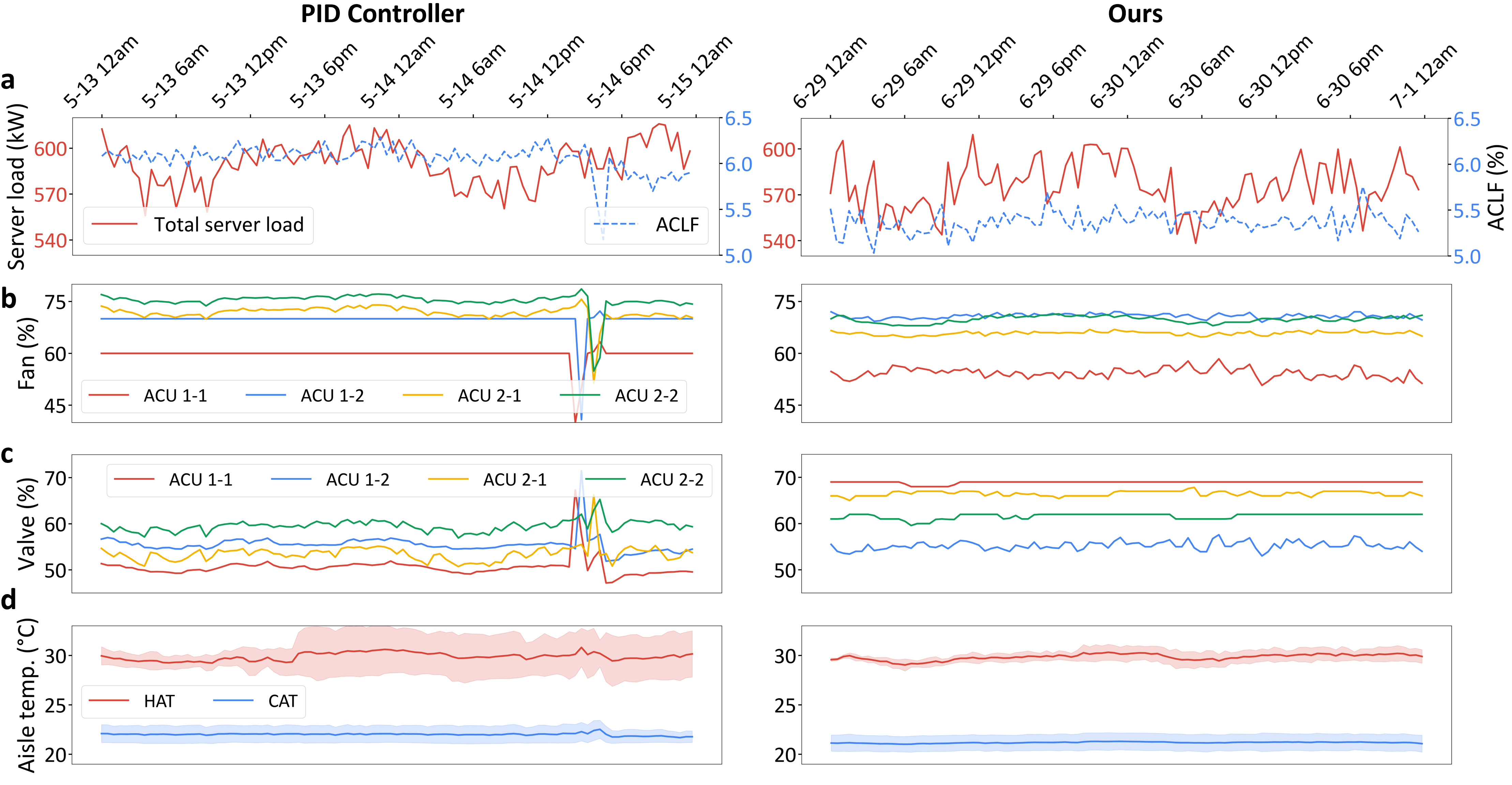

信息技术和人工智能的快速发展推动了全球数据中心(DC)产业的扩张,同时也带来了对电力的巨大需求。在典型的数据中心中,约30%~40%的能源消耗在冷却系统上,而非计算机服务器,因此迫切需要开发新的节能优化技术。然而,优化这种实际工业系统面临诸多挑战,包括缺乏可靠的仿真环境、有限的历史数据以及严格的安全和控制鲁棒性要求。本文提出了一种新颖的基于物理信息的离线强化学习(RL)框架,用于数据中心冷却系统的能效优化。该框架使用专门设计的图神经网络架构对服务器机房内复杂的动态模式和物理依赖关系进行建模,该架构符合基本的时间反演对称性。由于其良好且可泛化的状态-动作表示,该模型能够使用有限的真实世界运行数据进行样本高效且鲁棒的潜在空间离线策略学习。我们的框架已成功部署并在大型生产数据中心中进行了验证,用于空调机组(ACU)的闭环控制。我们在生产数据中心环境中进行了总计2000小时的短期和长期实验。结果表明,我们的方法在数据中心冷却系统中实现了14%~21%的节能,且没有违反任何安全或操作约束。我们的结果证明了离线强化学习在解决广泛的数据受限、安全关键的现实工业控制问题方面的巨大潜力。

🔬 方法详解

问题定义:论文旨在解决数据中心冷却系统能耗高的问题。现有方法依赖于在线强化学习,需要大量的探索和试错,在实际数据中心中部署风险高,且缺乏可靠的仿真环境和足够的数据支持。因此,如何在数据有限、安全约束严格的条件下,优化数据中心冷却系统的能耗是一个关键问题。

核心思路:论文的核心思路是利用离线强化学习,从已有的历史数据中学习最优的冷却策略,避免在线探索带来的风险。同时,为了提高学习效率和泛化能力,引入物理信息,利用图神经网络对数据中心内部的复杂动态模式和物理依赖关系进行建模。

技术框架:整体框架包含以下几个主要模块:1) 数据收集:收集数据中心的历史运行数据,包括温度、湿度、空调机组状态等。2) 图神经网络建模:构建图神经网络,对数据中心内部的物理关系进行建模,学习状态和动作的表示。3) 离线策略学习:利用收集到的数据和图神经网络学习到的表示,使用离线强化学习算法训练冷却策略。4) 策略部署:将学习到的策略部署到实际的数据中心冷却系统中,进行闭环控制。

关键创新:最重要的技术创新点在于将物理信息融入到离线强化学习中。通过图神经网络对数据中心内部的物理关系进行建模,可以提高学习效率和泛化能力。此外,该图神经网络架构符合基本的时间反演对称性,进一步增强了模型的稳定性和可靠性。与现有方法相比,该方法无需在线探索,降低了部署风险,且能够利用有限的数据进行高效学习。

关键设计:论文中图神经网络的具体结构未知,但强调了其符合时间反演对称性。离线强化学习算法的具体选择未知,但强调了其在潜在空间中的应用,以提高样本效率和鲁棒性。损失函数的设计也未知,但可以推测其会考虑冷却系统的能耗、安全约束等因素。

🖼️ 关键图片

📊 实验亮点

该方法在实际大规模生产数据中心进行了部署和验证,通过2000小时的实验,实现了14%~21%的冷却系统节能,并且没有违反任何安全或操作约束。这一结果表明了该方法在实际应用中的有效性和可靠性,远超传统优化方法。

🎯 应用场景

该研究成果可广泛应用于数据中心冷却系统的节能优化,降低运营成本,减少碳排放。此外,该方法也可推广到其他工业控制领域,如智能楼宇、智能工厂等,解决数据受限、安全关键的控制问题,具有重要的实际应用价值和推广前景。

📄 摘要(原文)

The recent advances in information technology and artificial intelligence have fueled a rapid expansion of the data center (DC) industry worldwide, accompanied by an immense appetite for electricity to power the DCs. In a typical DC, around 30~40% of the energy is spent on the cooling system rather than on computer servers, posing a pressing need for developing new energy-saving optimization technologies for DC cooling systems. However, optimizing such real-world industrial systems faces numerous challenges, including but not limited to a lack of reliable simulation environments, limited historical data, and stringent safety and control robustness requirements. In this work, we present a novel physics-informed offline reinforcement learning (RL) framework for energy efficiency optimization of DC cooling systems. The proposed framework models the complex dynamical patterns and physical dependencies inside a server room using a purposely designed graph neural network architecture that is compliant with the fundamental time-reversal symmetry. Because of its well-behaved and generalizable state-action representations, the model enables sample-efficient and robust latent space offline policy learning using limited real-world operational data. Our framework has been successfully deployed and verified in a large-scale production DC for closed-loop control of its air-cooling units (ACUs). We conducted a total of 2000 hours of short and long-term experiments in the production DC environment. The results show that our method achieves 14~21% energy savings in the DC cooling system, without any violation of the safety or operational constraints. Our results have demonstrated the significant potential of offline RL in solving a broad range of data-limited, safety-critical real-world industrial control problems.