Causal Graphs Meet Thoughts: Enhancing Complex Reasoning in Graph-Augmented LLMs

作者: Hang Luo, Jian Zhang, Chujun Li

分类: cs.AI, cs.CL

发布日期: 2025-01-24 (更新: 2025-03-17)

备注: 18 pages, 3 figures, 3 tables

💡 一句话要点

提出因果图增强的图RAG方法,提升LLM在知识密集型任务中的复杂推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 因果图谱 图检索增强生成 知识密集型任务 大型语言模型 思维链 医疗问答 可解释性

📋 核心要点

- 现有Graph RAG方法在知识密集型任务中,无法有效捕捉因果关系,导致LLM推理能力受限。

- 论文提出一种新的Graph RAG流程,通过强调因果关系边和对齐思维链来增强LLM的推理能力。

- 在医疗问答任务上的实验表明,该方法在多个LLM上实现了高达10%的性能提升。

📝 摘要(中文)

在知识密集型任务中,尤其是在医疗和法律等高风险领域,不仅需要检索相关信息,还需要提供因果推理和可解释性。大型语言模型(LLM)在自然语言理解和生成任务中取得了显著的性能。然而,它们常常面临一些局限性,例如难以整合新知识、产生幻觉以及解释其推理过程。为了解决这些挑战,将知识图谱与图检索增强生成(Graph RAG)相结合已成为一种有效的解决方案。传统的Graph RAG方法通常依赖于简单的图遍历或语义相似性,无法捕捉因果关系或与模型的内部推理步骤很好地对齐。本文提出了一种新的流程,该流程过滤大型知识图谱以强调因果关系边,使检索过程与模型的思维链(CoT)对齐,并通过多阶段路径改进来增强推理。在医疗问答任务上的实验表明,该方法取得了持续的收益,在多个大型语言模型(LLM)上实现了高达10%的绝对改进。该方法证明了将因果推理与逐步检索相结合的价值,从而为复杂查询提供更具可解释性和逻辑基础的解决方案。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在知识密集型任务中,特别是医疗问答等需要因果推理的场景下,由于无法有效利用知识图谱中的因果关系而导致的推理能力不足的问题。现有Graph RAG方法主要依赖于简单的图遍历或语义相似性,忽略了知识图谱中蕴含的丰富因果信息,导致检索到的信息与LLM的推理过程不匹配,影响了最终的问答效果。

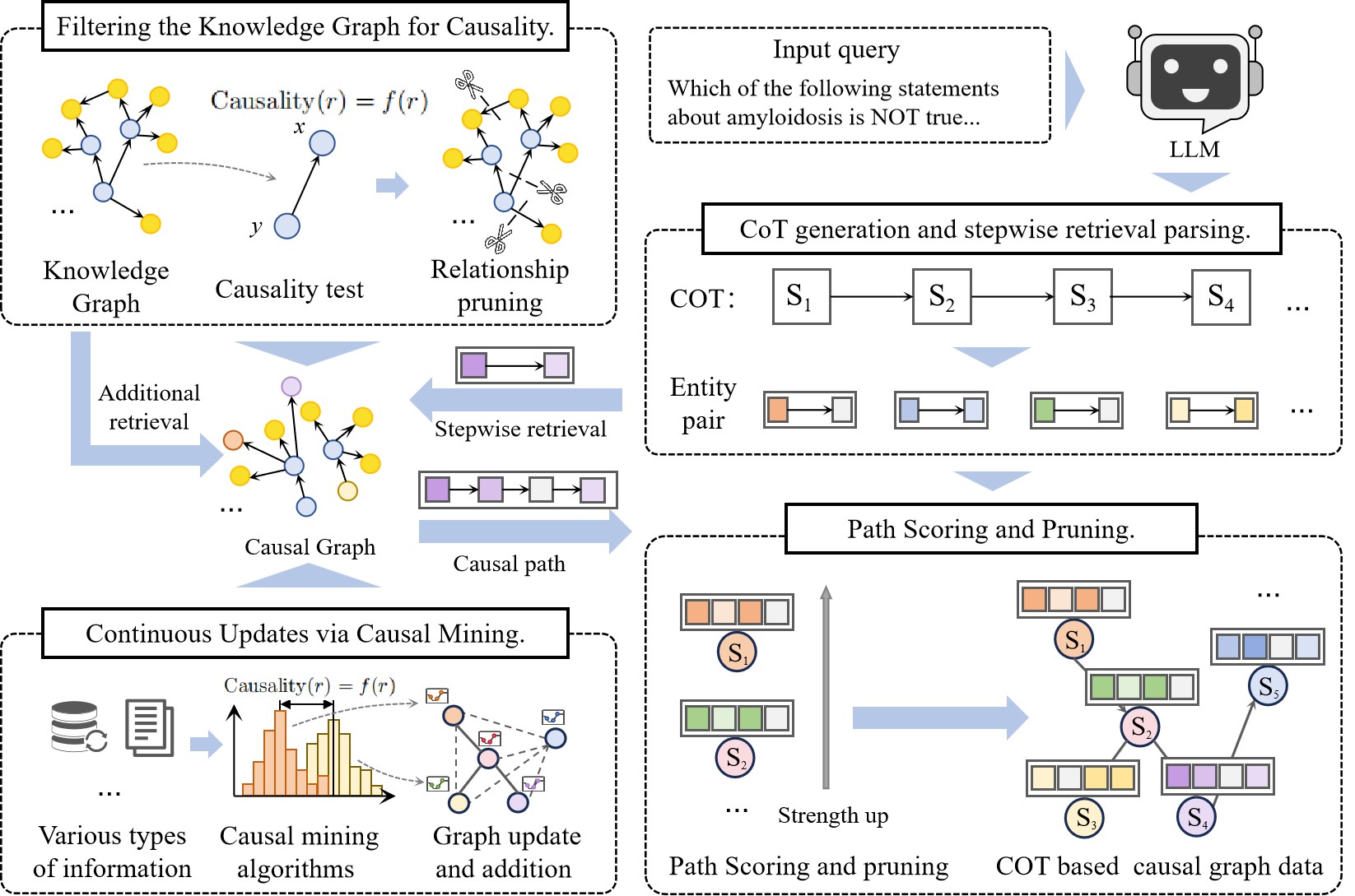

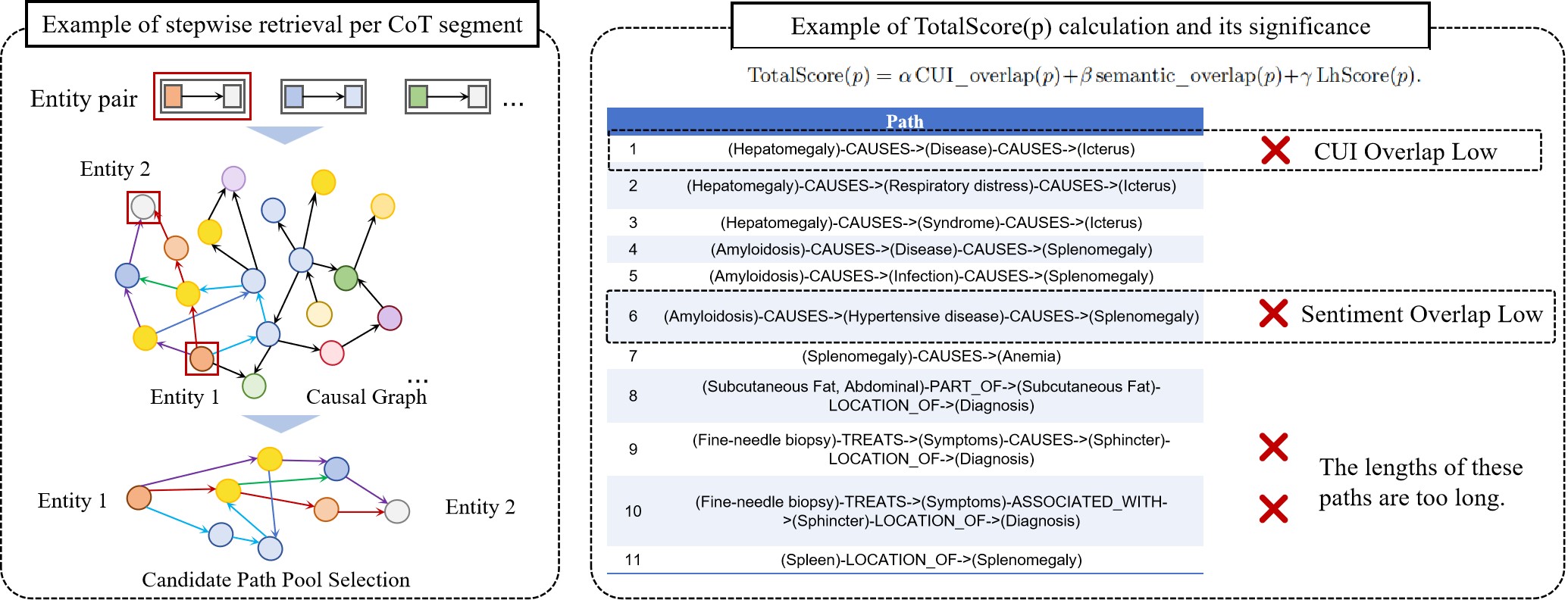

核心思路:论文的核心思路是通过构建因果关系驱动的Graph RAG流程,将知识图谱中的因果关系显式地引入到LLM的推理过程中。具体来说,首先对知识图谱进行过滤,突出因果关系边;然后,将检索过程与LLM的思维链(Chain-of-Thought, CoT)对齐,确保检索到的信息能够支持LLM的逐步推理;最后,通过多阶段路径改进,进一步优化推理路径,提高推理的准确性和可解释性。

技术框架:该方法包含以下几个主要阶段:1) 因果图谱构建:从原始知识图谱中提取或构建因果关系图谱,强调原因和结果之间的连接。2) 思维链对齐的检索:根据LLM的思维链,逐步检索相关的知识图谱子图,确保检索到的信息与LLM的推理步骤相匹配。3) 多阶段路径改进:通过迭代优化推理路径,提高推理的准确性和可解释性。具体实现细节未知。

关键创新:该方法最重要的创新点在于将因果推理与Graph RAG相结合,通过显式地引入因果关系,增强了LLM在知识密集型任务中的推理能力。与传统的Graph RAG方法相比,该方法更加注重知识图谱中的因果信息,能够更好地支持LLM的逐步推理,从而提高问答的准确性和可解释性。

关键设计:论文中关于具体的技术细节描述较少,例如如何进行因果图谱构建,如何实现思维链对齐的检索,以及如何进行多阶段路径改进等。这些细节的设计将直接影响到该方法的性能。具体的参数设置、损失函数、网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

该论文在医疗问答任务上进行了实验,结果表明,该方法在多个大型语言模型(LLM)上实现了高达10%的绝对改进。这表明将因果推理与逐步检索相结合能够显著提升LLM在知识密集型任务中的性能。具体的基线模型和数据集信息未知。

🎯 应用场景

该研究成果可广泛应用于医疗、法律、金融等知识密集型领域,提升LLM在复杂问题上的推理和决策能力。例如,在医疗诊断中,可以帮助医生更准确地诊断疾病并制定治疗方案;在法律咨询中,可以为律师提供更全面的法律依据和案例分析。该研究还有助于提高LLM的可解释性,增强用户对LLM的信任。

📄 摘要(原文)

In knowledge-intensive tasks, especially in high-stakes domains like medicine and law, it is critical not only to retrieve relevant information but also to provide causal reasoning and explainability. Large language models (LLMs) have achieved remarkable performance in natural language understanding and generation tasks. However, they often suffer from limitations such as difficulty in incorporating new knowledge, generating hallucinations, and explaining their reasoning process. To address these challenges, integrating knowledge graphs with Graph Retrieval-Augmented Generation (Graph RAG) has emerged as an effective solution. Traditional Graph RAG methods often rely on simple graph traversal or semantic similarity, which do not capture causal relationships or align well with the model's internal reasoning steps. This paper proposes a novel pipeline that filters large knowledge graphs to emphasize cause-effect edges, aligns the retrieval process with the model's chain-of-thought (CoT), and enhances reasoning through multi-stage path improvements. Experiments on medical question-answering tasks show consistent gains, with up to a 10\% absolute improvement across multiple large language models (LLMs). This approach demonstrates the value of combining causal reasoning with stepwise retrieval, leading to more interpretable and logically grounded solutions for complex queries.