A Zero-Shot LLM Framework for Automatic Assignment Grading in Higher Education

作者: Calvin Yeung, Jeff Yu, King Chau Cheung, Tat Wing Wong, Chun Man Chan, Kin Chi Wong, Keisuke Fujii

分类: cs.CY, cs.AI

发布日期: 2025-01-24

💡 一句话要点

提出一种零样本LLM框架,用于高等教育中自动作业评分。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动评分 大型语言模型 零样本学习 提示工程 教育技术

📋 核心要点

- 现有自动评分系统依赖大量数据进行训练,且缺乏个性化反馈,更侧重于基准测试表现。

- 论文提出零样本LLM自动评分框架,利用提示工程评估学生回答,无需额外训练或微调。

- 实验表明,该系统能有效提高学生的学习动机、理解力和准备程度,优于传统评分方法。

📝 摘要(中文)

自动评分已成为教育技术中的重要工具,能够高效评估大量学生作业,提供一致且无偏的评估,并提供即时反馈以增强学习。然而,当前的系统面临重大限制,包括在少样本学习方法中需要大型数据集,缺乏个性化和可操作的反馈,以及过度强调基准性能而非学生体验。为了应对这些挑战,我们提出了一种基于零样本大型语言模型(LLM)的自动作业评分(AAG)系统。该框架利用提示工程来评估计算型和解释型学生回答,而无需额外的训练或微调。AAG系统提供定制化的反馈,突出个人优势和需要改进的领域,从而提高学生的学习成果。我们的研究通过全面的评估证明了该系统的有效性,包括高等教育学生的调查回复,表明与传统评分方法相比,学生的积极性、理解力和准备程度都有显著提高。结果验证了AAG系统通过优先考虑学习体验和提供可扩展的高质量反馈来改变教育评估的潜力。

🔬 方法详解

问题定义:现有自动评分系统需要大量标注数据进行训练,这在实际应用中成本很高。此外,现有系统提供的反馈通常不够个性化和具体,难以有效帮助学生改进。现有方法也更关注在特定数据集上的基准测试性能,而忽略了学生的实际学习体验。

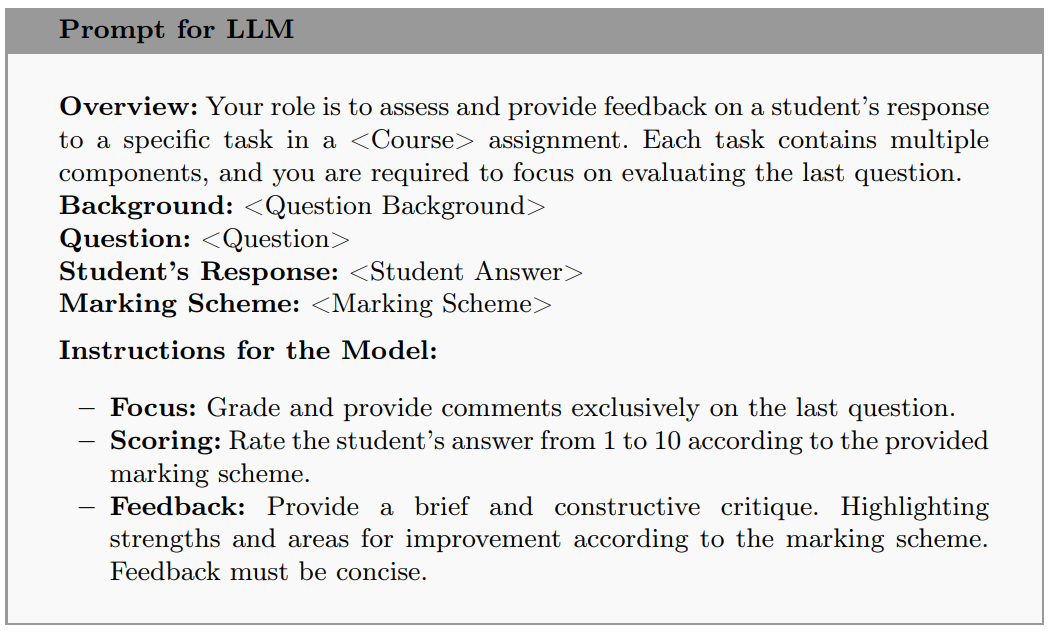

核心思路:论文的核心思路是利用大型语言模型(LLM)的零样本学习能力,通过精心设计的提示(Prompt Engineering)来指导LLM对学生的作业进行评估和反馈。这种方法避免了对大量标注数据的依赖,并且可以通过调整提示来提供更个性化和可操作的反馈。

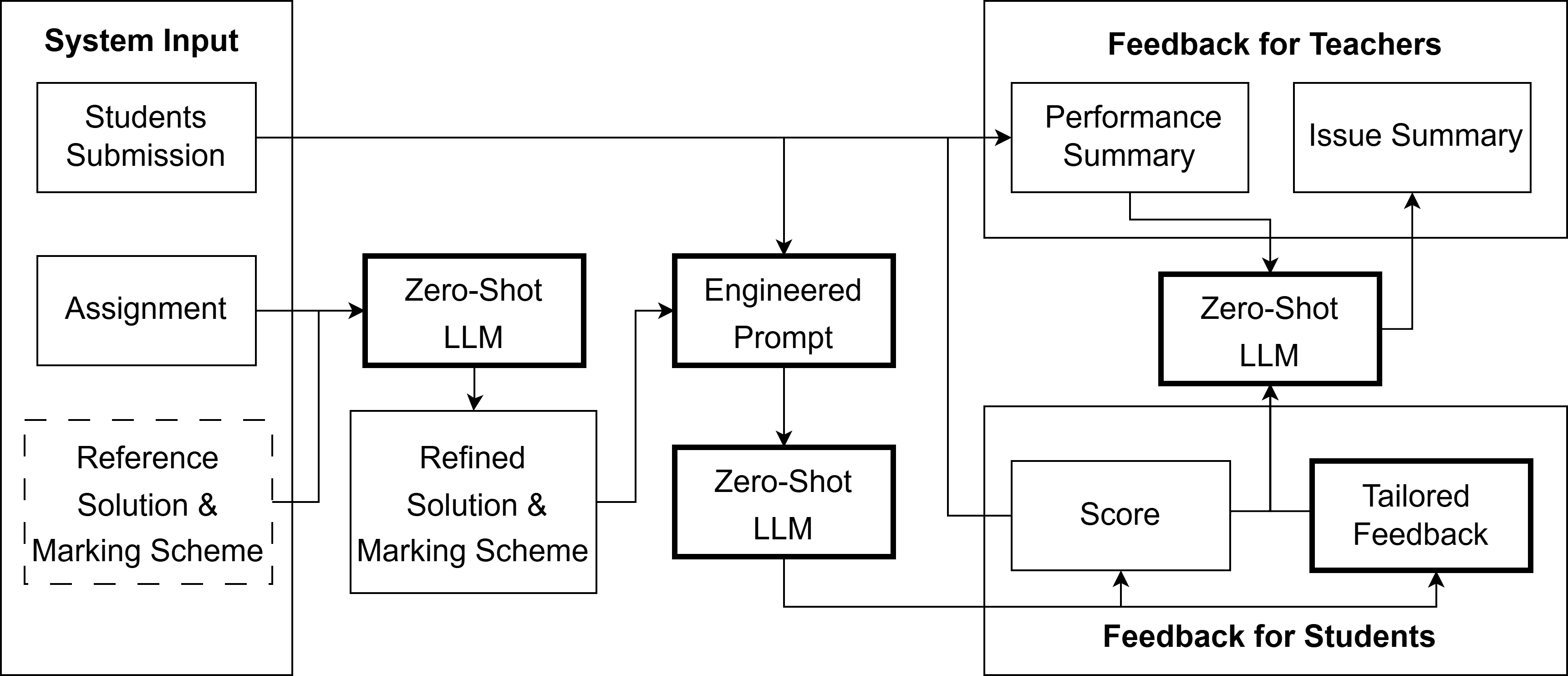

技术框架:该AAG系统的整体框架主要包含以下几个阶段:1) 输入学生答案:系统接收学生提交的作业答案,包括计算型和解释型答案。2) 提示工程:根据作业类型和评分标准,设计合适的提示,引导LLM进行评估。3) LLM推理:将学生答案和提示输入LLM,LLM根据提示生成评分和反馈。4) 输出评分和反馈:系统将LLM生成的评分和反馈呈现给学生。

关键创新:该论文的关键创新在于将零样本学习应用于自动作业评分,并利用提示工程来提高LLM的评估能力。与传统的监督学习方法相比,该方法无需大量标注数据,具有更高的灵活性和可扩展性。此外,该系统能够提供更个性化和可操作的反馈,从而更好地帮助学生学习。

关键设计:论文中关于提示工程的具体设计是关键。例如,提示可能包含以下信息:作业的评分标准、期望的答案格式、以及一些示例答案。此外,论文可能还探索了不同的提示策略,例如链式思考(Chain-of-Thought)提示,以提高LLM的推理能力。具体的参数设置和网络结构取决于所使用的LLM,论文可能对LLM的选择和配置进行了优化。

🖼️ 关键图片

📊 实验亮点

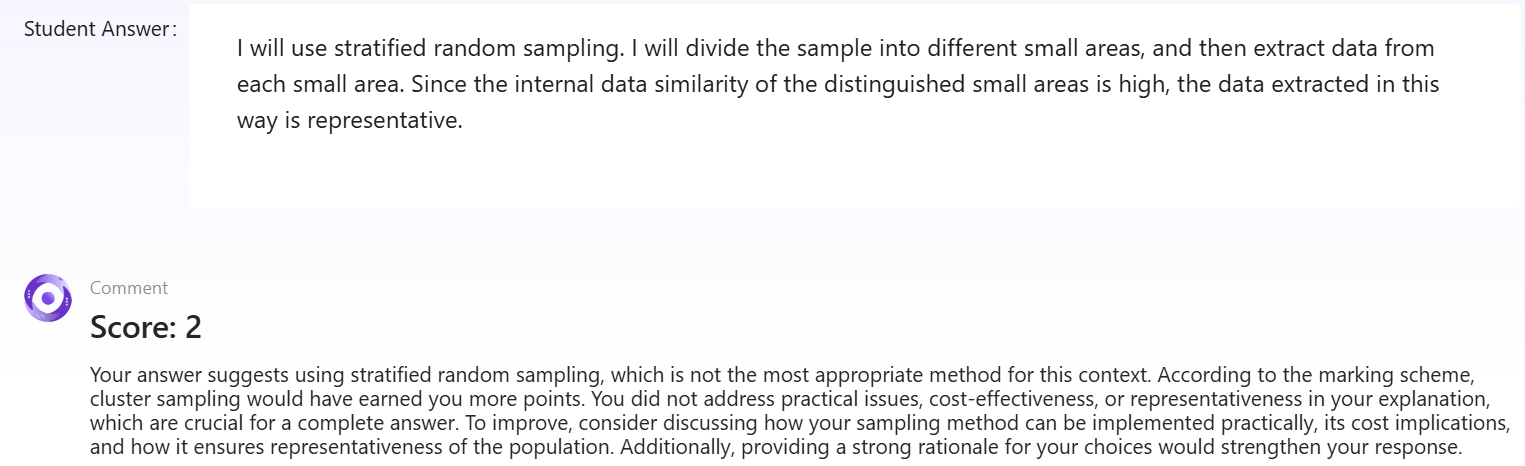

该研究通过学生调查表明,与传统评分方法相比,使用AAG系统后,学生的学习动机、理解力和准备程度都有显著提高。具体性能数据(例如评分准确率、反馈质量等)和对比基线(例如人工评分、其他自动评分系统)的具体数值未知,但学生的主观反馈表明该系统具有显著优势。

🎯 应用场景

该研究成果可广泛应用于高等教育和在线教育平台,实现大规模作业的自动评分和个性化反馈。有助于教师减轻评分负担,提升教学效率,并为学生提供及时有效的学习支持。未来,该技术还可扩展到其他类型的评估任务,如论文批改、代码审查等。

📄 摘要(原文)

Automated grading has become an essential tool in education technology due to its ability to efficiently assess large volumes of student work, provide consistent and unbiased evaluations, and deliver immediate feedback to enhance learning. However, current systems face significant limitations, including the need for large datasets in few-shot learning methods, a lack of personalized and actionable feedback, and an overemphasis on benchmark performance rather than student experience. To address these challenges, we propose a Zero-Shot Large Language Model (LLM)-Based Automated Assignment Grading (AAG) system. This framework leverages prompt engineering to evaluate both computational and explanatory student responses without requiring additional training or fine-tuning. The AAG system delivers tailored feedback that highlights individual strengths and areas for improvement, thereby enhancing student learning outcomes. Our study demonstrates the system's effectiveness through comprehensive evaluations, including survey responses from higher education students that indicate significant improvements in motivation, understanding, and preparedness compared to traditional grading methods. The results validate the AAG system's potential to transform educational assessment by prioritizing learning experiences and providing scalable, high-quality feedback.