Adaptive Testing for LLM-Based Applications: A Diversity-based Approach

作者: Juyeon Yoon, Robert Feldt, Shin Yoo

分类: cs.SE, cs.AI

发布日期: 2025-01-23

备注: 9 pages

💡 一句话要点

提出基于多样性的自适应测试方法,优化LLM应用Prompt模板测试。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM测试 自适应测试 多样性测试 Prompt模板 软件测试

📋 核心要点

- 现有LLM应用测试框架缺乏对测试套件的优化,导致测试成本高昂且效率低下。

- 提出基于多样性的自适应测试方法,利用字符串距离度量指导测试用例的选择,提升测试效率。

- 实验结果表明,该方法能以更少的测试预算发现更多故障,并生成更多样化的输出。

📝 摘要(中文)

随着基于大型语言模型(LLM)的软件系统激增,涌现了各种测试框架,它们主要将Prompt模板作为测试单元。然而,测试输入执行和输出评估的成本很高,但这些工具中优化测试套件的构建却被忽视,因此需要定制的测试选择或优先级排序策略。本文表明,基于多样性的测试技术,例如具有适当字符串距离度量的自适应随机测试(ART),可以有效地应用于Prompt模板的测试。我们提出的自适应测试方法通过基于现有测试套件及其标注结果的分数来选择新的测试输入,从而调整传统的ART过程。我们的结果,通过探索几种基于字符串的距离的各种实现获得,证实了我们的方法能够以更少的测试预算发现故障,并促进更多样化的输出生成。

🔬 方法详解

问题定义:论文旨在解决LLM应用中Prompt模板测试的效率问题。现有测试方法在构建测试套件时缺乏优化,导致测试成本高昂,且可能无法充分覆盖各种可能的输入情况,从而难以有效发现潜在的故障。现有方法的痛点在于,没有充分利用已有的测试结果来指导后续测试用例的选择,导致测试资源的浪费。

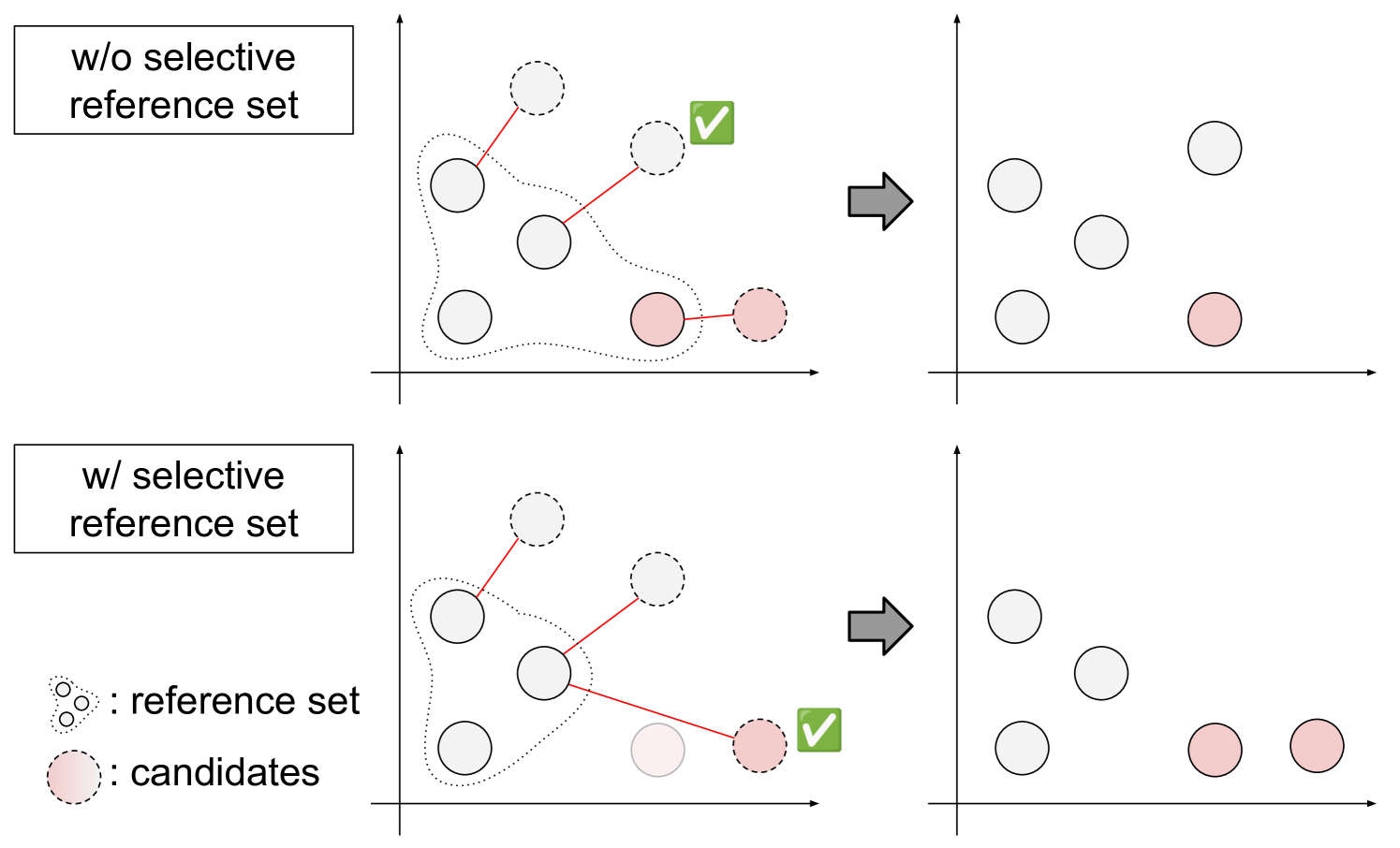

核心思路:论文的核心思路是利用基于多样性的自适应测试(ART)方法,根据已有的测试结果动态调整测试用例的选择策略。通过计算新测试用例与现有测试套件的距离,选择那些能够最大程度增加测试套件多样性的用例,从而更有效地覆盖不同的输入空间,并提高发现故障的概率。

技术框架:该方法基于传统的ART框架,并针对Prompt模板测试进行了调整。整体流程如下:1) 初始化一个小的测试套件;2) 迭代地选择新的测试用例;3) 对于每个候选测试用例,计算其与现有测试套件的距离;4) 根据距离得分选择最佳的测试用例加入测试套件;5) 执行测试并评估结果;6) 重复步骤2-5,直到达到预定的测试预算。

关键创新:该方法最重要的创新点在于将多样性度量引入到LLM应用的Prompt模板测试中。通过自适应地选择测试用例,能够更有效地覆盖输入空间,并提高发现故障的概率。与传统的随机测试相比,该方法能够更智能地利用已有的测试结果,从而提高测试效率。

关键设计:该方法使用了多种基于字符串的距离度量,例如编辑距离、余弦相似度等,来衡量测试用例之间的差异。选择合适的距离度量对于测试效果至关重要。此外,该方法还引入了一个评分函数,用于综合考虑测试用例的距离和已有的测试结果,从而选择最佳的测试用例。具体的参数设置和评分函数需要根据具体的应用场景进行调整。

🖼️ 关键图片

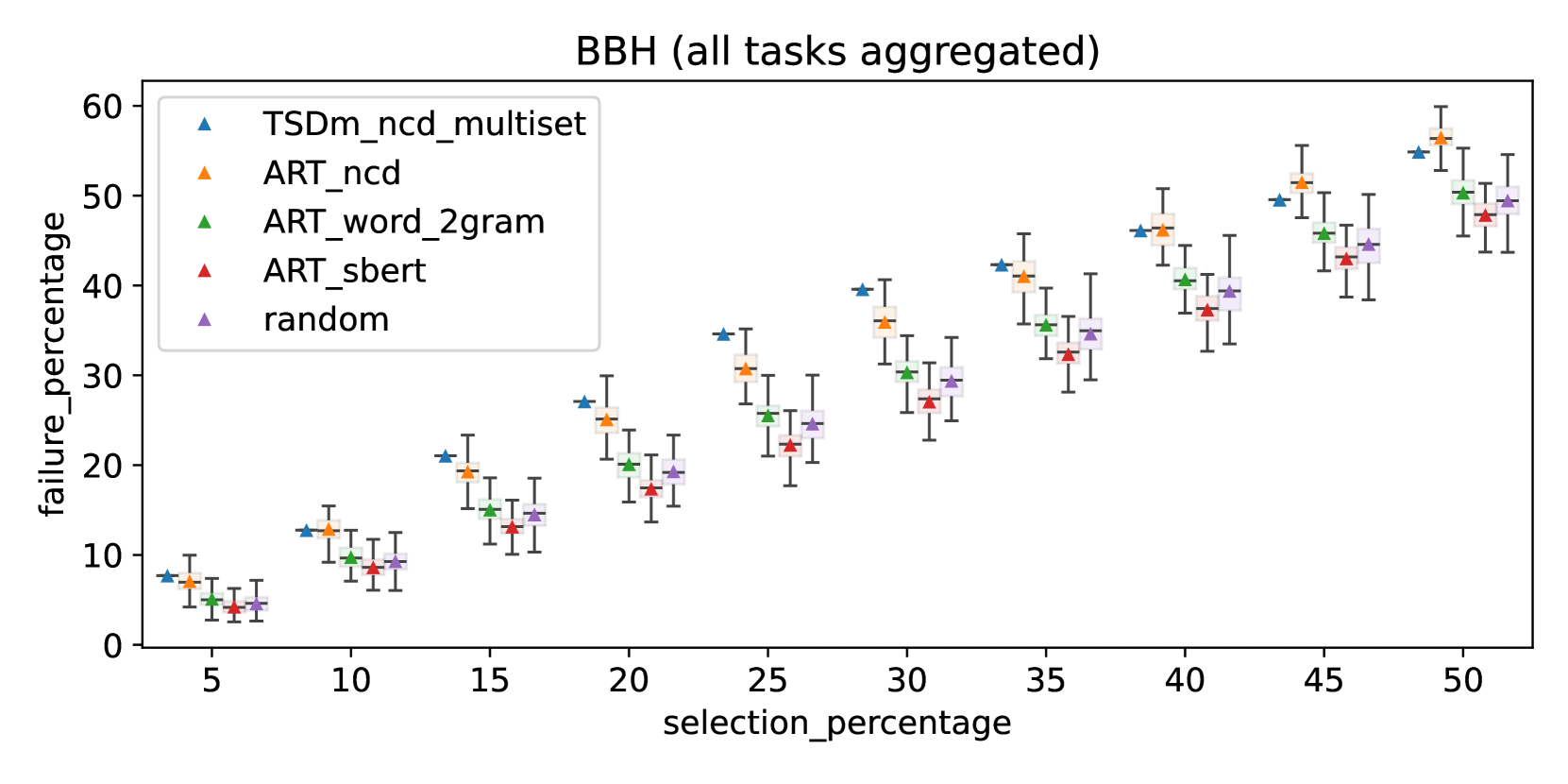

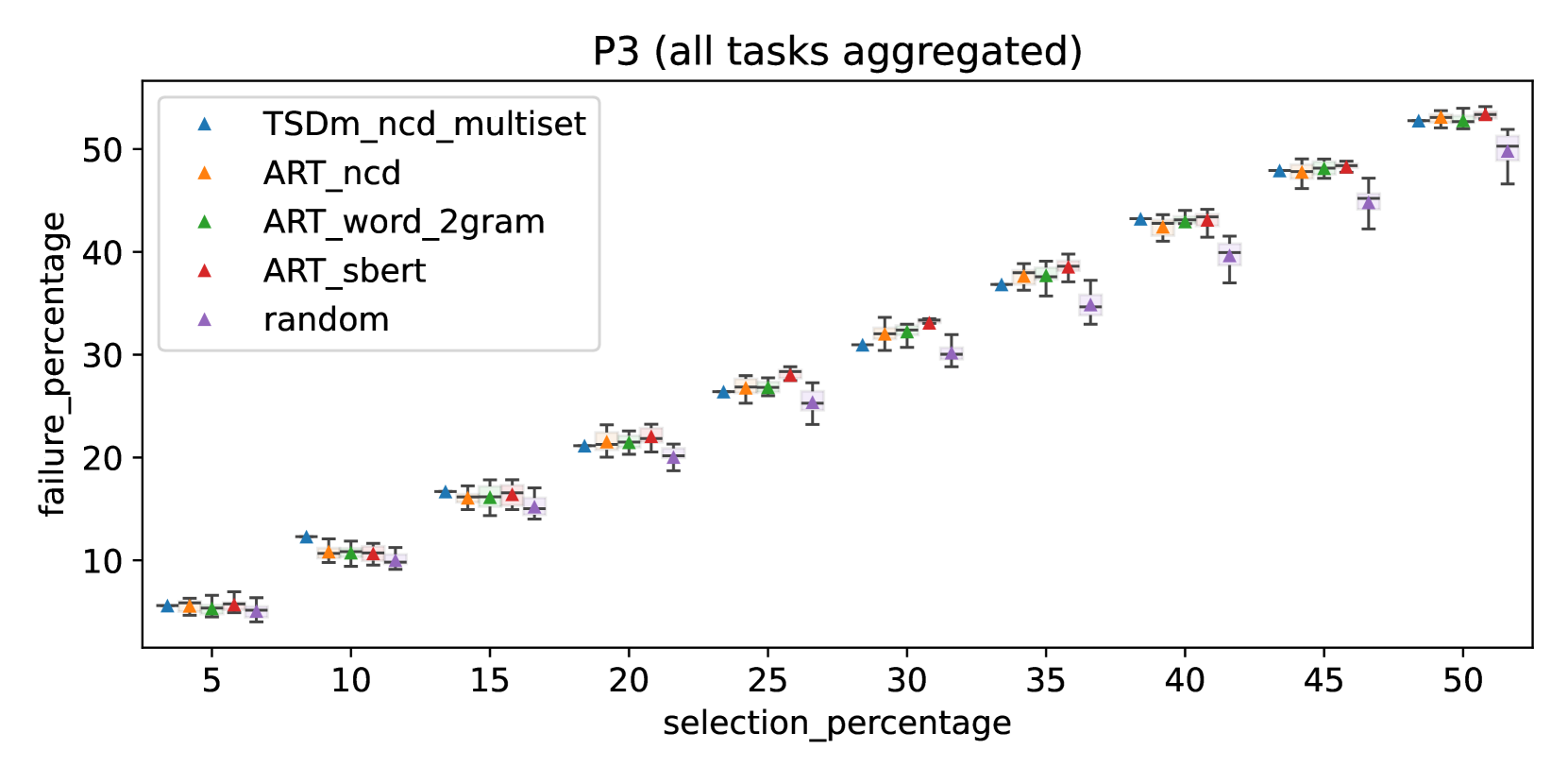

📊 实验亮点

实验结果表明,该方法在减少测试预算和发现故障方面优于传统的随机测试方法。通过使用不同的字符串距离度量,该方法能够生成更多样化的输出,并更有效地覆盖输入空间。具体的性能数据(原文未提供)未知,但总体趋势表明,该方法能够显著提高LLM应用的测试效率。

🎯 应用场景

该研究成果可应用于各种基于LLM的软件系统的测试,例如聊天机器人、智能助手、文本生成工具等。通过优化Prompt模板的测试,可以提高这些系统的可靠性和鲁棒性,减少潜在的错误和风险。未来,该方法可以进一步扩展到其他类型的LLM应用测试,例如模型安全性和公平性测试。

📄 摘要(原文)

The recent surge of building software systems powered by Large Language Models (LLMs) has led to the development of various testing frameworks, primarily focused on treating prompt templates as the unit of testing. Despite the significant costs associated with test input execution and output assessment, the curation of optimized test suites is yet overlooked in these tools, which calls for tailored test selection or prioritization strategies. In this paper, we show that diversity-based testing techniques, such as Adaptive Random Testing (ART) with appropriate string distance metrics, can be effectively applied to the testing of prompt templates. Our proposed adaptive testing approach adjusts the conventional ART process to this context by selecting new test inputs based on scores derived from existing test suite and their labelling results. Our results, obtained using various implementations that explore several string-based distances, confirm that our approach enables the discovery of failures with reduced testing budgets and promotes the generation of more varied outputs.