Multi-stage intermediate fusion for multimodal learning to classify non-small cell lung cancer subtypes from CT and PET

作者: Fatih Aksu, Fabrizia Gelardi, Arturo Chiti, Paolo Soda

分类: eess.IV, cs.AI, cs.CV, q-bio.QM

发布日期: 2025-01-21

期刊: Pattern Recognition Letters 193 (2025) 86-93

DOI: 10.1016/j.patrec.2025.04.001

💡 一句话要点

提出多阶段中间融合方法,利用CT和PET图像进行非小细胞肺癌亚型分类

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 中间融合 非小细胞肺癌 CT图像 PET图像 亚型分类 医学图像分析 深度学习

📋 核心要点

- 现有侵入性NSCLC亚型分类方法存在局限性,可能导致临床并发症,亟需非侵入性诊断手段。

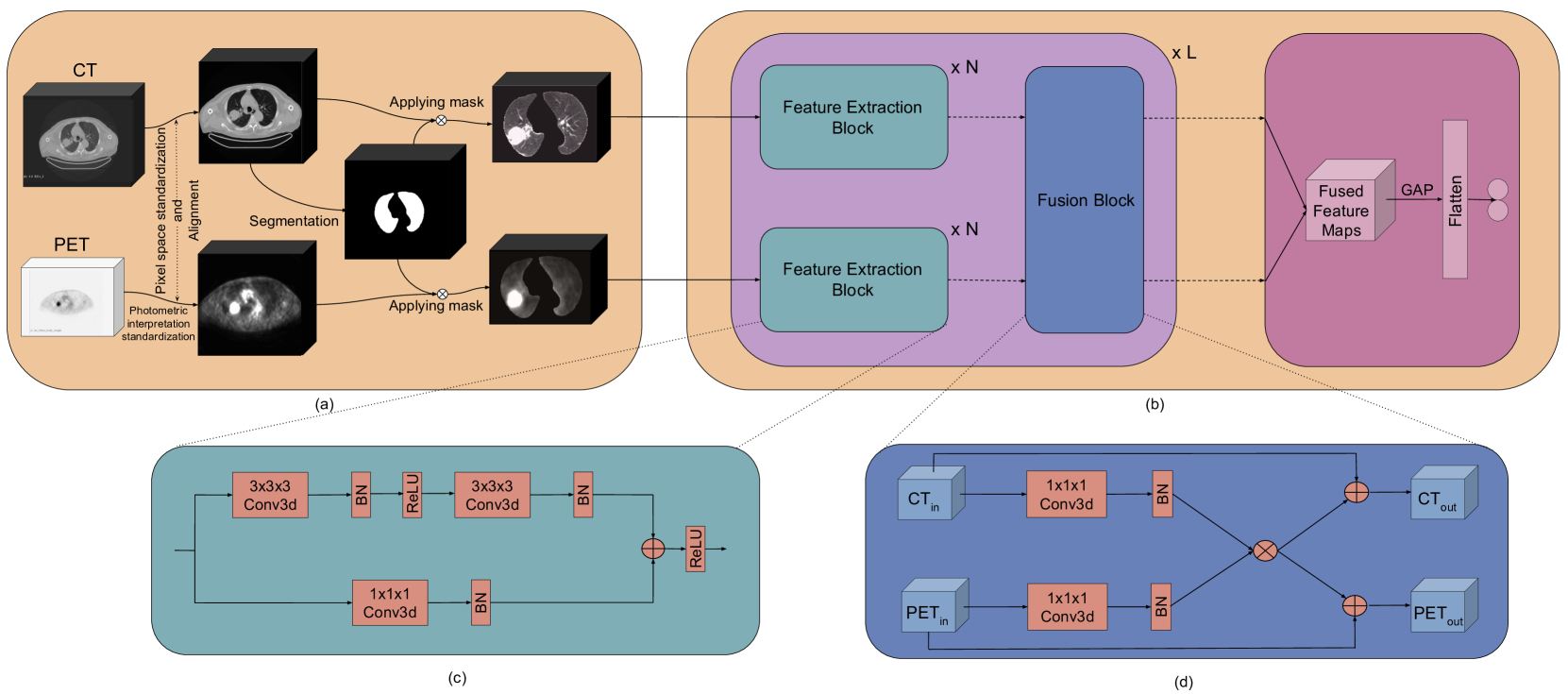

- 提出多阶段中间融合方法,在特征提取的不同阶段融合CT和PET图像信息,保留空间相关性。

- 实验结果表明,该方法在准确率和AUC上均优于单模态、早期/晚期融合以及现有中间融合方法。

📝 摘要(中文)

本研究提出了一种多阶段中间融合方法,旨在利用CT和PET图像对非小细胞肺癌(NSCLC)的组织学亚型进行精确分类。在精准医疗时代,准确的亚型分类至关重要,但现有的侵入性技术并非总是可行,且可能导致临床并发症。该方法在特征提取的不同阶段整合两种模态的信息,采用体素级融合,以利用不同抽象层次上的互补信息,同时保留空间相关性。研究将该方法与仅使用CT或PET图像的单模态方法进行比较,以证明模态融合的优势,并将其与早期和晚期融合技术进行基准测试,以突出中间融合在特征提取过程中的优势。此外,还将该模型与现有的唯一一种使用PET/CT图像进行组织学亚型分类的中间融合方法进行比较。结果表明,所提出的方法在关键指标上优于所有替代方法,准确率和AUC分别达到0.724和0.681。这种非侵入性方法有潜力显著提高诊断准确性,促进更明智的治疗决策,并推进肺癌管理中的个性化护理。

🔬 方法详解

问题定义:论文旨在解决非小细胞肺癌(NSCLC)组织学亚型分类问题。现有方法,特别是侵入性活检,存在可行性问题和潜在的临床并发症。利用CT和PET图像进行非侵入性亚型分类是重要的研究方向,但如何有效融合多模态信息是关键挑战。

核心思路:核心思路是在特征提取的不同阶段进行中间融合,即在早期融合(原始图像层面)和晚期融合(决策层面)之间进行信息整合。这种方式旨在利用不同模态在不同抽象层次上的互补信息,同时保留重要的空间相关性,从而提升分类性能。

技术框架:整体框架包含多个阶段的特征提取和融合。首先,分别从CT和PET图像中提取特征。然后,在多个中间层进行体素级别的特征融合。最后,利用融合后的特征进行分类。具体流程可能涉及卷积神经网络(CNN)等深度学习模型,用于特征提取和分类。

关键创新:关键创新在于多阶段的中间融合策略。与传统的早期融合和晚期融合相比,中间融合能够在更细粒度的层面上捕捉模态间的互补信息。此外,体素级别的融合方式有助于保留空间信息,这对于医学图像分析至关重要。

关键设计:论文中可能涉及的关键设计包括:1) 具体使用的特征提取网络结构(例如,3D CNN);2) 中间融合的具体层数和融合方式(例如,特征拼接或加权平均);3) 损失函数的设计,可能包括交叉熵损失等;4) 数据增强策略,以提高模型的泛化能力;5) 超参数的优化方法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的多阶段中间融合方法在NSCLC亚型分类任务中取得了显著的性能提升。该方法在准确率和AUC指标上均优于单模态方法(仅使用CT或PET图像)、早期融合和晚期融合方法,以及现有的中间融合方法。具体而言,准确率达到0.724,AUC达到0.681,证明了该方法的有效性。

🎯 应用场景

该研究成果可应用于临床辅助诊断,帮助医生更准确地判断NSCLC亚型,从而制定更个性化的治疗方案。该方法具有非侵入性特点,可减少患者痛苦和并发症风险。未来,该技术有望整合到肺癌筛查流程中,提高早期诊断率,改善患者预后。

📄 摘要(原文)

Accurate classification of histological subtypes of non-small cell lung cancer (NSCLC) is essential in the era of precision medicine, yet current invasive techniques are not always feasible and may lead to clinical complications. This study presents a multi-stage intermediate fusion approach to classify NSCLC subtypes from CT and PET images. Our method integrates the two modalities at different stages of feature extraction, using voxel-wise fusion to exploit complementary information across varying abstraction levels while preserving spatial correlations. We compare our method against unimodal approaches using only CT or PET images to demonstrate the benefits of modality fusion, and further benchmark it against early and late fusion techniques to highlight the advantages of intermediate fusion during feature extraction. Additionally, we compare our model with the only existing intermediate fusion method for histological subtype classification using PET/CT images. Our results demonstrate that the proposed method outperforms all alternatives across key metrics, with an accuracy and AUC equal to 0.724 and 0.681, respectively. This non-invasive approach has the potential to significantly improve diagnostic accuracy, facilitate more informed treatment decisions, and advance personalized care in lung cancer management.