Fine-Grained Appropriate Reliance: Human-AI Collaboration with a Multi-Step Transparent Decision Workflow for Complex Task Decomposition

作者: Gaole He, Patrick Hemmer, Michael Vössing, Max Schemmer, Ujwal Gadiraju

分类: cs.AI, cs.HC

发布日期: 2025-01-19

备注: Work in progress

💡 一句话要点

提出多步透明决策流程,提升复杂任务中人机协作的适当依赖性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机协作 适当依赖 多步决策 透明决策流程 事实核查

📋 核心要点

- 现有研究主要关注单步决策中的人机信任与依赖,忽略了复杂任务中多步决策流程的影响。

- 提出多步透明(MST)决策流程,将复杂任务分解为多个可解释的步骤,以提升用户对AI的适当依赖。

- 实验结果表明,在AI建议具有误导性时,MST流程优于单步流程,且用户对中间步骤的关注度越高,MST流程越有效。

📝 摘要(中文)

近年来,人工智能系统的快速发展带来了智能服务的便利,但也引发了对安全性和可靠性的担忧。通过培养用户对人工智能系统的适当依赖,可以实现互补的团队表现并减少人类的工作量。以往的实证研究广泛分析了任务、系统和人类行为等因素对单步决策中用户信任和适当依赖的影响。然而,在需要多步工作流程的复杂语义任务中,用户对人工智能系统的依赖仍然未被充分探索。受近期关于使用大型语言模型进行任务分解工作的启发,我们提出研究一种新颖的多步透明(MST)决策流程对用户依赖行为的影响。我们对复合事实核查任务(即需要多个子事实验证步骤的事实核查任务)中的人工智能辅助决策进行了实证研究(N = 233)。我们的研究结果表明,在特定情况下(例如,当来自人工智能系统的建议具有误导性时),使用MST决策流程的人机协作可以优于单步协作。对细粒度级别的适当依赖性的进一步分析表明,当用户对中间步骤表现出相对较高的考虑时,MST决策流程可能有效。我们的工作强调,没有一种万能的决策流程可以帮助获得最佳的人机协作。我们的见解有助于加深对决策流程在促进适当依赖性方面的作用的理解。我们综合了重要意义,为设计有效手段以促进对复合任务中人工智能系统的适当依赖性,为人本人工智能和更广泛的人机交互社区提供了机会。

🔬 方法详解

问题定义:现有的人机协作研究主要集中在单步决策任务中,缺乏对复杂任务(需要多步推理和验证)中人机协作的深入研究。在复杂任务中,用户难以理解AI的决策过程,容易产生过度信任或不信任,导致不适当的依赖。因此,如何设计有效的决策流程,促进用户对AI的适当依赖,是亟待解决的问题。

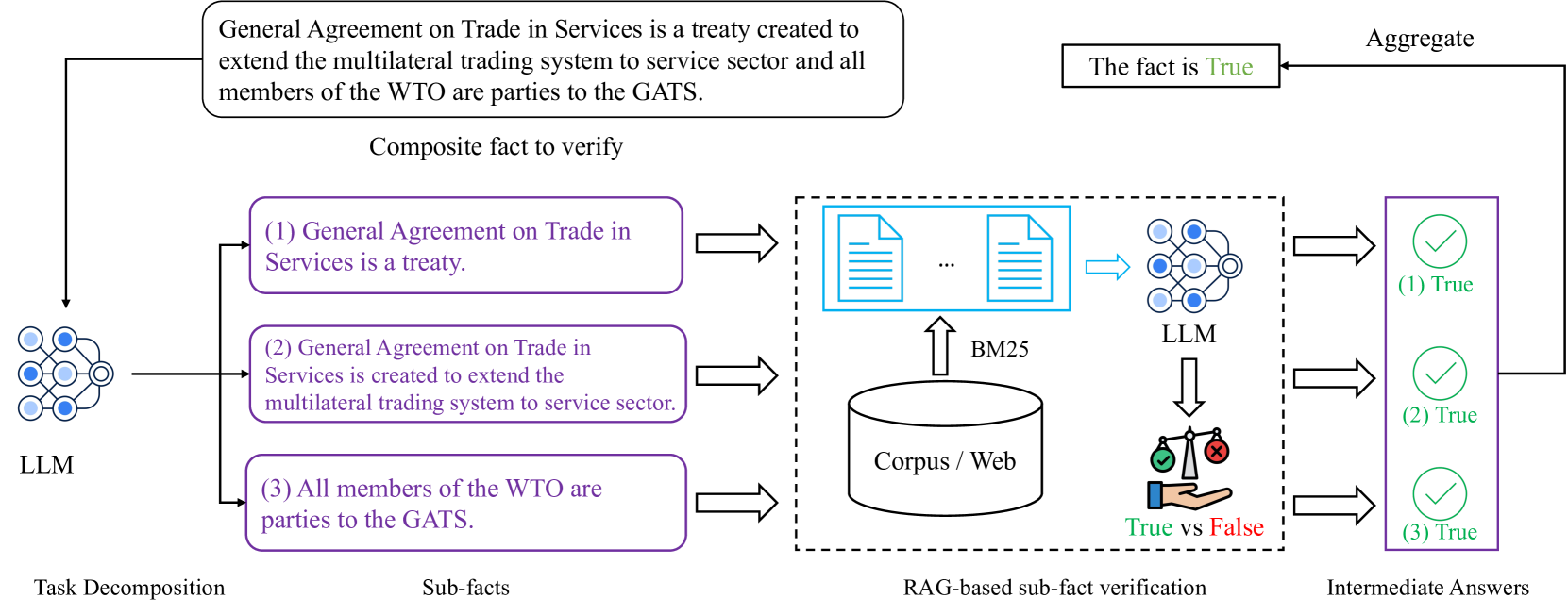

核心思路:论文的核心思路是将复杂任务分解为多个子任务,并让AI系统逐步展示其决策过程,从而提高决策的透明度和可解释性。通过这种方式,用户可以更好地理解AI的推理过程,从而更准确地评估AI的建议,并做出更明智的决策。这种设计旨在避免用户盲目信任或完全拒绝AI的建议,而是根据AI的实际能力进行适当的依赖。

技术框架:该研究的技术框架主要包括以下几个部分:1)任务分解模块:将复杂的事实核查任务分解为多个子任务,例如识别关键信息、搜索相关证据、评估证据可靠性等。2)AI决策模块:利用AI模型(例如大型语言模型)对每个子任务进行决策,并给出相应的建议。3)透明展示模块:将AI的决策过程以清晰易懂的方式展示给用户,例如展示AI搜索到的证据、推理过程和置信度等。4)用户交互模块:允许用户对AI的建议进行评估和修改,并最终做出决策。

关键创新:该论文的关键创新在于提出了多步透明(MST)决策流程,该流程通过将复杂任务分解为多个可解释的步骤,并展示AI的决策过程,从而提高了决策的透明度和可解释性。与传统的单步决策流程相比,MST流程可以帮助用户更好地理解AI的推理过程,从而更准确地评估AI的建议,并做出更明智的决策。

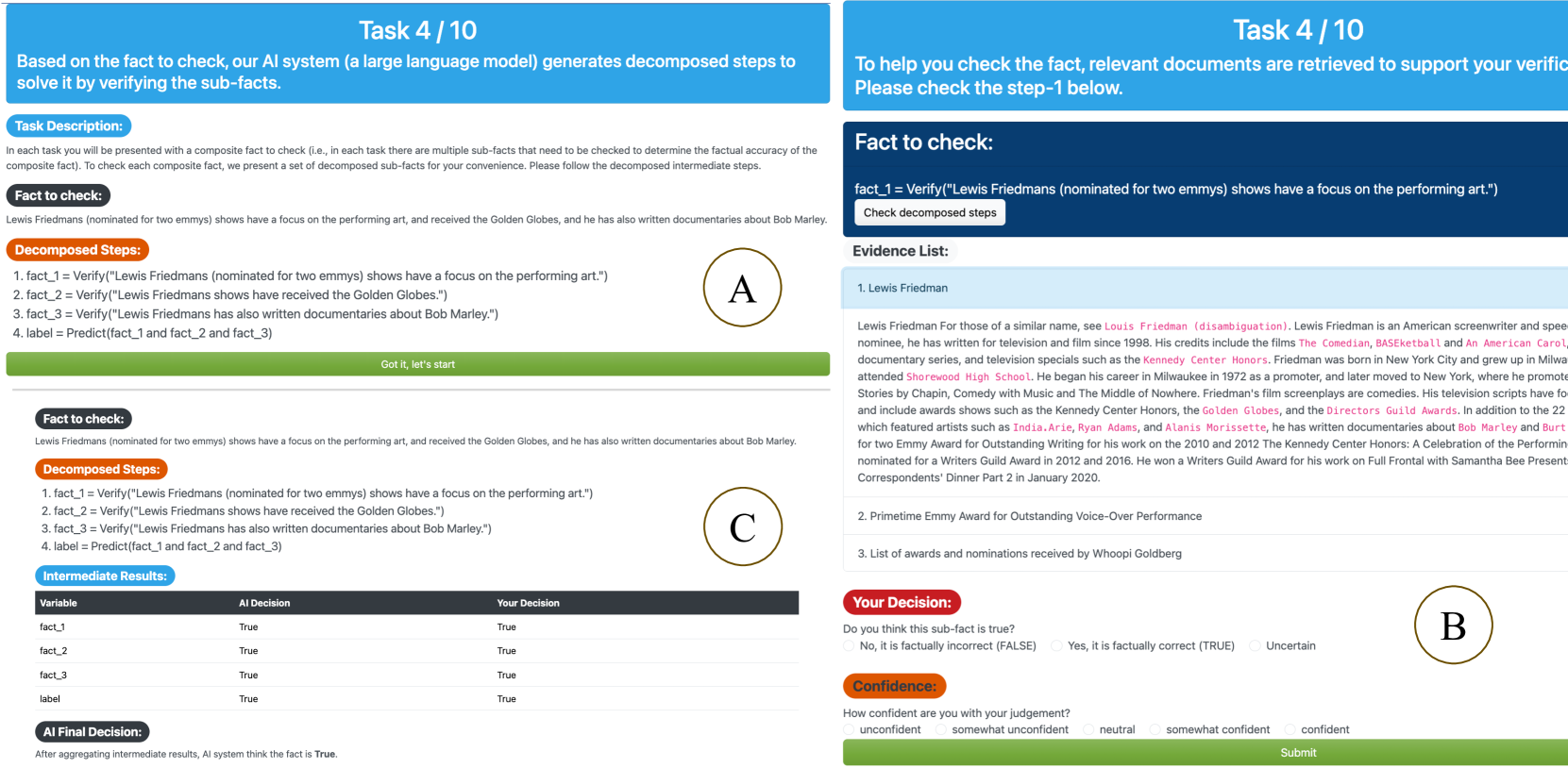

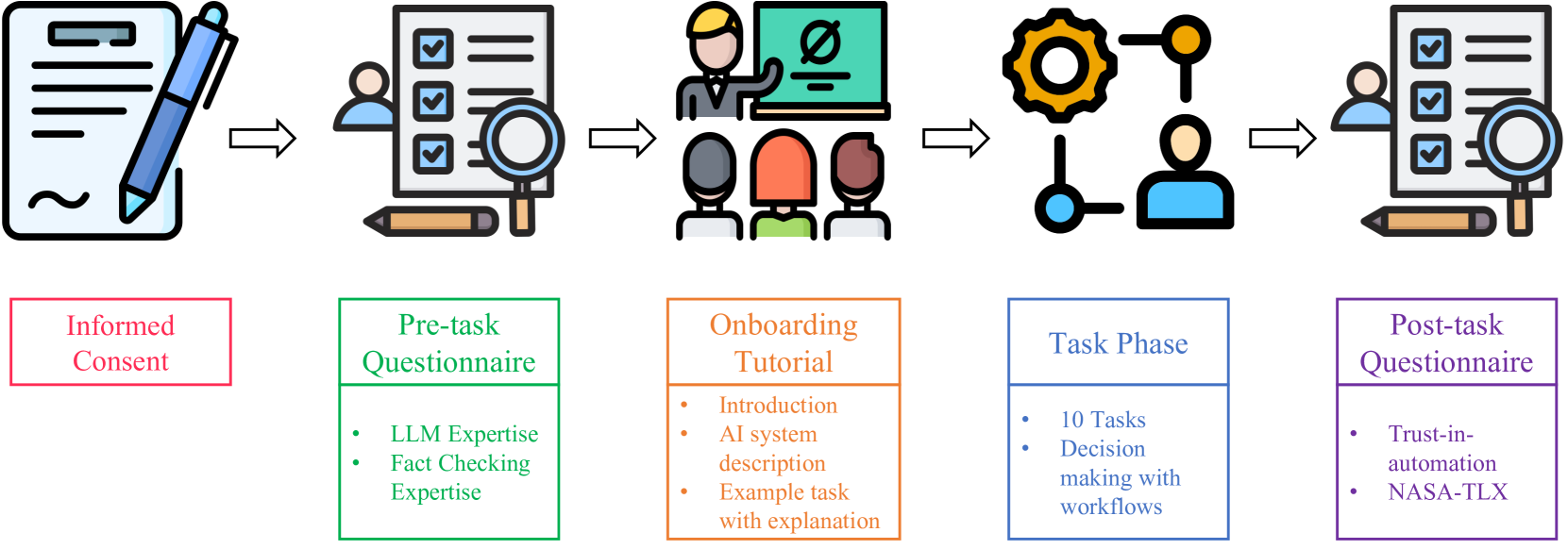

关键设计:在实验设计方面,研究者采用了复合事实核查任务作为研究对象,该任务需要多个子事实验证步骤。研究者设计了两种决策流程:单步决策流程和多步透明(MST)决策流程。在MST流程中,用户可以查看AI在每个子步骤中的决策过程和证据。研究者通过比较两种流程下用户对AI的依赖程度和决策准确率,来评估MST流程的有效性。此外,研究者还分析了用户对中间步骤的关注度与决策结果之间的关系。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在AI建议具有误导性时,使用MST决策流程的人机协作显著优于单步协作。具体来说,当AI提供错误信息时,采用MST流程的用户能够更好地识别错误并进行纠正,从而提高决策准确率。此外,研究发现,用户对中间步骤的关注度越高,MST流程的效果越好,这表明用户对AI决策过程的理解程度是影响人机协作效果的关键因素。

🎯 应用场景

该研究成果可应用于各种需要人机协作的复杂决策场景,例如医疗诊断、金融风险评估、法律咨询等。通过采用多步透明决策流程,可以提高AI系统的可信度和可解释性,促进用户对AI的适当依赖,从而提高决策质量和效率。未来,该研究可以进一步扩展到其他类型的复杂任务,并探索更有效的透明展示方式。

📄 摘要(原文)

In recent years, the rapid development of AI systems has brought about the benefits of intelligent services but also concerns about security and reliability. By fostering appropriate user reliance on an AI system, both complementary team performance and reduced human workload can be achieved. Previous empirical studies have extensively analyzed the impact of factors ranging from task, system, and human behavior on user trust and appropriate reliance in the context of one-step decision making. However, user reliance on AI systems in tasks with complex semantics that require multi-step workflows remains under-explored. Inspired by recent work on task decomposition with large language models, we propose to investigate the impact of a novel Multi-Step Transparent (MST) decision workflow on user reliance behaviors. We conducted an empirical study (N = 233) of AI-assisted decision making in composite fact-checking tasks (i.e., fact-checking tasks that entail multiple sub-fact verification steps). Our findings demonstrate that human-AI collaboration with an MST decision workflow can outperform one-step collaboration in specific contexts (e.g., when advice from an AI system is misleading). Further analysis of the appropriate reliance at fine-grained levels indicates that an MST decision workflow can be effective when users demonstrate a relatively high consideration of the intermediate steps. Our work highlights that there is no one-size-fits-all decision workflow that can help obtain optimal human-AI collaboration. Our insights help deepen the understanding of the role of decision workflows in facilitating appropriate reliance. We synthesize important implications for designing effective means to facilitate appropriate reliance on AI systems in composite tasks, positioning opportunities for the human-centered AI and broader HCI communities.