Aligning Instruction Tuning with Pre-training

作者: Yiming Liang, Tianyu Zheng, Xinrun Du, Ge Zhang, Jiaheng Liu, Xingwei Qu, Wenqiang Zu, Xingrun Xing, Chujie Zheng, Lei Ma, Guoyin Wang, Zhaoxiang Zhang, Wenhao Huang, Xiang Yue, Jiajun Zhang

分类: cs.AI

发布日期: 2025-01-16 (更新: 2025-08-11)

💡 一句话要点

提出AITP方法,通过对齐指令微调与预训练分布,提升大语言模型的泛化能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 指令微调 预训练 大语言模型 数据对齐 泛化能力

📋 核心要点

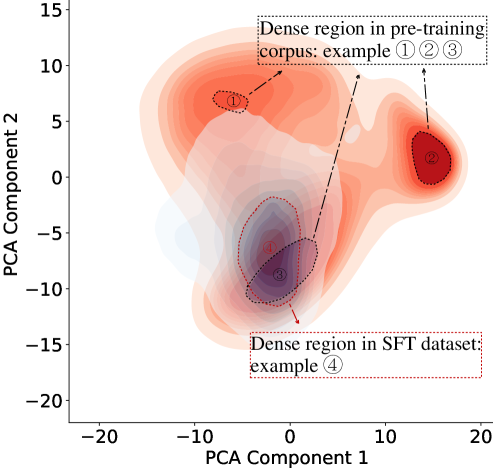

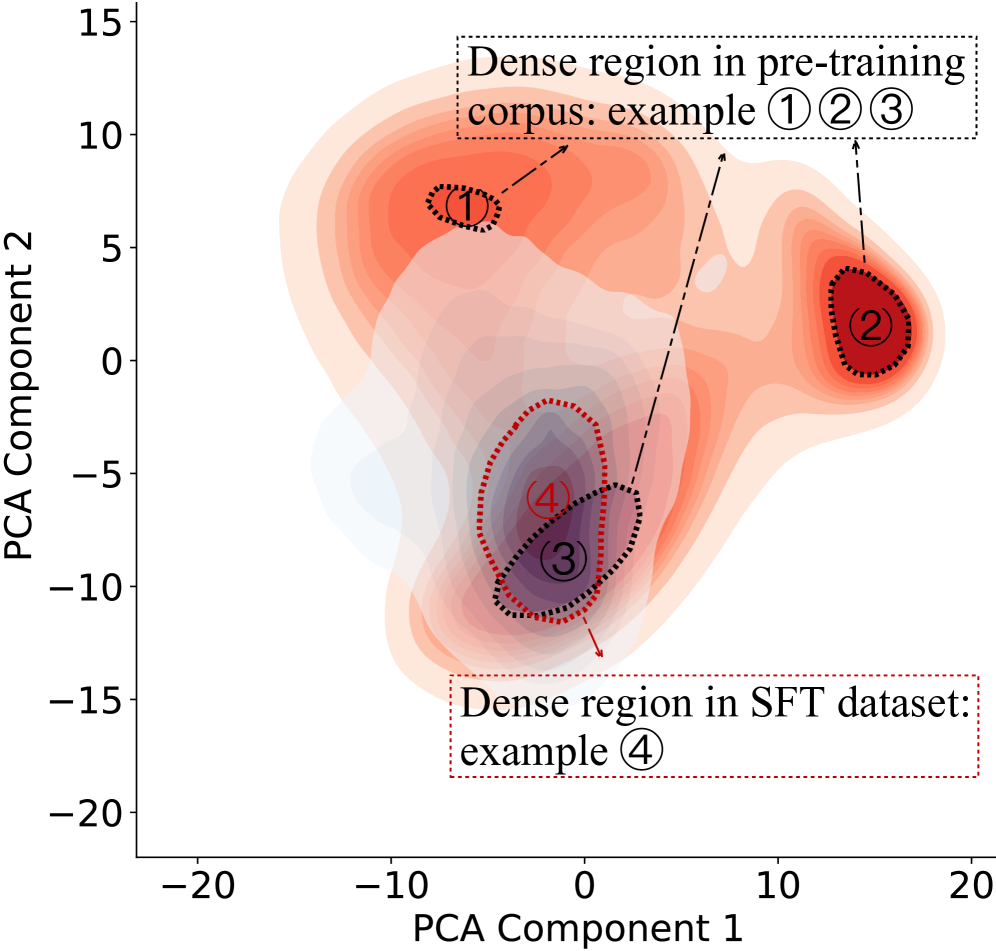

- 指令微调数据集通常与预训练数据分布不一致,导致大语言模型泛化能力受限。

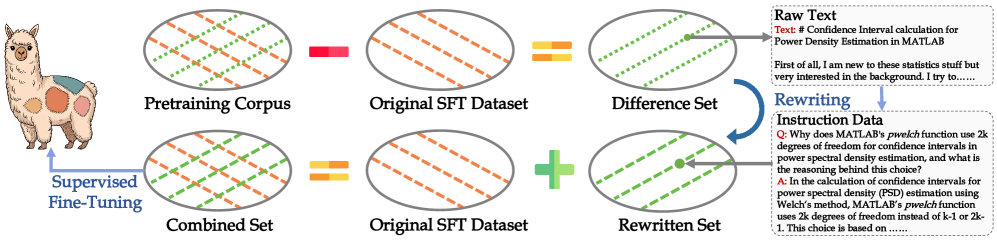

- AITP方法通过识别指令微调数据集的覆盖不足,重写预训练数据,生成高质量指令-响应对。

- 实验结果表明,AITP方法能够持续提升大语言模型在多个基准测试上的性能。

📝 摘要(中文)

指令微调通过高质量数据集引导大语言模型(LLMs)遵循人类指令,从而增强其在各种任务中的表现。然而,这些数据集,无论是手动构建还是合成生成,通常关注范围狭窄,与预训练阶段捕获的广泛分布不一致,限制了LLM的泛化能力和预训练知识的有效利用。我们提出了对齐指令微调与预训练(AITP)的方法,通过识别指令微调数据集中的覆盖不足,并将代表性不足的预训练数据重写为高质量的指令-响应对来弥合这一差距。这种方法丰富了数据集的多样性,同时保留了特定于任务的目标。在三个完全开放的LLM上,跨八个基准的评估表明,AITP能够带来持续的性能提升。消融实验突出了自适应数据选择、受控重写和平衡集成的优势,强调了对齐指令微调与预训练分布对于释放LLM全部潜力的重要性。

🔬 方法详解

问题定义:现有指令微调方法依赖的数据集往往覆盖范围有限,与大语言模型预训练阶段学习到的广泛数据分布存在偏差。这种偏差导致模型在指令微调后,虽然在特定任务上表现良好,但在面对更广泛、更真实的场景时,泛化能力不足,无法充分利用预训练阶段获得的知识。

核心思路:AITP的核心思路是弥合指令微调数据集与预训练数据分布之间的差距。通过分析指令微调数据集的覆盖范围,识别预训练数据中代表性不足的部分,并将其转化为高质量的指令-响应对,从而丰富指令微调数据集的多样性,使其更接近预训练数据的分布。

技术框架:AITP方法包含以下几个主要阶段:1) 覆盖率分析:分析现有指令微调数据集,识别其在预训练数据分布中的覆盖不足之处。2) 数据选择:从预训练数据中选择代表性不足的数据样本。3) 指令重写:将选定的预训练数据样本重写为高质量的指令-响应对。4) 数据集集成:将重写后的指令-响应对集成到现有的指令微调数据集中。5) 模型微调:使用集成后的数据集对大语言模型进行微调。

关键创新:AITP的关键创新在于其自适应地将预训练数据转化为指令微调数据,从而有效地对齐了指令微调和预训练的分布。与传统的指令微调方法相比,AITP能够更好地利用预训练阶段获得的知识,提升模型的泛化能力。此外,AITP还强调了受控重写和平衡集成的重要性,确保生成高质量的指令-响应对,并避免引入偏差。

关键设计:AITP的关键设计包括:1) 自适应数据选择策略:根据覆盖率分析结果,动态调整从预训练数据中选择样本的策略。2) 受控重写机制:使用特定的模板和规则,确保重写后的指令-响应对具有高质量和一致性。3) 平衡集成策略:在将重写后的数据集成到现有数据集中时,考虑不同数据来源的权重,避免引入偏差。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AITP方法在三个完全开放的LLM上,跨八个基准测试中均取得了持续的性能提升。消融实验验证了自适应数据选择、受控重写和平衡集成的重要性。例如,在某些基准测试中,使用AITP微调的模型相比于基线模型,性能提升超过5%。这些结果表明,AITP方法能够有效地对齐指令微调和预训练分布,从而提升大语言模型的性能。

🎯 应用场景

AITP方法可广泛应用于各种大语言模型的指令微调场景,尤其是在需要模型具备更强泛化能力和能够处理多样化任务的场景下。例如,可以应用于智能客服、文本生成、机器翻译等领域,提升模型在实际应用中的性能和鲁棒性。该方法也有助于降低对大规模高质量指令微调数据集的依赖,从而降低模型训练的成本。

📄 摘要(原文)

Instruction tuning enhances large language models (LLMs) to follow human instructions across diverse tasks, relying on high-quality datasets to guide behavior. However, these datasets, whether manually curated or synthetically generated, are often narrowly focused and misaligned with the broad distributions captured during pre-training, limiting LLM generalization and effective use of pre-trained knowledge. We propose Aligning Instruction Tuning with Pre-training (AITP), a method that bridges this gap by identifying coverage shortfalls in instruction-tuning datasets and rewriting underrepresented pre-training data into high-quality instruction-response pairs. This approach enriches dataset diversity while preserving task-specific objectives. Evaluations on three fully open LLMs across eight benchmarks demonstrate consistent performance improvements with AITP. Ablations highlight the benefits of adaptive data selection, controlled rewriting, and balanced integration, emphasizing the importance of aligning instruction tuning with pre-training distributions to unlock the full potential of LLMs.