YETI (YET to Intervene) Proactive Interventions by Multimodal AI Agents in Augmented Reality Tasks

作者: Saptarashmi Bandyopadhyay, Vikas Bahirwani, Lavisha Aggarwal, Bhanu Guda, Lin Li, Andrea Colaco

分类: cs.AI, cs.CV, cs.ET, cs.MA

发布日期: 2025-01-16

备注: Preprint

💡 一句话要点

YETI:基于增强现实任务中多模态AI代理的主动干预

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 增强现实 多模态AI代理 主动干预 场景理解 结构相似性

📋 核心要点

- 现有AI代理在增强现实任务中主要为被动响应,缺乏主动干预能力,难以有效辅助用户纠正错误。

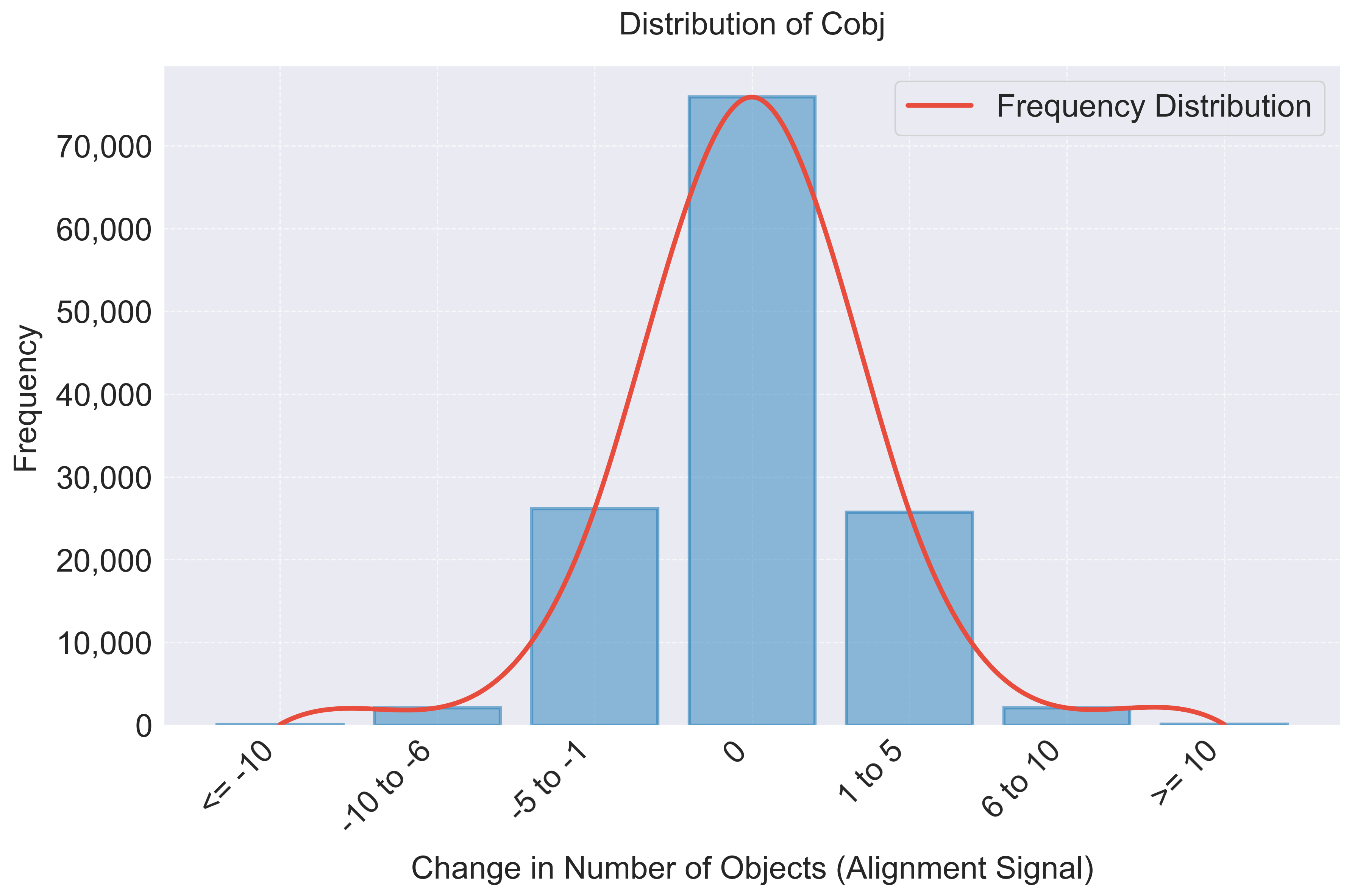

- YETI代理通过学习场景理解信号(基于SSIM)和对齐信号,判断用户操作与预期是否一致,从而决定何时主动介入。

- 该方法在HoloAssist基准测试中进行了验证,展示了YETI代理在主动干预方面的有效性。

📝 摘要(中文)

多模态AI代理能够以交互和协作的方式协助用户完成日常任务。增强现实(AR)头戴设备通过为AI代理提供以自我为中心的音频和视频观察能力,可以显著提升用户在解决程序性日常任务时的体验。这种AR能力帮助AI代理观察和倾听用户的行为,类似于人类用户的多模态能力。现有的AI代理,无论是大型语言模型(LLM)还是多模态视觉-语言模型(VLM),本质上都是被动的,即模型必须在读取或听到用户的提示后才能采取行动。另一方面,AI代理的主动性可以帮助用户检测和纠正代理观察到的任务中的任何错误,鼓励用户正确地完成任务,或者简单地与用户进行对话,类似于人类教学或协助用户。我们提出的“YET to Intervene (YETI)”多模态代理关注于识别可能需要代理主动干预的情况这一研究问题。这使得代理能够理解何时可以介入与用户的对话,从而帮助用户纠正烹饪等任务中的错误,使用AR。我们的YETI代理基于连续视频帧上的结构相似性(SSIM)的可解释概念来学习场景理解信号。我们还定义了对齐信号,AI代理可以学习识别视频帧中用户在任务上的操作是否与预期操作一致。我们的AI代理使用这些信号来确定何时应该主动干预。我们将我们的结果与HoloAssist多模态基准测试中专家代理指导用户完成程序性任务的主动干预实例进行了比较。

🔬 方法详解

问题定义:论文旨在解决增强现实(AR)环境中,AI代理如何主动地、适时地干预用户任务执行过程,以纠正错误、提供指导的问题。现有的大型语言模型(LLM)或多模态视觉-语言模型(VLM)通常是被动响应式的,需要用户明确的指令才能采取行动,无法主动发现并纠正用户在任务执行中的偏差。

核心思路:YETI代理的核心思路是让AI代理能够像人类助手一样,通过观察用户的行为,理解当前任务的进展,并判断用户的操作是否符合预期。当代理检测到用户可能出现错误时,主动介入并提供帮助。这种主动干预能够更有效地辅助用户完成任务,提升用户体验。

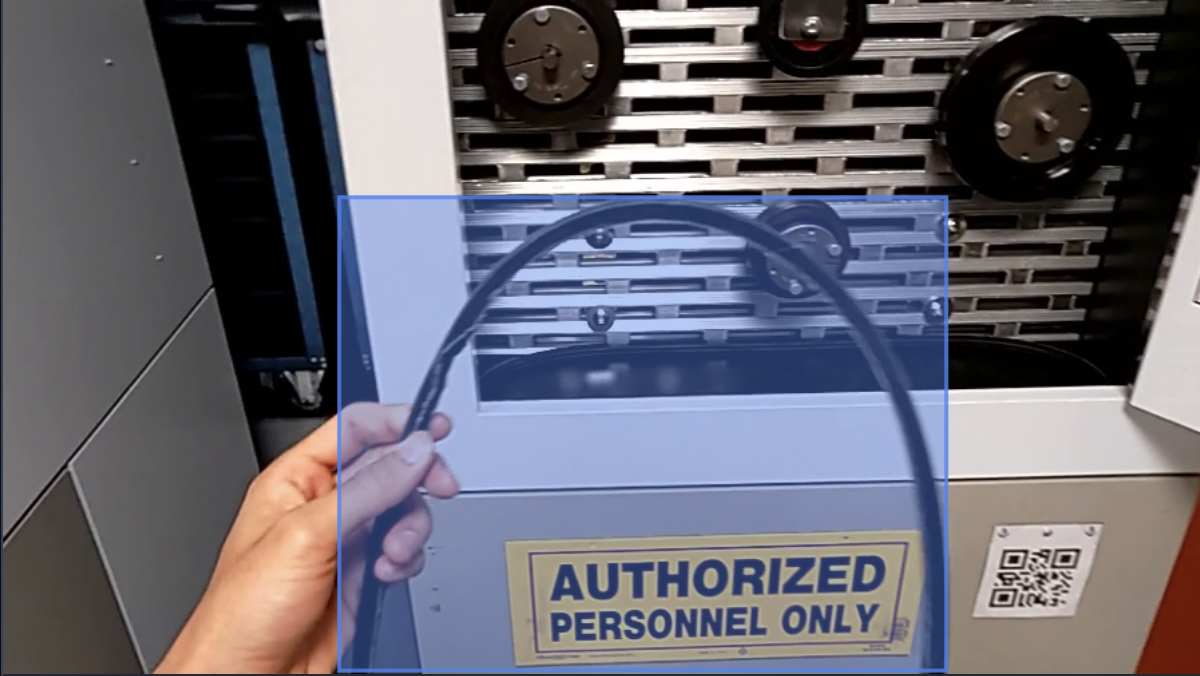

技术框架:YETI代理的技术框架主要包含以下几个模块:1) 视频帧输入:从AR设备获取用户视角的视频流。2) 场景理解模块:基于连续视频帧的结构相似性(SSIM)计算场景理解信号,用于判断场景的变化和进展。3) 对齐模块:计算用户操作与预期操作的对齐信号,判断用户行为是否符合任务流程。4) 干预决策模块:综合场景理解信号和对齐信号,判断是否需要进行主动干预。如果判断需要干预,则生成相应的干预策略(例如,语音提示、视觉引导等)。

关键创新:YETI代理的关键创新在于其主动干预机制。与传统的被动式AI代理不同,YETI能够主动观察、理解用户的行为,并根据用户的操作状态进行干预。此外,YETI代理使用结构相似性(SSIM)和对齐信号作为可解释的场景理解信号,使得干预决策更具透明性和可解释性。

关键设计:YETI代理的关键设计包括:1) SSIM阈值:用于判断场景变化的程度,阈值设置会影响场景理解的敏感度。2) 对齐信号的计算方法:需要定义用户操作与预期操作之间的相似度度量方式。3) 干预策略的生成规则:需要设计合理的规则,将干预决策转化为具体的干预行为(例如,语音提示的内容、视觉引导的方式等)。这些参数和规则需要根据具体的任务场景进行调整和优化。

🖼️ 关键图片

📊 实验亮点

论文在HoloAssist多模态基准测试上验证了YETI代理的有效性。实验结果表明,YETI代理能够有效地识别用户操作中的错误,并及时进行干预,从而显著提升用户的任务完成效率和准确率。具体的性能数据和对比基线需要在论文中查找,但整体趋势表明YETI代理在主动干预方面具有显著优势。

🎯 应用场景

YETI代理具有广泛的应用前景,例如:烹饪教学、设备维修指导、医疗操作辅助、工业装配等。通过AR设备和YETI代理,用户可以获得实时的、个性化的指导,从而更高效、更安全地完成任务。未来,YETI代理可以与更强大的知识库和更先进的推理引擎相结合,实现更智能、更灵活的主动干预。

📄 摘要(原文)

Multimodal AI Agents are AI models that have the capability of interactively and cooperatively assisting human users to solve day-to-day tasks. Augmented Reality (AR) head worn devices can uniquely improve the user experience of solving procedural day-to-day tasks by providing egocentric multimodal (audio and video) observational capabilities to AI Agents. Such AR capabilities can help AI Agents see and listen to actions that users take which can relate to multimodal capabilities of human users. Existing AI Agents, either Large Language Models (LLMs) or Multimodal Vision-Language Models (VLMs) are reactive in nature, which means that models cannot take an action without reading or listening to the human user's prompts. Proactivity of AI Agents on the other hand can help the human user detect and correct any mistakes in agent observed tasks, encourage users when they do tasks correctly or simply engage in conversation with the user - akin to a human teaching or assisting a user. Our proposed YET to Intervene (YETI) multimodal agent focuses on the research question of identifying circumstances that may require the agent to intervene proactively. This allows the agent to understand when it can intervene in a conversation with human users that can help the user correct mistakes on tasks, like cooking, using AR. Our YETI Agent learns scene understanding signals based on interpretable notions of Structural Similarity (SSIM) on consecutive video frames. We also define the alignment signal which the AI Agent can learn to identify if the video frames corresponding to the user's actions on the task are consistent with expected actions. These signals are used by our AI Agent to determine when it should proactively intervene. We compare our results on the instances of proactive intervention in the HoloAssist multimodal benchmark for an expert agent guiding a user to complete procedural tasks.