Flow: Modularized Agentic Workflow Automation

作者: Boye Niu, Yiliao Song, Kai Lian, Yifan Shen, Yu Yao, Kun Zhang, Tongliang Liu

分类: cs.AI, cs.LG, cs.MA

发布日期: 2025-01-14 (更新: 2025-02-23)

🔗 代码/项目: GITHUB

💡 一句话要点

Flow:模块化Agent工作流自动化框架,通过动态调整和模块化设计提升效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多Agent系统 工作流自动化 大型语言模型 动态规划 模块化设计 任务执行 AOV图

📋 核心要点

- 现有多Agent框架在自动化规划和任务执行中表现出色,但缺乏对执行过程中工作流的有效调整机制,难以应对实际场景中的突发状况。

- Flow框架将工作流定义为AOV图,利用LLM Agent根据历史表现动态调整子任务分配,实现工作流的持续优化和适应性。

- 通过模块化设计,Flow框架实现了高效的子任务并发执行、目标达成和容错能力提升,并在多个实际任务中验证了其效率优势。

📝 摘要(中文)

本文提出了一种基于大型语言模型(LLM)的多Agent框架,用于自动化规划和任务执行。该框架着重研究了执行过程中Agent工作流的有效调整,这在实际场景中至关重要,因为初始计划必须实时适应不可预见的挑战和变化的环境,以确保复杂任务的高效执行。本文将工作流定义为活动顶点(AOV)图,允许LLM Agent通过基于历史性能和先前AOV的动态子任务分配调整来持续改进工作流。为了进一步提高框架性能,我们强调基于评估并行性和依赖复杂性的工作流设计的模块化。通过这种设计,我们提出的多Agent框架实现了子任务的高效并发执行、有效的目标实现和增强的容错能力。在各种实际任务中的经验结果表明,通过动态工作流改进和模块化,多Agent框架的效率得到了显著提高。代码可在https://github.com/tmllab/2025_ICLR_FLOW 获取。

🔬 方法详解

问题定义:现有的多Agent框架在复杂任务执行过程中,难以根据实时环境变化和历史执行情况动态调整工作流,导致效率低下和容错性差。尤其是在面对不可预测的挑战时,初始计划的僵化性成为瓶颈。

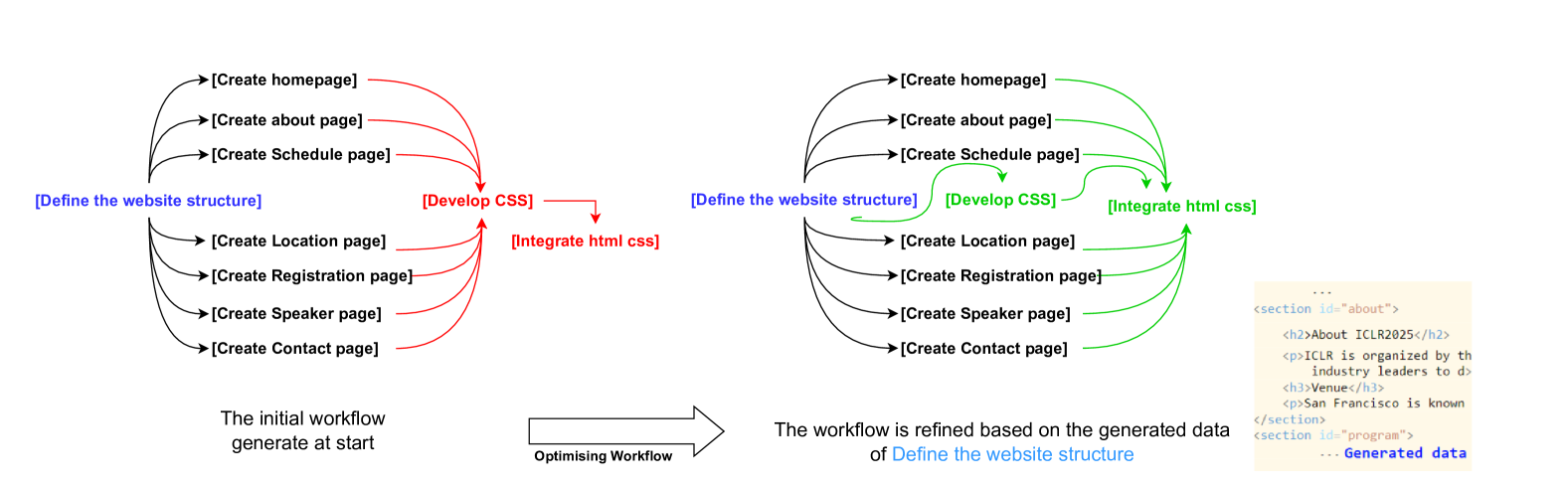

核心思路:Flow框架的核心在于将工作流建模为活动顶点(AOV)图,并利用LLM Agent的推理能力,根据历史性能和先前的AOV图,动态地调整子任务的分配。这种动态调整使得框架能够适应不断变化的环境,并优化任务执行路径。同时,通过模块化设计,提高子任务的并行执行效率和整体容错能力。

技术框架:Flow框架包含以下主要模块:1) 工作流定义模块:将任务分解为子任务,并构建AOV图来表示任务之间的依赖关系。2) 动态调整模块:LLM Agent根据历史性能和环境反馈,动态调整AOV图中的子任务分配,优化工作流。3) 模块化执行模块:根据模块化设计,并发执行独立的子任务,提高整体执行效率。4) 监控与反馈模块:实时监控任务执行状态,并向LLM Agent提供反馈,用于后续的动态调整。

关键创新:Flow框架的关键创新在于其动态工作流调整机制和模块化设计。传统的静态工作流难以适应复杂多变的环境,而Flow框架通过LLM Agent的智能决策,实现了工作流的自适应优化。模块化设计则进一步提高了框架的并行性和容错性。与现有方法相比,Flow框架能够更有效地应对实际场景中的挑战。

关键设计:Flow框架的关键设计包括:1) AOV图的构建方式,需要合理地分解任务并定义依赖关系。2) LLM Agent的prompt设计,需要清晰地指导Agent进行子任务分配和工作流调整。3) 模块化设计的粒度,需要平衡并行性和依赖复杂性。4) 历史性能的评估指标,需要准确地反映子任务的执行效率和质量。

🖼️ 关键图片

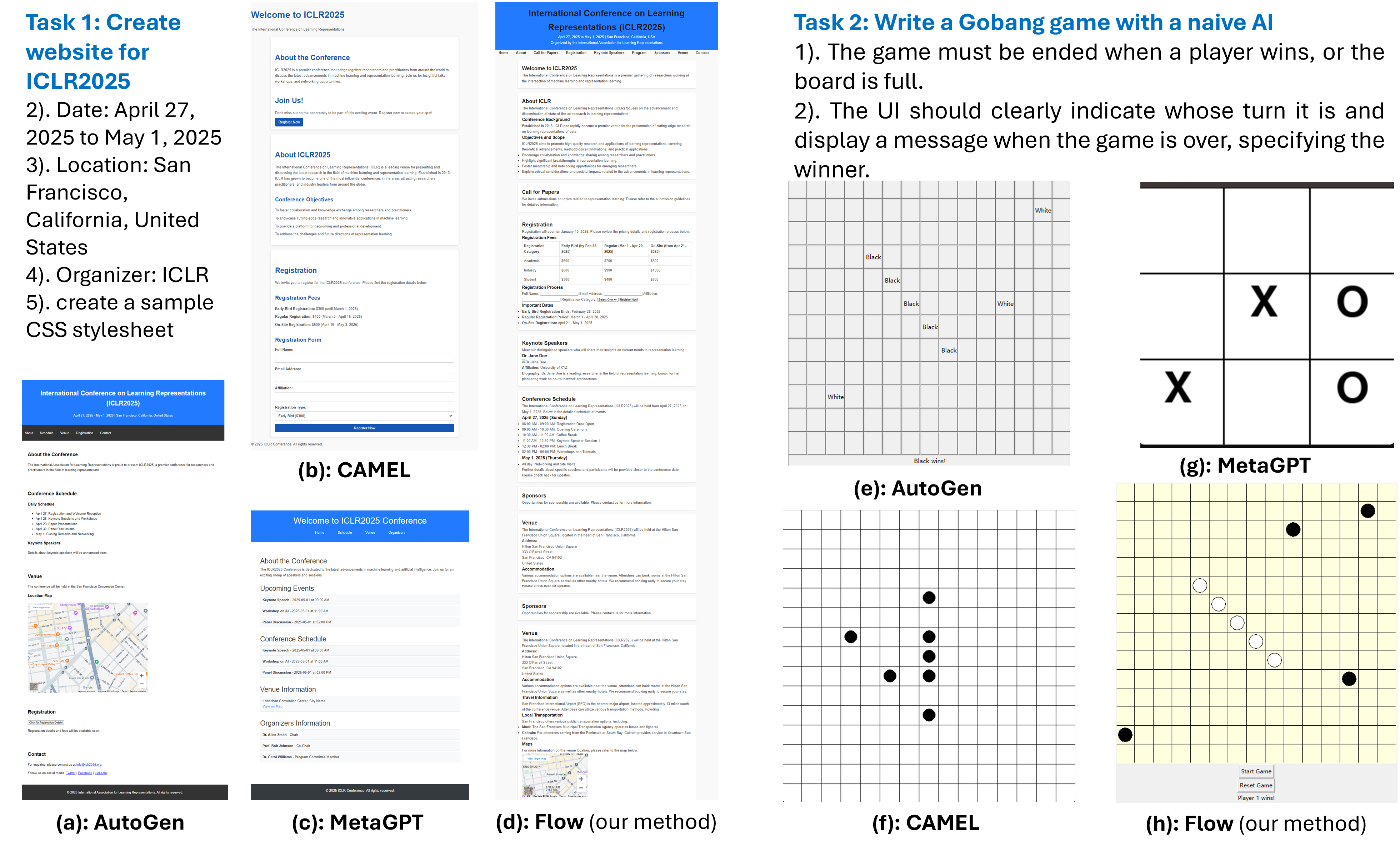

📊 实验亮点

论文通过在多个实际任务上的实验验证了Flow框架的有效性。实验结果表明,与传统的静态工作流相比,Flow框架能够显著提高任务完成效率,降低错误率,并更好地适应环境变化。具体的性能提升数据在论文中进行了详细展示,证明了动态工作流改进和模块化的优势。

🎯 应用场景

Flow框架具有广泛的应用前景,可用于自动化软件开发、智能制造、金融风控、智能交通等领域。通过动态调整和模块化设计,Flow能够显著提高复杂任务的执行效率和鲁棒性,降低人工干预成本,实现更智能化的自动化流程。

📄 摘要(原文)

Multi-agent frameworks powered by large language models (LLMs) have demonstrated great success in automated planning and task execution. However, the effective adjustment of agentic workflows during execution has not been well studied. An effective workflow adjustment is crucial in real-world scenarios, as the initial plan must adjust to unforeseen challenges and changing conditions in real time to ensure the efficient execution of complex tasks. In this paper, we define workflows as an activity-on-vertex (AOV) graph, which allows continuous workflow refinement by LLM agents through dynamic subtask allocation adjustment based on historical performance and previous AOVs. To further enhance framework performance, we emphasize modularity in workflow design based on evaluating parallelism and dependency complexity. With this design, our proposed multi-agent framework achieves efficient concurrent execution of subtasks, effective goal achievement, and enhanced error tolerance. Empirical results across various practical tasks demonstrate significant improvements in the efficiency of multi-agent frameworks through dynamic workflow refinement and modularization. The code is available at: https://github.com/tmllab/2025_ICLR_FLOW.