CureGraph: Contrastive Multi-Modal Graph Representation Learning for Urban Living Circle Health Profiling and Prediction

作者: Jinlin Li, Xiao Zhou

分类: cs.AI

发布日期: 2025-01-13

🔗 代码/项目: GITHUB

💡 一句话要点

CureGraph:用于城市生活圈健康画像与预测的对比多模态图表示学习

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多模态学习 图神经网络 对比学习 城市健康 老年健康

📋 核心要点

- 现有研究依赖单一数据模态或多模态信息的简单特征拼接,无法全面分析城市环境与老年人健康的关系。

- CureGraph利用图结构建模城市生活圈,融合视觉和文本信息,通过对比学习生成更具表达力的社区健康表征。

- 实验表明,CureGraph在老年疾病风险预测任务中显著优于现有方法,R平方指标平均提升28%。

📝 摘要(中文)

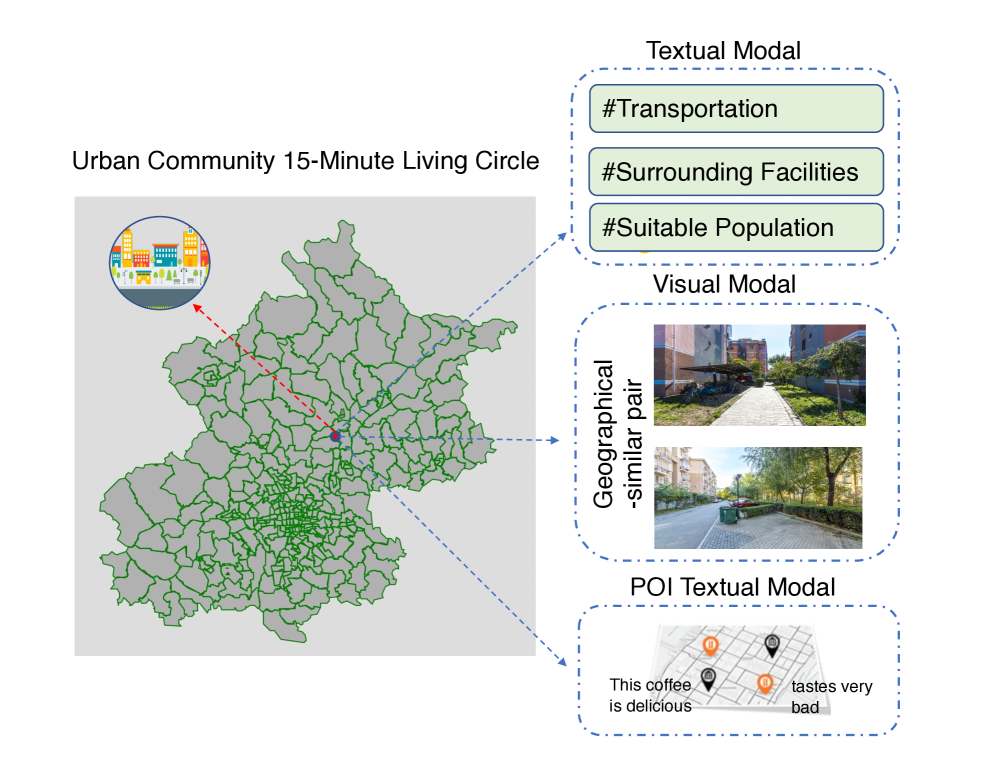

本文提出CureGraph,一个对比多模态表示学习框架,用于城市健康预测,旨在通过图技术推断城市生活圈内老年人常见慢性病的患病率。CureGraph利用丰富的多模态信息,包括居住区及其周边兴趣点的照片和文本评论,生成城市社区嵌入。通过将预训练的视觉和文本编码器与图建模技术相结合,CureGraph捕捉跨模态空间依赖关系,从而全面理解针对老年人健康考虑的城市环境。在真实世界数据集上的大量实验表明,CureGraph在老年疾病风险预测任务中,R平方指标平均比最佳基线提高了28%。此外,该模型能够识别阶段性慢性疾病进展,并支持跨社区的比较公共卫生分析,为可持续城市发展和提高生活质量提供可操作的见解。代码已公开。

🔬 方法详解

问题定义:现有方法在分析城市环境对老年人健康的影响时,主要存在两个痛点:一是依赖单一数据模态,如仅使用人口统计数据或地理信息;二是即使使用多模态数据,也通常采用简单的特征拼接方式,无法有效捕捉不同模态之间的复杂关系和空间依赖性。这导致对城市环境的健康影响因素理解不够全面,预测精度有限。

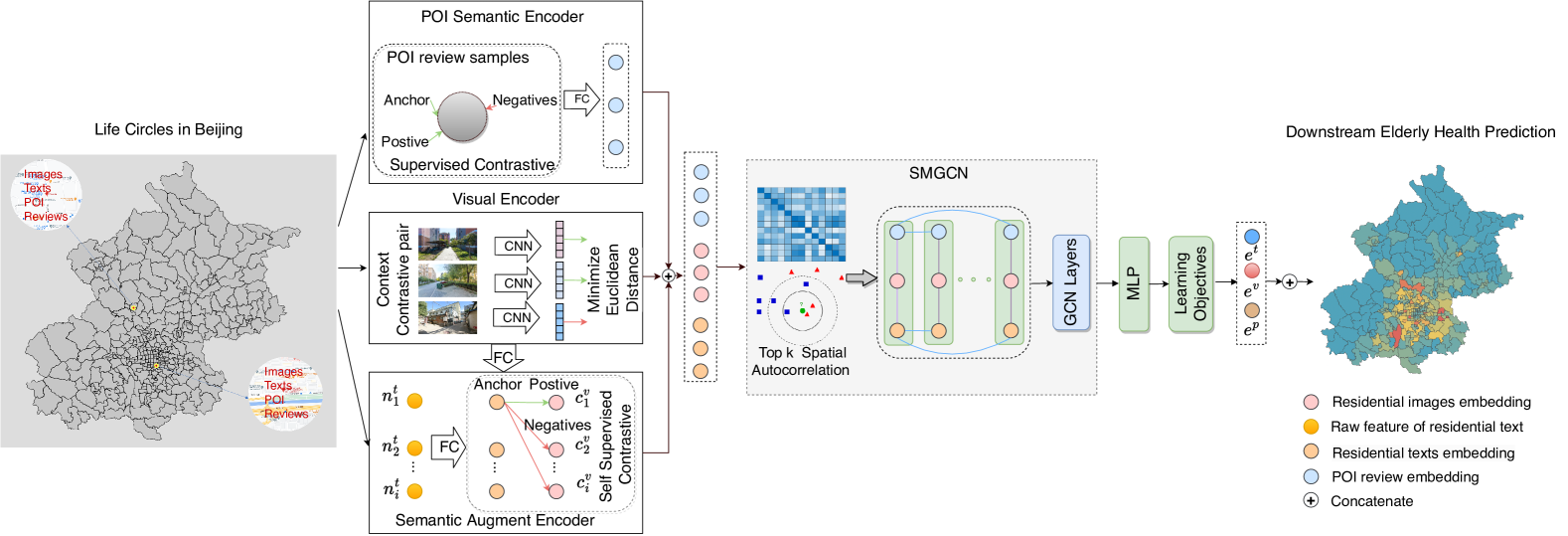

核心思路:CureGraph的核心思路是利用图结构建模城市生活圈,将社区及其周边兴趣点视为节点,利用多模态信息(照片和文本评论)构建节点特征,并通过图神经网络学习节点之间的关系。同时,采用对比学习方法,鼓励模型学习到更具区分性的社区健康表征,从而提高预测精度。这样设计的目的是为了更全面地捕捉城市环境对老年人健康的影响,并有效利用多模态数据。

技术框架:CureGraph的整体框架包括以下几个主要模块:1) 多模态数据编码:使用预训练的视觉(例如,ResNet)和文本(例如,BERT)编码器提取图像和文本特征。2) 图构建:基于地理位置信息构建城市生活圈图,节点代表社区和兴趣点,边表示它们之间的空间关系。3) 图神经网络:使用图神经网络(例如,GCN)学习节点表示,捕捉节点之间的依赖关系。4) 对比学习:设计对比学习目标,鼓励模型学习到更具区分性的社区健康表征。5) 预测模块:使用学习到的社区表征预测老年人慢性病患病率。

关键创新:CureGraph的关键创新在于:1) 多模态图表示学习:将多模态信息融合到图结构中,利用图神经网络学习节点表示,从而捕捉跨模态空间依赖关系。2) 对比学习:通过对比学习,鼓励模型学习到更具区分性的社区健康表征,提高预测精度。与现有方法的本质区别在于,CureGraph能够更全面地利用多模态信息,并有效捕捉节点之间的复杂关系。

关键设计:在多模态数据编码方面,使用了预训练的ResNet和BERT模型,并根据具体任务进行了微调。在图构建方面,使用了基于地理位置信息的K近邻图。在对比学习方面,采用了InfoNCE损失函数,并设置了合适的温度参数。在图神经网络方面,使用了两层GCN,并设置了合适的隐藏层维度。

🖼️ 关键图片

📊 实验亮点

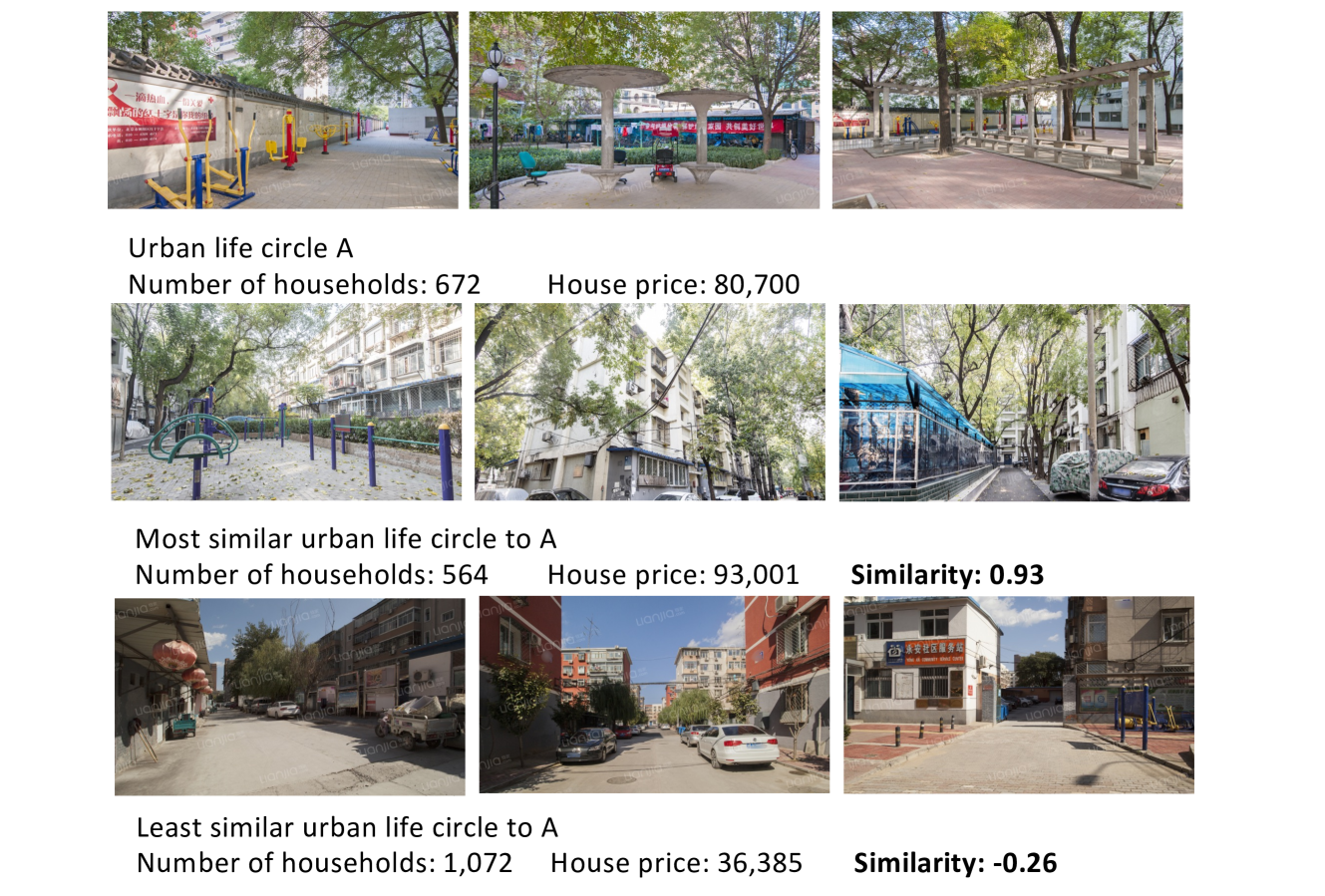

实验结果表明,CureGraph在老年疾病风险预测任务中显著优于现有方法。具体来说,CureGraph在R平方指标上平均比最佳基线提高了28%。此外,模型还能够识别阶段性慢性疾病进展,并支持跨社区的比较公共卫生分析,为公共卫生决策提供了有价值的见解。

🎯 应用场景

CureGraph可应用于城市规划、公共卫生政策制定等领域。通过分析不同社区的健康风险因素,可以为政府提供决策支持,例如优化公共设施布局、改善社区环境、制定针对性的健康干预措施。此外,该模型还可以用于预测未来健康风险,提前预警,从而更好地保障老年人的健康和福祉,促进可持续城市发展。

📄 摘要(原文)

The early detection and prediction of health status decline among the elderly at the neighborhood level are of great significance for urban planning and public health policymaking. While existing studies affirm the connection between living environments and health outcomes, most rely on single data modalities or simplistic feature concatenation of multi-modal information, limiting their ability to comprehensively profile the health-oriented urban environments. To fill this gap, we propose CureGraph, a contrastive multi-modal representation learning framework for urban health prediction that employs graph-based techniques to infer the prevalence of common chronic diseases among the elderly within the urban living circles of each neighborhood. CureGraph leverages rich multi-modal information, including photos and textual reviews of residential areas and their surrounding points of interest, to generate urban neighborhood embeddings. By integrating pre-trained visual and textual encoders with graph modeling techniques, CureGraph captures cross-modal spatial dependencies, offering a comprehensive understanding of urban environments tailored to elderly health considerations. Extensive experiments on real-world datasets demonstrate that CureGraph improves the best baseline by $28\%$ on average in terms of $R^2$ across elderly disease risk prediction tasks. Moreover, the model enables the identification of stage-wise chronic disease progression and supports comparative public health analysis across neighborhoods, offering actionable insights for sustainable urban development and enhanced quality of life. The code is publicly available at https://github.com/jinlin2021/CureGraph.