PoAct: Policy and Action Dual-Control Agent for Generalized Applications

作者: Guozhi Yuan, Youfeng Liu, Jingli Yang, Wei Jia, Kai Lin, Yansong Gao, Shan He, Zilin Ding, Haitao Li

分类: cs.AI

发布日期: 2025-01-13

💡 一句话要点

提出PoAct:一种策略与行动双重控制的Agent框架,用于通用任务

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Agent框架 大型语言模型 策略学习 行动控制 复杂推理

📋 核心要点

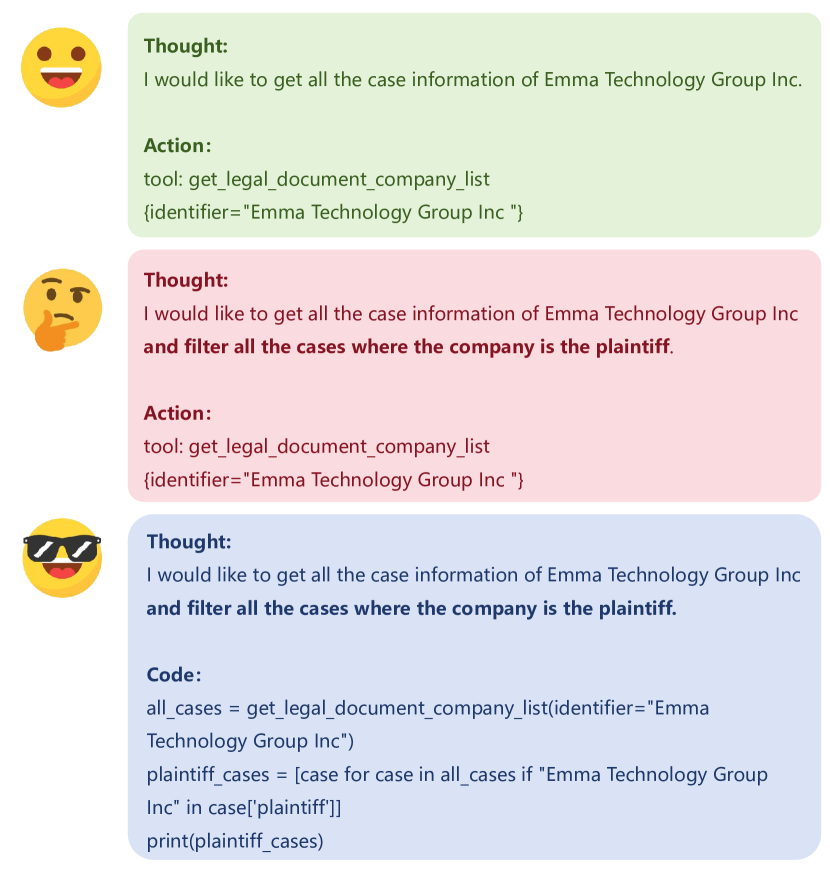

- ReAct类Agent在复杂推理中存在工具调用与复杂规划不一致的问题,Code Action虽然有所改进,但引入了更复杂的操作空间。

- PoAct通过动态切换推理策略和修改操作空间,旨在实现更高质量的代码操作和更准确的推理路径。

- 实验结果表明,PoAct在复杂任务中具有更强的推理能力,并在LegalAgentBench上比基线提高了20%,同时减少了token消耗。

📝 摘要(中文)

基于大型语言模型(LLM)的Agent框架在复杂推理任务中取得了显著成功。类似ReAct的Agent通过逐步规划和工具调用,迭代优化步骤,解决了各种复杂问题。然而,随着LLM规划能力的提高,ReAct类框架中的工具调用与复杂规划和数据组织常常不一致。Code Action解决了这些问题,但也引入了更复杂的操作空间和操作组织难题。为了利用Code Action并应对其复杂性带来的挑战,本文提出了一种用于通用应用的策略与行动双重控制Agent(PoAct)。旨在通过动态切换推理策略和修改操作空间,实现更高质量的代码操作和更准确的推理路径。在法律和通用场景的Agent Benchmark上的实验结果表明,我们的方法在复杂任务中具有卓越的推理能力并降低了token消耗。在LegalAgentBench上,我们的方法比基线提高了20%,同时减少了token消耗。我们在GPT-4o和GLM-4系列模型上进行了实验和分析,证明了我们的方法在解决复杂问题方面的巨大潜力和可扩展性。

🔬 方法详解

问题定义:现有基于LLM的Agent框架,如ReAct,在处理复杂推理任务时,工具调用与LLM的规划能力之间存在错位,导致行动与规划目标不一致。Code Action试图解决这个问题,但引入了更复杂的操作空间和行动组织问题,增加了Agent的学习和控制难度。

核心思路:PoAct的核心思路是引入策略与行动的双重控制机制。通过动态切换推理策略,Agent可以根据当前任务的复杂度和状态选择合适的推理方式。同时,通过修改操作空间,Agent可以更好地组织和执行行动,从而提高行动的质量和准确性。这种双重控制机制旨在弥合LLM规划能力与实际行动之间的差距。

技术框架:PoAct框架包含策略选择模块、行动执行模块和环境反馈模块。策略选择模块根据当前任务状态选择合适的推理策略,例如,对于简单任务选择快速推理策略,对于复杂任务选择深度推理策略。行动执行模块根据选择的策略执行相应的行动,并与环境交互。环境反馈模块将环境反馈信息传递给策略选择模块,用于调整推理策略和优化行动。

关键创新:PoAct的关键创新在于策略与行动的双重控制机制。与传统的ReAct类Agent相比,PoAct能够根据任务的复杂度和状态动态调整推理策略和操作空间,从而更好地适应不同的任务需求。这种动态调整能力使得PoAct在复杂任务中具有更强的适应性和鲁棒性。

关键设计:策略选择模块使用强化学习算法训练,根据任务状态和环境反馈选择最优的推理策略。行动执行模块使用Code Action作为基础行动空间,并根据选择的策略对行动空间进行修改,例如,增加或删除某些行动。环境反馈模块将环境状态、奖励信号等信息传递给策略选择模块,用于更新策略网络。

🖼️ 关键图片

📊 实验亮点

PoAct在LegalAgentBench上取得了显著的性能提升,相比基线方法提高了20%,同时减少了token消耗。在GPT-4o和GLM-4系列模型上的实验结果表明,PoAct具有良好的可扩展性,能够有效解决复杂问题。这些实验结果充分证明了PoAct的有效性和优越性。

🎯 应用场景

PoAct具有广泛的应用前景,可应用于法律咨询、智能客服、自动化编程、游戏AI等领域。通过动态切换推理策略和修改操作空间,PoAct能够更好地适应不同领域的任务需求,提高任务完成的效率和质量。未来,PoAct有望成为通用Agent框架的重要组成部分,推动人工智能技术的发展。

📄 摘要(原文)

Based on their superior comprehension and reasoning capabilities, Large Language Model (LLM) driven agent frameworks have achieved significant success in numerous complex reasoning tasks. ReAct-like agents can solve various intricate problems step-by-step through progressive planning and tool calls, iteratively optimizing new steps based on environmental feedback. However, as the planning capabilities of LLMs improve, the actions invoked by tool calls in ReAct-like frameworks often misalign with complex planning and challenging data organization. Code Action addresses these issues while also introducing the challenges of a more complex action space and more difficult action organization. To leverage Code Action and tackle the challenges of its complexity, this paper proposes Policy and Action Dual-Control Agent (PoAct) for generalized applications. The aim is to achieve higher-quality code actions and more accurate reasoning paths by dynamically switching reasoning policies and modifying the action space. Experimental results on the Agent Benchmark for both legal and generic scenarios demonstrate the superior reasoning capabilities and reduced token consumption of our approach in complex tasks. On the LegalAgentBench, our method shows a 20 percent improvement over the baseline while requiring fewer tokens. We conducted experiments and analyses on the GPT-4o and GLM-4 series models, demonstrating the significant potential and scalability of our approach to solve complex problems.