Dafny as Verification-Aware Intermediate Language for Code Generation

作者: Yue Chen Li, Stefan Zetzsche, Siva Somayyajula

分类: cs.SE, cs.AI, cs.CL, cs.LO, cs.PL

发布日期: 2025-01-10

💡 一句话要点

提出基于Dafny的验证感知中间语言,提升LLM生成代码的质量

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码生成 大型语言模型 形式化验证 Dafny 中间语言

📋 核心要点

- 大型语言模型生成的代码可能存在不易察觉的错误,降低了代码质量和可靠性。

- 利用Dafny作为中间表示,对LLM生成的代码进行形式化验证,确保代码满足预定规范。

- 原型系统在HumanEval Python代码生成基准测试上进行了评估,验证了该方法的可行性。

📝 摘要(中文)

本文探讨了如何利用形式化方法来提高大型语言模型(LLM)生成的代码质量。针对LLM直接生成代码时存在的潜在错误问题,论文提出了一种新方法:引导LLM首先生成一种不透明的、验证感知的中间表示,即Dafny语言代码。Dafny代码可以根据预先设定的规范自动验证其正确性。验证通过的Dafny程序随后被编译成目标语言,并返回给用户。整个过程中,用户与系统之间的交互都通过自然语言进行,Dafny代码对用户是不可见的。论文描述了当前的原型系统,并报告了其在HumanEval Python代码生成基准测试上的性能表现。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在代码生成过程中产生的代码质量问题。现有方法直接生成目标代码,但缺乏有效的验证机制,导致生成的代码可能存在潜在的、不易发现的错误,影响代码的可靠性。

核心思路:论文的核心思路是引入形式化验证,在LLM生成目标代码之前,先生成一种可验证的中间表示。具体而言,选择Dafny作为中间语言,因为Dafny是一种支持形式化验证的编程语言,可以对生成的代码进行自动验证,确保其满足预定的规范。

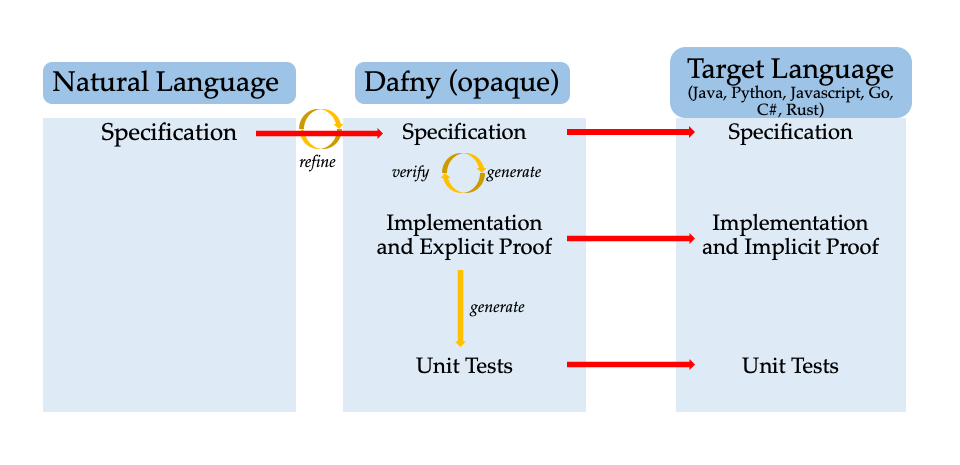

技术框架:整体框架包含以下几个阶段:1) 用户通过自然语言向系统提出代码生成需求;2) LLM根据用户需求生成Dafny代码;3) Dafny验证器对生成的Dafny代码进行验证,检查其是否满足预定规范;4) 如果验证通过,则将Dafny代码编译成目标语言代码;5) 将目标语言代码返回给用户。整个过程中,用户只与系统进行自然语言交互,无需接触Dafny代码。

关键创新:最重要的创新点在于将形式化验证融入到LLM代码生成流程中,利用Dafny作为验证感知的中间语言,实现了对LLM生成代码的自动验证。这与传统方法直接生成目标代码的方式有本质区别,提高了代码的可靠性和质量。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构等技术细节,重点在于验证框架的搭建和Dafny语言的应用。未来的研究可以探索如何优化LLM生成Dafny代码的质量,以及如何更有效地利用Dafny验证器进行代码验证。

🖼️ 关键图片

📊 实验亮点

论文报告了原型系统在HumanEval Python代码生成基准测试上的性能表现,但具体的数据和对比基线未在摘要中给出。因此,具体的性能提升幅度未知。未来的研究需要提供更详细的实验结果,以充分展示该方法的优势。

🎯 应用场景

该研究成果可应用于各种需要高质量代码自动生成的场景,例如软件开发、自动化测试、嵌入式系统等。通过形式化验证,可以显著提高生成代码的可靠性和安全性,降低软件开发和维护成本。未来,该方法有望成为LLM代码生成的重要组成部分,推动软件工程领域的自动化发展。

📄 摘要(原文)

Using large language models (LLMs) to generate source code from natural language prompts is a popular and promising idea with a wide range of applications. One of its limitations is that the generated code can be faulty at times, often in a subtle way, despite being presented to the user as correct. In this paper, we explore ways in which formal methods can assist with increasing the quality of code generated by an LLM. Instead of emitting code in a target language directly, we propose that the user guides the LLM to first generate an opaque intermediate representation, in the verification-aware language Dafny, that can be automatically validated for correctness against agreed on specifications. The correct Dafny program is then compiled to the target language and returned to the user. All user-system interactions throughout the procedure occur via natural language; Dafny code is never exposed. We describe our current prototype and report on its performance on the HumanEval Python code generation benchmarks.