Collaboration of Large Language Models and Small Recommendation Models for Device-Cloud Recommendation

作者: Zheqi Lv, Tianyu Zhan, Wenjie Wang, Xinyu Lin, Shengyu Zhang, Wenqiao Zhang, Jiwei Li, Kun Kuang, Fei Wu

分类: cs.IR, cs.AI, cs.CL, cs.DC

发布日期: 2025-01-10 (更新: 2025-02-25)

备注: Published on KDD'25: Proceedings of the ACM SIGKDD Conference on Knowledge Discovery and Data Mining 2025

💡 一句话要点

提出设备-云端LLM-SRM协同推荐框架,解决LLM推荐实时性不足问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推荐系统 设备-云端协同 小型推荐模型 实时推荐

📋 核心要点

- LLM在推荐系统中表现出色,但训练和推理成本高昂,难以频繁更新,且难以访问实时数据,限制了其应用。

- LSC4Rec框架利用小型推荐模型(SRM)资源消耗低、易于部署在设备端并能访问实时数据的优势,弥补LLM的不足。

- 通过协同训练、协同推理和智能请求三种策略,LSC4Rec有效整合了LLM和SRM的优势,实验验证了各策略的有效性。

📝 摘要(中文)

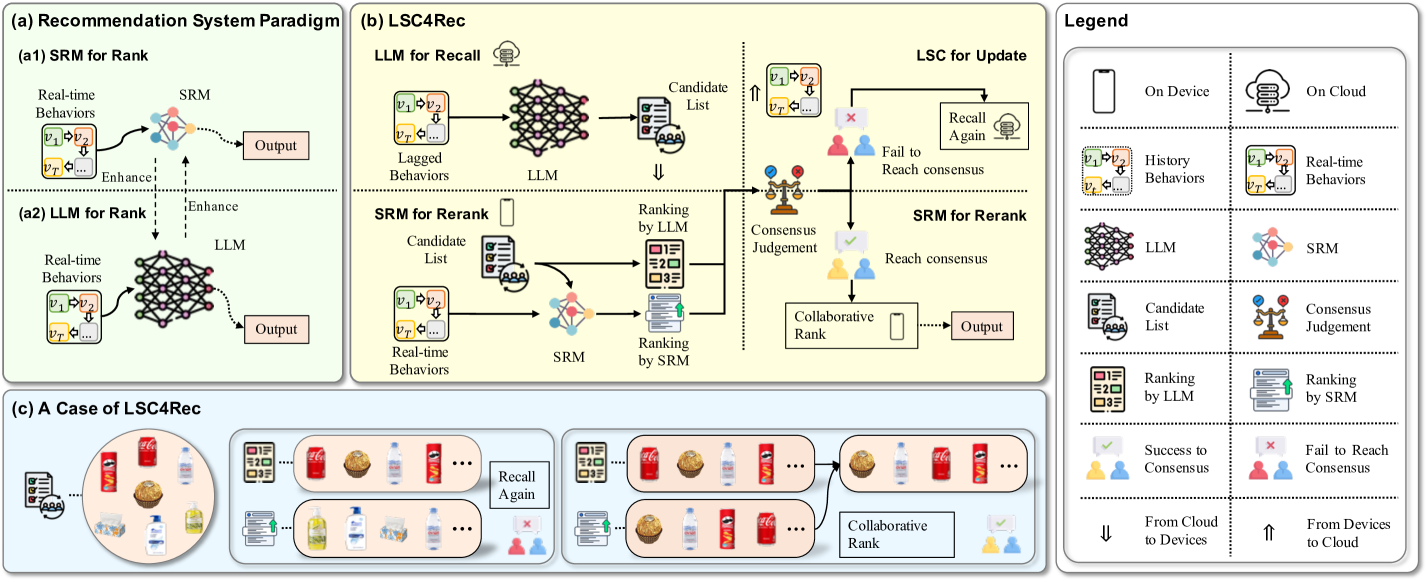

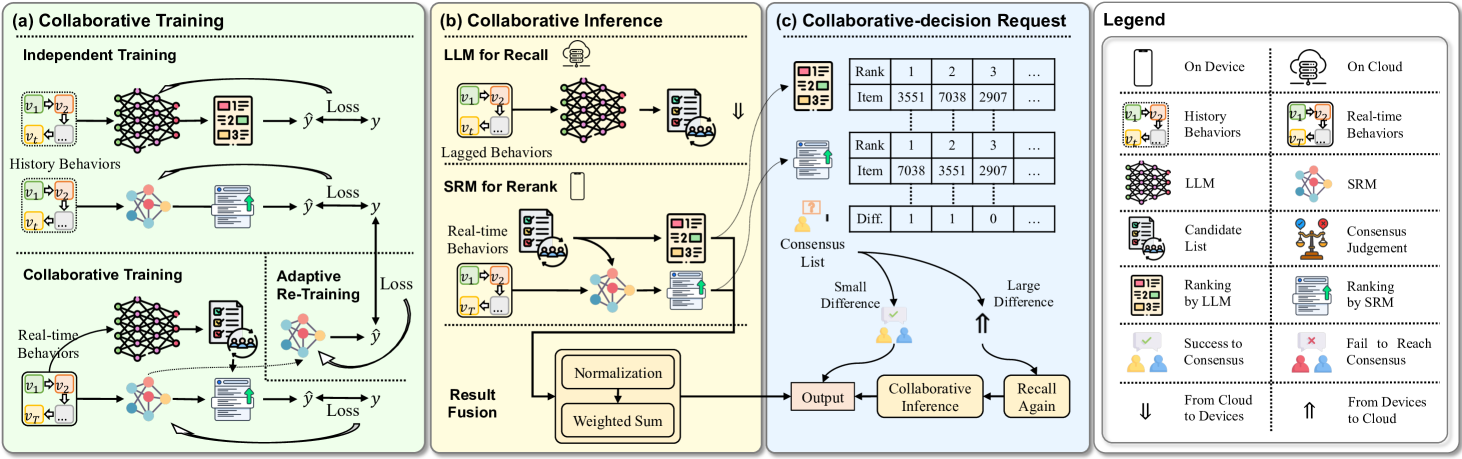

本文提出了一种设备-云端LLM-SRM协同推荐框架(LSC4Rec),旨在整合大型语言模型(LLM)和小推荐模型(SRM)的优势,以及云和边缘计算的优点,实现互补协同。LSC4Rec通过三种策略增强了实用性:协同训练、协同推理和智能请求。在训练期间,LLM生成候选列表,以增强SRM在协同场景中的排序能力,并使SRM能够自适应地更新以捕获实时用户兴趣。在推理期间,LLM和SRM分别部署在云端和设备上。LLM基于用户行为生成候选列表和初始排序结果,SRM基于候选列表重新排序,最终结果整合LLM和SRM的分数。设备通过比较LLM和SRM排序列表的一致性来确定是否需要新的候选列表。全面的实验分析验证了LSC4Rec中每种策略的有效性。

🔬 方法详解

问题定义:现有的大型语言模型推荐(LLM4Rec)方法虽然性能优异,但存在两个主要痛点:一是训练和推理成本高,难以频繁更新模型;二是难以获取实时用户数据,因为模型参数量巨大,不方便部署在设备端。这些问题限制了LLM4Rec在实际应用中的效果。

核心思路:本文的核心思路是利用小型推荐模型(SRM)的优势来弥补LLM的不足。SRM资源消耗低,可以方便地部署在设备端,并且能够实时访问用户数据。通过LLM和SRM的协同,可以兼顾推荐的准确性和实时性。

技术框架:LSC4Rec框架采用设备-云端协同架构。在云端部署LLM,负责生成候选列表和初步排序;在设备端部署SRM,负责基于候选列表进行重排序。框架包含三个主要模块:协同训练模块、协同推理模块和智能请求模块。协同训练模块利用LLM生成的候选列表来提升SRM的排序能力,并使SRM能够自适应地捕获实时用户兴趣。协同推理模块将LLM和SRM的排序结果进行融合,得到最终的推荐结果。智能请求模块根据LLM和SRM排序结果的一致性,决定是否需要从云端请求新的候选列表。

关键创新:该论文的关键创新在于提出了一个设备-云端协同的LLM-SRM推荐框架,并设计了协同训练、协同推理和智能请求三种策略。这种框架能够有效地整合LLM和SRM的优势,实现互补协同。与现有方法相比,LSC4Rec能够更好地兼顾推荐的准确性和实时性,更适合实际应用。

关键设计:协同训练阶段,LLM生成候选列表作为SRM训练的补充信息,具体如何生成候选列表以及如何融入SRM的训练过程,论文中没有详细说明。协同推理阶段,LLM和SRM的排序结果如何融合,论文中也没有给出具体的融合方法。智能请求模块中,LLM和SRM排序列表一致性的判断标准,以及触发新候选列表请求的阈值,这些关键参数的具体设置在论文中也未提及。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了LSC4Rec框架的有效性,以及协同训练、协同推理和智能请求三种策略的贡献。具体的性能数据和对比基线在摘要中未提及,因此无法给出量化的提升幅度。但实验结果表明,LSC4Rec能够有效地整合LLM和SRM的优势,提升推荐的准确性和实时性。

🎯 应用场景

该研究成果可应用于各种需要实时用户偏好感知的推荐场景,例如电商、新闻推荐、短视频推荐等。通过设备-云端协同,可以提供更个性化、更及时的推荐服务,提升用户体验和平台收益。未来的发展方向包括进一步优化LLM和SRM的协同方式,以及探索更智能的请求策略。

📄 摘要(原文)

Large Language Models (LLMs) for Recommendation (LLM4Rec) is a promising research direction that has demonstrated exceptional performance in this field. However, its inability to capture real-time user preferences greatly limits the practical application of LLM4Rec because (i) LLMs are costly to train and infer frequently, and (ii) LLMs struggle to access real-time data (its large number of parameters poses an obstacle to deployment on devices). Fortunately, small recommendation models (SRMs) can effectively supplement these shortcomings of LLM4Rec diagrams by consuming minimal resources for frequent training and inference, and by conveniently accessing real-time data on devices. In light of this, we designed the Device-Cloud LLM-SRM Collaborative Recommendation Framework (LSC4Rec) under a device-cloud collaboration setting. LSC4Rec aims to integrate the advantages of both LLMs and SRMs, as well as the benefits of cloud and edge computing, achieving a complementary synergy. We enhance the practicability of LSC4Rec by designing three strategies: collaborative training, collaborative inference, and intelligent request. During training, LLM generates candidate lists to enhance the ranking ability of SRM in collaborative scenarios and enables SRM to update adaptively to capture real-time user interests. During inference, LLM and SRM are deployed on the cloud and on the device, respectively. LLM generates candidate lists and initial ranking results based on user behavior, and SRM get reranking results based on the candidate list, with final results integrating both LLM's and SRM's scores. The device determines whether a new candidate list is needed by comparing the consistency of the LLM's and SRM's sorted lists. Our comprehensive and extensive experimental analysis validates the effectiveness of each strategy in LSC4Rec.